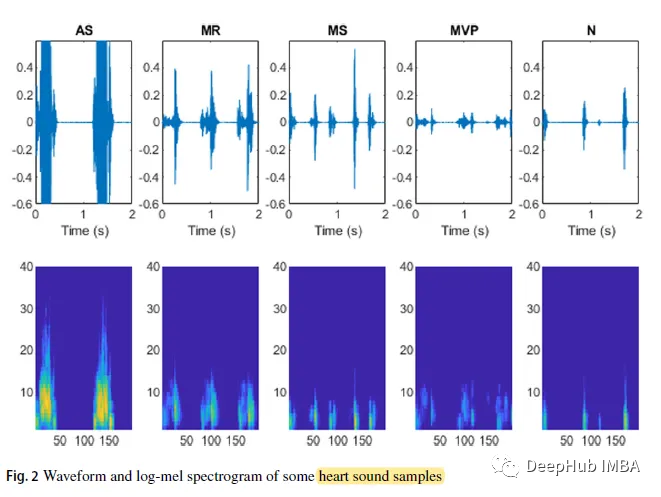

基于对数谱图的深度学习心音分类

这是一篇很有意思的论文,他基于心音信号的对数谱图,提出了两种心率音分类模型,我们都知道:频谱图在语音识别上是广泛应用的,这篇论文将心音信号作为语音信号处理,并且得到了很好的效果。

基于自注意力机制的LSTM多变量负荷预测

在之前使用长短期记忆网络构建电力负荷预测模型的基础上,将自注意力机制 (Self-Attention)融入到负荷预测模型中。具体内容是是在LSTM层后面接Self-Attention层,在加入Self-Attention后,可以将负荷数据通过加权求和的方式进行处理,对负荷特征添加注意力权重,来突出负

lstm轴承寿命预测

自用

【阅读论文】基于VAE-LSTM混合模型的时间序列异常检测

在这项工作中,我们提出了一种VAE-LSTM混合模型,作为一种无监督的时间序列异常检测方法。我们的模型既利用VAE模块在短窗口上形成稳健的局部特征,又利用LSTM模块在从VAE模块推断的特征之上估计序列中的长期相关性。因此,我们的检测算法能够识别跨越多个时间尺度的异常。我们证明了我们的检测算法在五个

时间序列预测股票数据—以LSTM模型为例

时间序列是按照一定时间间隔排列的数据,时间间隔可以是任意时间单位,通过对时间序列的分析,我们可以探寻到其中的现象以及变化规律,并将这些信息用于预测。这就需要一系列的模型,用于将原始时间序列数据放进模型中进行训练,并用训练好的时间序列模型来预测未知的时间序列。提供的数据:“中国平安”2016-2018

PyTorch搭建LSTM神经网络实现文本情感分析实战(附源码和数据集)

PyTorch搭建LSTM神经网络实现文本情感分析实战(附源码和数据集)

LSTM和双向LSTM讲解及实践

慢慢的将各种双向LSTM全部都将其搞定都行啦的回事与打算。

长短时记忆网络(Long Short Term Memory,LSTM)详解

长短时记忆网络(LSTM)基本原理与基于Pytorch的实现方法。

使用LSTM预测结果为一条直线原因总结

使用LSTM预测结果为一条直线原因总结

LSTM+注意力机制(Attention)实现时间序列预测(PyTorch版)

本专栏整理了《深度学习时间序列预测案例》,内包含了各种不同的基于深度学习模型的时间序列预测方法,例如LSTM、GRU、CNN(一维卷积、二维卷积)、LSTM-CNN、BiLSTM、Self-Attention、LSTM-Attention、Transformer等经典模型,包含项目原理以及源码,每一

LSTM实现多变量输入多步预测(直接多输出)时间序列预测(PyTorch版)

本专栏整理了《深度学习时间序列预测案例》,内包含了各种不同的基于深度学习模型的时间序列预测方法,例如LSTM、GRU、CNN(一维卷积、二维卷积)、LSTM-CNN、BiLSTM、Self-Attention、LSTM-Attention、Transformer等经典模型,💥💥💥包含项目原理以

【深度学习】——LSTM参数设置

LSTM的批大小可以根据训练数据集的大小和计算资源的限制来确定。一般而言,批大小,训练速度越快,但可能会导致过拟合和内存限制。批大小越小,训练速度越慢,但对于较大的数据集和内存限制较严格的情况下会更加稳定。在实践中,可以通过尝试不同的批大小来找到最优的批大小。一种常用的方法是开始使用较小的批大小,然

【机器学习】GRU 讲解

GRU RNN LSTM 长期依赖问题 前向传播 重置门 更新门 输入门 输出门 遗忘门

LSTM多步时间序列预测+区间预测(附代码实现)

LSTM多步时间序列预测,往后滚动预测,及其区间预测

基于PyTorch+LSTM的交通客流预测(时间序列分析)

将深度学习与交通客流时间分布特征相结合,能够有效地揭示轨道交通客流量的变化趋势。本文将使用LSTM进行较为客观的客流量预测数据统计,并通过深度学习将预测结果应用于实践之中对轨道交通发车频次进行合理优化。

【nn.LSTM详解】

nn.LSTM详解

GC-LSTM:用于动态网络链路预测的图卷积嵌入原理+代码(上)原理部分

GC-LSTM利用GCN提取图数据的拓扑结构特征,LSTM提取序列数据的时序特征,从而能够对动态变化的图拓扑进行预测。本文详细介绍了GC-LSTM模型的原理,并基于PYG Temporal对其进行代码实现。

最通俗易懂的LSTM讲解,一个例子理解通透!!

LSTM 最通俗的理解!!!

利用pytorch长短期记忆网络LSTM实现股票预测分析

长短时记忆网络(Long Short Term Memory Network, LSTM),是一种改进之后的循环神经网络,可以解决RNN无法处理长距离的依赖的问题,目前比较流行。LSTM主要就是加入了三个门控:第一个开关遗忘门:负责控制继续保存长期状态c;第二个开关输入门:负责控制把即时状态输入到长

人工智能(Pytorch)搭建LSTM网络实现简单案例

LSTM网络是一种特殊的循环神经网络,它能够学习处理序列中的长期依赖性,而不会受到梯度消失或梯度爆炸的影响。LSTM中的关键组成部分是门控机制,它允许网络选择性地丢弃或保留信息。在训练过程中,LSTM网络通过反向传播算法自动调整门控单元的参数,使其能够更好地适应数据。PyTorch是一个基于Pyth