五、CNN-LSTM数据驱动模型

CNN-LSTM数据驱动模型6.1 基本原理深度学习是机器学习前沿且热门的理论,而其中的两大框架卷积神经网络(CNN)以及长短期记忆网络(LSTM)是深度学习的代表,CNN能过够通过使用卷积核从样本数据中提取出其潜在的特征,而长短期记忆网络LSTM能够捕捉到长期的成分。近年来两者的结合成为研究的热点

基于时序模式注意力机制(TPA)的长短时记忆(LSTM)网络TPA-LSTM的多变量输入风电功率预测

0 前言1、TPA理论注意力机制(Attention mechanism)通常结合神经网络模型用于序列预测,使得模型更加关注历史信息与当前输入信息的相关部分。时序模式注意力机制(Temporal Pattern Attention mechanism, TPA)由 Shun-Yao Shih 等提出

基于长短期记忆神经网络LSTM的预测模型(matlab实现)

长短期记忆神经网络(LSTM)是循环神经网络中的一种。由于普通的神经网络出现如上的问题,长短期记忆神经网络来源于对循环神经网络的改进和优化,有效解决了循环神经网络中出现的梯度消失或梯度爆炸等问题,可用于处理更复杂的时间序列问题。长短期记忆神经网络通过独特设计的遗忘门、输入们和输出门,在设计的开始就默

LSTM实现多变量输入多步预测(Seq2Seq多步预测)时间序列预测(PyTorch版)

本专栏整理了《深度学习时间序列预测案例》,内包含了各种不同的基于深度学习模型的时间序列预测方法,例如LSTM、GRU、CNN(一维卷积、二维卷积)、LSTM-CNN、BiLSTM、Self-Attention、LSTM-Attention、Transformer等经典模型,包含项目原理以及源码,每一

LSTM反向传播原理——LSTM从零实现系列(2)

lstm反向传播原理

LSTM实现时间序列预测(PyTorch版)

为了训练数据,首先定义LSTM模型,然后再定义对应的损失函数,由于我们这里是风速预测,显然是个回归问题,所以采用回归问题常用的MESLoss(),如果可以的话,可以自定义损失函数,针对自己的项目需求定义对应的损失函数。对于优化器来讲,使用的也是目前常用的Adam优化器,对于新手来讲也可以多多尝试其它

Attention-LSTM模型的python实现

1.模型结构Attention-LSTM模型分为输入层、LSTM 层、Attention层、全连接层、输出层五层。LSTM 层的作用是实现高层次特征学习;Attention 层的作用是突出关键信息;全连接层的作用是进行局部特征整合,实现最终的预测。 这里解决的问题是:使用Attention-L

CNN+LSTM+Attention实现时间序列预测(PyTorch版)

本专栏整理了《深度学习时间序列预测案例》,内包含了各种不同的基于深度学习模型的时间序列预测方法,例如LSTM、GRU、CNN(一维卷积、二维卷积)、LSTM-CNN、BiLSTM、Self-Attention、LSTM-Attention、Transformer等经典模型,包含项目原理以及源码,每一

使用PyTorch-LSTM进行单变量时间序列预测的示例教程

在本教程中,我们将使用PyTorch-LSTM进行深度学习时间序列预测。

长短期记忆(LSTM)详解

目录一、背景二、原理三、总结四、LSTM的优缺点五、LSTM代码实现一、背景 当时间步数(T)较大或时间步(t)较小的时候,RNN的梯度较容易出现衰减或爆炸。虽然裁剪梯度可以应对梯度爆炸,但是无法解决梯度衰减的问题。这个原因使得RNN在实际中难以捕捉时间序列中时间步(t)距离较大的依赖关系。因

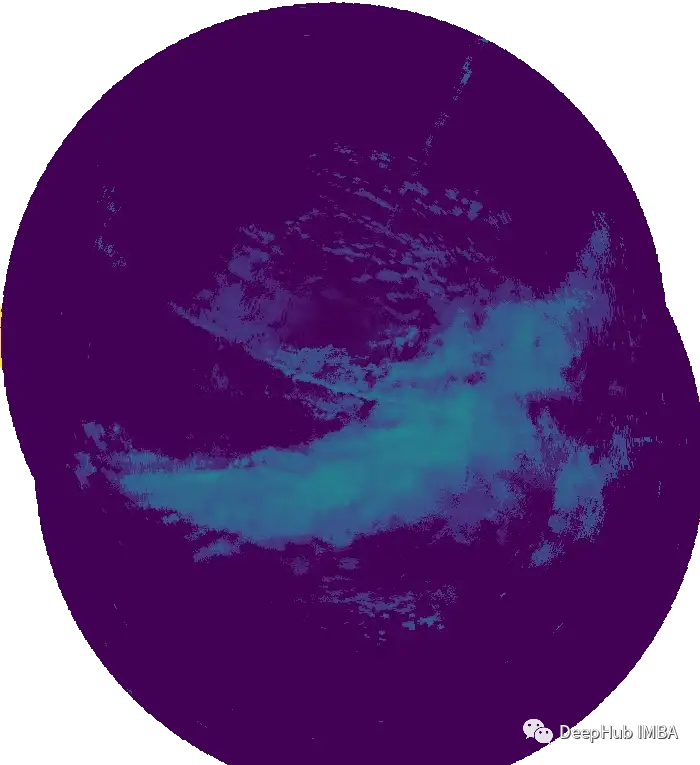

基于CNN和LSTM的气象图降水预测示例

我们是否可以通过气象图来预测降水量呢?今天我们来使用CNN和LSTM进行一个有趣的实验。

LSTM详解

LSTM详解文章目录LSTM详解改进记忆单元门控机制LSTM结构LSTM的计算过程遗忘门输入门更新记忆单元输出门通过LSTM循环单元,整个网络可以建立较长距离的时序依赖关系,以上公式可以简洁地描述为$$\begin{bmatrix}\tilde{c}_t \\o_t \\i_t \\f_t\end{

基于时序模式注意力机制(TPA)的长短时记忆(LSTM)网络TPA-LSTM的多变量输入风电功率预测

0 前言1、TPA理论注意力机制(Attention mechanism)通常结合神经网络模型用于序列预测,使得模型更加关注历史信息与当前输入信息的相关部分。时序模式注意力机制(Temporal Pattern Attention mechanism, TPA)由 Shun-Yao Shih 等提出

【nn.LSTM详解】

nn.LSTM详解

[时间序列预测]基于BP、LSTM、CNN-LSTM神经网络算法的单特征用电负荷预测[保姆级手把手教学]

本文章主要从3个算法BP、LSTM、CNN-LSTM进行时间序列预测的讲解,主要案例是利用单特征电力负荷预测进行讲解。对比三个模型在用电负荷预测中的优越性。

Keras深度学习实战——使用长短时记忆网络构建情感分析模型

我们已经学习了如何使用循环神经网络 (Recurrent neural networks, RNN) 构建情感分析模型,为了将循环神经网络与长短时记忆网络 (Long Short Term Memory, LSTM) 的性能进行对比,同时也为了加深对 LSTM 的了解,在节中,我们将使用 LSTM

【深度学习100例】—— 利用pytorch长短期记忆网络LSTM实现股票预测分析 | 第5例

长短时记忆网络(Long Short Term Memory Network, LSTM),是一种改进之后的循环神经网络,可以解决RNN无法处理长距离的依赖的问题,目前比较流行。LSTM主要就是加入了三个门控:第一个开关遗忘门:负责控制继续保存长期状态c;第二个开关输入门:负责控制把即时状态输入到长

猿创征文丨深度学习基于双向LSTM模型完成文本分类任务

大家好,我是猿童学,本期猿创征文的第三期,也是最后一期,给大家带来神经网络中的循环神经网络案例,基于双向LSTM模型完成文本分类任务,数据集来自kaggle,对电影评论进行文本分类。电影评论可以蕴含丰富的情感:比如喜欢、讨厌、等等.情感分析(Sentiment Analysis)是为一个文本分类问题

TensorFlow搭建LSTM实现时间序列预测(负荷预测)

TensorFlow搭建LSTM实现时间序列预测(负荷预测)

文科生也能理解的LSTM,图文并茂!

一句话介绍LSTM,它是RNN的进阶版,如果说RNN的最大限度是理解一句话,那么LSTM的最大限度则是理解一段话,详细介绍如下:LSTM,全称为长短期记忆网络(Long Short Term Memory networks),是一种特殊的RNN,能够学习到长期依赖关系。1997提出,许多研究者进行了