【PyTorch】多对象分割项目

对象分割任务的目标是找到图像中目标对象的边界。实际应用例如自动驾驶汽车和医学成像分析。这里将使用PyTorch开发一个深度学习模型来完成多对象分割任务。多对象分割的主要目标是自动勾勒出图像中多个目标对象的边界。对象的边界通常由与图像大小相同的分割掩码定义,在分割掩码中属于目标对象的所有像素基于预定义

【传知代码】LAD-GNN标签注意蒸馏(论文复现)

在当今的数据科学领域,Graph Neural Networks (GNNs) 已成为处理图结构数据的强大工具。然而,传统的GNN在图分类任务中面临一个重要挑战——嵌入不对齐问题。本文将介绍一篇名为“Label Attentive Distillation for GNN-Based Graph C

【人工智能】Transformers之Pipeline(七):图像分割(image-segmentation)

本文对transformers之pipeline的图像分割(image-segmentation)从概述、技术原理、pipeline参数、pipeline实战、模型排名等方面进行介绍,读者可以基于pipeline使用文中的2行代码极简的使用计算机视觉中的图像分割(image-segmentation

Transformer预测模型及其Python和MATLAB实现

通过将输入的查询、键和值线性变换为多个不同的头部,然后并行计算每个头的注意力,最后将所有头的结果拼接后经过线性变换。- **查询(Query)、键(Key)和值(Value)**:对输入的词嵌入进行线性变换,得到查询、键和值。- **解码器**:解码器结构类似于编码器,但在每个层中加入了对先前生成的

【AI大数据计算原理与代码实例讲解】Hadoop

【AI大数据计算原理与代码实例讲解】Hadoop作者:禅与计算机程序设计艺术 / Zen and the Art of Computer Programming关键词:Hadoop, 分布式计算, 大数据, 数据处理框架, YARN, MapReduce1

Pyinstaller打包OSError: could not get source code【终极解决】

pyinstaller 打包报错 torch.jit.script

探索LLaMA模型:架构创新与Transformer模型的进化之路

LLaMA模型代表了一种先进的人工智能技术,能够在自然语言处理(NLP)任务上表现出卓越的能力,如文本生成、问答、对话交互、机器翻译以及其他基于语言的理解和生成任务。LLaMA模型家族的特点在于包含了不同参数规模的多个模型版本,参数量从70亿(7B)至650亿(65B)不等。这些模型设计时借鉴了Ch

【机器学习】基于3D CNN通过CT图像分类预测肺炎

本文深入探讨了3D卷积神经网络(3D CNN)在CT图像肺炎分类预测中的应用。通过构建高效的3D CNN模型,结合精确的数据预处理和增强技术,实验结果表明该模型在医学影像诊断中具有显著的潜力。尽管面临数据规模和计算资源的挑战,但通过模型优化和跨学科合作,有望进一步提升性能。未来研究将着眼于扩大数据集

认识神经网络【多层感知器数学原理】

简单认识神经网络,学习多层感知器的数学原理和公式

模型安全与对抗攻防原理与代码实战案例讲解

模型安全与对抗攻防原理与代码实战案例讲解作者:禅与计算机程序设计艺术 / Zen and the Art of Computer Programming1. 背景介绍1.1 问题的由来随着人工智能技术的飞速发展,深

2024年最新AI大模型,一文带你走进AI搜索!

随着技术的不断进步,这些AI工具将更加深入我们的生活,成为我们探索知识、解决问题的得力助手。智能对话,数据分析,语音识别和多平台支持,提供智能化、便捷化、高效化的解决方案。功能:华为的盘古大模型,它不仅支持知识问答、文案生成、代码生成,以及多模态大模型的图像生成、图像理解等能力集,还支持雷达、红外线

AI Agent: AI的下一个风口 自然语言带来交互革命

AI Agent: AI的下一个风口 自然语言带来交互革命1. 背景介绍1.1 人工智能的发展历程人工智能(Artificial Intelligence, AI)是当代科技领域最具革命性和影响力的技术之一

Kafka Offset原理与代码实例讲解

Kafka Offset原理与代码实例讲解作者:禅与计算机程序设计艺术 / Zen and the Art of Computer Programming关键词:Kafka,Offset,消息队列,分布式系统,数据流处理1. 背景介绍

YOLOv10改进 | 特殊场景检测篇 | 轻量级的低照度图像增强网络IAT改进YOLOv10暗光检测(全网独家首发)

本文给大家带来的改进机制是轻量级的变换器模型:Illumination Adaptive Transformer (IAT),用于图像增强和曝光校正。其基本原理是通过分解图像信号处理器(ISP)管道到局部和全局图像组件,从而恢复在低光或过/欠曝光条件下的正常光照sRGB图像。具体来说,IAT使用注意

Datawhale AI 夏令营——从零入门CV图像竞赛(Deepfake攻防) & Task2

深度学习()是一种机器学习方法,通过使用人工神经网络()来模拟人脑的功能,从而进行数据处理和模式识别。它属于人工智能()的一个分支,主要通过大量数据和计算资源来训练多层神经网络模型,以实现复杂的任务。

开源模型应用落地-Yi模型小试-开源模型 vs 闭源模型(四)

测试零一万物的闭源模型,并与其开源模型进行比较

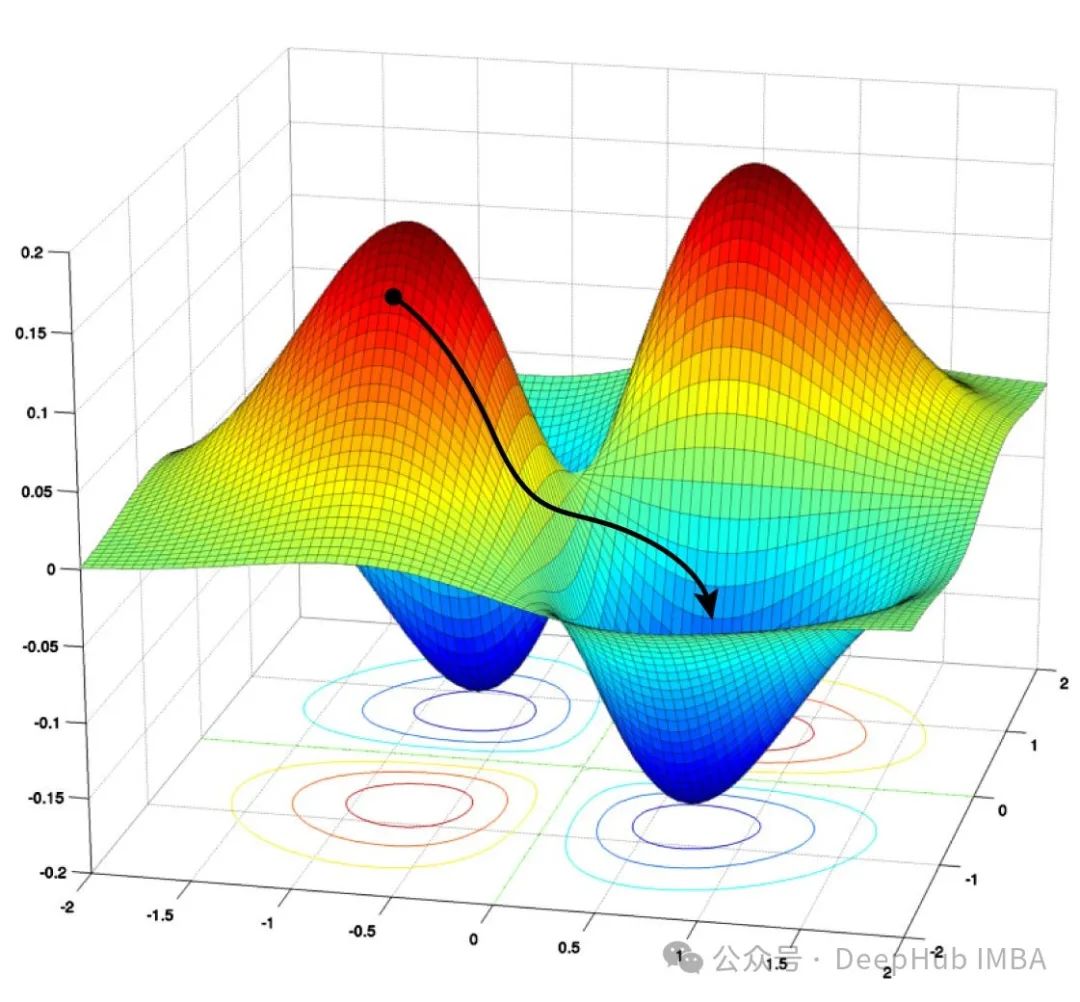

Adam-mini:内存占用减半,性能更优的深度学习优化器

论文提出一种新的优化器Adam-mini,在不牺牲性能的情况下减少Adam优化器的内存占用。

机器学习课程设计,人工智能课程设计,深度学习课程设计--基于Transformer的家庭暴力情绪检测系统(欢迎私)

家庭暴力在现今社会屡见不鲜,成为威胁社会和谐与稳定的重要问题之一。家庭暴力不仅包括身体上的虐待,还涉及情感、心理和经济上的虐待,给受害者尤其是女性和儿童带来深远的负面影响。有效预防和处理家庭暴力事件,及时感知和理解伴侣的情感显得尤为重要。为了帮助社会稳定,提高居民生活幸福指数,本系统选取了CMU-M

【AI大数据计算原理与代码实例讲解】大数据

【AI大数据计算原理与代码实例讲解】大数据作者:禅与计算机程序设计艺术 / Zen and the Art of Computer Programming关键词:大数据计算原理, 大数据存储, 数据处理流程, 分布式计算, MapReduce, Spark, Hadoop生态系统

减轻幻觉新SOTA,7B模型自迭代训练效果超越GPT-4,上海AI lab发布

本文通过迭代自我训练,逐步扩大数据集的多样性和规模,并提高幻觉标注器的准确性。最终得到的ANAH-v2仅用7B参数在各种幻觉检测基准测试中首次超过了GPT-4,并在第三方幻觉检测基准测试中表现出色。ANAH-v2不仅提供了一个基于的扩展数据集的自动幻觉评估基准,为未来幻觉缓解研究铺平了道路,还通过简