三元组损失Triplet loss 详解

在这篇文章中,我们将以简单的技术术语解析三元组损失及其变体批量三元组损失,并提供一个相关的例子来帮助你理解这些概念。

CV10_模型、特征图、CAM热力图可视化

https://www.bilibili.com/video/BV17i421U73P/?spm_id_from=333.999.0.0&vd_source=7dace3632125a1ef7fd32c285eb2fbac

Datawhale AI 夏令营Task02:从baseline入门深度学习

Task2的内容在Task1的基础上更深入了一些,上次是初窥的话,这次就是深入入门了,已经进了深度学习这扇大门了,哈哈哈哈哈哈。之前就是扒在门框上偷偷看了几眼。言归正传,使用手册因为涉及的内容太多,所以讲的相对浅一些,其中涉及代码的部分也不多,主要是原理,并且更多的内容还需要大家自行查阅。代码的话则

美团的 AI 面试有点简单

数据增强是一种通过对原始数据集进行变换,生成新的训练样本的技术。这些变换包括图像翻转、旋转、缩放、裁剪以及其他各种手法,通过引入这些变化,可以有效地扩充数据集的规模,提高模型的泛化能力。是不是很简单?将原始数据集做一些变换然后送给模型做训练,此时裁剪出来的图片,可能就是猫咪尖尖的耳朵和大大的眼睛,训

在 AutoDL 平台配置 U-Mamba 环境并训练医学图像分割

最近,处理长序列任务的 Mamba 模型较为火爆。U-Mamba 的作者设计了一个混合的 CNN-SSM(卷积神经网络 - 状态空间序列模型)块,它结合了 CNN 的局部特征提取能力以及 SSM 捕捉长距离依赖的能力,还充分利用了 UNet 的 U 型结构的优势,从而提出了 U-Mamba 网络。通

【环境搭建】使用openSfM+MVSNet重建稠密点云

本帖详细介绍了如何使用openSfM+MVSNet对真实采集的数据进行稀疏重建与稠密重建,并针对一些真实场景下可能遇到的问题进行了整理。

YOLOv10有效涨点专栏目录 | 目前已有90+篇内容,内含各种卷积模块,主干网络,注意力机制,损失函数等创新点改进

YOLOv10专栏持续复现网络上各种顶会内容,同时专栏内容可以用于YOLOv8改进~,欢迎大家订阅!!!

注意力机制(Attention)原理与代码实战案例讲解

注意力机制(Attention)原理与代码实战案例讲解1. 背景介绍1.1 问题的由来在深度学习领域,特别是在自然语言处理(NLP)任务中,注意力机制(Attention Mechanism)的引入极大地提升了模型的性能

粒子群算法(Particle Swarm Optimization) 原理与代码实例讲解

粒子群算法(Particle Swarm Optimization) - 原理与代码实例讲解1. 背景介绍1.1 问题的由来随着优化理论和计算机科学的快速发展,面对复杂多变的问题,传

百川大模型微调指令详解

设定 beta2 为 0.98 比默认的 0.999 稍低,可能会使得优化过程对历史信息的依赖程度降低,从而提高优化过程的灵活性,但也可能增加训练过程中的噪声。在使用 Adam 或其他类似的优化算法(如 RMSprop、Adagrad)时,历史梯度对当前梯度的影响主要体现在如何计算梯度的动量(即梯度

AI Agent: AI的下一个风口 从图形用户界面到自然语言的进化

在计算机发展的早期阶段,命令行界面(Command Line Interface, CLI)是用户与计算机交互的主要方式。用户需要记忆和输入各种命令来执行操作,这对用户的专业技能要求较高,使用起来并不友好。AI Agent (人工智能代理) 是指能够感知环境、进行决策和执行动作的智能体,它可以模拟人

Spark GraphX图计算引擎原理与代码实例讲解

Spark GraphX图计算引擎原理与代码实例讲解1.背景介绍1.1 图计算的重要性在当今大数据时代,图计算已经成为了一个非常重要的研究领域。图能够很好地表示现实世界中各种实体之间的复杂关系,如社交网络、交通网络、

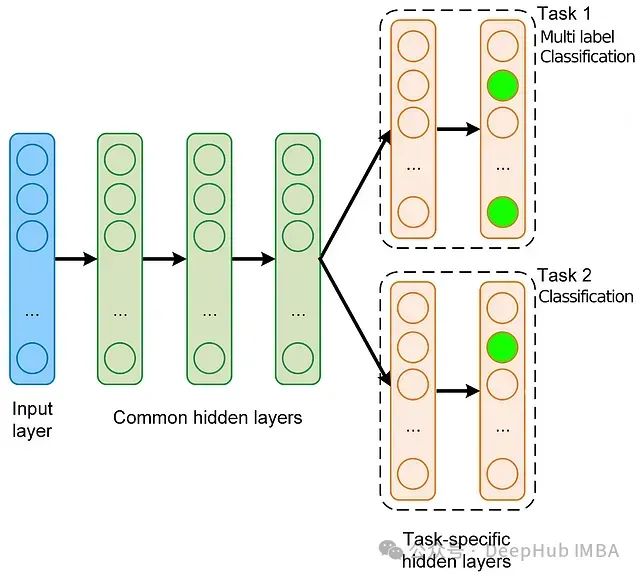

深度学习实战:手把手教你构建多任务、多标签模型

在本文中,我们将基于流行的 MovieLens 数据集,使用稀疏特征来创建一个多任务多标签模型,并逐步介绍整个过程。所以本文将涵盖数据准备、模型构建、训练循环、模型诊断,最后使用 Ray Serve 部署模型的全部流程。

Transformer--编码器和解码器(包含掩码张量,注意力机制,多头注意力机制)

编码器部分: 由N个编码器层堆叠而成,每个编码器层由两个子层连接结构组成,第一个子层连接结构包括一个多头自注意力子层和规范化层以及一个残差连接,第二个子层连接结构包括一个前馈全连接子层和规范化层以及一个残差连接💡在讲述编码器的结构之前,我们先引入三个概念--掩码张量,注意力机制,多头注意力机制。

Linux系统安装多个CUDA版本与切换,正常AI模型训练

如果已经安装了NVIDIA驱动版本,先卸载旧驱动,再安装新CUDA对应的驱动,如果没有安装过NVIDIA驱动版本,可以直接安装新CUDA版本,它会自动安装对应的NVIDIA驱动。(2)执行nvidia-smi命令,显示是cuda的版本号(每个cuda版本对应了不同驱动版本),提供有关系统中NVIDI

Storm Topology原理与代码实例讲解

Storm Topology: Principles and Code Examples1. Background IntroductionApache Storm is a free

AWQ量化及AutoAWQ代码详解

awq论文解读及autoawq源码分析

AI:12-基于深度学习的人脸识别研究

人脸识别技术作为一种先进的生物特征识别技术,在各个领域展示了广泛的应用前景。本文基于深度学习的人脸识别签到系统进行了深入研究,通过使用卷积神经网络(CNN)和面部特征提取技术,实现了准确的人脸识别和自动签到功能。同时,为了提高系统性能和效率,优化了模型架构、数据预处理和模型调优等方面。通过代码实现和

登顶GitHub Trending,开源工具MinerU助力复杂PDF高效解析提取

在7月4日举行的WAIC 2024科学前沿主论坛上,书生·浦语2.5正式发布,面向大模型研发与应用的全链条工具体系同时迎来升级。在数据处理环节,上海人工智能实验室(上海AI实验室)大模型数据基座OpenDataLab团队开源了全新的智能数据提取工具——MinerU。

从零实现强化学习RLHF代码(PPO、RLOO)

从零开始实现强化学习代码