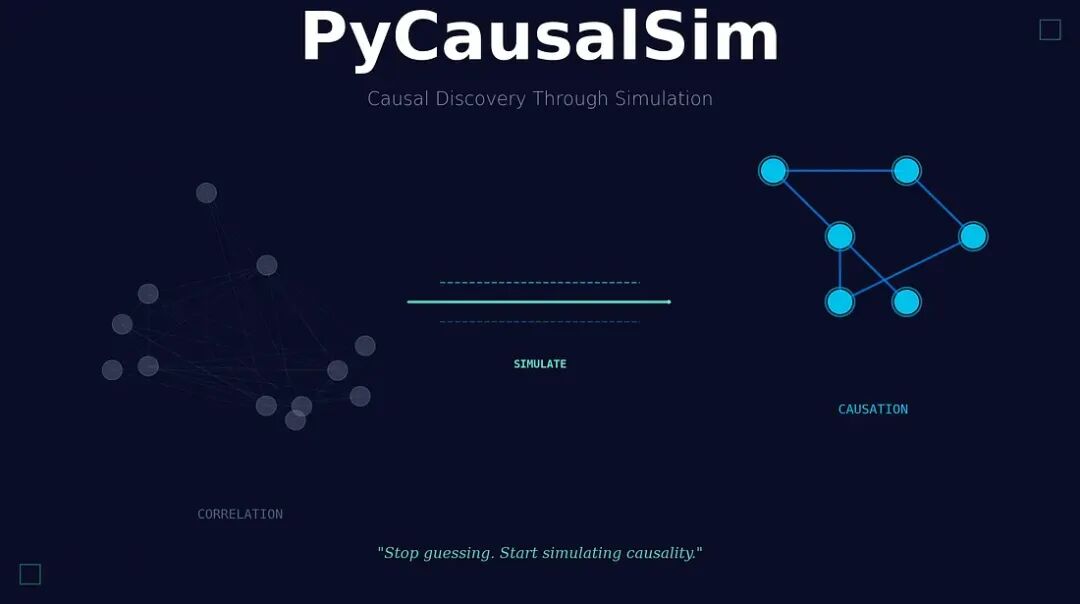

PyCausalSim:基于模拟的因果发现的Python框架

今天介绍一下 **PyCausalSim**,这是一个利用模拟方法来挖掘和验证数据中因果关系的 Python 框架。

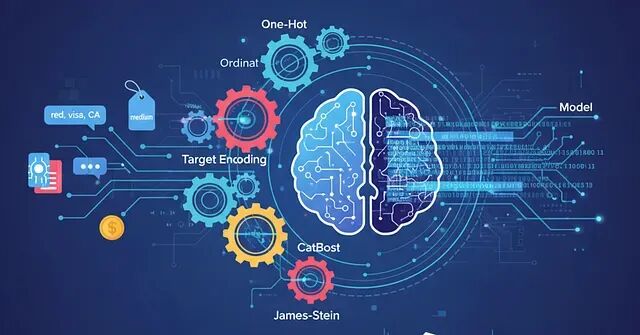

别只会One-Hot了!20种分类编码技巧让你的特征工程更专业

编码方法其实非常多。目标编码、CatBoost编码、James-Stein编码这些高级技术,用对了能给模型带来质的飞跃,尤其面对高基数特征的时候。

从 Pandas 转向 Polars:新手常见的10 个问题与优化建议

Polars 速度快、语法现代、表达力强,但很多人刚上手就把它当 Pandas 用,结果性能优势全都浪费了。

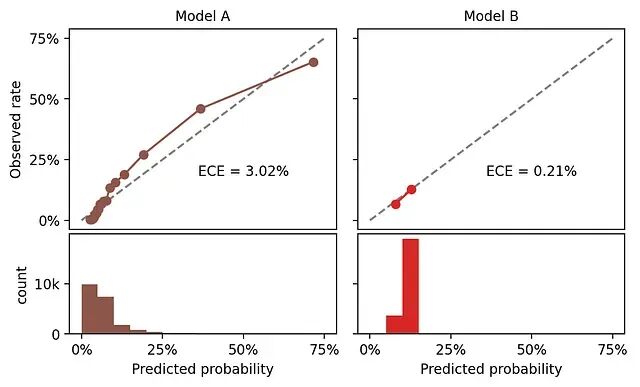

分类模型校准:ROC-AUC不够?用ECE/pMAD评估概率质量

这里校准的定义是:如果模型给一批样本都预测了25%的正例概率,那这批样本中实际的正例比例应该接近25%。这就是校准。

Pandas GroupBy 的 10 个实用技巧

本文将介绍10个实际工作中比较有用的技巧,文章的代码都是可以直接拿来用。

Python 3.14 实用技巧:10个让代码更清晰的小改进

Python 3.14 引入的改进大多数都很细微,但这些小变化会让代码写起来更流畅,运行也更稳定。本文整理了 10 个实用的特性改进,每个都配了代码示例。

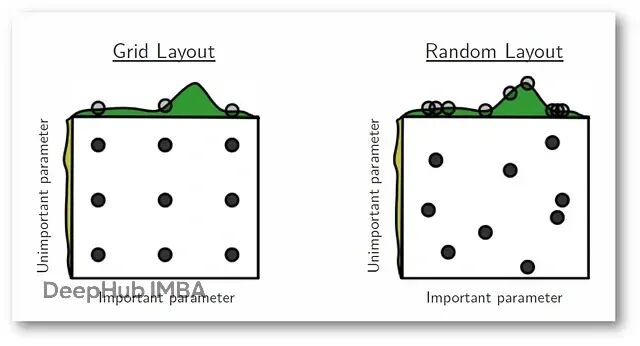

超参数调优:Grid Search 和 Random Search 的实战对比

这篇文章会把Grid Search和Random Search这两种最常用的超参数优化方法进行详细的解释。从理论到数学推导,从优缺点到实际场景,再用真实数据集跑一遍看效果。

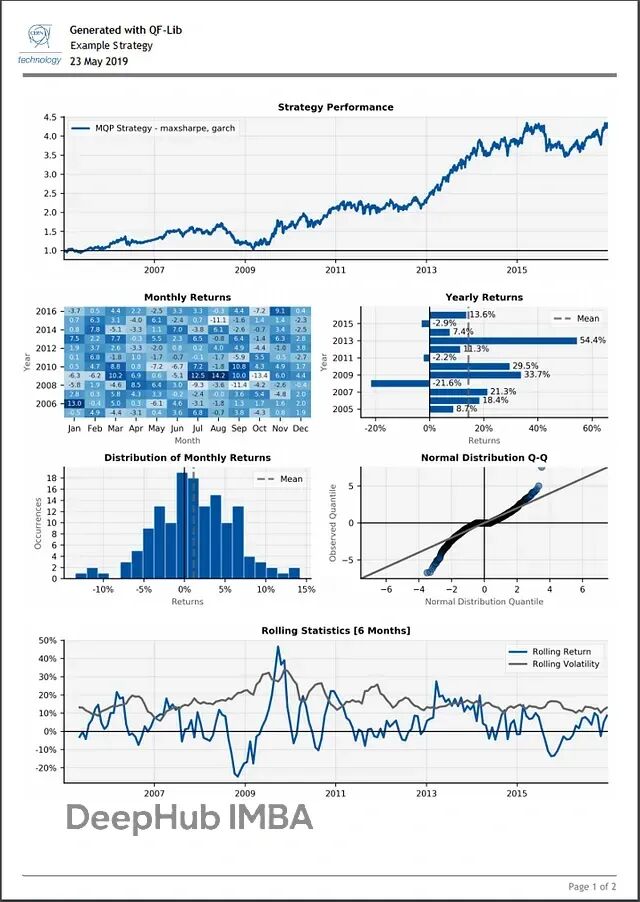

QF-Lib:用一个库搞定Python量化回测和策略开发

QF-Lib(Quantitative Finance Library)是个金融研究和回测工具包。从数据获取到策略模拟、风险评估,再到最后的报告生成,基本能在这一个工具里搞定。

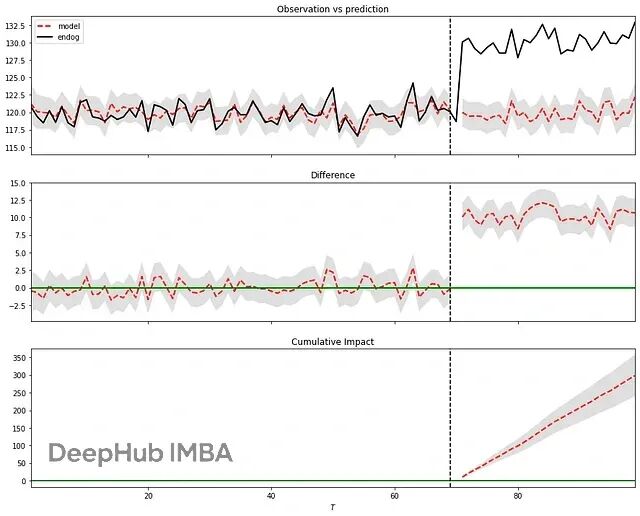

Python因果分析选哪个?六个贝叶斯推断库实测对比(含代码示例)

这篇文章将对比了六个目前社区中最常用的因果推断库:**Bnlearn、Pgmpy、CausalNex、DoWhy、PyAgrum 和 CausalImpact**。

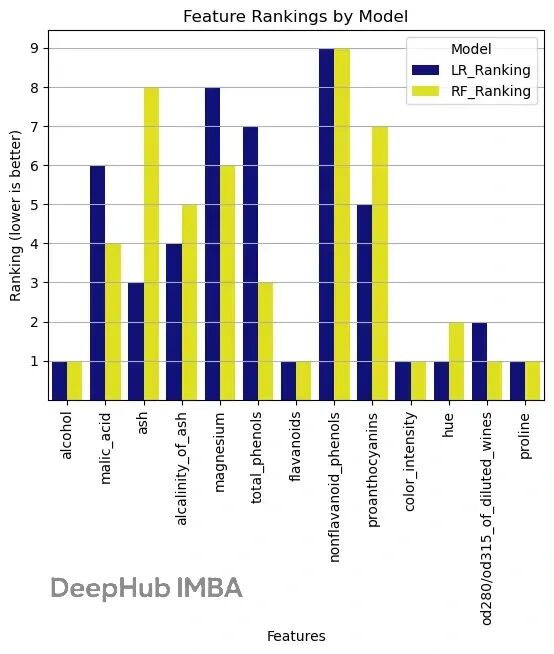

sklearn 特征选择实战:用 RFE 找到最优特征组合

本文会详细介绍RFE 的工作原理,然后用 scikit-learn 跑一个完整的例子。

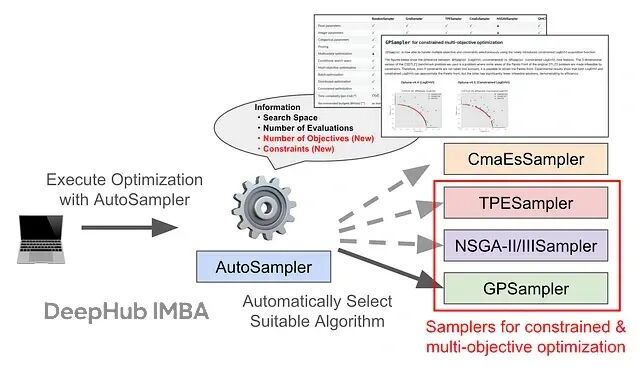

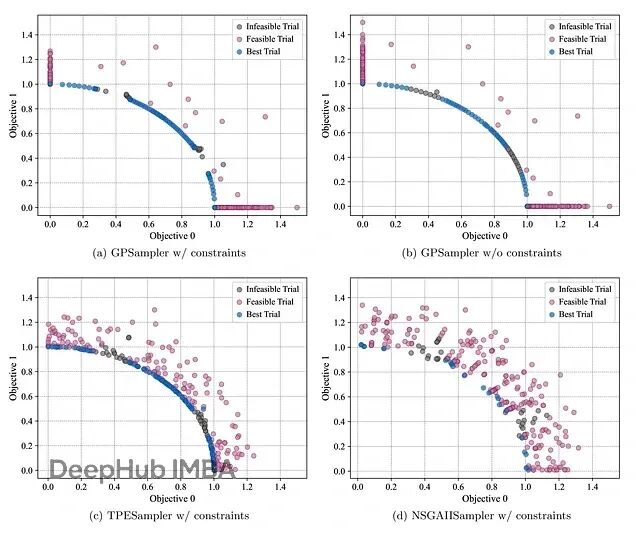

Optuna AutoSampler 更新:让多目标和约束优化不再需要手动选算法

这篇文章会讲清楚新功能怎么用,顺带看看基准测试的表现如何。最新版本其实现在就能用了。

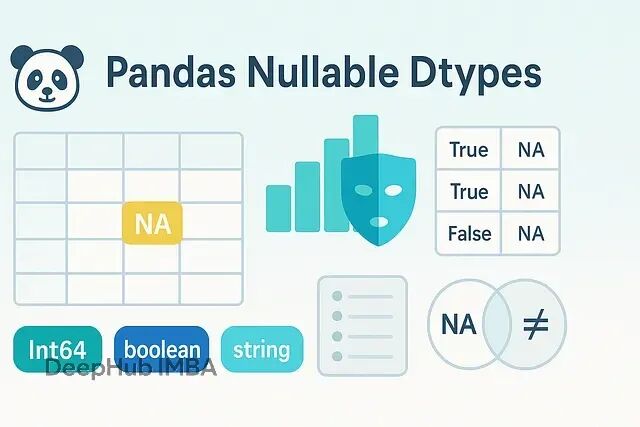

Pandas 缺失值最佳实践:用 pd.NA 解决缺失值的老大难问题

Pandas1.0引入的可空类型不只是修边角的细节优化,它把"缺失"这个语义明确编码进了类型系统。整数保持整数,布尔值该表示"未知"就表示"未知",字符串就是字符串。过滤和 join 的逻辑变得更清楚,也更不容易出错。

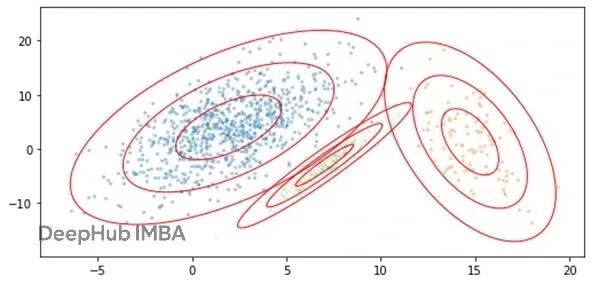

如何生成逼真的合成表格数据:独立采样与关联建模方法对比

本文将重点介绍如何让合成数据在分布特征和列间关系上都跟真实数据保持一致。我们会介绍两种基于多项式分布的实践方法,不预设具体应用场景,纯粹从技术角度拆解生成过程。

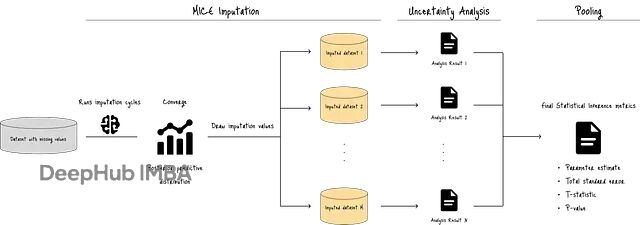

别再用均值填充了!MICE算法教你正确处理缺失数据

本文会通过PMM(Predictive Mean Matching)和线性回归等具体方法,拆解MICE的工作原理,同时对比标准回归插补作为参照。

12 种 Pandas 测试技巧,让数据处理少踩坑

下面这 12 个策略是实际项目里反复使用的测试方法,能让数据处理代码变得比较靠谱。

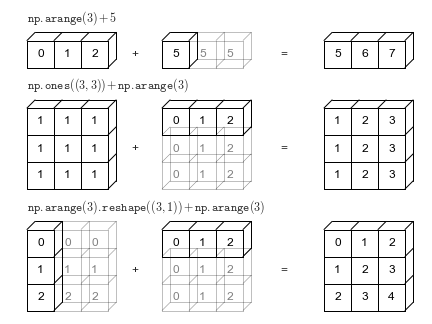

NumPy广播:12个技巧替代循环,让数组计算快40倍

广播是NumPy里最让人恍然大悟的特性。掌握后能去掉大量循环,让代码意图更清晰,同时获得向量化带来的性能提升——而且不需要引入什么复杂工具。

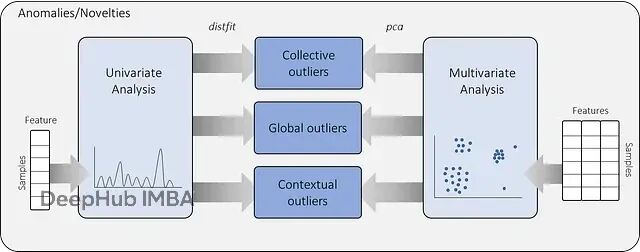

Python离群值检测实战:使用distfit库实现基于分布拟合的异常检测

本文会先讲清楚异常检测的核心概念,分析anomaly和novelty的区别,然后通过实际案例演示如何用概率密度拟合方法构建单变量数据集的无监督异常检测模型。所有代码基于distfit库实现。

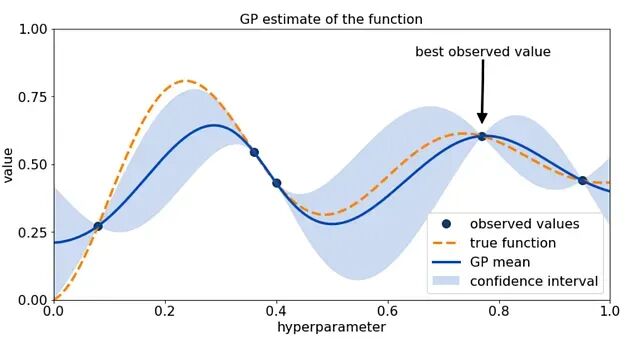

Optuna v4.5新特性深度解析:GPSampler实现约束多目标优化

Optuna在8月18日发布了最近的 v4.5版,加入了GPSampler的约束多目标优化功能,我们来看看这个新的功能。

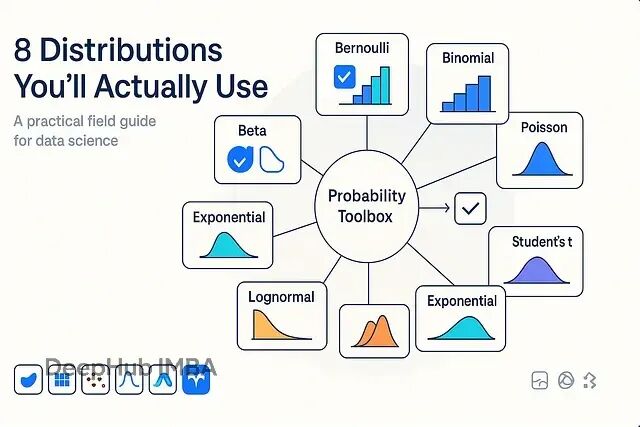

为你的数据选择合适的分布:8个实用的概率分布应用场景和选择指南

本文包含了实际会用到的概率分布速查手册,包含使用场景、代码实现和常见陷阱