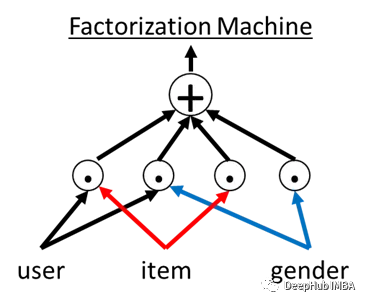

因子分解机介绍和PyTorch代码实现

因子分解机(Factorization Machines,简称FM)是一种用于解决推荐系统、回归和分类等机器学习任务的模型

mmdetection3d-之(一)--FCOS3d训练nuscenes-mini数据集

fcos3d训练nuscenes-mini 数据集

卸载cpu版本的torch并离线安装对应的gpu版本

每次从github上安装项目对应的库,利用requirements.txt安装很容易出现版本不对应的情况,尤其是将torch的gpu版本安装成cpu。这里记录一些查看版本的指令和离线安装的方法,就不用每次百度啦!(注:其他库的离线安装也可以用同样的方法,只需要去相应的网站下载wheel即可)第一个框

Pytorch 多GPU训练

Pytorch 多GPU训练

cuda 版本更新

cuda安装

YOLOv7改进:在不同位置添加biformer

为了缓解多头自注意力()的可扩展性问题,先前的一些方法提出了不同的稀疏注意力机制,其中每个查询只关注少量的键值对,而非全部。为此,作者探索了一种动态的、查询感知的稀疏注意力机制,其关键思想是在粗糙区域级别过滤掉大部分不相关的键值对,以便只保留一小部分路由区域(这不就把冗余的信息干掉了吗老铁们)。其次

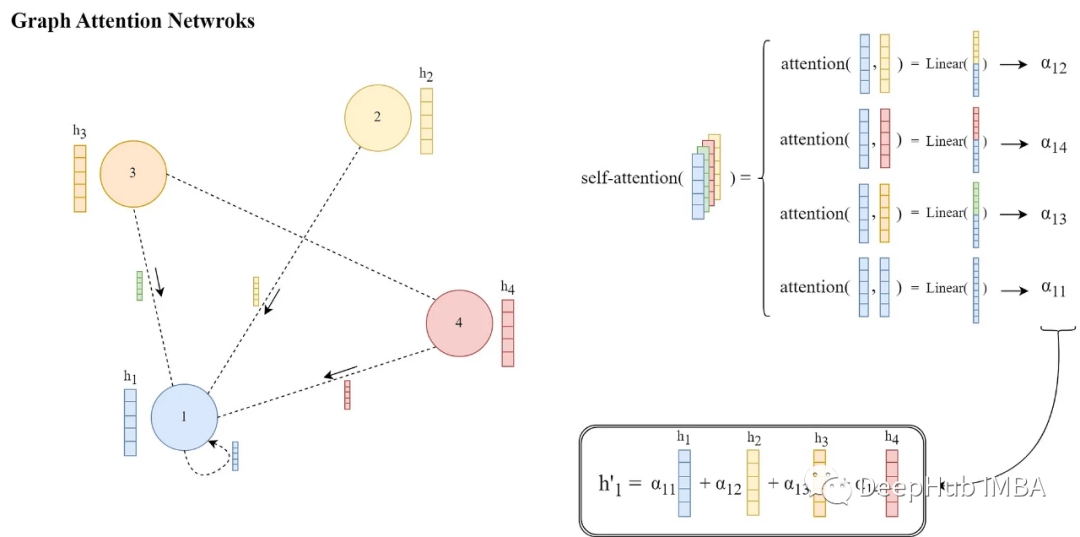

图注意力网络论文详解和PyTorch实现

图注意力网络(GAT)[1]是一类特殊的gnn,主要的改进是消息传递的方式。他们引入了一种可学习的注意力机制,通过在每个源节点和目标节点之间分配权重,

pytorch交换tensor的指定维度

pytorch中有两种方式可以实现tensor指定维度的交换,第一个是torch.permute(),第二个方法是torch.transpose()。二者不同是torch.permute()可以同时交换多个维度,而torch.transpose()每次只能交换两个维度。

Litmaps最新论文检索神器

最近有小伙伴私信我如何找到自己研究领域的相关论文,因为论文太多了,不知道如何找到优质的或者适合自己阅读的,然后我给大家推荐个论文检索工具 Citation Gecko ,但是这个网站好像不再维护了,但是不影响使用。

PyTorch训练“WARNING:root:NaN or Inf found in input tensor”问题

PyTorch训练报“WARNING:root:NaN or Inf found in input tensor”警告,可能是tensorboardX使用中数据格式不符合规范。

Pytorch中RandomResizedCrop()的参数及用法

Pytorch中的RandomResizedCrop()

【pytorch】torch.clip() & torch.clamp() 数值裁剪

这两个函数用法一样,效果也一样。

PyTorch基本操作练习

实现了一些PyTorch基本操作,减法等。原理可参考《神经网络与深度学习》《动手学深度学习》中的内容。

PyTorch:通过pth文件查看网络结构(查看输入输出维度)

显示pth文件的模型参数

动手学深度学习(李沐)的pytorch版本(包含代码和PDF版本)

动手学深度学习(李沐)的pytorch版本(包含代码和PDF版本),《动手学深度学习》PyTorch版本TendorFlow版本(内有所有代码和PDF版下载地址)

解决OSError: [WinError 127] 找不到指定的程序

使用PyG和PyTorch训练网络时出现 `解决OSError: [WinError 127] 找不到指定的程序` 问题

【pytorch问题解决】OSError: [WinError 1455] 页面文件太小,无法完成操作。

pytorch,OSError,页面文件太小,问题解决

Windows环境下GPU版本pytorch安装

Windows环境下GPU版本pytorch安装

Pytorch 多卡并行训练教程 (DDP)

Pytorch 多卡并行训练教程 (DDP),关于使用DDP进行多开并行训练 网上有许多教程,而且很多对原理解析的也比较透彻,但是有时候看起来还是比较懵逼,再啃了许多相关的博客后,博主记录了一些自己对于使用torch.nn.DistributedDataParallel(DDP)进行单机多卡并行训练

mmsegmentation 训练自制数据集全过程

mmsegmentation训练自己的数据集,环境配置,数据集制作,训练,预测全过程