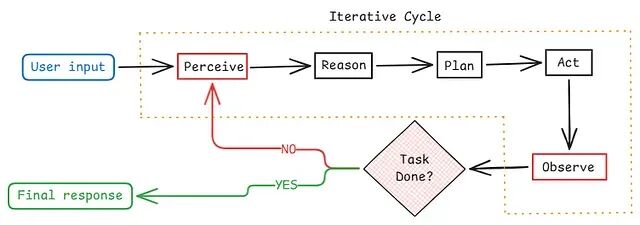

推理 → 行动 → 观察:用 LangChain + Python 实现一个智能体循环

下面这篇介绍会说明它是什么、如何工作,以及如何把它实现出来。

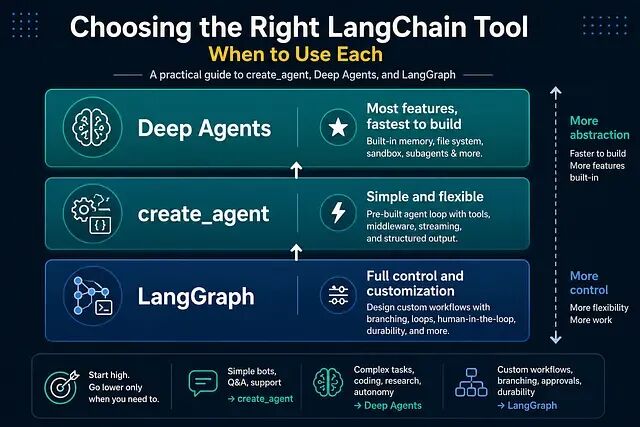

LangChain 生态里的三层抽象:LangGraph、create_agent、Deep Agents

把它们看作不同抽象层级的工具更容易理解。LangGraph 在最底层,所有控制都掌握在开发者手里;

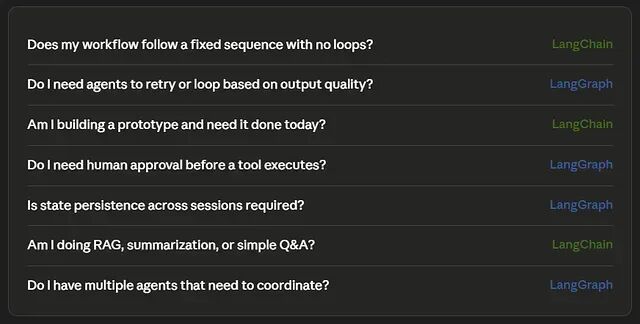

LangChain 还是 LangGraph?一个是编排一个是工具包

现在介绍LangGraph 和 LangChain 的文章。每一篇的结论都差不多:简单流程用 LangChain,复杂的用 LangGraph。

LangChain v1.0 中间件详解:彻底搞定 AI Agent 上下文控制

LangChain v1.0 引入中间件机制,系统化解决上下文管理难题。通过模块化中间件,实现输入预处理、敏感信息过滤、工具权限控制等,提升Agent在生产环境的稳定性与可维护性。

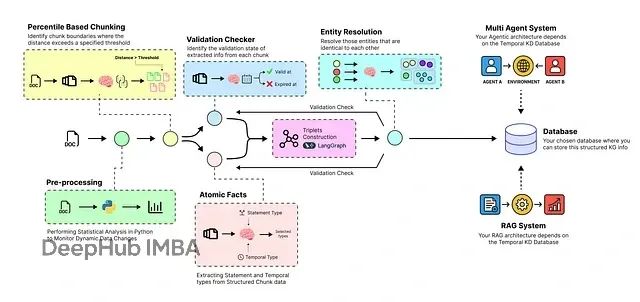

构建时序感知的智能RAG系统:让AI自动处理动态数据并实时更新知识库

本文将构建一个端到端的时序智能体管道,实现从原始数据到动态知识库的转换,并在此基础上构建多智能体系统以验证其性能表现。

提升LangChain开发效率:10个被忽视的高效组件,让AI应用性能翻倍

本文将系统分析LangChain框架中十个具有重要价值但使用率相对较低的核心组件,通过技术原理解析和实践案例说明,帮助开发者构建更高效、更智能、更具适应性的AI应用系统。

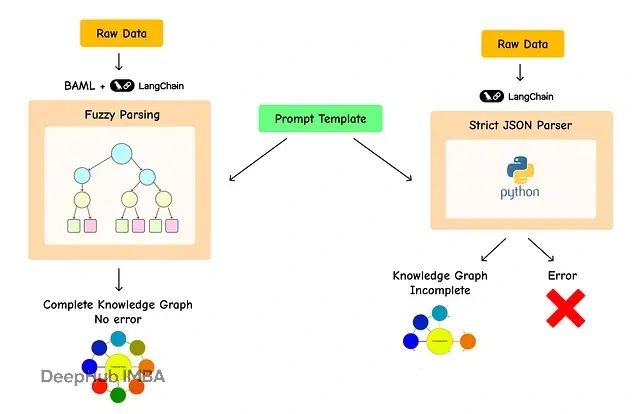

使用 BAML 模糊解析改进 LangChain 知识图谱提取:成功率从25%提升到99%

本文将深入分析小型量化模型在 LangChain 提取任务中的性能限制,并展示 BAML 技术如何将知识图谱提取成功率从约 **25% 显著提升至 99% 以上**。

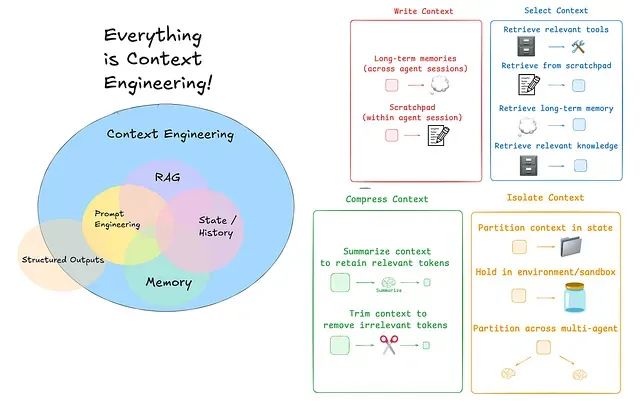

AI代理性能提升实战:LangChain+LangGraph内存管理与上下文优化完整指南

本文将深入探讨如何运用LangChain和LangGraph这两个构建AI代理、RAG应用和LLM应用的核心工具,系统性地实现上下文工程技术,以实现AI代理性能的全面优化。

LangChain-08 Query SQL DB 通过GPT自动查询SQL

LangChain的方式进行数据库查询,通过编写SQL对DB进行读取,并返回运行的结果,我们需要下载一个LangChain官方提供的本地小数据库,同时需要编写一段Chain来达到我们的目的。

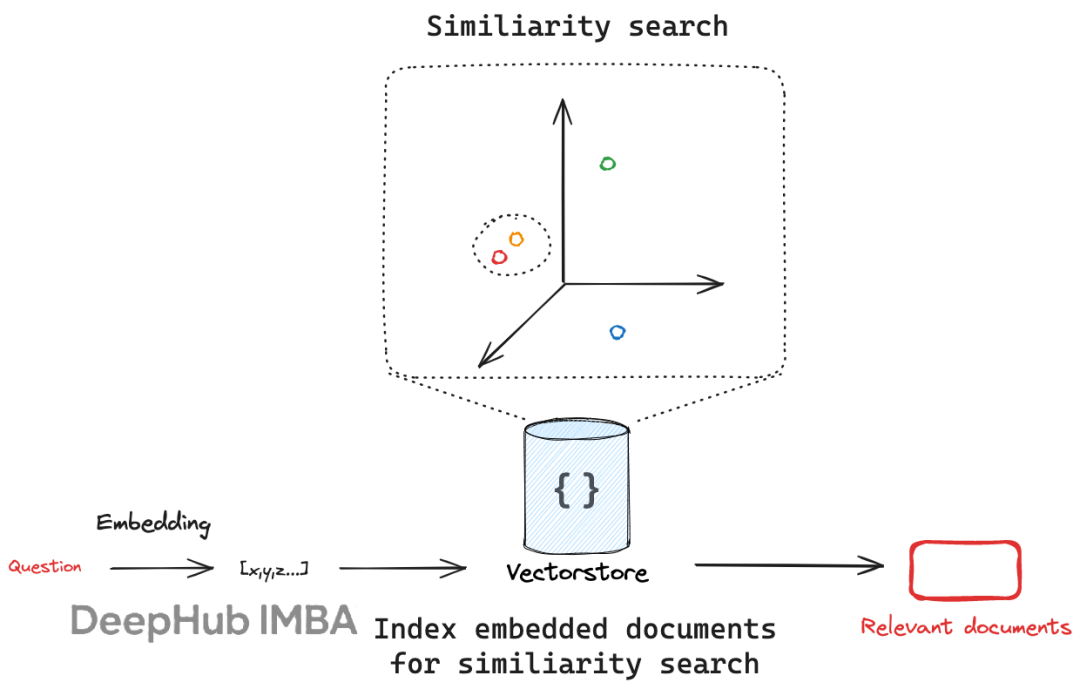

LangChain——Embedding 智谱AI

Embedding嵌入创建一段文本的矢量表示。这很有用,因为这意味着我们可以考虑向量空间中的文本,并执行语义搜索之类的操作,在其中查找向量空间中最相似的文本片段。LangChain 中的基类Embeddings提供了两种方法:一种用于嵌入文档,另一种用于嵌入查询。前者采用多个文本作为输入,而后者采用

如何使用Langchain集成Kimi AI(Moonshot AI)

AI浪潮势不可挡,还不来试试看吗?

docker部署本地词向量模型

会先去下载 docker 镜像,然后运行容器。特别要强调的是:model 的路径可不是随便写的。在我的这个例子中,启动 docker 时,映射的路径是。,因此 model 的路径必须以/data 开头,不然的话是找不到模型的。,大家可以参考我的路径来调整 model 和 volume 变量的值。

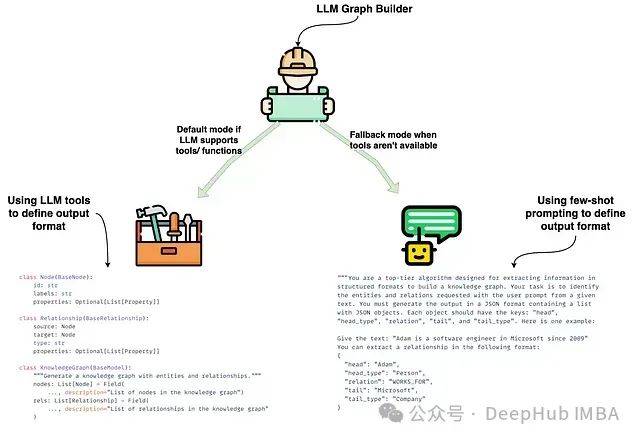

基于LLM Graph Transformer的知识图谱构建技术研究:LangChain框架下转换机制实践

本文是LangChain的一个代码贡献者编写的文章,将对这些内容进行详细介绍,文章最后还包含了作者提供的源代码

LangChain 实战:零基础打造你的专属 AI 智能体

随着人工智能技术的飞速发展,大语言模型(LLMs)如GPT系列已成为推动AI应用创新的重要力量。然而,面对复杂的实际应用场景,单一的 LLM 往往力不从心。LangChain 作为一个强大的开源框架应运而生,它为开发者提供了一套灵活的工具和接口,即使不具备深厚的技术背景,也能轻松构建出满足特定需求的

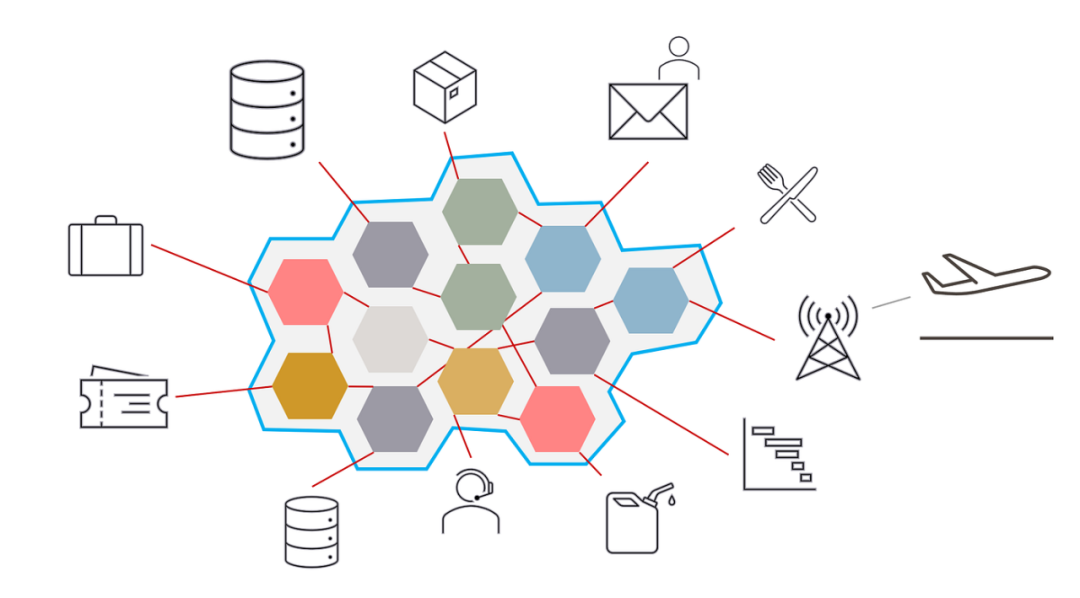

LangChain(八)构建多Agent的AI系统-实战!

好久没有更新LangChian系列的文章了,最近一直在给我们的项目进行集成工作。代码集成、系统优化、多线程操作等等……交给一个算法工程师真的好吗……不得已恶补了一下这方面的知识,写了很多有关于系统集成、代码规范、多线程编程方面的文章。时至今日终于告一段落……针对项目中实际编写的有关多链路由多Agen

借助AI与LangChain:一键从Excel生成智能化跨平台自动化测试代码!

通过这些扩展,工具不仅能支持Android和iOS平台,还能生成复杂的用户操作,并能够生成详细的测试报告和实现数据驱动测试。这让自动化测试工具更灵活、更强大,同时满足了更多实际测试场景的需求。

使用 Langchain-chatchat 搭建 RAG 应用,并使用postman进行测试验证

LangChain-Chatchat (原 Langchain-ChatGLM),一种利用 langchain 思想实现的基于本地知识库的问答应用,目标期望建立一套对中文场景与开源模型支持友好、可离线运行的知识库问答解决方案。

使用Langchain-chatchat搭建RAG应用,并使用postman进行测试验证

Github地址:https://github.com/chatchat-space/Langchain-Chatchat LangChain-Chatchat (原 Langchain-ChatGLM),一种利用 langchain 思想实现的基于本地知识库的问答应用,目标期望建立一

为什么AI大模型连简单的加法都算不对?

这个问题引发了一个常见的现象,即大模型(如讯飞星火、Kimi等)在涉及简单的加法运算时,结果经常不准确。

【AI大模型】初识LangChain:功能强大的语言模型框架

LangChain由 Harrison Chase 创建于2022年10月,它是围绕LLMs(大语言模型)建立的一个框架,LLMs使用机器学习算法和海量数据来分析和理解自然语言,GPT3.5、GPT4是LLMs最先进的代表,国内百度的文心一言、阿里的通义千问也属于LLMs。LangChain自身