关键字: [Amazon Web Services re:Invent 2023, Ray, Llms, Cost Efficiency, Anthropic Endpoints, Fine Tuning, Future Proof]

本文字数: 1000, 阅读完需: 5 分钟

视频

如视频不能正常播放,请前往bilibili观看本视频。>> https://www.bilibili.com/video/BV1KH4y1k7aj

导读

如果你能在自己的云端运行专门为你的业务定制和优化的大型语言模型会怎样呢?ChatGPT向世人展示了大型语言模型的强大,但也带来了关于成本、隐私和控制权的挑战。这次闪电式演讲利用基准测试和真实客户案例来展示开源大型语言模型如何迅速赶上专有替代品,以及Anyscale如何轻松地为你在自己的亚马逊云科技账户中提供个性化、可扩展、性价比高的大型语言模型服务。还将介绍亚马逊云科技和Anyscale为优化Amazon Inferentia和Amazon Trainium实例上的AI工作负载性能所做的工作。本次演示由亚马逊云科技合作伙伴Anyscale带来。

演讲精华

以下是小编为您整理的本次演讲的精华,共700字,阅读时间大约是4分钟。如果您想进一步了解演讲内容或者观看演讲全文,请观看演讲完整视频或者下面的演讲原文。

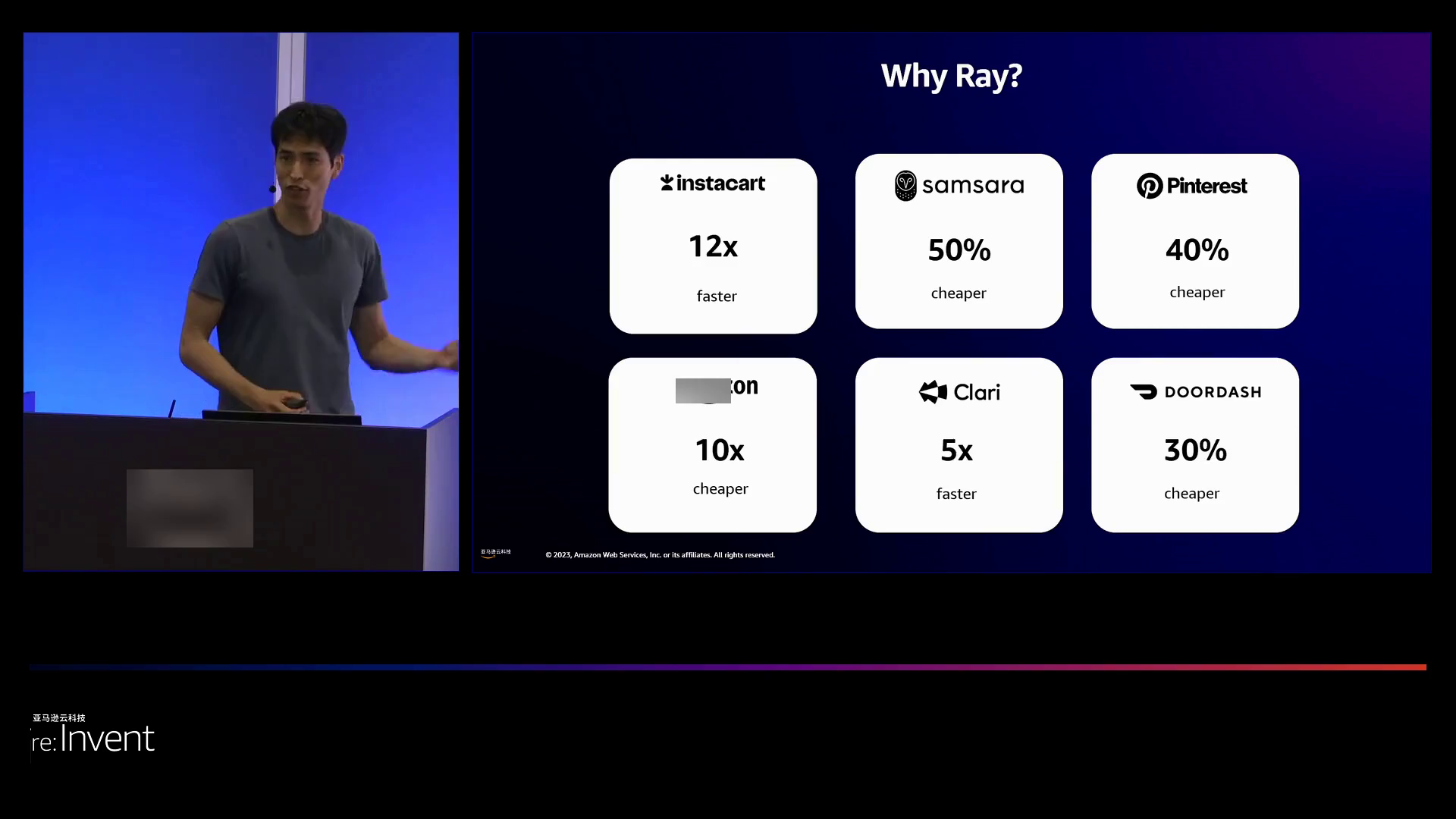

演讲者在开始演讲时,询问了多少人曾使用过类似OpenAI的语言模型API。许多人举手表示他们对这项技术非常熟悉。在深入讨论主题之前,演讲者为Ray这个项目提供了基本背景。Ray是一个被各行各业广泛采用的开源基础设施项目。他强调,Ray已经成为构建人工智能系统的标准基础,并推动了包括Uber、Spotify、Pinterest和TikTok在内的流行应用的发展。演讲者进一步解释道,Ray如此受欢迎的原因主要源于它带来的两个主要优势:速度和成本节省。他提供了一些具体的例子,展示了通过使用Ray来构建其AI基础设施的公司实现了显著的改进。例如,Samsara通过使用Ray来训练计算机视觉和自然语言处理模型,成功地将推理支出减少了50%。另一个例子是,Pinterest通过利用Ray执行成千上万的工作,将培训费用降低了40%。此外,Instacart现在由于采用了Ray,能够在100倍的数据上训练模型快12倍。

演讲者接着解释了最近Ray的采用速度的爆炸性增长。他指出,在过去6-12个月里,随着AI应用的规模巨大增长,需求已经迅速加速。大型语言模型和生成性AI的出现意味着计算需求呈指数增长。这为企业带来了巨大的基础设施挑战,许多公司没有能力应对这些挑战。特别是,他强调了寻求利用大型语言模型的组织所面临的三个核心障碍:规模、成本效益和创新速度。规模现在是不可避免的现实,因为现代模型不再适合单台机器,而且数据量继续增加。成本效益已成为一个关键问题,因为公司在运行模型时需要向云提供商支付大量费用。企业必须做好准备,灵活地整合最先进的AI进步,否则可能会落后于竞争对手。

演讲者注意到了这些精确的问题恰好是Ray和Anthropic的专长领域。他们采用了各种策略来解决规模问题,比如分布式计算、推断解码、持续批处理和自动调整。在提高成本效益方面,他们提到了一些优化方法,如S3模型加载、多租户资源池和智能作业调度。演讲者认为Ray具有前瞻性,可以立即应用新的算法、模型和硬件。

谈到Anthropic的产品线,演讲者介绍了Anthropic Endpoints,这是一个用于大型语言模型的API服务。他将此服务与OpenAI API进行了对比,并解释了用户如何轻松地从OpenAI切换到Anthropic的开源模型,如Llama和Mistral。Anthropic关注成本和性能的优势贯穿整个软件栈。例如,他们270亿参数的Llama模型在推理阶段具有卓越的成本效益。

作为一个降低成本的案例研究,演讲者展示了一个关于Anthropic对SQL查询生成研究的项目。起初,他们7亿参数的Llama模型的准确性只有3%,而GPT-4的准确性为78%。然而,经过针对SQL任务的微调之后,Llama的准确性超过了GPT-4,达到了86%,同时成本仅为后者的1/300。这说明了对特定任务的专门微调可以在某些情况下实现更大模型的性能。

对于需要更多控制、隐私或定制的场景,演讲者介绍了Anthropic Private Endpoints。这允许用户在自管理的基础设施上部署整个LLM后端。他认为这对于除了典型的API服务之外还有其他特殊需求的企业来说是非常理想的。

总的来说,演讲者总结道,Ray和Anthropic提供了一套优化的未来可靠的AI基础设施,以满足规模、成本和创新方面日益增长的需求。他们的产品,如Anthropic Endpoints和Private Endpoints,使企业能够高效地利用大型语言模型并保持竞争力。

下面是一些演讲现场的精彩瞬间:

雷(Ray)是一个开源项目,旨在构建人工智能基础设施,为众多流行应用提供支持,包括Uber、ChatGBT、Spotify、Pinterest和TikTok等。

通过雷,诸如Samsara、Pinterest和Instacart等企业能够大幅降低成本并加速机器学习模型的训练过程。

在过去的一年里,亚马逊云科技的AI功能迅速扩张,帮助企业应对各种新兴挑战。

然而,由于其规模和多样化的数据需求,长文本生成模型(LLM)在扩展方面面临挑战。

亚马逊云科技为客户提供了一种灵活的选择方案,可以部署定制模型和逻辑,同时确保数据隐私和控制。

Anthropic平台使客户能够立即利用最新的AI技术、模型、优化和硬件。

总结

演讲者详细阐述了Ray这一开源分布式计算框架已逐渐成为构建可扩展且低成本的人工智能基础设施的行业标准的过程。诸如Uber、Pinterest和Instacart等企业都在使用Ray来降低其成本并加速训练过程。然而,随着人工智能领域特别是大型语言模型(LLM)的快速发展,也带来了一些新的挑战,例如规模、成本和创新速度等问题。

为了应对这些挑战,Anthropic公司推出了两款基于Ray的产品。首先,Anthropic Endpoints提供了一种高性能且成本优化的API,用于对开源LLM进行推理和微调。通过调整较小的模型,如Llama,可以在成本仅为GPT-4的一小部分的情况下实现相同的准确性。其次,Anthropic Private Endpoints允许在企业自己的环境中运行定制化的LLM基础设施,从而获得更多控制和隐私保障。该平台具有前瞻性,能够充分利用新模型、优化和新硬件的优势。这些产品共同使得企业在控制成本和保持适应性的同时,能够高效地运用LLM的强大功能。

演讲原文

https://blog.csdn.net/just2gooo/article/details/134860953

想了解更多精彩完整内容吗?立即访问re:Invent 官网中文网站!

2023亚马逊云科技re:Invent全球大会 - 官方网站

点击此处,一键获取亚马逊云科技全球最新产品/服务资讯!

点击此处,一键获取亚马逊云科技中国区最新产品/服务资讯!

即刻注册亚马逊云科技账户,开启云端之旅!

【免费】亚马逊云科技“100 余种核心云服务产品免费试用”

【免费】亚马逊云科技中国区“40 余种核心云服务产品免费试用”

亚马逊云科技是谁?

亚马逊云科技(Amazon Web Services)是全球云计算的开创者和引领者,自 2006 年以来一直以不断创新、技术领先、服务丰富、应用广泛而享誉业界。亚马逊云科技可以支持几乎云上任意工作负载。亚马逊云科技目前提供超过 200 项全功能的服务,涵盖计算、存储、网络、数据库、数据分析、机器人、机器学习与人工智能、物联网、移动、安全、混合云、虚拟现实与增强现实、媒体,以及应用开发、部署与管理等方面;基础设施遍及 31 个地理区域的 99 个可用区,并计划新建 4 个区域和 12 个可用区。全球数百万客户,从初创公司、中小企业,到大型企业和政府机构都信赖亚马逊云科技,通过亚马逊云科技的服务强化其基础设施,提高敏捷性,降低成本,加快创新,提升竞争力,实现业务成长和成功。

版权归原作者 李白的朋友高适 所有, 如有侵权,请联系我们删除。