AnythingLLM 是一个全栈应用程序,您可以使用商业现成的 LLM 或流行的开源 LLM 和 vectorDB 解决方案来构建私有 ChatGPT,无需任何妥协,您可以在本地运行,也可以远程托管并能够智能聊天以及您提供的任何文件。

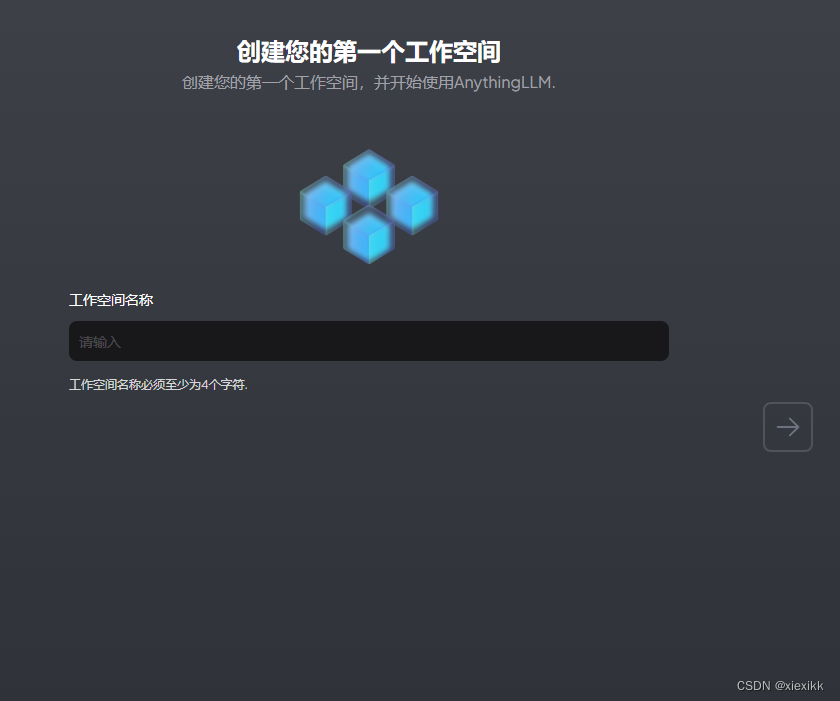

AnythingLLM 将您的文档划分为名为workspaces.工作区的功能很像线程,但增加了文档的容器化。工作区可以共享文档,但它们不会相互通信,因此您可以保持每个工作区的上下文干净。

anything-llm:https://github.com/Mintplex-Labs/anything-llm

ollama: https://github.com/ollama/ollama

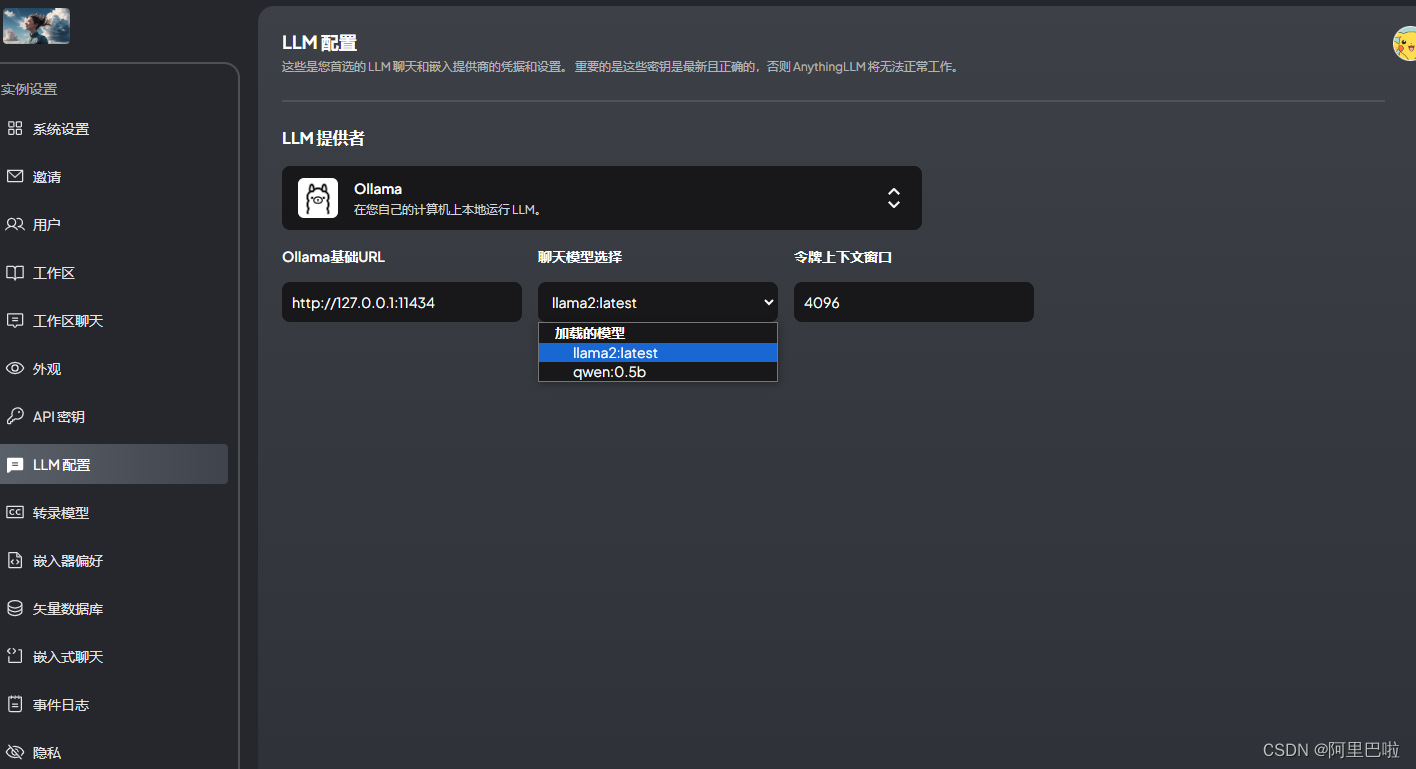

在本地启动并运行大型语言模型, 根据自己的需求去安装启动大模型。

后面手动汉化迭代了一个版本,后续会发布github,需要请先关注收藏一下哈!

这个 monorepo 包含三个主要部分:

frontend:一个 viteJS + React 前端,您可以运行它来轻松创建和LLM可以使用的所有内容。

server:一个 NodeJS Express 服务器,用于处理所有交互并执行所有向量数据库管理和 LLM 交互。

docker:Docker 说明和构建过程+从源代码构建的信息。

collector:NodeJS Express 服务器,用于处理和解析来自 UI 的文档。

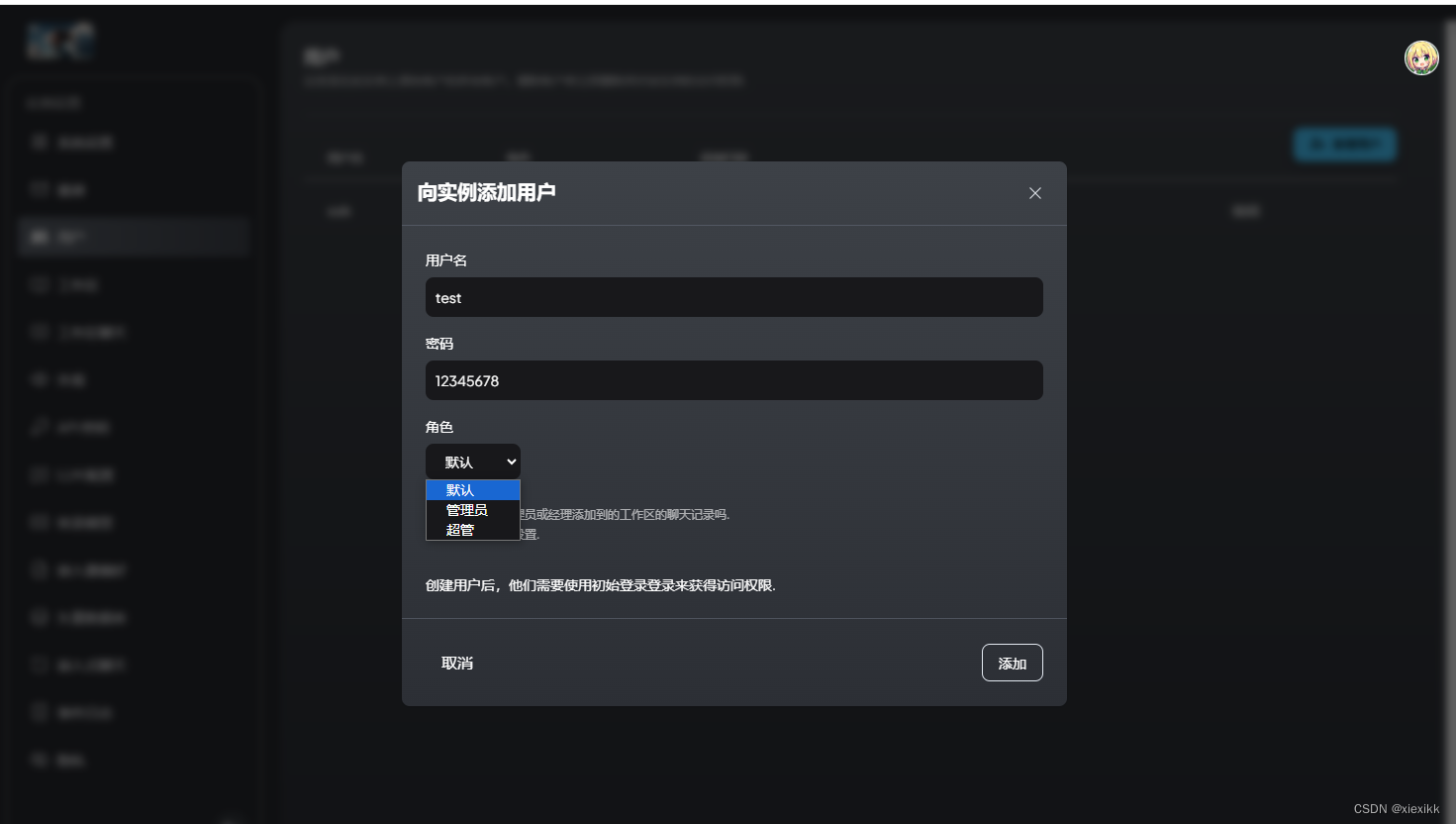

先来几张截图:

本地环境运行,window和mac是有所不同的,踩坑系列后面补上来。

版权归原作者 阿里巴啦 所有, 如有侵权,请联系我们删除。