首先我们来探究下为什么要设计大模型+工作流

一、大模型+工作流的优势主要有四点:

1. 降低任务门槛:工作流可以将复杂任务分解成多个小任务,降低每个任务的复杂度,从而减少对提示词和大模型推理能力的依赖。这样可以提升大模型处理复杂任务的性能和容错能力。

2. 提升任务效率:工作流可以实现自动化处理,减少重复劳动和纠正。只需提供必要元素,工作流就可以直接输出结果,提高效率和稳定性。

3. 提高任务的一致性:工作流可以确保任务的执行是一致的,减少人为错误和偏差,提高任务的可靠性和质量。

4. 实现任务的可重复性:工作流可以实现任务的可重复性,减少重复劳动和开发时间,提高开发效率和生产力。

好了接下来我们开始正式实践。

二、安装docker desktop + wsl2

dockerdesktop下载地址:Docker Desktop: The #1 Containerization Tool for Developers | Docker

安装步骤就省略咯,可以百度。

推荐博客:0基础基于最新WSL2的Window Docker安装及搭建内网穿透保姆级教程_wsl 镜像网络-CSDN博客

三、安装ollama

1、安装ollama

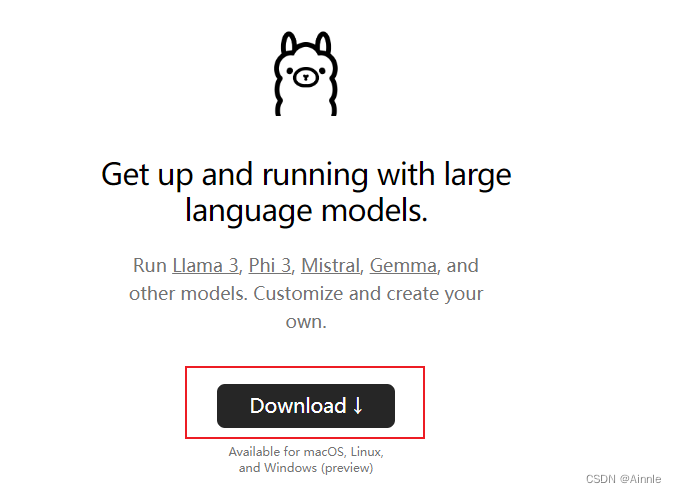

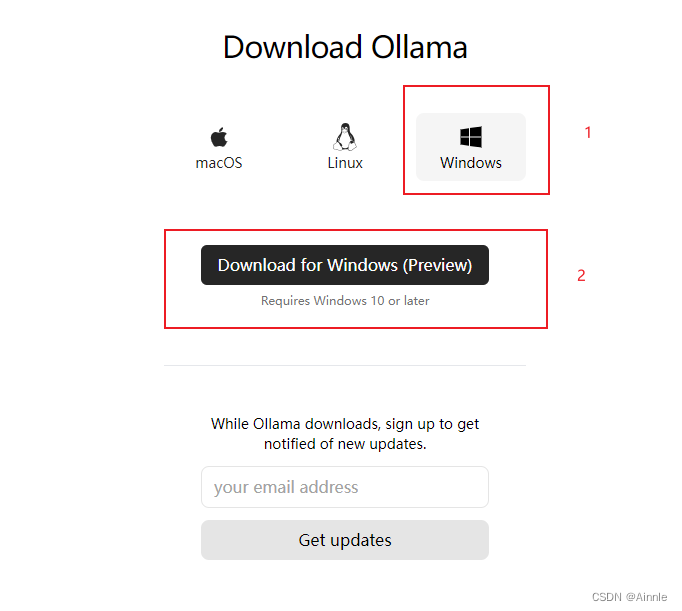

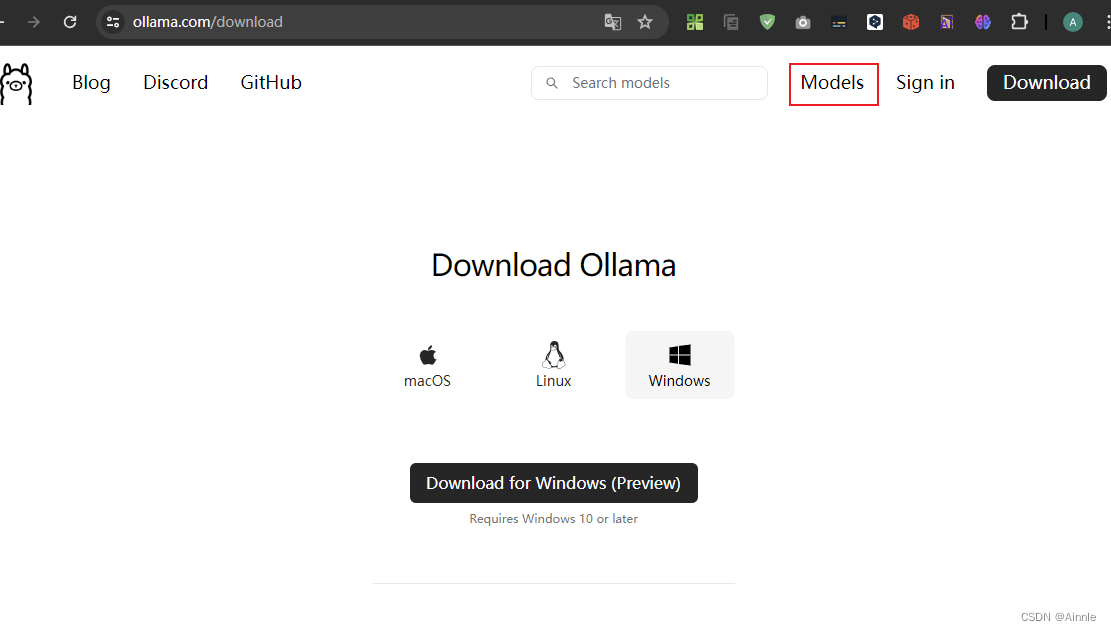

下载ollama官方windows安装程序,下载后直接双击应用程序安装。

地址:Ollama

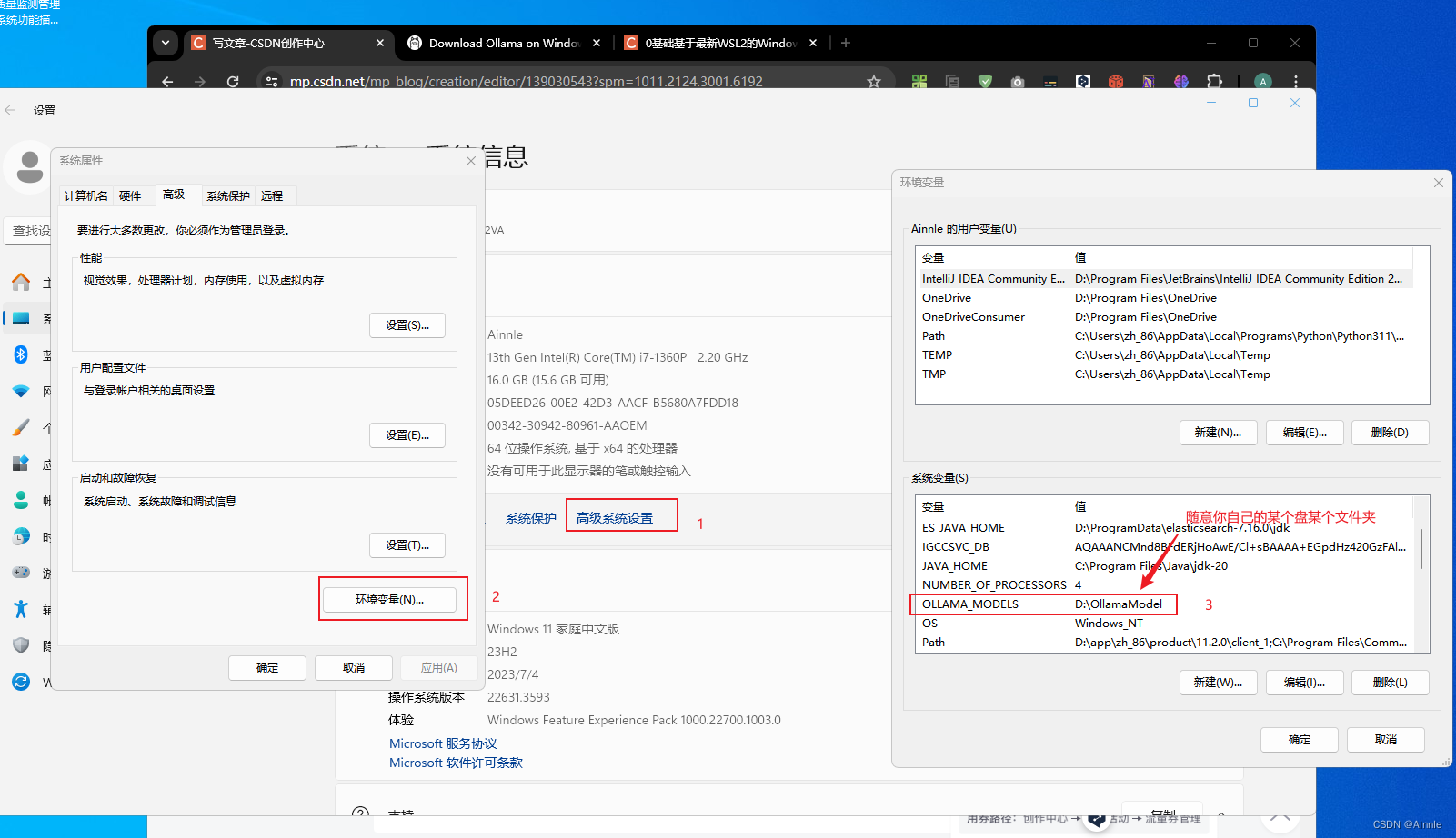

安装完成后进行更换ollama的存储位置

(设置环境变量--不明白就百度一下windows设置环境变量,这里就不过多讲解。):

设置完成后重启电脑。

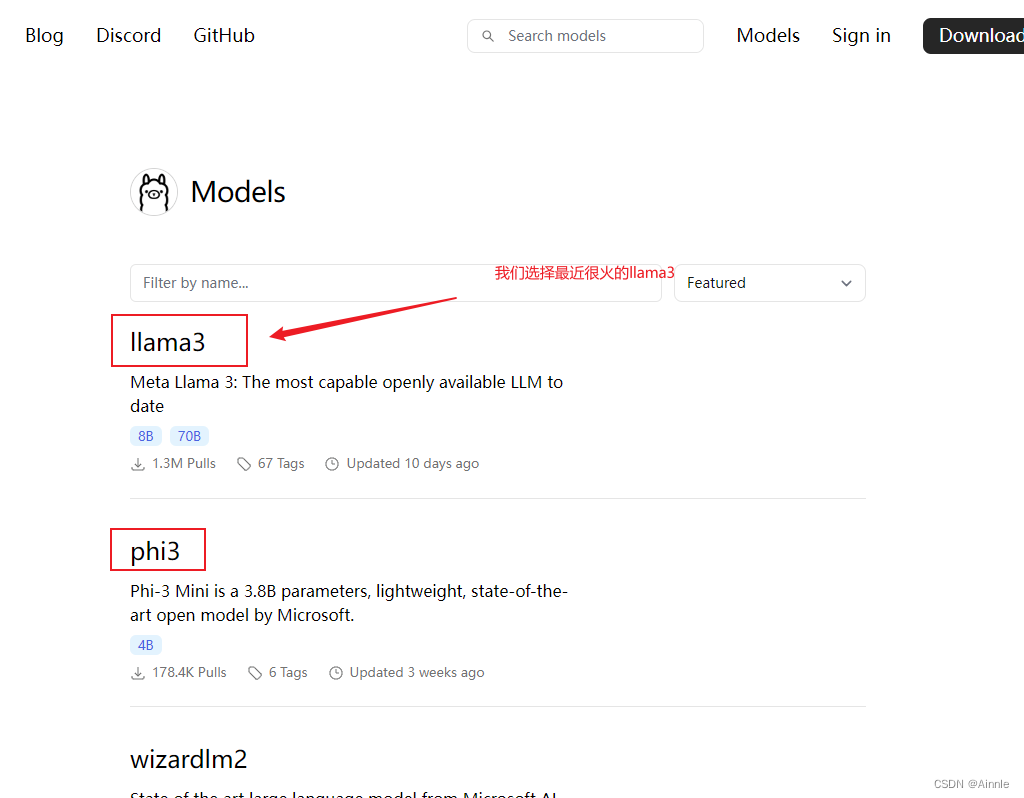

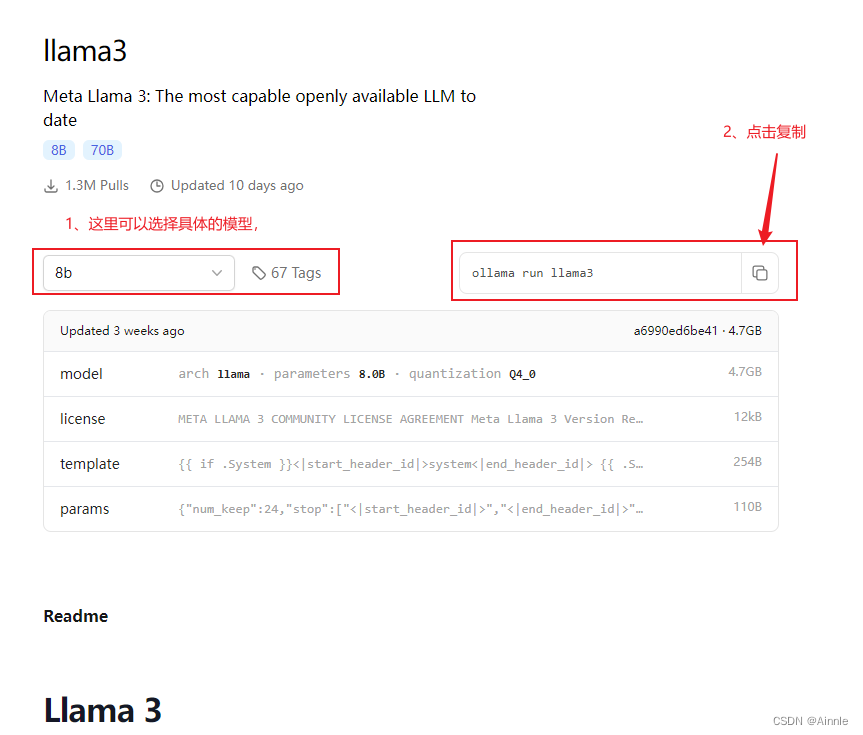

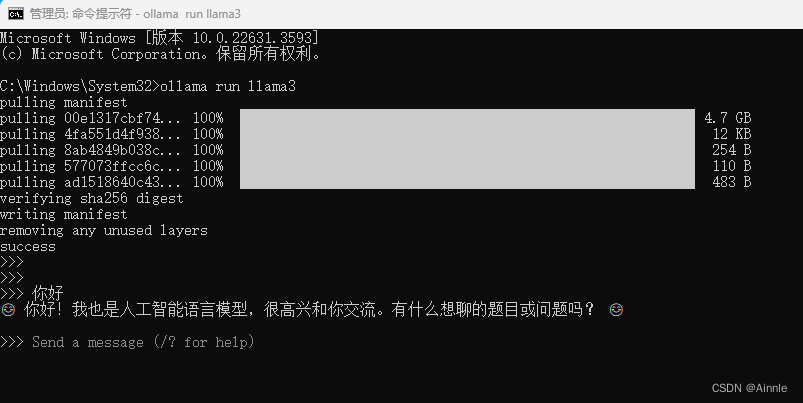

2、下载模型

ollama官网顶部Models,进入模型列表界面。

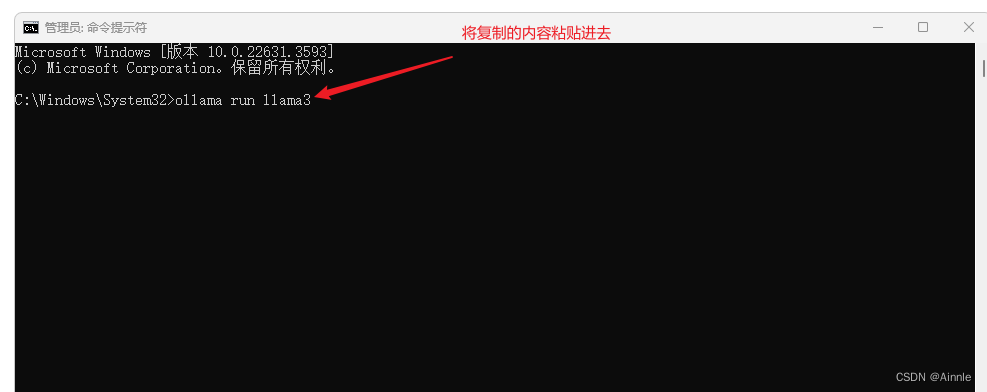

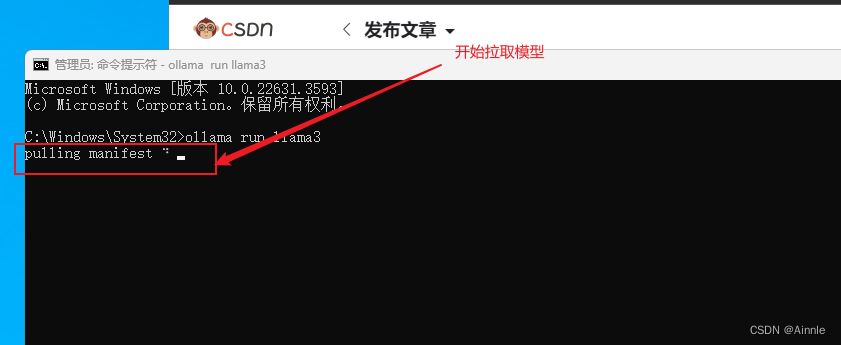

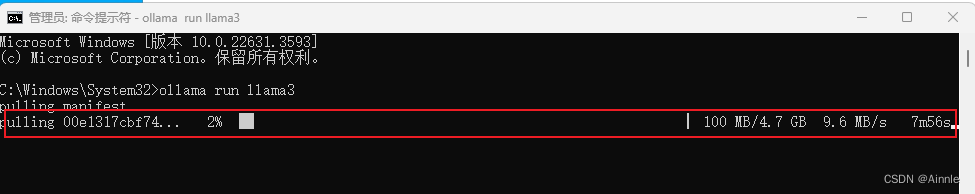

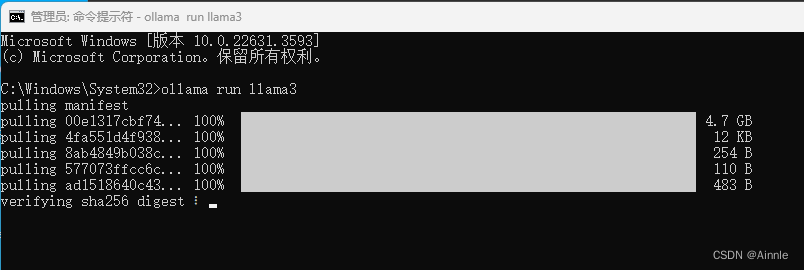

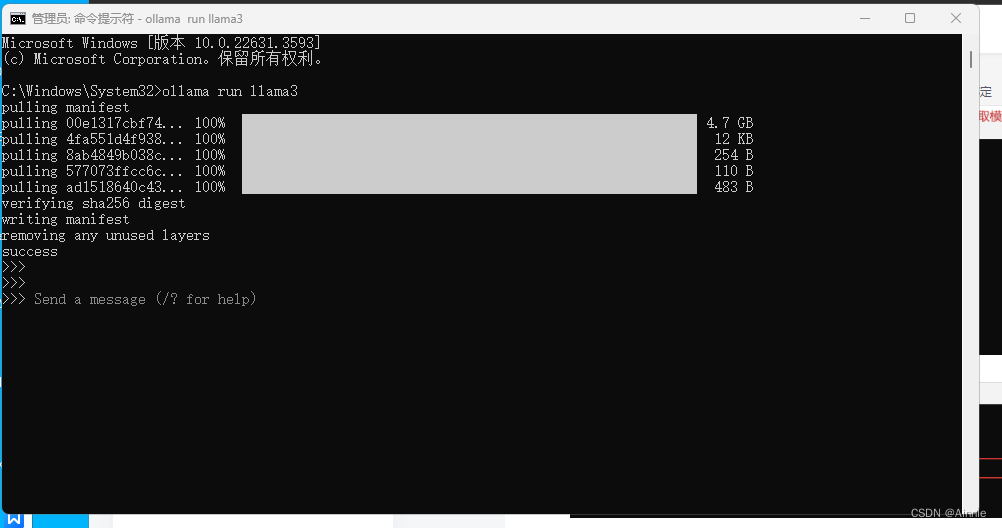

复制完成后进入cmd,并开始下载模型,将复制的模型 粘贴并回车。

上图为拉取进度,完成后会自动进行编译,然后本地cmd方式即可进行对话。

经过以上步骤本地大模型llama3以安装完成,接下来我们通过dockerdesktop进行搭建fastgpt。

四、安装部署Fastgpt

1、部署fastgpt到dockerdesktop

Fastgpt开源项目地址:https://github.com/labring/FastGPT

Fastgpt官方docker模式部署地址:Docker Compose 快速部署 | FastGPT

方法如下:

启动 dockerdesktop。

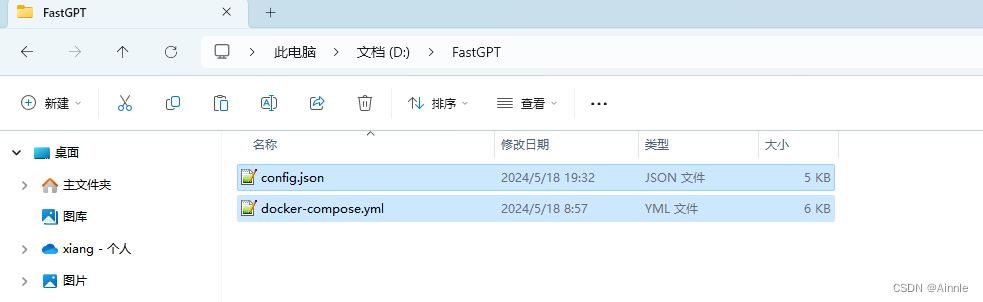

依次执行下面命令,创建 FastGPT 文件并复制

docker-compose.yml

和

config.json的内容并创建两个一模一样的文件

,执行完后目录下会有 2 个文件。

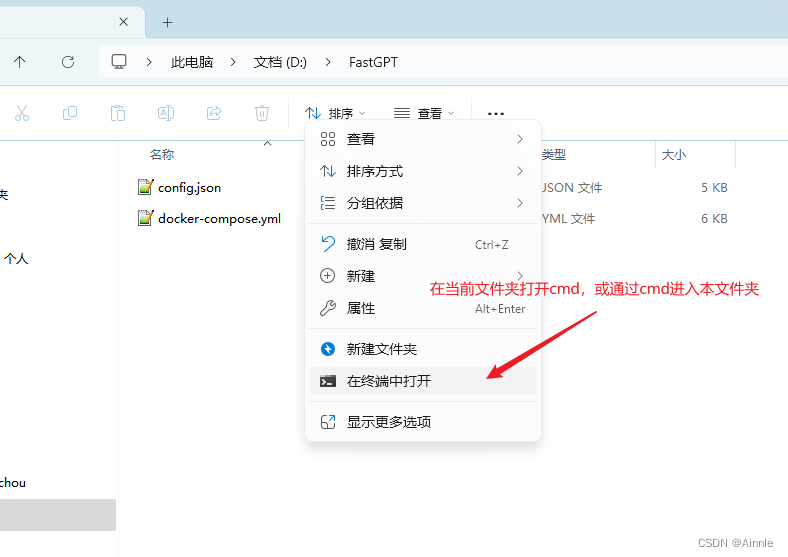

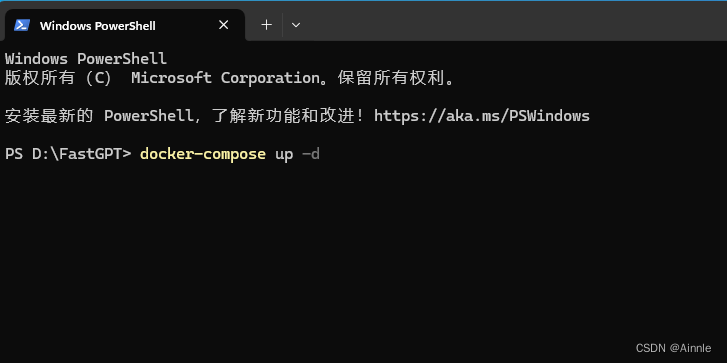

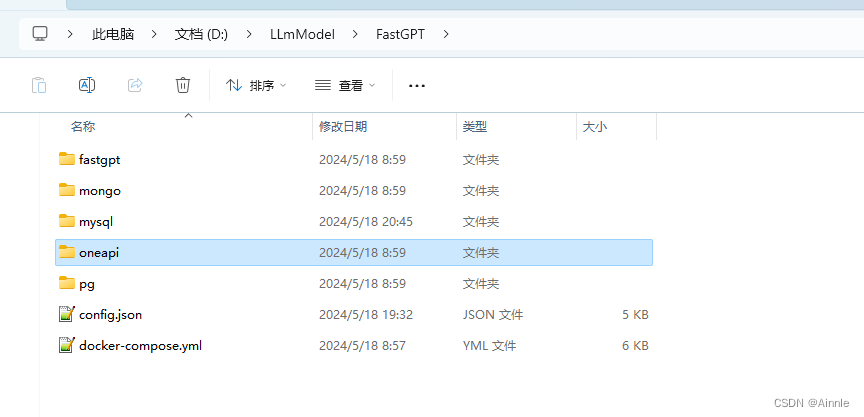

文件创建好并拷贝出git上对应的两个文件内容,并cmd进入当前文件夹执行代码:docker-compose up -d

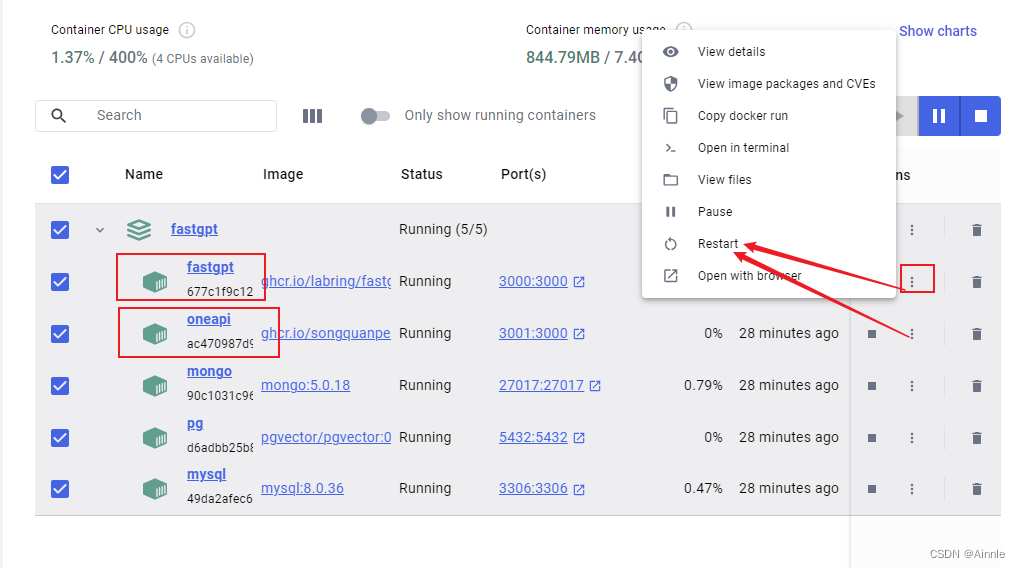

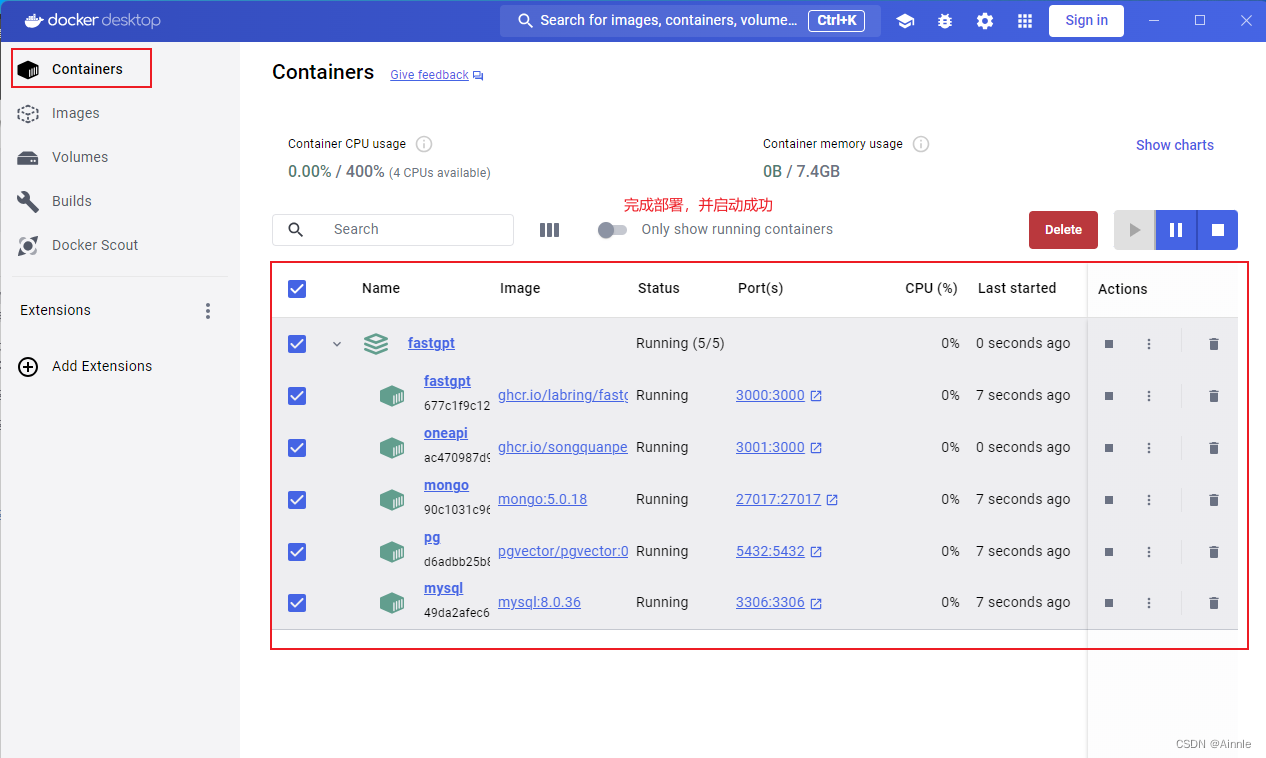

然后等待安装完成(由于我电脑已经完成安装,就不演示了)。完成后dockerdesktop会显示如下信息:

文件夹内容:

dockerdesktop内容:

2、启动并配置one api模型:

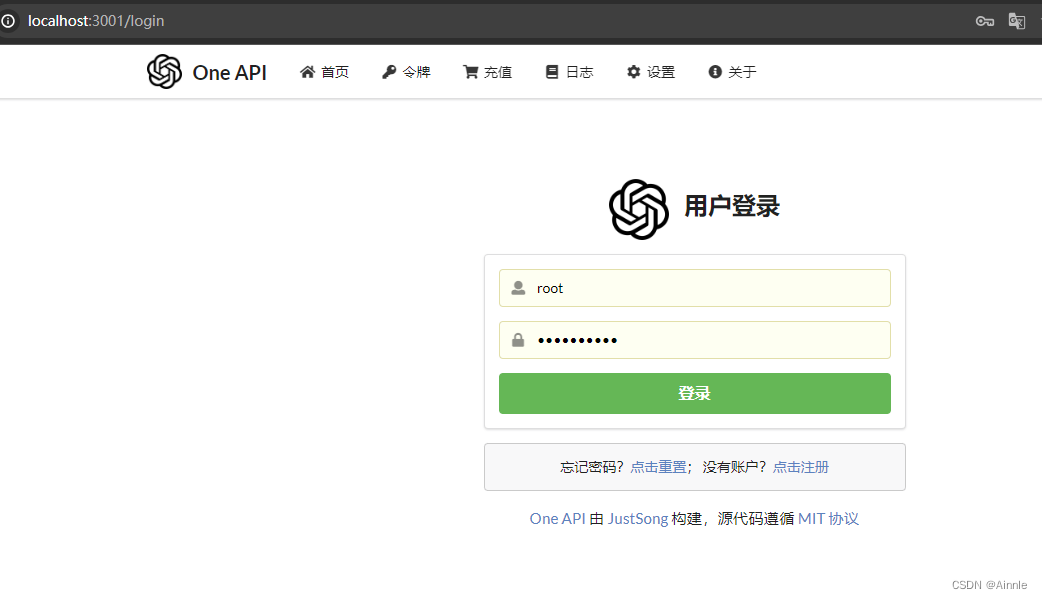

访问本地部署好的one api:http://localhost:3001/channel

初始化的 用户名:root 密码:123456

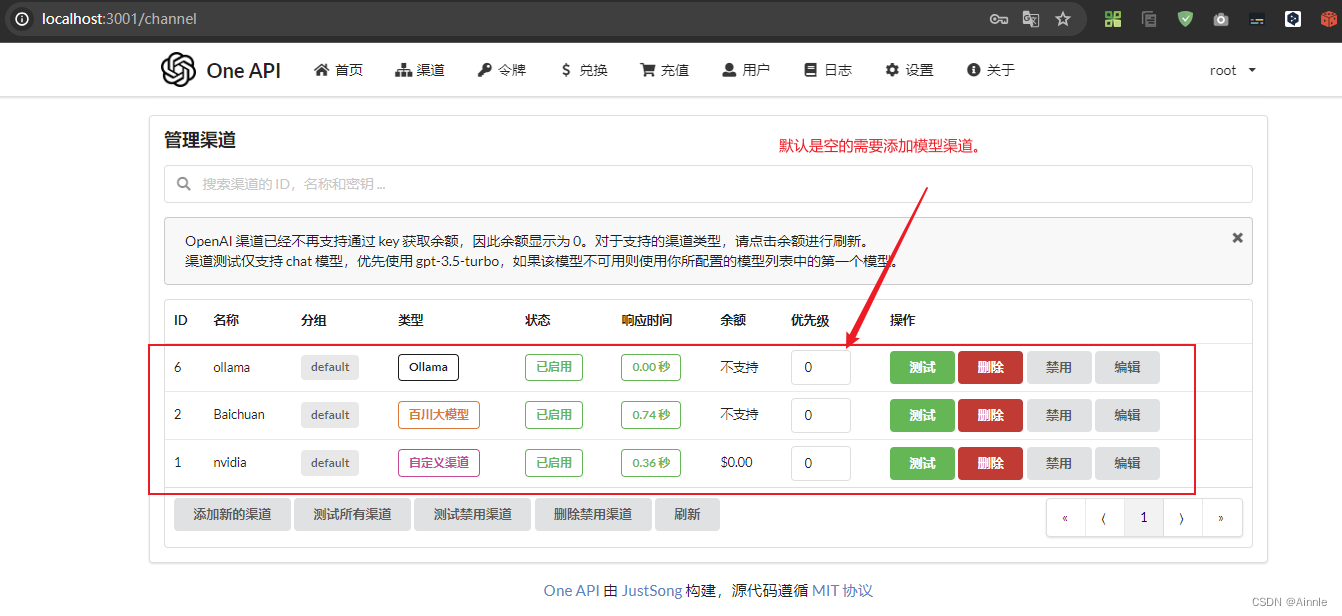

进入后会叫修改密码之类的,完成后点击“渠道”,配置你的大语言模型。首次登录进来渠道是空的,需要自己添加自己的大模型。

那接下来我们怎么配置刚刚安装的本地大模型llama3呢?

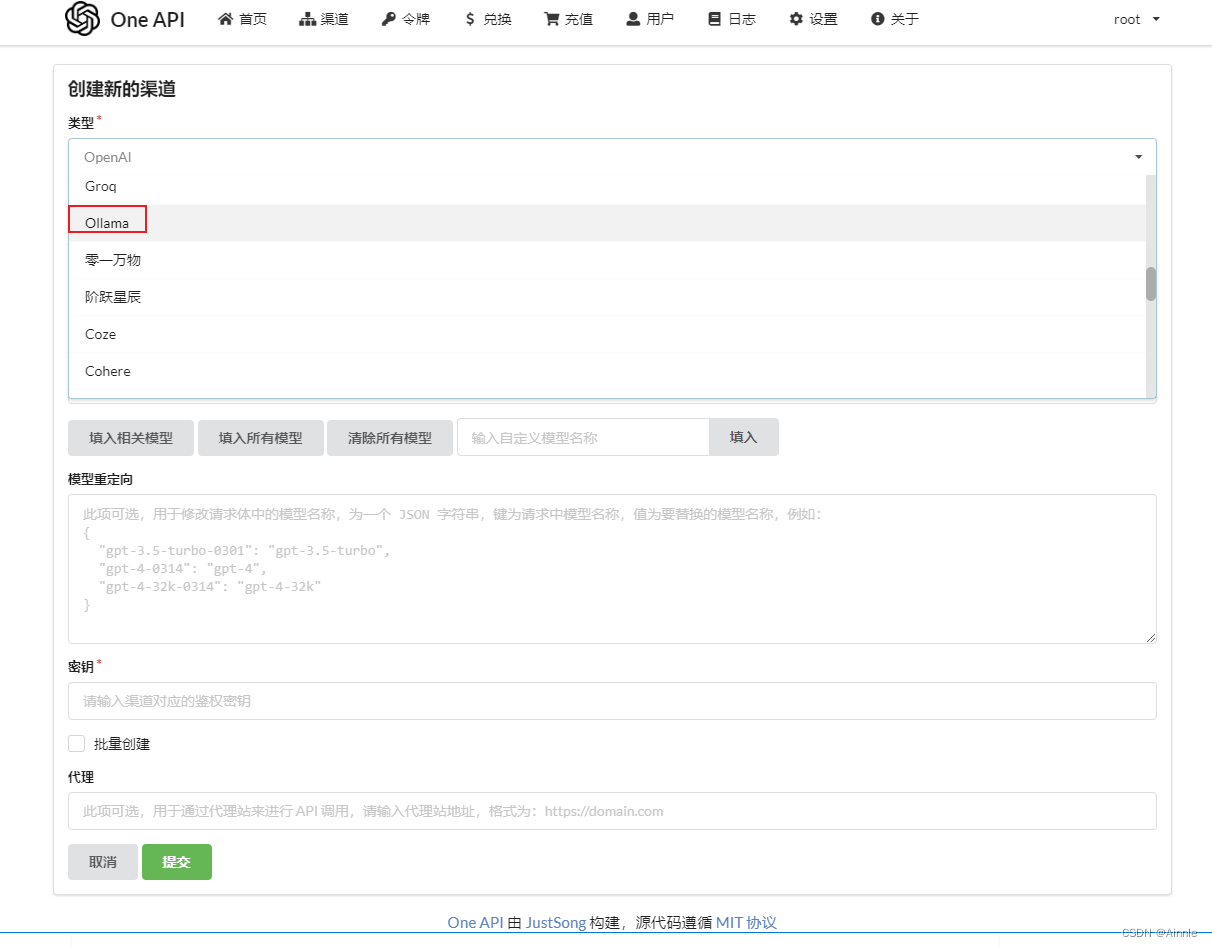

第一步:先点击 底部“添加新的渠道”,然后选择“Ollama”。

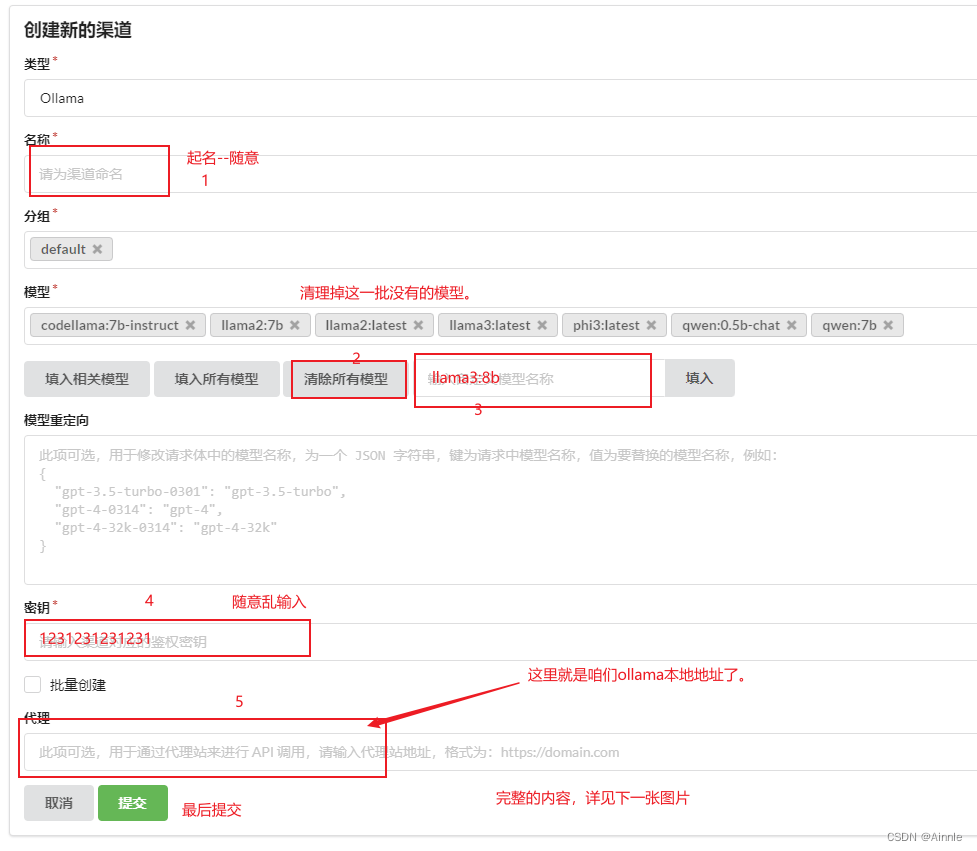

第二步:配置本地llama3:8b大模型

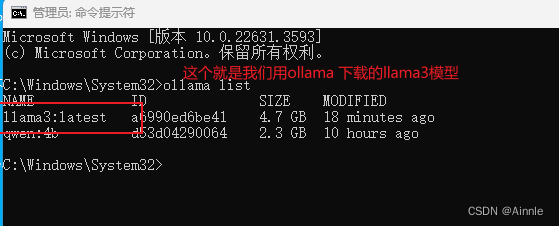

查询本地ollama中的模型名称,填入模型的时候用到

完整的配置界面

完成后测试通过,下图中有时间返回,就说明模型链接成功。

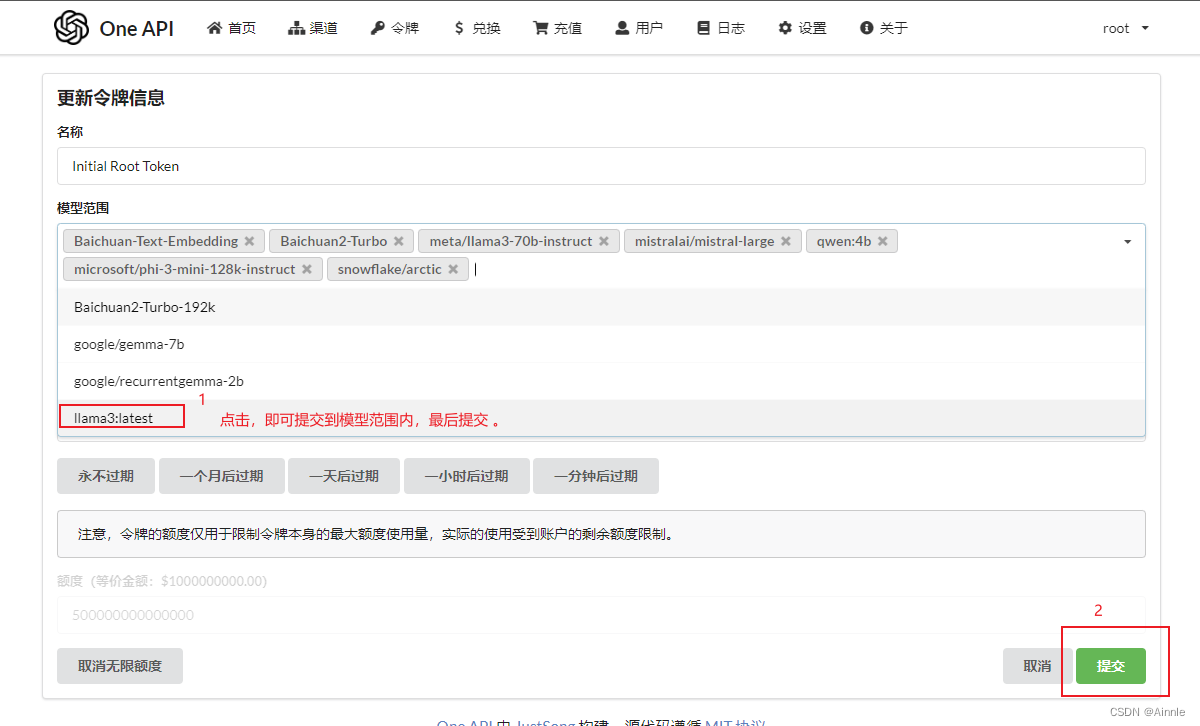

oneapi还有最后一步,就是将模型加入到咱们的令牌中,点击顶部“令牌”导航进入。选默认的令牌信息,并添加llama3:laest 模型。

五、配置Fastgpt

接下来配置Fastgpt并使用咱们导入的本地大模型llama3来进行创建chat 或者 agent了。

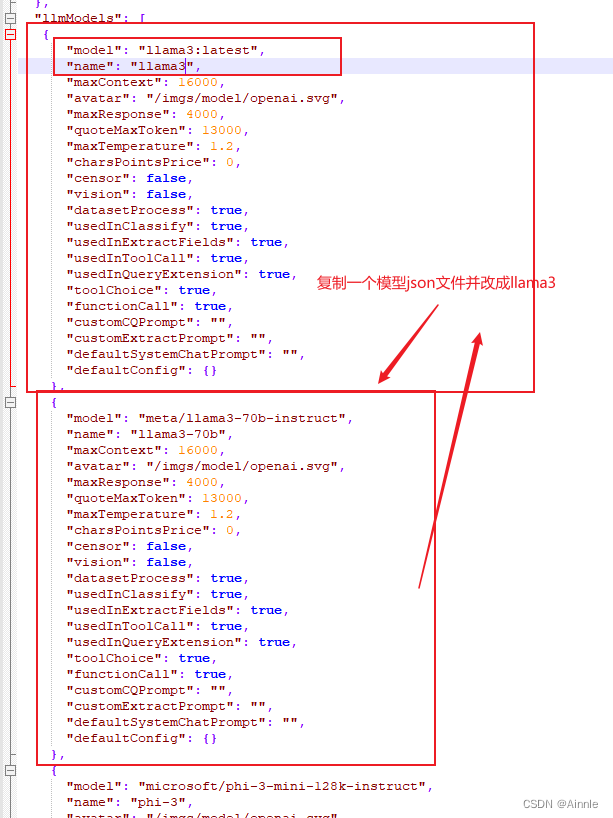

1、配置fastgpt的模型

进入最开始的fastgpt文件夹。找到config.json,配置llama3模型,位置和代码如下:

完成配置后需要重新启动dockerdesktop里面的oneapi和fastgpt。

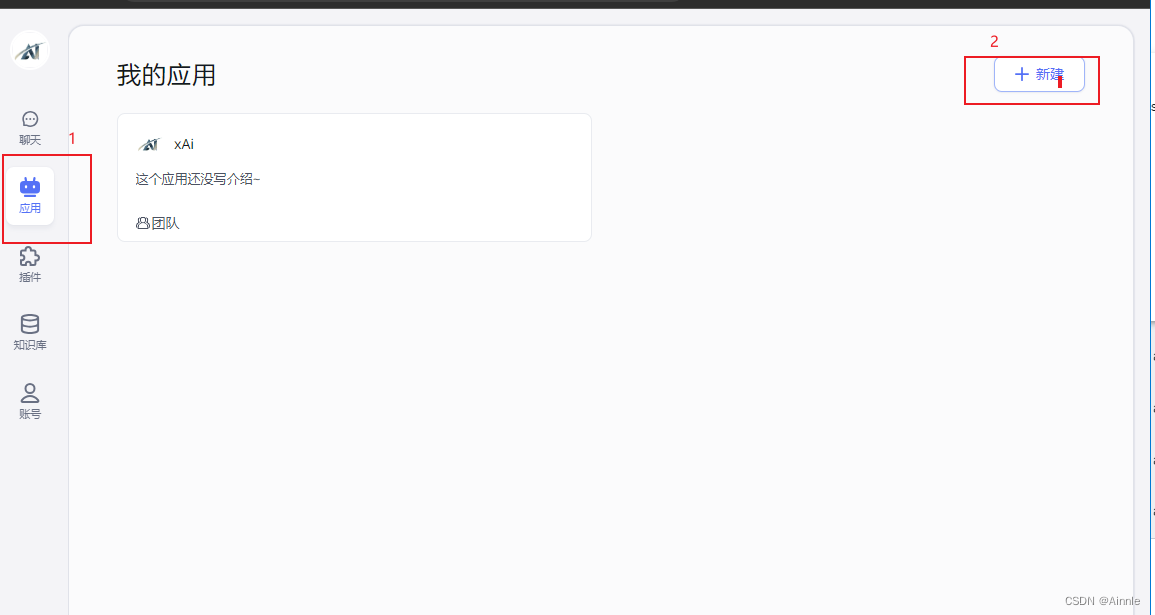

2、访问fastgpt

地址:http://localhost:3000/login,默认用户名:root 密码:1234

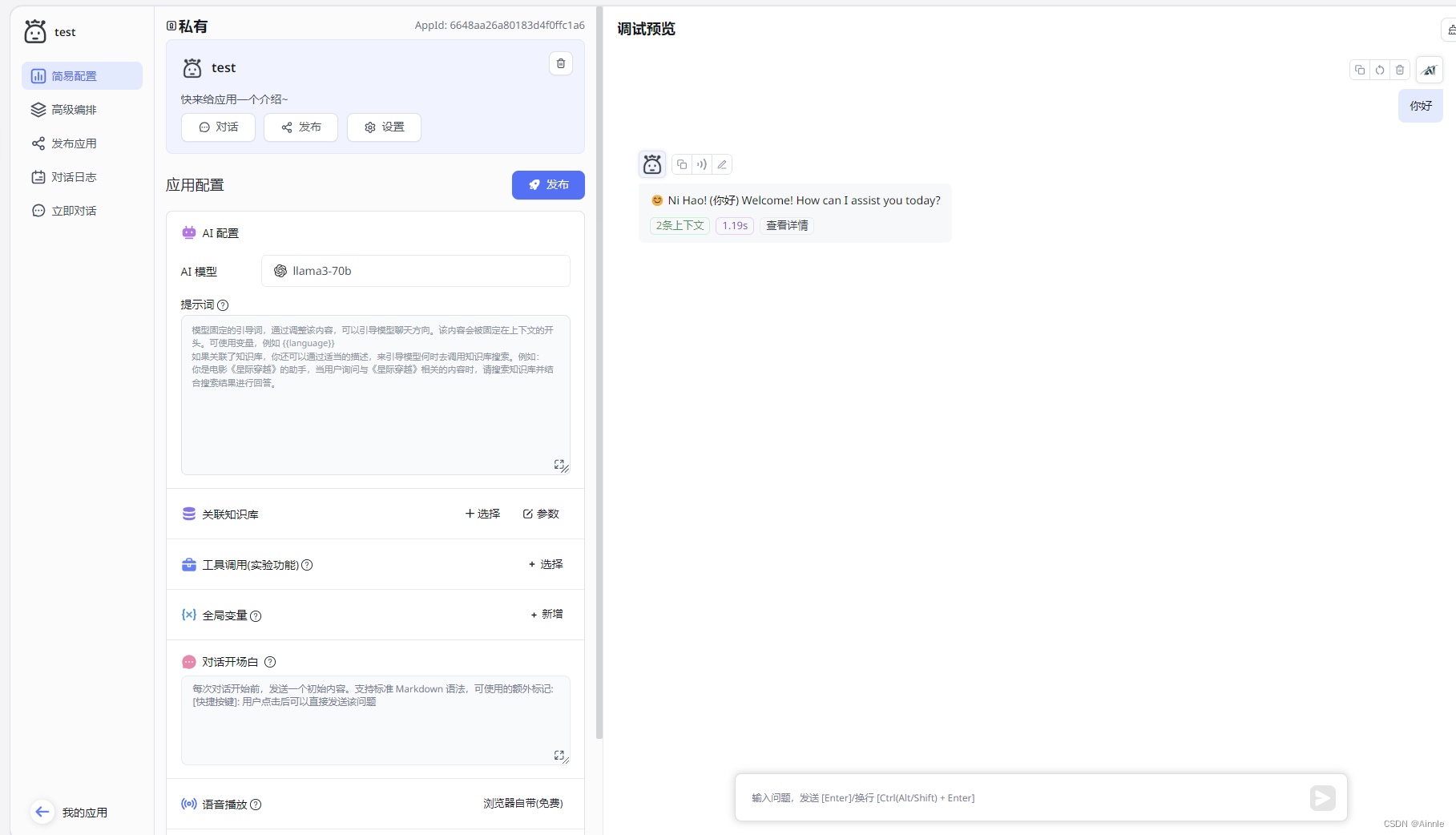

2、配置应用chat、agent等:

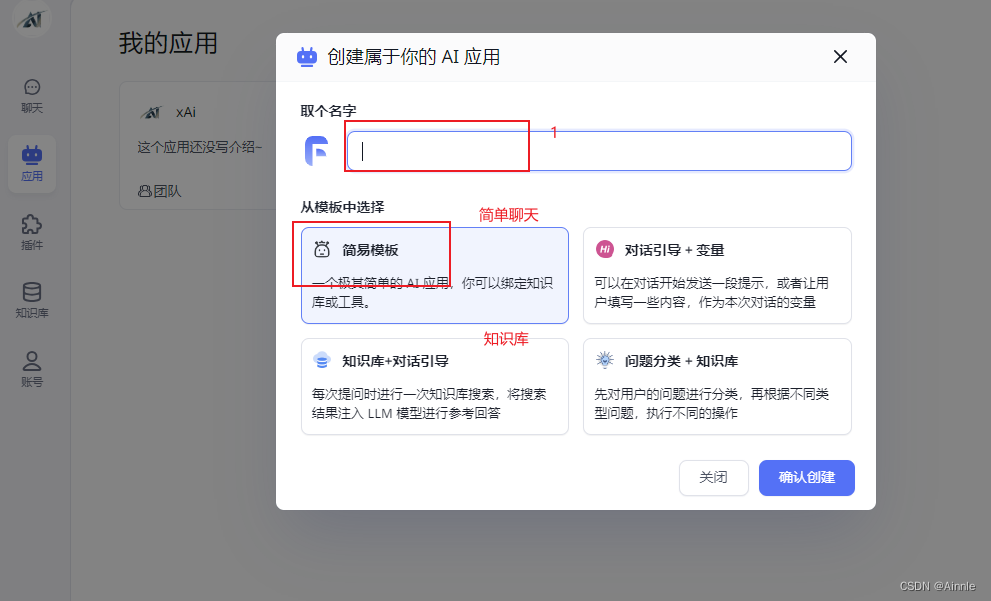

输入chat名字,选择类型。

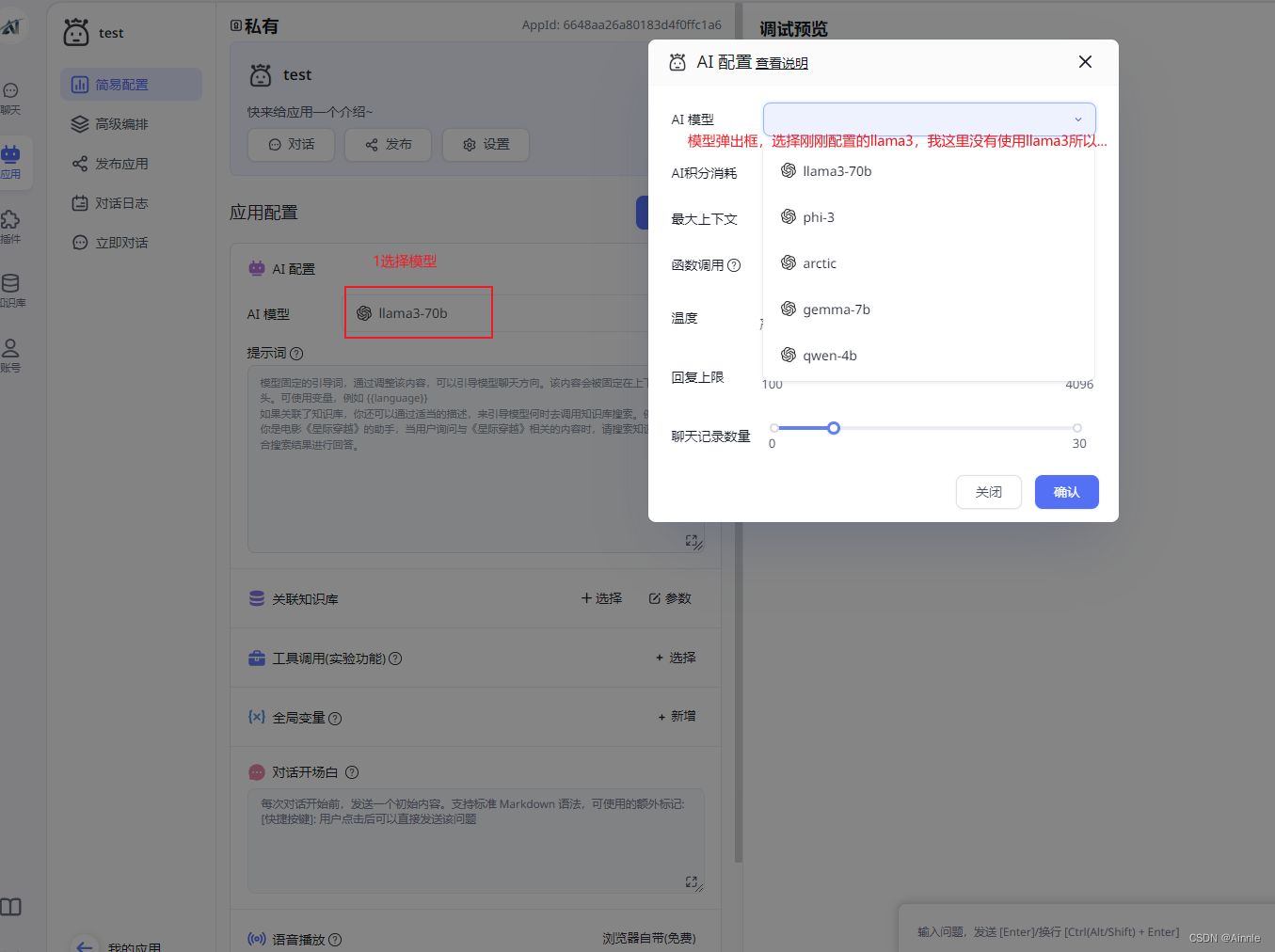

选择一个大模型,配置到你创建的应用中。

完成模型选择后进行 发布,发布后即可在右变边的聊天框中输入信息,进行对话。

第一个聊天应用就搞定了。后续还有知识库上传和导入,导入完成后即可配置本地RAG检索agent配置了。

下期再写吧,感谢各位耐心观看。

版权归原作者 Ainnle 所有, 如有侵权,请联系我们删除。