算力平台AutoDL

pip install -r requirements.txt -i https://pypi.mirrors.ustc.edu.cn/simple

-i https://pypi.mirrors.ustc.edu.cn/simple

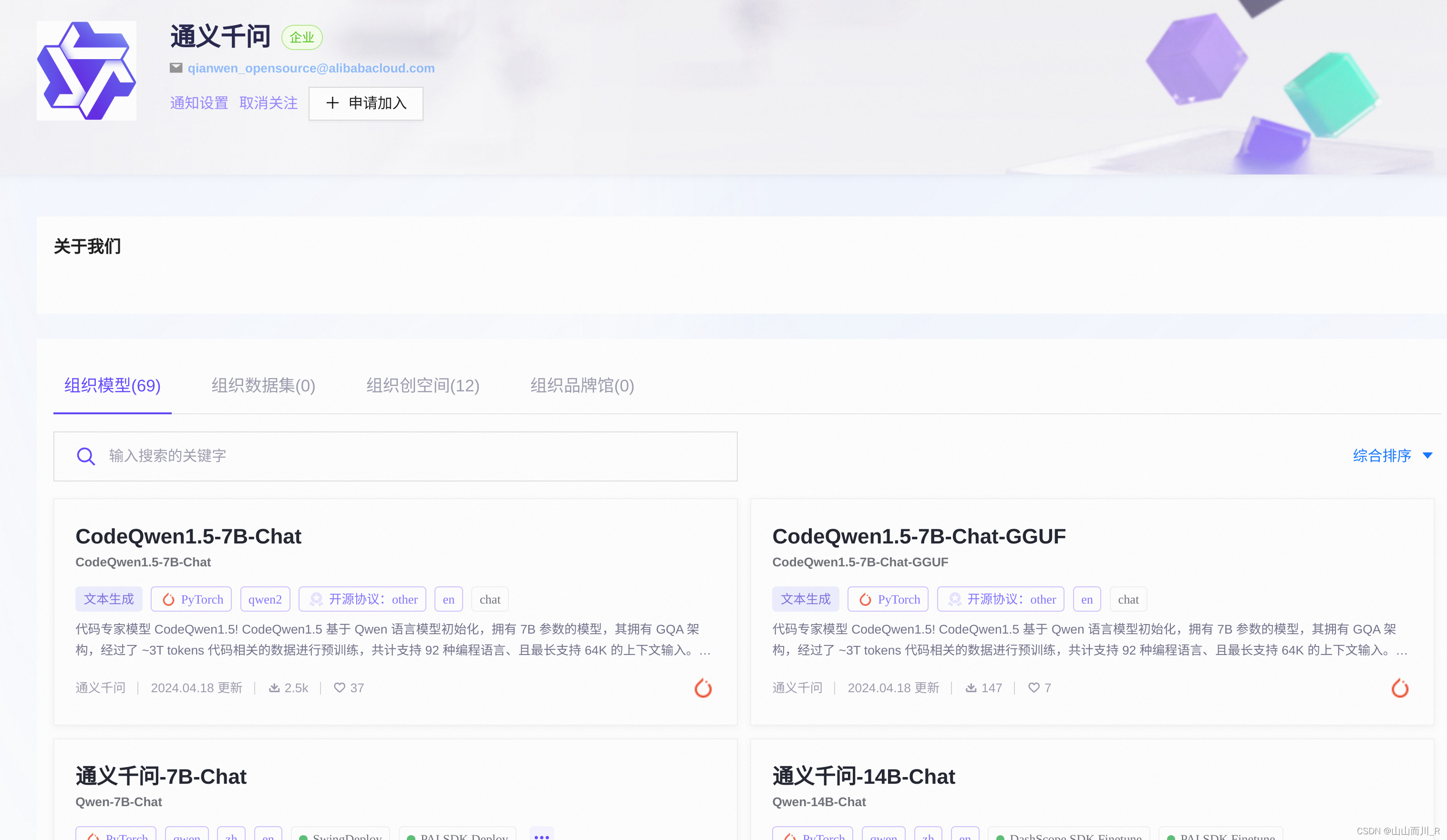

一、通义千问系列模型

1、CodeQwen1.5-7B-Chat

CodeQwen1.5是Qwen1.5的代码特定版本。它是一种基于变换器的纯解码器语言模型,在大量代码数据上进行预训练。

强大的代码生成能力和在一系列基准测试中具有竞争力的性能;

支持长上下文理解和生成,上下文长度为64 K令牌;

支持92种编码语言

在文本到SQL、错误修复等方面表现出色。

Qwen1.5-Int 4演示地址

2、通义千问-VL-Chat

VL-Chat 启动实例

VL-Chat-Int4 魔塔社区

VL-Chat 模型下载

** Qwen-VL** 是阿里云研发的大规模视觉语言模型(Large Vision Language Model, LVLM)。Qwen-VL 可以以图像、文本、检测框作为输入,并以文本和检测框作为输出。Qwen-VL 系列模型的特点包括:

- 强大的性能:在四大类多模态任务的标准英文测评中(Zero-shot Caption/VQA/DocVQA/Grounding)上,均取得同等通用模型大小下最好效果;

- 多语言对话模型:天然支持多语言对话,端到端支持图片里中英双语的长文本识别;

- 多图交错对话:支持多图输入和比较,指定图片问答,多图文学创作等;

- 首个支持中文开放域定位的通用模型:通过中文开放域语言表达进行检测框标注;

- 细粒度识别和理解:相比于目前其它开源LVLM使用的224分辨率,Qwen-VL是首个开源的448分辨率的LVLM模型。更高分辨率可以提升细粒度的文字识别、文档问答和检测框标注。

目前,我们提供了 Qwen-VL 系列的两个模型:

- Qwen-VL: Qwen-VL 以 Qwen-7B 的预训练模型作为语言模型的初始化,并以 Openclip ViT-bigG 作为视觉编码器的初始化,中间加入单层随机初始化的 cross-attention,经过约1.5B的图文数据训练得到。最终图像输入分辨率为448。

- Qwen-VL-Chat: 在 Qwen-VL 的基础上,我们使用对齐机制打造了基于大语言模型的视觉AI助手Qwen-VL-Chat,其训练数据涵盖了 QWen-7B 的纯文本 SFT 数据、开源 LVLM 的 SFT 数据、数据合成和人工标注的图文对齐数据。

想了解更多关于模型的信息,请点击链接查看我们的技术备忘录。

依赖项 (Dependency)

- python 3.8及以上版本

- pytorch 1.12及以上版本,推荐2.0及以上版本

- 建议使用CUDA 11.4及以上(GPU用户需考虑此选项)

未完...

版权归原作者 山山而川_R 所有, 如有侵权,请联系我们删除。