对抗样本:20行Python代码让95%准确率的图像分类器彻底失效

本文会用FGSM(快速梯度符号法)演示如何制作对抗样本,并解释神经网络为何如此脆弱。

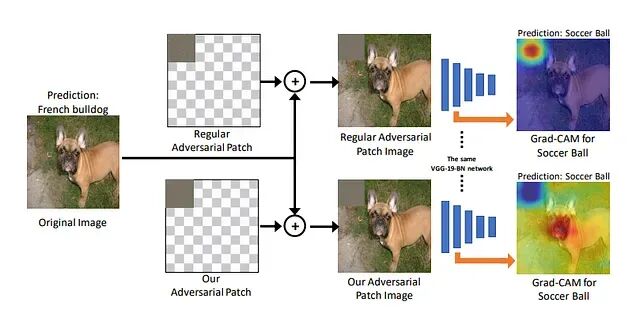

Simple Black-box Adversarial Attacks

我们提出了一种有趣的简单方法,用于在黑盒环境中构建对抗性图像。与白盒场景相比,构建黑盒对抗图像对查询预算有额外的限制,而有效的攻击至今仍是一个悬而未决的问题。仅在连续值置信分数的温和假设下,我们的高效查询算法利用了以下简单的迭代原理: 我们从预定义的正交基中随机采样向量,并将其添加或减去到目标图像中