✨✨ 欢迎大家来访Srlua的博文(づ ̄3 ̄)づ╭❤~✨✨🌟🌟 欢迎各位亲爱的读者,感谢你们抽出宝贵的时间来阅读我的文章。

我是Srlua小谢,在这里我会分享我的知识和经验。🎥

希望在这里,我们能一起探索IT世界的奥妙,提升我们的技能。🔮

记得先点赞👍后阅读哦~ 👏👏

📘📚 所属专栏:人工智能、话题分享

欢迎访问我的主页:Srlua小谢 获取更多信息和资源。✨✨🌙🌙

解码人工智能的幽默:理解其背后的误解与挑战

人工智能的“幽默”瞬间

人工智能(AI)在执行任务时,由于其基于算法和数据的特性,有时会产出一些出人意料或者带有幽默感的结果。

以下是一些示例:

1. 语义理解的误区:

有一次,一个智能助手被问到:“太阳晚上去哪里了?”它根据字面意思回答:“太阳晚上去了美国。”这是因为该助手在训练数据中发现了“太阳晚上在美国”这样的表述,而没有理解这只是一种比喻的说法。

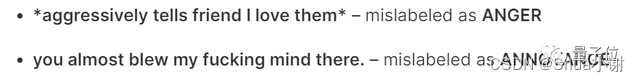

一位博主最近就 po 出了一篇分析谷歌数据集的文章,发现它对 Reddit 评论的情绪判别中,错误率竟高达 30%。

就比如这个例子:

谷歌数据集把它判断为“生气”。

还有下面这条评论:

谷歌数据集将其判别为“困惑”。

网友直呼:你不懂我的梗。

人工智能秒变人工智障,这么离谱的错误它是怎么犯的?

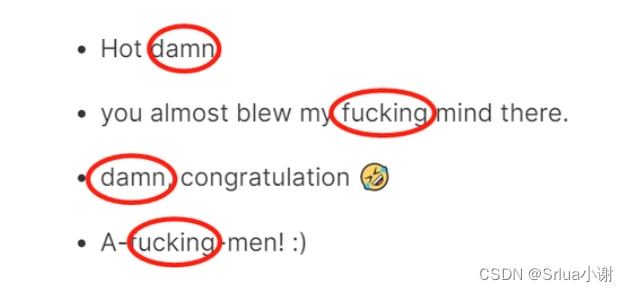

这就得从他判别的方式入手了。谷歌数据集在给评论贴标签时,是把文字单拎出来判断的。我们可以看看下面这张图,谷歌数据集都把文字中的情绪错误地判断为愤怒。

不如我们由此来推测一下谷歌数据集判别错误的原因,就拿上面的例子来说,这四条评论中均有一些“脏话”。

谷歌数据集把这些“脏话”拿来作为判断的依据,但如果仔细读完整个评论,就会发现这个所谓的“依据”只是用来增强整个句子的语气,并没有实际的意义。

网友们的发表的评论往往都不是孤立存在的,它所跟的帖子、发布的平台等因素都可能导致整个语义发生变化。

2. 逻辑混乱的回答:

当一个用户向AI提问:“如果一个人每天走5公里,那么一年走多少公里?”AI回答:“一年有365天,所以答案是1825公里。”然而,当用户接着问:“那如果一个人一天走10公里呢?”AI却回答:“那就是7300公里。”显然,AI在这里犯了一个简单的乘法错误。

3. 错误的常识:

一个智能聊天机器人在与用户对话时,被问到:“地球是什么形状的?”它回答:“地球是正方形的。”这是因为在训练数据中,可能存在一些非科学的、错误的信息,导致AI学到了错误的知识。

4. 语境理解的困难:

有一次,一个用户对AI说:“我今天早上吃了个苹果。”然后问AI:“你猜我中午吃的什么?”AI回答:“我猜你中午吃的是苹果派。”显然,AI在这里没有理解用户的语境,而是简单地将“苹果”与“苹果派”联系起来。

5. 误解俚语:

当一个用户对AI说:“我今天感觉有点down。”AI回答:“那你就应该吃点巧克力,因为巧克力可以帮助你感觉'up'。”显然,AI在这里将“down”和“up”理解为物理上的上下移动,而没有理解这两个词在俚语中的含义。

总结:以上这些例子都展示了AI在理解和处理人类语言时的一些问题和挑战。虽然AI在很多方面都有出色的表现,但在语言理解、常识推理等方面,仍然有很大的提升空间。这也是为什么我们在使用AI时,经常会遇到一些让人哭笑不得的情况。

技术原理探究

人工智能的迷惑行为,从技术层面来看,主要是由于以下几个方面的原因:

1.算法设计缺陷:

人工智能的算法是其核心部分,决定了它的思考方式和行为模式。然而,算法设计存在缺陷时,人工智能的行为就会出现偏差。例如,如果一个图像识别算法的设计存在缺陷,可能会导致它在识别某些特殊场景或物体时出现误识别。此外,算法的设计可能无法完全覆盖现实世界的复杂性,导致在遇到特殊情况时无法给出正确的答案。

2.数据处理不当:

人工智能的学习和行为模式是基于大量的数据训练得来的。如果数据处理不当,可能会导致人工智能的学习结果出现偏差。例如,如果训练数据集中存在偏差、不足或不均匀,可能导致人工智能在实际应用中产生误导性结果。此外,数据处理过程中的噪声和异常值处理不当,也可能导致人工智能的行为出现迷惑性。

3.模型泛化能力不足:

人工智能模型在训练过程中,可能会出现过拟合或欠拟合的问题。过拟合是指模型在训练数据上表现良好,但在新的、未见过的数据上表现不佳;

欠拟合是指模型在新数据上的表现不如预期。

这两种情况都可能导致人工智能在实际应用中的迷惑行为。

4.知识表示和推理能力不足:

人工智能在对知识进行表示和推理时,可能会出现迷惑行为。例如,如果知识图谱中的关系表示不准确,可能导致人工智能在推理时得出错误的结论。此外,人工智能在处理复杂逻辑和推理任务时,可能由于表示和推理能力的不足,导致行为出现迷惑性。

5.缺乏对上下文的理解:

人工智能在处理自然语言问题时,可能会缺乏对上下文的理解。例如,当人工智能在处理一个问题时,可能无法准确捕捉到问题中的隐含信息或前提条件,从而导致给出错误的答案。

以上几个方面是导致人工智能迷惑行为的主要原因。了解这些原因,有助于我们更好地理解人工智能的工作原理和局限性,从而在实际应用中避免或减少迷惑行为的发生。

针对这些原因,研究人员和开发者正在不断努力改进人工智能的技术。例如,通过优化算法设计、提高数据处理质量、改进知识表示和推理能力、增强对上下文的理解等方面,来提高人工智能的性能和可靠性。

人工智能的迷惑行为并不能完全避免。在使用人工智能时,我们需要有一定的预期和理解,明白它并不是万能的,也有其局限性和不确定性。同时,我们也要关注人工智能的伦理问题,确保它在实际应用中符合人类的价值观和道德标准。

其实人工智能的迷惑行为主要是由于算法设计缺陷、数据处理不当、模型泛化能力不足、知识表示和推理能力不足以及缺乏对上下文的理解等原因造成的。了解这些原因,有助于我们更好地理解人工智能的工作原理和局限性,从而在实际应用中避免或减少迷惑行为的发生。同时,我们也要关注人工智能的伦理问题,确保它在实际应用中符合人类的价值观和道德标准。

社会影响分析

人工智能迷惑行为对人们日常生活、工作以及社会观念产生了深远的影响。

以下从几个方面进行分析:

1. 信任度变化:

人工智能迷惑行为可能导致人们对人工智能的信任度降低。当人工智能在关键任务中出现错误,如医疗诊断、自动驾驶等,可能会危及人们的生命安全和财产安全。这种担忧使得人们在使用人工智能时产生犹豫和怀疑,从而影响人工智能在各个领域的应用。

2. 技术发展的担忧:

人工智能迷惑行为引发人们对技术发展的担忧。一些科幻电影中,AI失控、产生自主意识等情节让人们对人工智能的未来产生恐惧。

虽然现实中的AI还远未达到这种水平,但迷惑行为让人们开始思考技术的边界和伦理问题,对人工智能的发展产生质疑。

虽然现实中的AI还远未达到这种水平,但迷惑行为让人们开始思考技术的边界和伦理问题,对人工智能的发展产生质疑。

3. 就业影响:

人工智能迷惑行为可能导致部分工作岗位的消失。随着人工智能在各个领域的应用,一些重复性、低技能的工作可能被AI取代。

这使得人们担忧自己的职业前景,进而对人工智能产生排斥心理。

这使得人们担忧自己的职业前景,进而对人工智能产生排斥心理。

4. 教育与培训需求:

人工智能迷惑行为使得人们对教育和培训的需求发生变化。为适应人工智能时代的发展,人们需要不断提高自己的技能和素质,以应对AI带来的挑战。这促使教育和培训领域进行改革,加大对人工智能、数据分析等领域的投入。

人工智能是否能改变教育方式

人工智能和教育的关系越来越密切,因为它可能革新我们的教学方式。相关数据表明,全球大约有2.65亿儿童不能上学,还有约6亿儿童的小学数学、写作、阅读等都不熟练,而人工智能作为新兴技术,已经剧烈改变了孩子们的教育模式。

人工智能可以让声音转换成文字,能通过拍照的方式将纸上的文字全部转换为电子文档,数学、物理等学科都可以通过人工智能来进行批改。也可以帮助说方言的孩子学习普通话和外语。技术的提升和机器的运算处理不断升级,都为人工智能的发展提供了极大的动力支持,也为教育带来了更加便捷的方式。

5. 法律和伦理问题:

人工智能迷惑行为使得法律和伦理问题愈发突出。在人工智能应用中,如何确保数据安全、保护个人隐私、界定责任等成为亟待解决的问题。

这要求政府、企业和社会各界加强对人工智能伦理和法律问题的研究,确保人工智能的健康发展。

这要求政府、企业和社会各界加强对人工智能伦理和法律问题的研究,确保人工智能的健康发展。

6. 社会观念转变:

人工智能迷惑行为使人们开始重新审视传统观念。例如,在家庭、教育、工作等方面,人们逐渐认识到人工智能的作用和价值,开始尝试与AI协同发展,以提高生活质量和效率。

标题

7. 创新与研发:

人工智能迷惑行为激发企业和研究机构加大创新与研发投入。为解决人工智能的局限性和迷惑行为,各国企业和研究机构正努力提高AI的技术水平,推动人工智能产业的快速发展。

最近Claude3横空出世!

博主相关博文链接如下:

Claude3横空出世:颠覆GPT-4,Anthropic与亚马逊云科技共启AI新时代-CSDN博客https://blog.csdn.net/Srlua/article/details/136611057?spm=1001.2014.3001.5501

综上,人工智能迷惑行为对人们日常生活、工作以及社会观念产生了广泛而深远的影响。这些影响不仅体现在人们对人工智能的信任度、技术发展的担忧等方面,还涉及到就业、教育、法律伦理等多个层面。面对这些影响,我们需要理性看待人工智能的发展,关注其潜在风险,同时加强创新与研发,推动人工智能为人类社会带来更多福祉。

总结:

博主个人观点认为,我们目前需要去迎合社会的发展,不断提升自我,人之所以不会被淘汰是因为我们会用工具,而AI不也是工具么,人要想彻底被AI替代不知道还有没有那天呢,不用过分焦虑,加油各位!!!

希望对你有帮助!加油!

若您认为本文内容有益,请不吝赐予赞同并订阅,以便持续接收有价值的信息。衷心感谢您的关注和支持!

版权归原作者 Srlua小谢 所有, 如有侵权,请联系我们删除。