前言

总结一下视频监控的数据集,用于目标检测、跟踪,持续跟新中..........。

一、UA-DETRAC 数据集

UA-DETRAC是一个具有挑战性的真实世界多目标检测和多目标跟踪基准。该数据集包括在中国北京和天津的24个不同地点使用Cannon EOS 550D相机拍摄的10小时视频。视频以每秒25帧(fps)的速度录制,分辨率为960×540像素。UA-DETRAC数据集中有超过14万个帧,手动注释了8250个车辆,总共有121万个标记的对象边界框。官方还对目标检测和多目标跟踪中的最新方法以及本网站中详述的评估指标进行基准测试。

官网地址:

The UA-DETRAC Benchmark Suitehttp://detrac-db.rit.albany.edu/

论文地址:

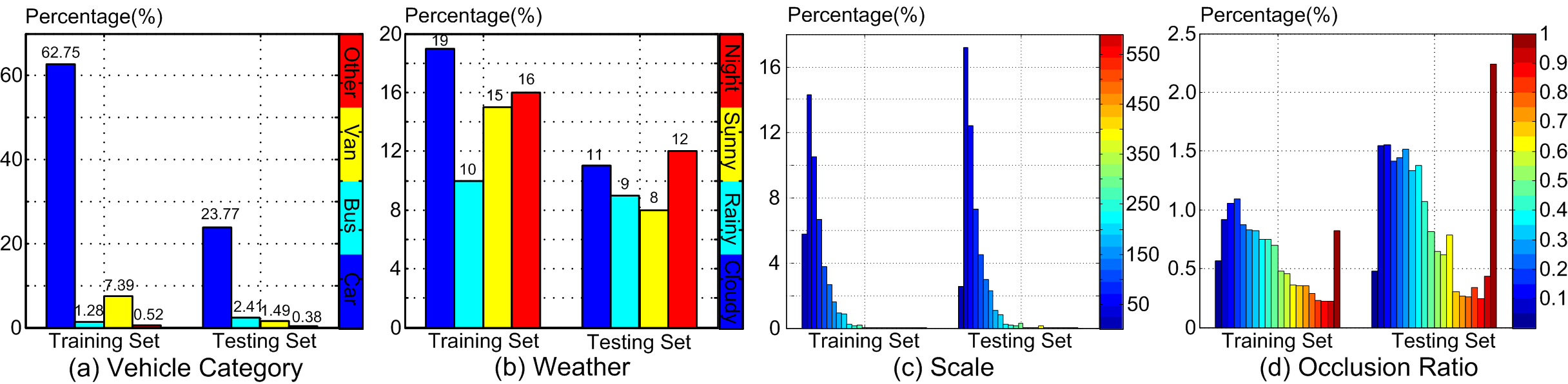

https://arxiv.org/pdf/1511.04136.pdfhttps://arxiv.org/pdf/1511.04136.pdf使用车辆类别、天气、规模、遮挡率和截断率等属性分析了目标检测和跟踪算法的性能。

- 车辆类别 我们将车辆分为四类,即轿车、公共汽车、面包车和其他。

- 天气 我们考虑四类天气条件,即多云、夜间、晴天和雨天。

- 比例 我们将带注释车辆的比例定义为其面积的平方根(以像素为单位)。我们将车辆分为三个等级:小型(0-50 像素)、中型(50-150 像素)和大型(超过 150 像素)。

- 遮挡率 我们使用车辆边界框被遮挡的比例来定义遮挡程度。我们将遮挡程度分为三类:无遮挡、部分遮挡和重度遮挡。具体来说,如果车辆的遮挡率在 1%-50% 之间,我们定义为部分遮挡,如果遮挡率大于 50%,我们定义为重遮挡。

- 截断率 截断率表示车辆部件在框架外的程度,用于训练样本选择。

二、MOT Challenge 数据集

MOT Challenge 是应用在多目标跟踪中最常见的数据集,它专门用于行人跟踪的场景,这些数据集目前已公开提供。对于每个数据集都提供了训练数据和测试数据,其中训练数据提供了目标检测结果和真实的跟踪结果,而测试数据只提供目标检测的结果。

常截至目前,MOT Challenge 数据集包含了MOT15,MOT16/MOT17,MOT20等子数据集。

MOT Challengehttps://motchallenge.net/MOT15 数据集部分视频序列实例:

MOT15 子数据集是 MOT Challenge 数据集上第一代数据,它包括 2D MOT15数据和 3D MOT15 数据。其中 2D MOT15 数据一共包含了 22 段视频序列(其中11 段视频作为训练使用,另外 11 段视频作为测试使用)。另外 2D MOT15 子数据集使用了 ACF 检测器识别视频序列中的目标来提供公共的检测结果。

MOT16/MOT17 子数据集中行人密度较高,因此该数据集也更具挑战性。这两个数据集包含了相同的 14 段视频序列(其中 7 段视频作为训练使用,另外 7 段视频作为测试使用)。

MOT16 子数据集使用了 DPM 检测器作为公开检测器。而 MOT17 子数据集则提供了三组不同的目标检测(Faster R-CNN,DPM以及 SDP)结果。

MOT20 数据集部分序列实例:

MOT20 子数据集的场景极其复杂,行人密度极高,更加考验多目标跟踪器的性能。该数据集一共包含 8 段视频序列,使用了 Faster R-CNN 作为检测器来提供公开检测结果。MOT20 数据集部分序列如上图所示,可以看到场景当中的人口密度极大。

参考文章:https://blog.csdn.net/weixin_44936889/article/details/107029111

参考文献:面向复杂场景的多目标跟踪算法研究.胡玉杰.电子科技大学.

目前只找到两个比较好的数据集,后面如果新的发现会持续跟新的,欢迎交流~

版权归原作者 一颗小树x 所有, 如有侵权,请联系我们删除。