YOLOV7训练自己的数据集以及训练结果分析(手把手教你)

YOLOV7训练自己的数据集整个过程主要包括:环境安装----制作数据集----参数修改----模型测试----模型推理

一:环境安装

conda create -n yolov7 python=3.8

conda activate yolov7

#cuda cudnn torch等版本就不细说了,根据自己的显卡配置自行下载

#v7 guihub代码地址 https://github.com/WongKinYiu/yolov7

git clone https://github.com/WongKinYiu/yolov7.git #下载到本地也行

#cd到v7项目中

conda activate yolov7

pip install -r requirements.txt

二: 制作数据集

labelme标注的数据格式是VOC,而YOLOv7能够直接使用的是YOLO格式的数据,因此下面将介绍如何将自己的数据集转换成可以直接让YOLOv7进行使用。

1. 创建数据集

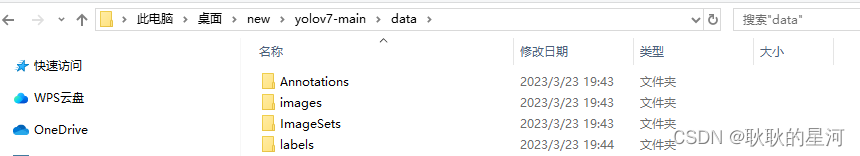

在data目录下新建Annotations, images, ImageSets, labels 四个文件夹

images目录下存放数据集的图片文件

Annotations目录下存放图片的xml文件(labelImg标注)

其中目录结构如下

.

├── ./data

│ ├── ./data/Annotations

│ │ ├── ./data/Annotations/35.xml

│ │ ├── ./data/Annotations/36.xml

│ │ ├── ...

│ ├── ./data/images

│ │ ├── ./data/images/35.jpg

│ │ ├── ./data/images/36.jpg

│ │ ├── ...

│ ├── ./data/ImageSets

│ └── ./data/labels

│ ├── ./data/coco.yaml

│ ├── ./data/hyp.scratch.p5.yaml

│ ├── ./data/hyp.scratch.p6.yaml

│ ├── ./data/hyp.scratch.tiny.yaml

├── ./cfg

├── ./detect.py

├── ./figure

├── ./hubconf.py

├── ./inference

├── ./models

├── ./README.md

├── ....

2. 按比例划分数据集

在yolov7根目录下新建一个文件splitDataset.py

随机分配训练/验证/测试集图片,代码如下所示:

import os

import random

trainval_percent = 0.9

train_percent = 0.9

xmlfilepath = 'data/Annotations'

txtsavepath = 'data/ImageSets'

total_xml = os.listdir(xmlfilepath)

num = len(total_xml)

list = range(num)

tv = int(num * trainval_percent)

tr = int(tv * train_percent)

trainval = random.sample(list, tv)

train = random.sample(trainval, tr)

ftrainval = open('data/ImageSets/trainval.txt', 'w')

ftest = open('data/ImageSets/test.txt', 'w')

ftrain = open('data/ImageSets/train.txt', 'w')

fval = open('data/ImageSets/val.txt', 'w')

for i in list:

name = total_xml[i][:-4] + '\n'

if i in trainval:

ftrainval.write(name)

if i in train:

ftrain.write(name)

else:

fval.write(name)

else:

ftest.write(name)

ftrainval.close()

ftrain.close()

fval.close()

ftest.close()

3. 将xml文件转换成YOLO系列标准读取的txt文件

在同级目录下再新建一个文件XML2TXT.py

注意classes = [“…”]一定需要填写自己数据集的类别,在这里我是一个类别"fall",因此classes = [“ship”],代码如下所示:

如果数据集中的类别比较多不想手敲类别的,可以使用(4)中的脚本直接获取类别,同时还能查看各个类别的数据量,如果不想可以直接跳过(4)。

# -*- coding: utf-8 -*-

# xml解析包

import xml.etree.ElementTree as ET

import pickle

import os

from os import listdir, getcwd

from os.path import join

sets = ['train', 'test', 'val']

classes = ['fall']

# 进行归一化操作

def convert(size, box): # size:(原图w,原图h) , box:(xmin,xmax,ymin,ymax)

dw = 1./size[0] # 1/w

dh = 1./size[1] # 1/h

x = (box[0] + box[1])/2.0 # 物体在图中的中心点x坐标

y = (box[2] + box[3])/2.0 # 物体在图中的中心点y坐标

w = box[1] - box[0] # 物体实际像素宽度

h = box[3] - box[2] # 物体实际像素高度

x = x*dw # 物体中心点x的坐标比(相当于 x/原图w)

w = w*dw # 物体宽度的宽度比(相当于 w/原图w)

y = y*dh # 物体中心点y的坐标比(相当于 y/原图h)

h = h*dh # 物体宽度的宽度比(相当于 h/原图h)

return (x, y, w, h) # 返回 相对于原图的物体中心点的x坐标比,y坐标比,宽度比,高度比,取值范围[0-1]

# year ='2012', 对应图片的id(文件名)

def convert_annotation(image_id):

'''

将对应文件名的xml文件转化为label文件,xml文件包含了对应的bunding框以及图片长款大小等信息,

通过对其解析,然后进行归一化最终读到label文件中去,也就是说

一张图片文件对应一个xml文件,然后通过解析和归一化,能够将对应的信息保存到唯一一个label文件中去

labal文件中的格式:calss x y w h 同时,一张图片对应的类别有多个,所以对应的bunding的信息也有多个

'''

# 对应的通过year 找到相应的文件夹,并且打开相应image_id的xml文件,其对应bund文件

in_file = open('data/Annotations/%s.xml' % (image_id), encoding='utf-8')

# 准备在对应的image_id 中写入对应的label,分别为

# <object-class> <x> <y> <width> <height>

out_file = open('data/labels/%s.txt' % (image_id), 'w', encoding='utf-8')

# 解析xml文件

tree = ET.parse(in_file)

# 获得对应的键值对

root = tree.getroot()

# 获得图片的尺寸大小

size = root.find('size')

# 如果xml内的标记为空,增加判断条件

if size != None:

# 获得宽

w = int(size.find('width').text)

# 获得高

h = int(size.find('height').text)

# 遍历目标obj

for obj in root.iter('object'):

# 获得difficult ??

difficult = obj.find('difficult').text

# 获得类别 =string 类型

cls = obj.find('name').text

# 如果类别不是对应在我们预定好的class文件中,或difficult==1则跳过

if cls not in classes or int(difficult) == 1:

continue

# 通过类别名称找到id

cls_id = classes.index(cls)

# 找到bndbox 对象

xmlbox = obj.find('bndbox')

# 获取对应的bndbox的数组 = ['xmin','xmax','ymin','ymax']

b = (float(xmlbox.find('xmin').text), float(xmlbox.find('xmax').text), float(xmlbox.find('ymin').text),

float(xmlbox.find('ymax').text))

print(image_id, cls, b)

# 带入进行归一化操作

# w = 宽, h = 高, b= bndbox的数组 = ['xmin','xmax','ymin','ymax']

bb = convert((w, h), b)

# bb 对应的是归一化后的(x,y,w,h)

# 生成 calss x y w h 在label文件中

out_file.write(str(cls_id) + " " + " ".join([str(a) for a in bb]) + '\n')

# 返回当前工作目录

wd = getcwd()

print(wd)

for image_set in sets:

'''

对所有的文件数据集进行遍历

做了两个工作:

1.将所有图片文件都遍历一遍,并且将其所有的全路径都写在对应的txt文件中去,方便定位

2.同时对所有的图片文件进行解析和转化,将其对应的bundingbox 以及类别的信息全部解析写到label 文件中去

最后再通过直接读取文件,就能找到对应的label 信息

'''

# 先找labels文件夹如果不存在则创建

if not os.path.exists('data/labels/'):

os.makedirs('data/labels/')

# 读取在ImageSets/Main 中的train、test..等文件的内容

# 包含对应的文件名称

image_ids = open('data/ImageSets/%s.txt' % (image_set)).read().strip().split()

# 打开对应的2012_train.txt 文件对其进行写入准备

list_file = open('data/%s.txt' % (image_set), 'w')

# 将对应的文件_id以及全路径写进去并换行

for image_id in image_ids:

list_file.write('data/images/%s.jpg\n' % (image_id))

# 调用 year = 年份 image_id = 对应的文件名_id

convert_annotation(image_id)

# 关闭文件

list_file.close()

4. 查看自定义数据集标签类别及数量

在同级目录下再新建一个文件ViewCategory.py,将代码复制进去

import os

from unicodedata import name

import xml.etree.ElementTree as ET

import glob

def count_num(indir):

label_list = []

# 提取xml文件列表

os.chdir(indir)

annotations = os.listdir('.')

annotations = glob.glob(str(annotations) + '*.xml')

dict = {} # 新建字典,用于存放各类标签名及其对应的数目

for i, file in enumerate(annotations): # 遍历xml文件

# actual parsing

in_file = open(file, encoding='utf-8')

tree = ET.parse(in_file)

root = tree.getroot()

# 遍历文件的所有标签

for obj in root.iter('object'):

name = obj.find('name').text

if (name in dict.keys()):

dict[name] += 1 # 如果标签不是第一次出现,则+1

else:

dict[name] = 1 # 如果标签是第一次出现,则将该标签名对应的value初始化为1

# 打印结果

print("各类标签的数量分别为:")

for key in dict.keys():

print(key + ': ' + str(dict[key]))

label_list.append(key)

print("标签类别如下:")

print(label_list)

if __name__ == '__main__':

# xml文件所在的目录,修改此处

indir = 'data/Annotations'

count_num(indir) # 调用函数统计各类标签数目

至此数据集的准备已经就绪,索引文件在data目录下的train.txt/val.txt/test.txt

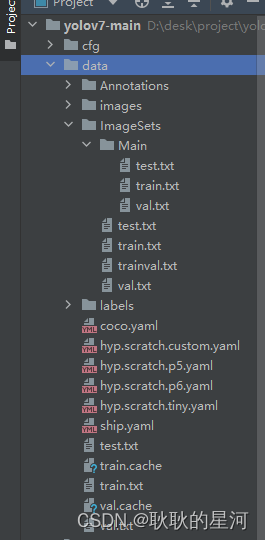

5. 完整的数据集文件

images目录下存放数据集的图片文件

Annotations目录下存放图片的xml文件(labelImg标注)

label:txt文件

xx.cache不用在意有没有

三:参数修改

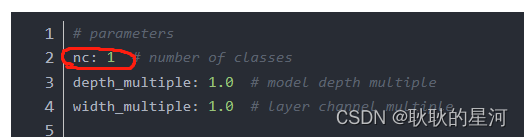

1. 修改模型配置文件

进入cfg/training文件夹,选择需要训练的模型配置文件,这里选择yolov7.yaml,将其中的nc修改为自己的类别数量,这里修改为1(根据自己的类别自定义)

2. 修改数据加载配置文件

在data/文件夹,新建ship.yaml(根据自己的类被自定义)内容如下:

train: ./data/train.txt

val: ./data/val.txt

test: ./data/test.txt

# number of classes

nc: 1

# class names

names: ['ship']

至此,配置文件修改完成

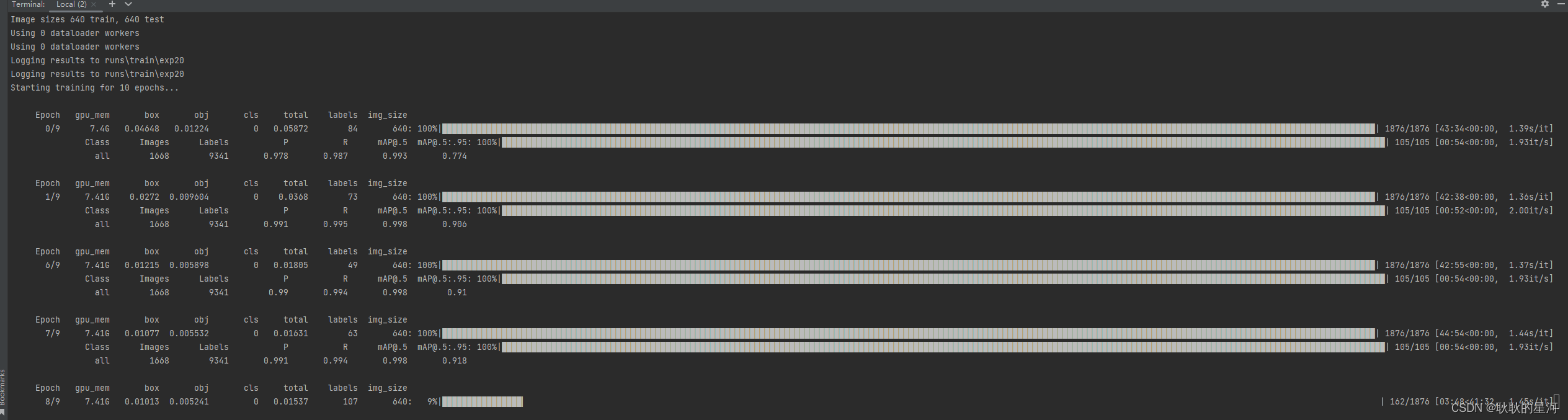

四:模型训练

yolov7仓库中有两个训练脚本,一个叫train.py,一个叫train_aux.py,前者是训练P5的模型,包含yolov7-tiny、yolov7-tiny-silu、yolov7、yolov7x,后者是训练P6的模型,包含yolov7-w6、yolov7-e6、yolov7-d6、yolov7-e6e。

yolov7.yaml 是在3.1修改的

ship.yaml是在3.2新建的

epochs 不用设置那么高 我对自己的数据集就设置了10轮

# 训练P5模型

python train.py --weights yolov7.pt --data data/ship.yaml --epochs 300 --batch-size 8 --cfg cfg/training/yolov7.yaml --workers 0 --device 0 --img-size 640 640

# 训练P6模型

python train_aux.py --weights yolov7-e6e.pt --data data/fall.yaml --epochs 300 --batch-size 8 --cfg cfg/training/yolov7-e6e.yaml --workers 0 --device 0 --img-size 1280 1280

其中,weights是指预训练模型权重,可以去yolov7官方链接下载,指定到相应目录下(推荐),如果没有配置网络可能会存在git不了权重文件

epochs:指的就是训练过程中整个数据集将被迭代多少次,显卡不行你就调小点。

batch-size:一次看完多少张图片才进行权重更新,梯度下降的mini-batch,显卡不行你就调小点。

cfg:存储模型结构的配置文件

data:存储训练、测试数据的文件

img-size:输入图片宽高,显卡不行你就调小点。

data是指数据加载文件路径 –epoch是指模型训练轮次 –batch-size是指一批次输入多少数据一起训练,根据自己显卡的显存决定

cfg是指模型加载文件路径,关于–cfg中的training和deploy可以参考这篇文章:training和deploy的区别

workers是指dataloader同时读取多少个进程,如果num_worker设为0,意味着每一轮迭代时,dataloader不再有自主加载数据到RAM这一步骤(因为没有worker了),而是在RA中找batch,找不到时再加载相应的batch。缺点当然是速度慢。设置为0可以避免一些错误发生

device是指选用几号GPU –img-size是指训练集和测试集图像大小,可选640或1280等

rect是指是否采用矩阵推理的方式去训练模型,采用矩阵推理就不要求送入的训练的图片是正方形 –resume断点续训

evolve超参数进化,模型提供的默认参数是通过在COCO数据集上使用超参数进化得来的

linear-lr利用余弦函数对训练中的学习率进行调整

五:模型推理

训练结束后会在run/train中有如下结果:

用自己的模型进行测试

python detect.py --weights best.pt --source frame22.jpg --device 0

六:结果分析

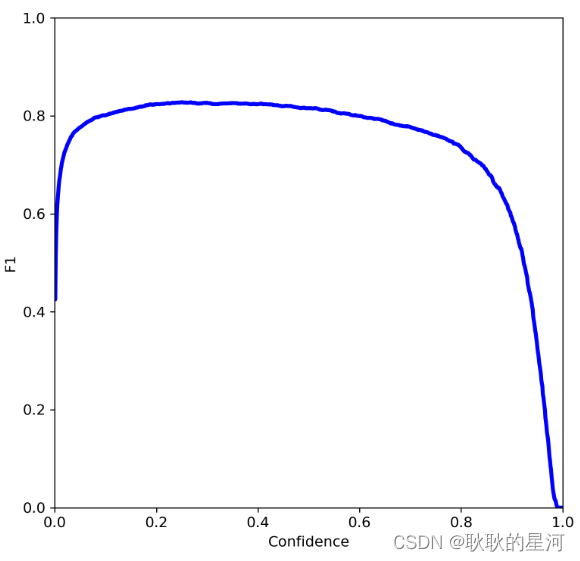

F1_curve.png

F1分数,它被定义为查准率和召回率的调和平均数

一些多分类问题的机器学习竞赛,常常将F1-score作为最终测评的方法。它是精确率和召回率的调和平均数,最大为1,最小为0。

F1-Score的值是从0到1的,1是最好,0是最差。

这是100epoch得到的F1_curve,说明在置信度为0.4-0.6区间内得到比较好的F1分数

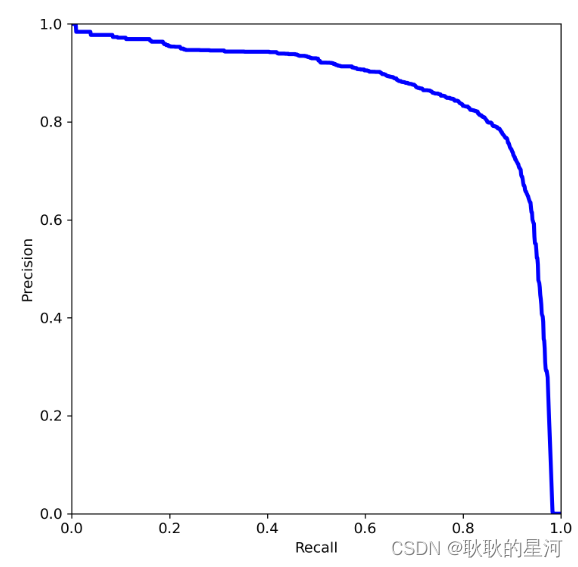

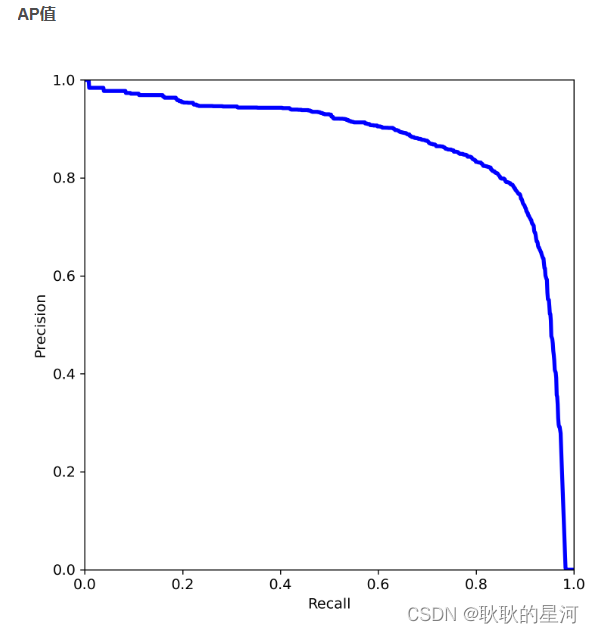

PR_curve.png

PR曲线中的P代表的是precision(精准率),R代表的是recall(召回率),其代表的是精准率与召回率的关系,一般情况下,将recall设置为横坐标,precision设置为纵坐标。PR曲线下围成的面积即AP,所有类别AP平均值即Map.

如果PR图的其中的一个曲线A完全包住另一个学习器的曲线B,则可断言A的性能优于B,当A和B发生交叉时,可以根据曲线下方的面积大小来进行比较。一般训练结果主要观察精度和召回率波动情况(波动不是很大则训练效果较好)

Precision和Recall往往是一对矛盾的性能度量指标;及一个的值越高另一个就低一点;

提高Precision <>提高二分类器预测正例门槛<> 使得二分类器预测的正例尽可能是真实正例;

提高Recall <> 降低二分类器预测正例门槛 < >使得二分类器尽可能将真实的正例挑选

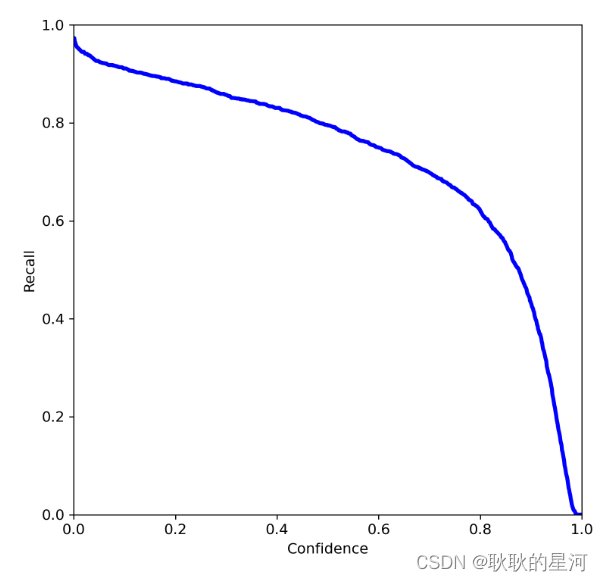

R_curve.png

召回率recall和置信度confidence之间的关系

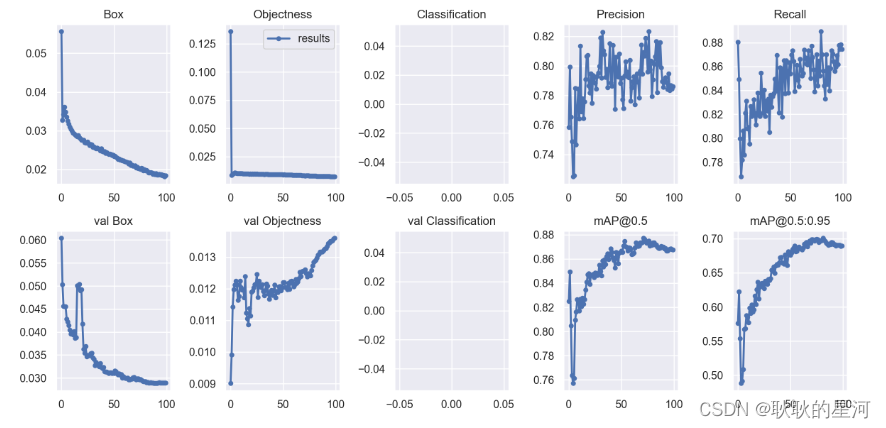

results.png

Box:Box推测为GIoU损失函数均值,越小方框越准;

Objectness:推测为目标检测loss均值,越小目标检测越准;

Classification:推测为分类loss均值,越小分类越准,本实验为一类所以为0;

Precision:精度(找对的正类/所有找到的正类);

Recall:真实为positive的准确率,即正样本有多少被找出来了(召回了多少)。

Recall从真实结果角度出发,描述了测试集中的真实正例有多少被二分类器挑选了出来,即真实的正例有多少被该二分类器召回。

val BOX: 验证集bounding box损失

val Objectness:验证集目标检测loss均值

val classification:验证集分类loss均值,本实验为一类所以为0

mAP是用Precision和Recall作为两轴作图后围成的面积,m表示平均,@后面的数表示判定iou为正负样本的阈值,@0.5:0.95表示阈值取0.5:0.05:0.95后取均值。

[email protected]:.95(mAP@[.5:.95])

表示在不同IoU阈值(从0.5到0.95,步长0.05)(0.5、0.55、0.6、0.65、0.7、0.75、0.8、0.85、0.9、0.95)上的平均mAP。

[email protected]:表示阈值大于0.5的平均mAP

一般训练结果主要观察精度和召回率波动情况(波动不是很大则训练效果较好)

然后观察mAP@0.5 & mAP@0.5:0.95 评价训练结果。

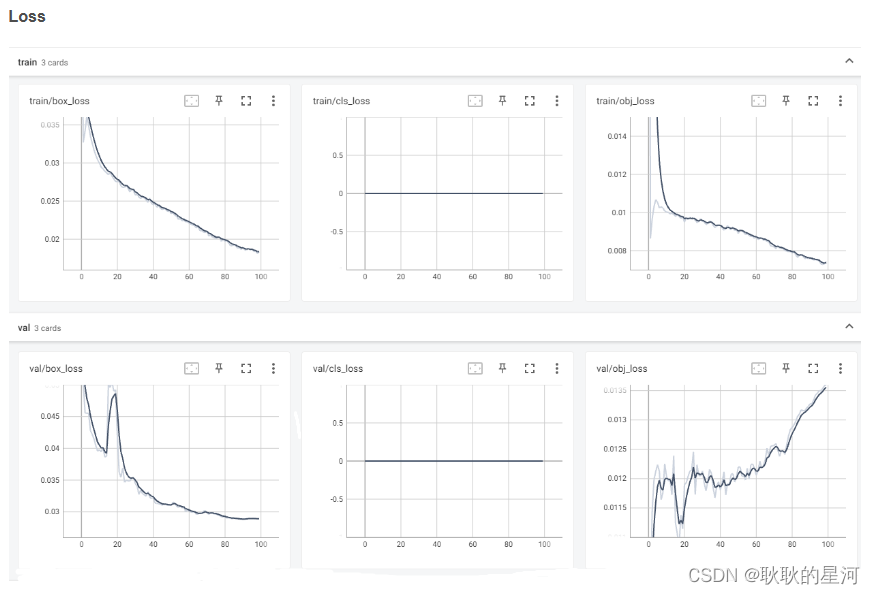

tensorboard

tensorboard是可实时观看自己训练数据集效果的可视化工具。

activate yolov7(自己所配的环境名称)

tensorboard --logdir=训练结果所在的文件夹

LOSS

AP值

版权归原作者 耿耿的星河 所有, 如有侵权,请联系我们删除。