【CVPR 2023的AIGC应用汇总(1)】图像转换/翻译,基于GAN生成对抗/diffusion扩散模型方法

【CVPR 2023的AIGC应用汇总(2)】可控文生图,基于diffusion扩散模型/GAN生成对抗方法

【CVPR 2023的AIGC应用汇总(3)】GAN改进/可控生成的方法10篇

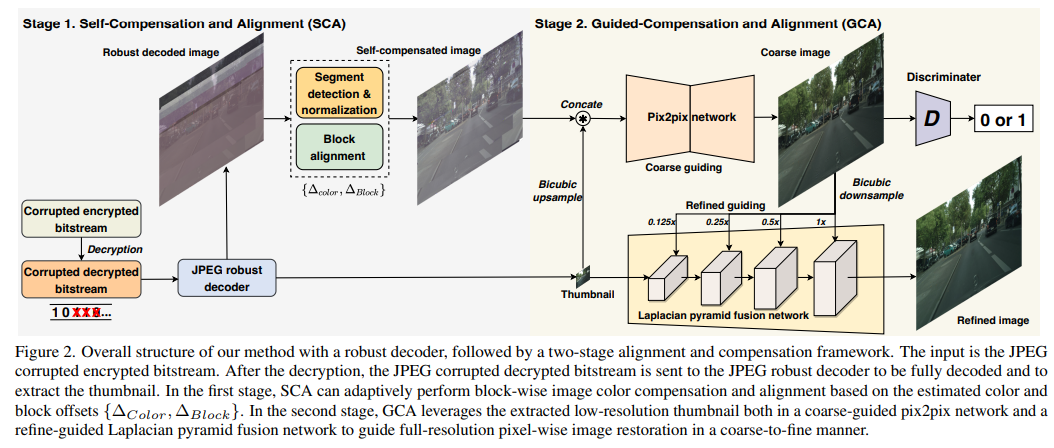

1、Bitstream-Corrupted JPEG Images are Restorable: Two-stage Compensation and Alignment Framework for Image Restoration

本文研究JPEG图像恢复问题,即加密比特流中的比特错误。比特错误会导致解码后的图像内容出现不可预测的色偏和块位移,这些问题无法通过现有的主要依赖于像素域中预定义退化模型的图像恢复方法来解决。为了解决这些挑战,提出了一个强健的JPEG解码器,并采用两阶段补偿和对齐框架来恢复受比特流损坏的JPEG图像。

具体而言,JPEG解码器采用了一种具有容错机制的方法来解码受损的JPEG比特流。两阶段框架由自补偿和对齐(SCA)阶段和引导补偿和对齐(GCA)阶段组成。SCA阶段基于图像内容相似性和估计的颜色和块偏移量,自适应地对图像颜色进行块状补偿和对齐。GCA阶段利用从JPEG头中提取的低分辨率缩略图来指导全分辨率像素级图像恢复,通过粗到细的方式实现。它由一个粗略引导的pix2pix网络和一个细化引导的双向拉普拉斯金字塔融合网络实现。

在三个不同比特错误率的基准测试上进行了实验。实验结果和消融研究表明了我们所提出的方法的优越性。代码在 https://github.com/wenyang001/Two-ACIR

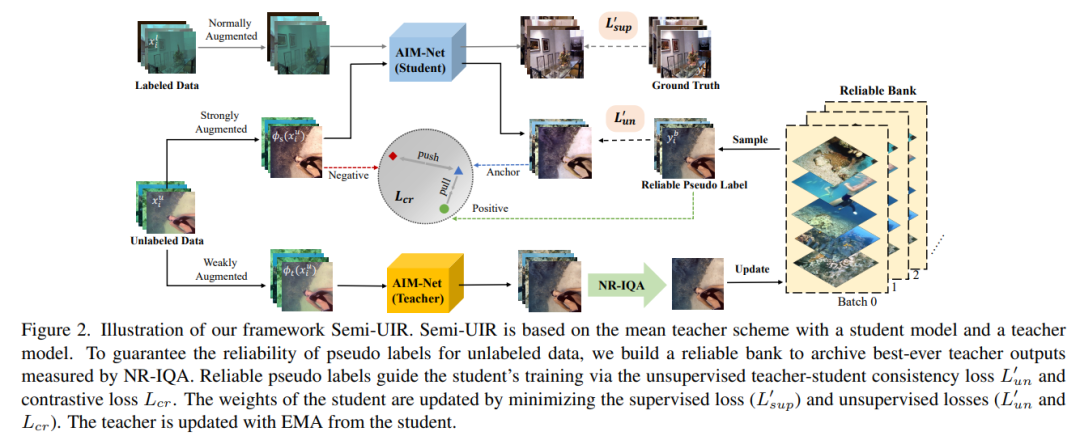

2、Contrastive Semi-supervised Learning for Underwater Image Restoration via Reliable Bank

尽管最近的水下图像恢复技术取得了显著成就,但标注数据的缺乏已成为进一步进展的主要障碍。本研究提出了一种基于mean-teacher的半监督水下图像恢复(Semi-UIR)框架,将未标记的数据纳入网络训练。然而,朴素的mean-teacher方法存在两个主要问题:(1)训练中使用的一致性损失可能在教师的预测错误时变得无效。(2)使用L1距离可能会导致网络过度拟合错误的标签,导致确认偏差。

为了解决上述问题,首先引入一个可靠的bank来存储“最佳”的输出作为伪基础事实。为了评估输出的质量,基于单调性属性进行实证分析,选择最可信的NR-IQA方法。此外,针对确认偏差问题,还引入对比正则化以防止对错误标签的过拟合。在全参考和非参考水下基准测试上的实验结果表明,算法在定量和定性上都比SOTA方法有明显的改进。

代码在https://github.com/Huang-ShiRui/Semi-UIR

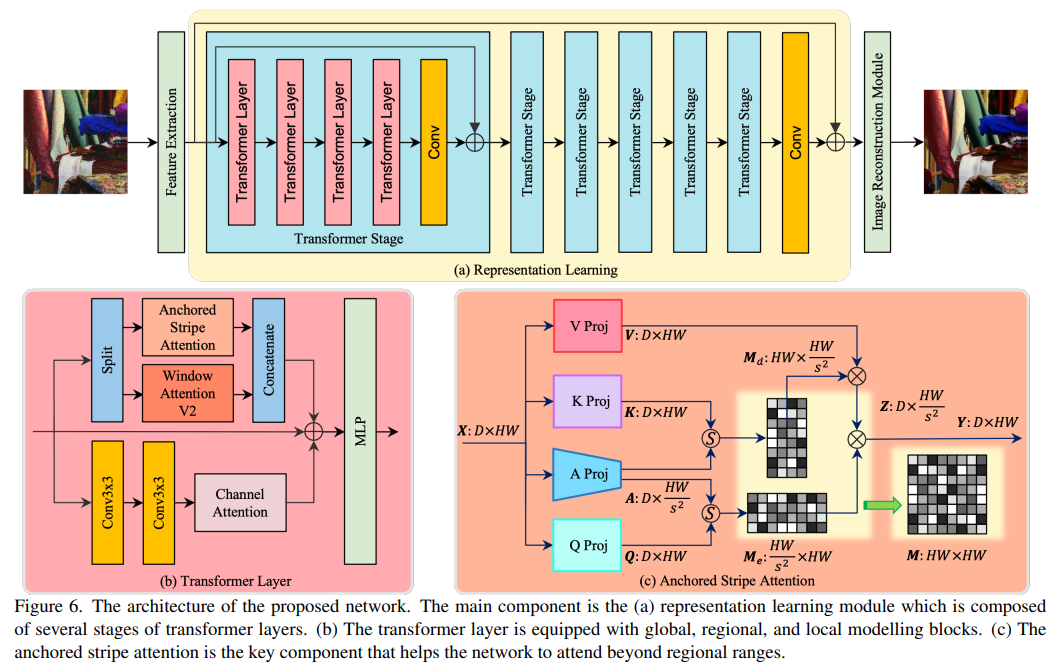

3、Efficient and Explicit Modelling of Image Hierarchies for Image Restoration

本文的目的是提出一种机制,以有效地和明确地建模图像恢复的全局、区域和局部层次结构。

为了实现这一目标,首先分析了自然图像的两个重要属性,包括跨尺度相似性和各向异性图像特征。在此启发下,提出了锚定条纹自注意力机制,它在自注意力的空间和时间复杂度和区域范围之外的建模能力之间取得了良好的平衡。

然后,提出了一种名为GRL的新网络结构,通过锚定条纹自注意力、窗口自注意力和通道注意力增强卷积,明确地建模图像的全局、区域和局部层次结构。

最后,将所提出的网络应用于7种图像恢复类型,包括真实和合成设置。所提出的方法为其中的几种设定设立了新的技术标准。

代码在https://github.com/ofsoundof/GRL-ImageRestoration.git

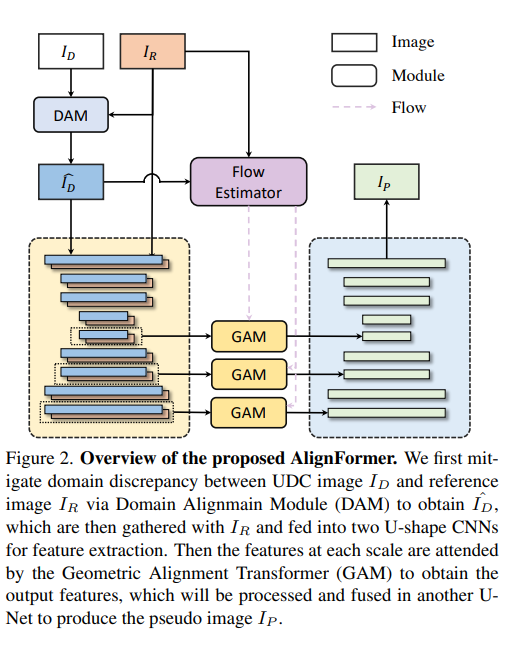

4、Generating Aligned Pseudo-Supervision from Non-Aligned Data forImage Restoration in Under-Display Camera

Under-Display Camera (UDC)图像修复任务,由于收集大规模且完全对齐的配对训练数据的困难,之前的方法采用基于监视器的图像系统或基于模拟的方法,牺牲了数据的真实性并引入了域差异。

本文重新考虑了经典的立体设置用于训练数据的收集——使用一个UDC和一个标准相机捕获同一场景的两个图像。关键思想是从高质量的参考图像中“复制”细节并将其“粘贴”到UDC图像中。虽然能够生成真实的训练配对,但由于透视和景深的变化,该设置容易出现空间不对齐的问题。该问题进一步加剧了UDC和正常图像之间的大域差异,这是UDC修复所特有的。

本文通过一种基于Transformer的框架,通过两个精心设计的组件,即域对齐模块(DAM)和几何对齐模块(GAM),来缓解非常规域差异和空间不对齐的问题,这有助于鼓励鲁棒和准确地发现UDC和正常视图之间的对应关系,并生成对应UDC输入的高质量、对齐的目标数据。实验表明,高质量和对齐的伪UDC训练配对有助于训练鲁棒的修复网络。

代码和数据集在https://github.com/jnjaby/AlignFormer

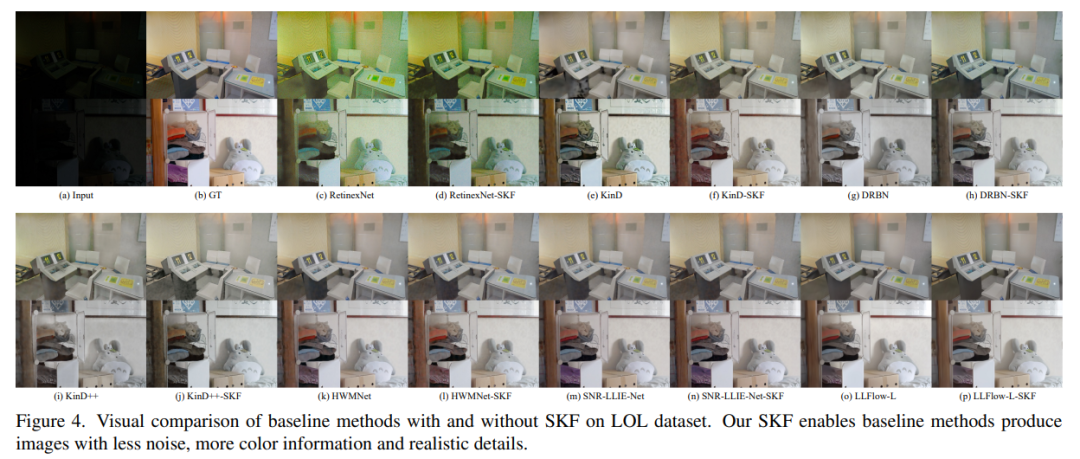

5、 Learning Semantic-Aware Knowledge Guidance for Low-Light Image Enhancement

低光图像增强(Low-light image enhancement ,LLIE)研究如何改善照明并产生正常光照的图像。现有的大多数方法通过全局和均匀的方式改善低光图像,而不考虑不同区域的语义信息。没有语义先验,网络可能会轻易偏离区域的原始颜色。

为了解决这个问题,提出了一个新的语义感知知识引导框架(semantic-aware knowledge-guided framework ,SKF),可以帮助低光增强模型学习包含在语义分割模型中的丰富多样的先验知识。专注于从三个关键方面融合语义知识:一个智能地在特征表示空间中集成语义先验的语义感知嵌入模块,一个保留各种实例颜色一致性的语义引导颜色直方图损失,以及语义引导的对抗性损失可通过语义先验产生更自然的纹理。

实验表明,配备 SKF 的模型在多个数据集上的表现明显优于基线,SKF可以很好地泛化到不同的模型和场景。代码在 https://github.com/langmanbusi/Semantic-Aware-Low-Light-Image-Enhancement

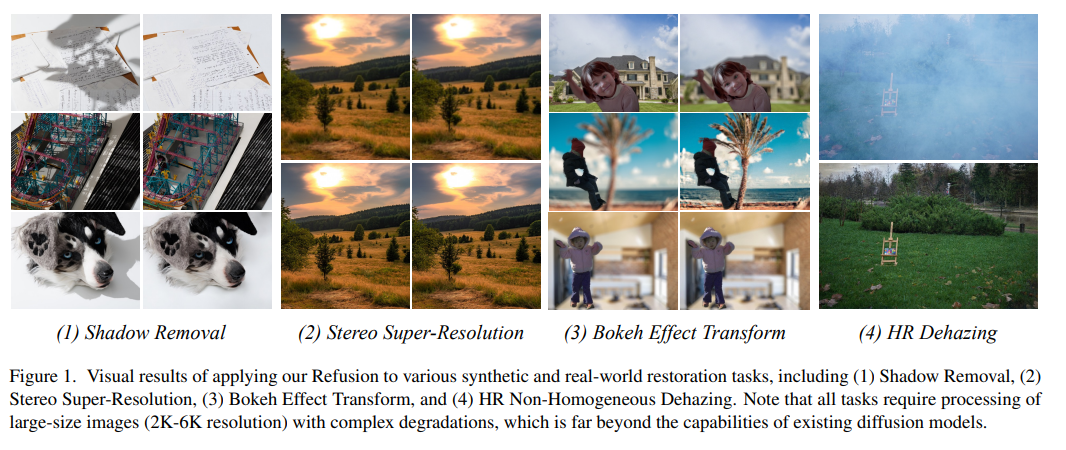

6、Refusion: Enabling Large-Size Realistic Image Restoration with Latent-Space Diffusion Model

本研究旨在提高扩散模型在实际图像恢复中的适用性。具体而言,从网络结构、噪声水平、去噪步骤、训练图像大小和优化器/调度器等多个方面增强了扩散模型。

调整这些超参数可以在失真和感知得分上实现更好的性能。还提出了一种基于U-Net的潜在扩散模型,它在低分辨率潜在空间中执行扩散,同时保留来自原始输入的高分辨率信息用于解码过程。与先前训练VAE-GAN来压缩图像的潜在扩散模型相比,提出的U-Net压缩策略更加稳定,并且可以在不依赖对抗性优化的情况下恢复高度精确的图像。

重要的是,这些修改能够将扩散模型应用于各种图像恢复任务,包括现实世界的阴影去除、高分辨率非均匀去雾、立体超分辨率和浅景深效果转换。通过简单地更换数据集并稍微更改噪声网络,模型Refusion能够处理大尺寸图像(例如HR去雾中的6000×4000×3)并在所有以上恢复问题上产生良好的结果。Refusion在NTIRE 2023图像阴影去除挑战赛中实现了最佳的感知性能,并获得了总体第二名。

https://github.com/Algolzw/image-restoration-sde

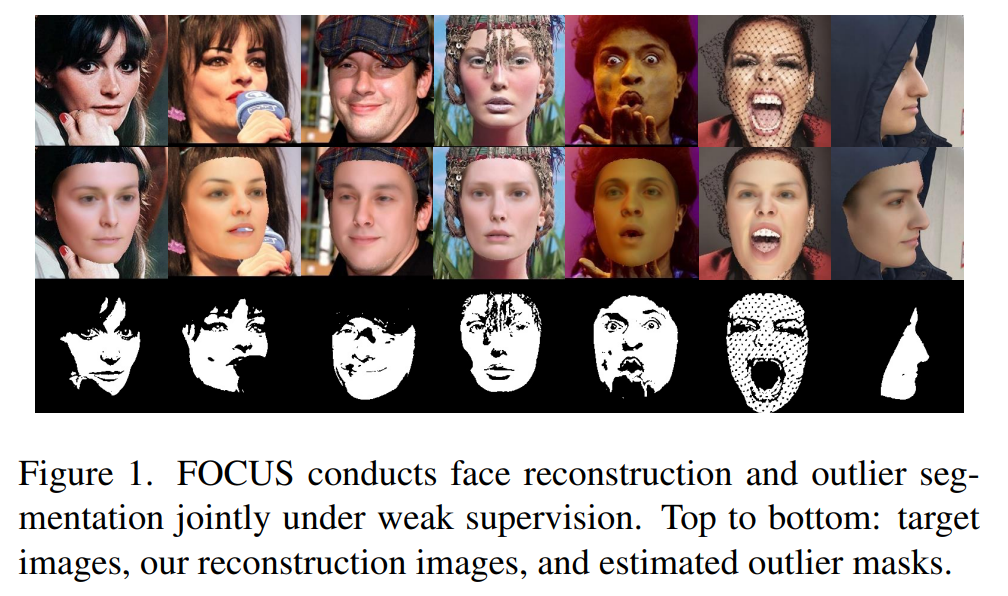

7、Robust Model-based Face Reconstruction through Weakly-Supervised Outlier Segmentation

通过避免将模型拟合到异常值(如遮挡物或化妆品这种无法很好地被模型表达的区域),提高基于模型的人脸重建的质量。局部异常值的核心挑战在于,它们高度变化且难以标注。

为了克服这个困难,引入了一种联合人脸自编码器和异常值分割方法(FOCUS)。具体而言,利用异常值不能很好地适配人脸模型这一事实,因此在给定高质量的模型拟合的情况下可以很好地定位异常值。主要的挑战在于模型拟合和异常值分割相互依赖,需要一起推断。通过EM类型的训练策略,其中人脸自编码器与异常值分割网络一起进行训练。这产生了一种协同作用,即分割网络防止人脸编码器拟合异常值,提高了重建质量。改进的3D人脸重建,反过来又使分割网络更好地预测异常值。

为了解决异常值和难以拟合的区域之间的模糊性,如眉毛,从合成数据中建立一个统计先验,以测量模型拟合中的系统偏差。在NoW测试集上的实验表明,FOCUS在没有3D注释的所有基线中实现了SOTA的3D人脸重建性能。此外,在CelebA-HQ和AR数据库上的结果表明,分割网络可以准确地定位遮挡物,尽管没有任何分割标签。

https://github.com/unibas-gravis/Occlusion-Robust-MoFA

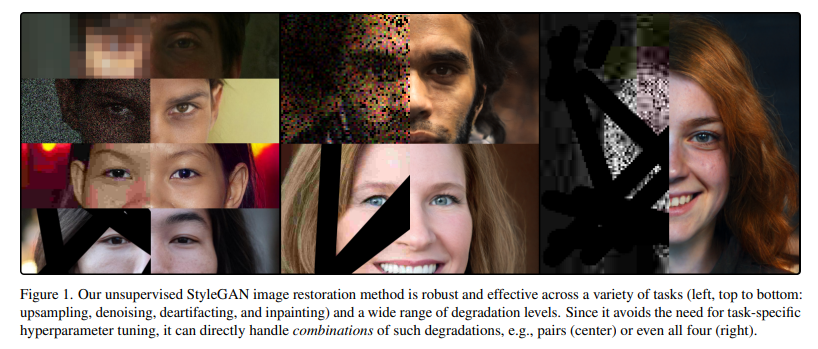

8、Robust Unsupervised StyleGAN Image Restoration

基于 GAN 的图像恢复,修复因已知退化而损坏的图像。现有的无监督方法必须针对每个任务和退化级别仔细调整。在这项工作中,使 StyleGAN 图像恢复具有鲁棒性:一组超参数适用于各种退化水平。这使得处理多种降级的组合成为可能,而无需重新调整。

提出的方法依赖于三阶段渐进潜在空间扩展和优化器,这避免了对任何额外正则化项的需要。大量实验证明了在不同退化水平下修复、上采样、去噪和去伪像的稳健性,优于其他基于 StyleGAN 的技术。

猜您喜欢:

深入浅出stable diffusion:AI作画技术背后的潜在扩散模型论文解读**

**

**深入浅出ControlNet,一种可控生成的AIGC绘画生成算法!

**

**经典GAN不得不读:StyleGAN

**

戳我,查看GAN的系列专辑~!

戳我,查看GAN的系列专辑~!

一顿午饭外卖,成为CV视觉的前沿弄潮儿!**

**

最新最全100篇汇总!生成扩散模型Diffusion Models

**ECCV2022 | 生成对抗网络GAN部分论文汇总

**

**CVPR 2022 | 25+方向、最新50篇GAN论文

**

** ICCV 2021 | 35个主题GAN论文汇总

**

超110篇!CVPR 2021最全GAN论文梳理**

**

超100篇!CVPR 2020最全GAN论文梳理

拆解组新的GAN:解耦表征MixNMatch

StarGAN第2版:多域多样性图像生成

附下载 | 《可解释的机器学习》中文版

附下载 |《TensorFlow 2.0 深度学习算法实战》

附下载 |《计算机视觉中的数学方法》分享

《基于深度学习的表面缺陷检测方法综述》

《零样本图像分类综述: 十年进展》

《基于深度神经网络的少样本学习综述》

《礼记·学记》有云:独学而无友,则孤陋而寡闻

点击 一顿午饭外卖,成为CV视觉的前沿弄潮儿!,领取优惠券,加入 AI生成创作与计算机视觉 知识星球!

版权归原作者 机器学习与AI生成创作 所有, 如有侵权,请联系我们删除。