今天分享的是AI大模型系列深度研究报告:《AI大模型专题:大模型安全与伦理研究报告2024》。

(报告出品方:腾讯研究院)

报告共计:76页

大模型具有不同于传统模型的特点和优势

第一,大模型和传统模型在规模上存在差异。大模型是基于深度学习的方法,具有更多的参数和更复杂的模型结构,往往具有数十亿百亿干亿以上个参数。这样大的参数量使得大模型能够更好地捕捉数掘中的复杂模式和特征,通过多层次的神经元连接和权重调整,能够学习到更丰富的语义和特征表示,从而提升了模型的表现能力。

第二,大模型和传统模型在训练数据上存在差异。大模型能够更好地捕提数据中的统计规律和模式,提高模型的泛化能力和预测准确性。然而,海量训练数据中也可能包含着一些敏感数掘和个人信息,这使得数据泄露和隐私侵犯的风险不可忽视。一旦这些敏感信息遭受泄露,个人隐私权益可能会遭受严重损害,甚至被用于恶意行为,这些恶性事件的发生不仅会给受害者带来经济损失,还可能引发社会的恐慌和对大模型的信任危机。

第三,大模型和传统模型在计算资源上存在差异。由于大模型具有更多的参数和更复杂的模型结构,因此需要更多的计算资源进行训练和推理。传统模型通常可以在较低的计算资源下进行训练和推理,而大模型则需要更强大的计算设备和算力支持。因此,大模型的发展进步与深学习和硬件计算能力的提升密不可分,硬件计算能力的提升也为大模型的训练和推理提供了强大的计算支持。

第四,大模型和传统模型在任务表现上存在差异。由于大模型具有更强大的表达能力和更多的参数,因此在许多任务上展现出更好的性能。而传统模型通常只能在一些简单的任务上表现良好,但在复杂的任务上往往无法达到大型模型的水平。而大模型的强大能力也是一把双刃剑它也可能被用于进行各种形式的恶意攻击。恶意使用者制造的虚假信息,借用大模型的能力可能放大危害结果,例如在社交媒体平台上传播误导性信息,从而扰乱社会秩序。此外,大那模型的使用往往涉及到社会伦理和法律问题。例如,算法的歧视性问,即模型在处理数据时产生的不公平或偏见,可能引发社会的不满和争议。

第五,大模型和传统模型在可解释性上存在差异。传统模型通常具有较好的可解释性,可以清晰地解释模型的决策过程和特征权重。而大模型由于参数数量庞大和模型结构复杂,往往难以直观地解释其决策过程。此外,大模型本身也很容易成为攻击者的目标。模型参数和权重的泄可能导致知识产权的损失,甚至使恶意使用者能够复制或修改模型,进一步加剧风险。对模型的针对性攻击,如投毒攻击,可能会导致模型输出产生不良影响,从面影响到正常的业务运营。

综上所述,建立可靠的大型模型安全风险控制体系势在必行。本白皮书旨在全面探讨大模型安全与伦理问题,并为各界提供指导,以确保大型模型在广泛应用中的安全性和可信度。通过深入分析大型模型领域的安全挑战,我们可以制定切实可行的措施,确保大型模型在为人类创造价值的同时,也能够保障个人隐私、社会稳定和信息安全。

范式和模型结构的改变

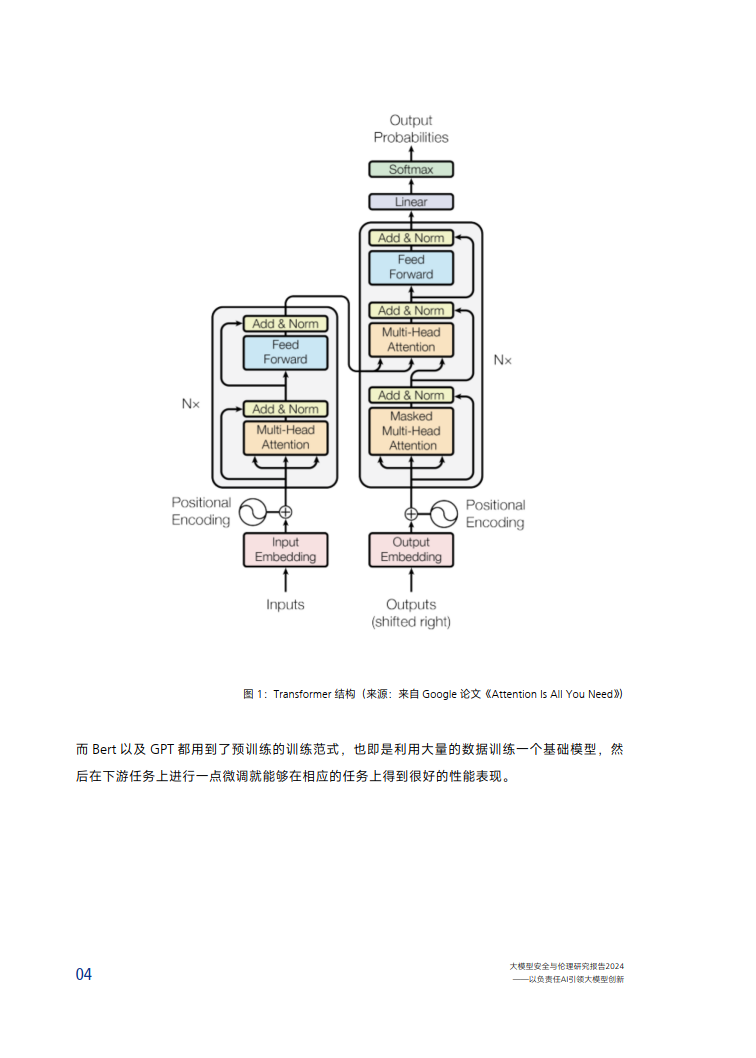

早期的神经网络因为结构简单,针对不同的任务分化出了不同的应用方向,例如计算机视觉自然语言处理,语音等等。但是在2017年,随着 Google 团队的Transformer 架构出现,这一模型在自然语言处理的问题当中取得了惊人的成功,该模型架构仅有 Attention 机制组成能够实现自然语言文本的翻译。

大模型的萌芽最早诞生于自然语言处理领域,Transformer取代了 ResNet 等模型架构成为了研究的主流,谷歌和微软分别针对 Transformer 的编码部分以及解码部分进行研究从而产生了两条技术路线,即以 Bert为代表的仅用编码器部分的路线和以 GPT 为代表的仅用解码器部分的路线。

而 Bert 以及 GPT 都用到了预训练的训练范式,也即是利用大量的数据训练一个基础模型,然后在下游任务上进行一点微调就能够在相应的任务上得到很好的性能表现。

报告共计:76页

版权归原作者 人工智能学派 所有, 如有侵权,请联系我们删除。