1. 介绍

11 月 21 日,Stability AI 推出了 Stable Video Diffusion,这是 Stability AI 的第一个基于图像模型 Stable Diffusion 的生成式视频基础模型。

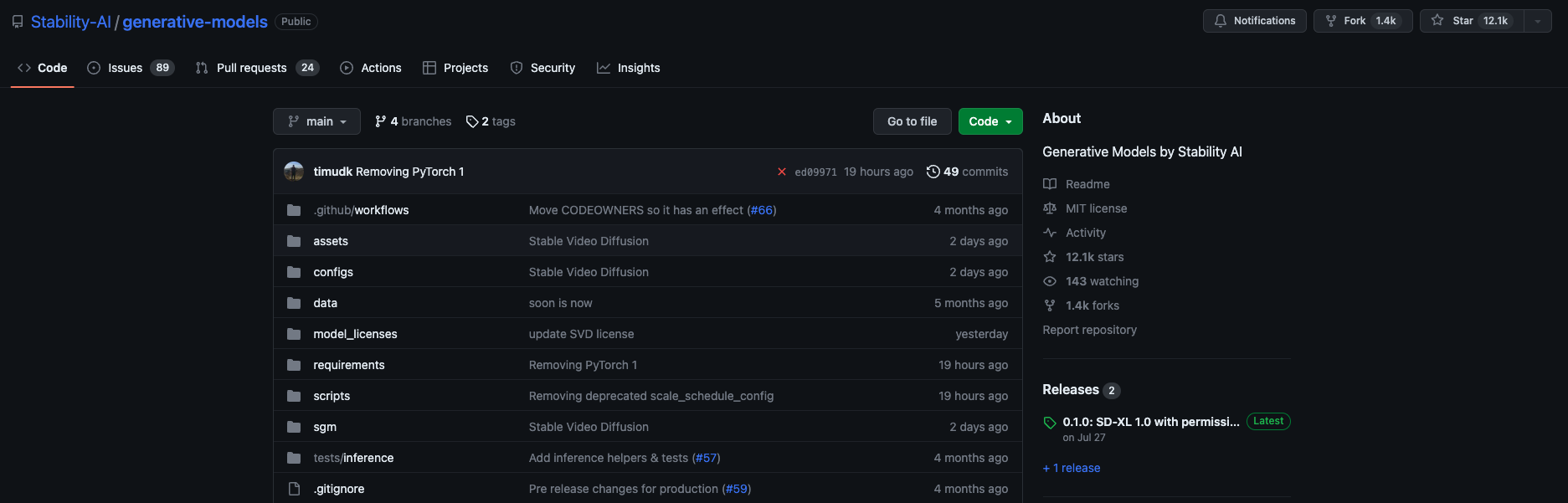

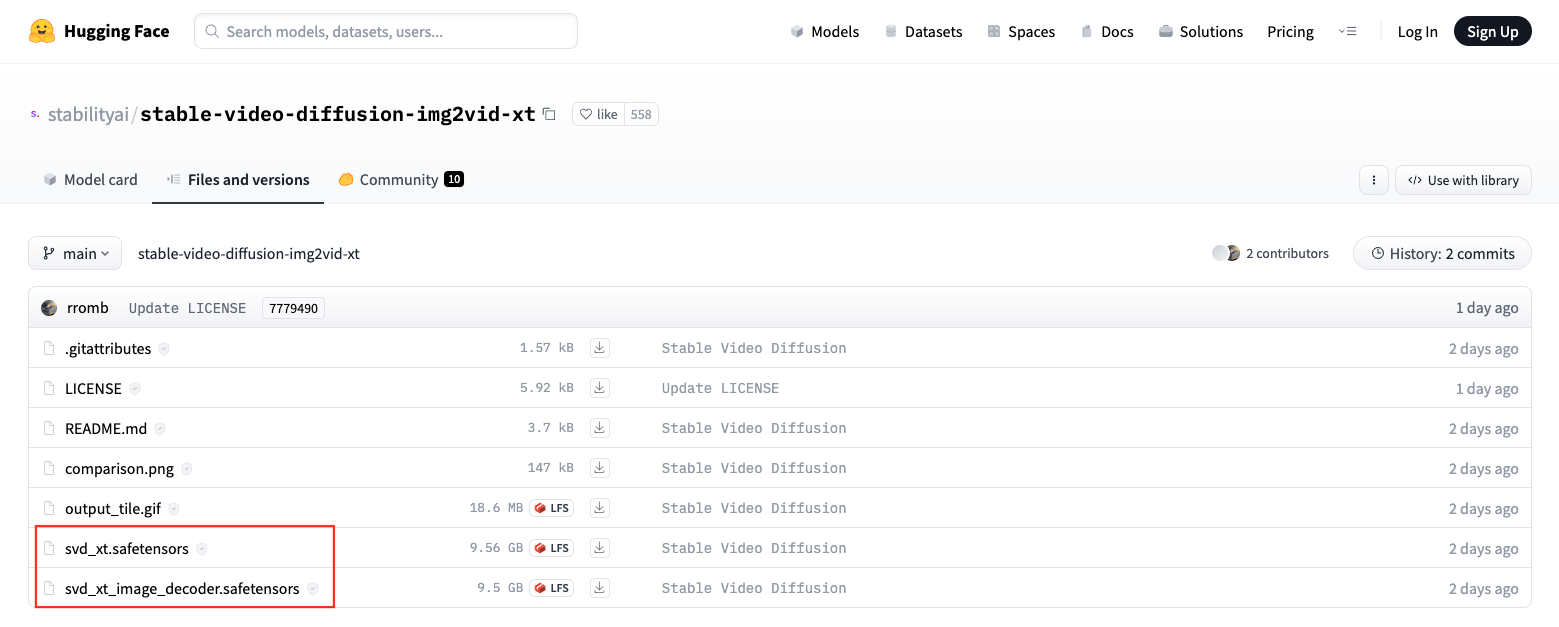

目前 Stability AI 已经在 GitHub 上开源了 Stable Video Diffusion 的代码,在 Hugging Face 上也可以找到模型本地运行所需要的 weights。

「GitHub」

https://github.com/Stability-AI/generative-models

「Hugging Face」

https://huggingface.co/stabilityai/stable-video-diffusion-img2vid-xt

目前该视频模型可以很容易地适配下游各种任务,并计划基于此基础模型建立一系列模型,类似于围绕 stable diffusion 建立一个生态系统。

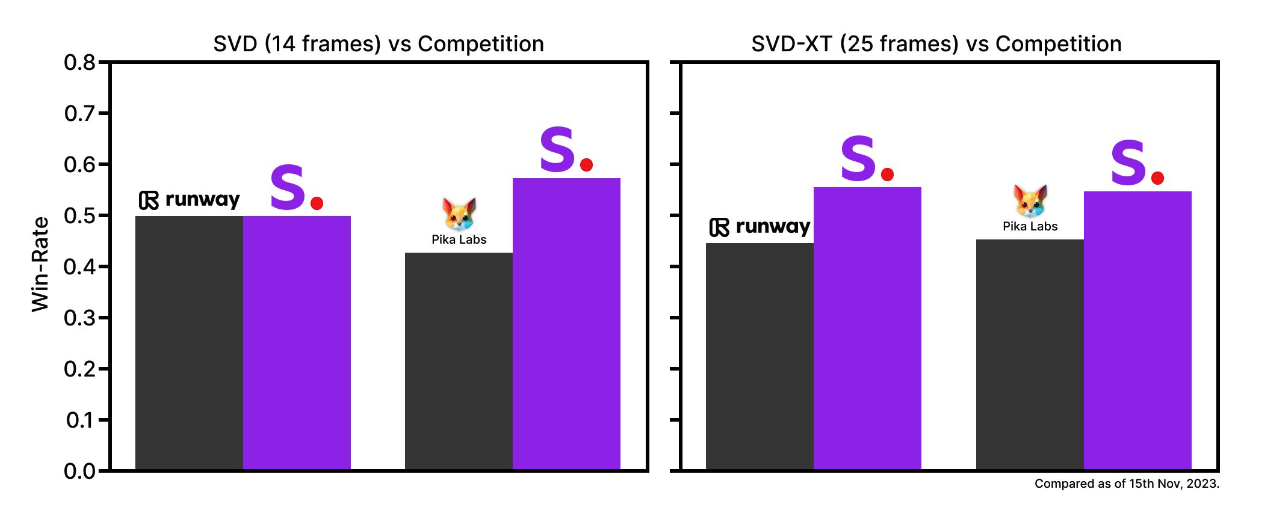

在外部评估中,Stable Video Diffusion 发布的两种图片生视频的模型 SVD 和 SVD-XT,在用户偏好研究中,已经超过了 Runway 和 Pika Labs。

2. 局限性

需要注意的是:

1、Stability AI 强调,此模型现阶段还不适用于实际或者商业应用。

2、网页的体验目前还未向所有人开放,可以在这里申请候补(https://stability.ai/contact)。

另外,stable-video-diffusion-img2vid-xt 还有一些局限性,在 Hugging Face 上也说明了,该模型仅用于研究目的。

局限性:

1、生成的视频相当短(<=4秒),并且该模型无法实现完美的照片级别的视频。

2、当前模型可能会生成没有运动的视频,或非常缓慢的相机平移的视频。

3、无法通过文本控制模型。

4、模型无法呈现清晰的文本。

5、面孔和人物可能无法正确生成。

6、模型的自编码部分是有损耗的。

3. 如何体验

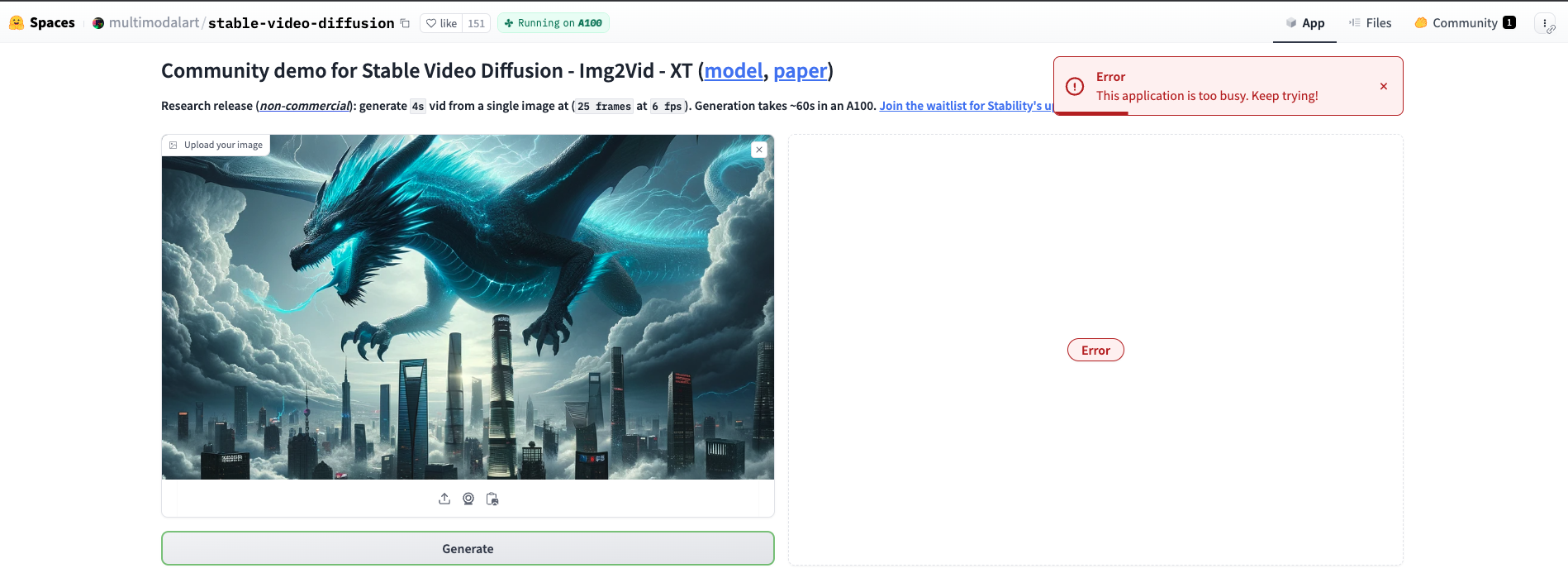

Hugging Face 上的体验地址:https://huggingface.co/spaces/multimodalart/stable-video-diffusion

不过上传图片点生成后,提示「This application is too busy」。

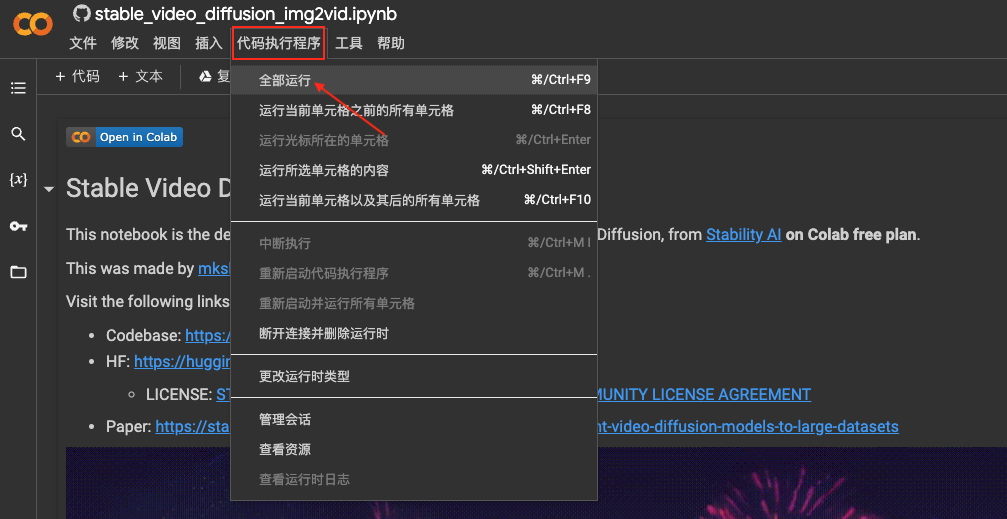

后来看到国外一位开发者 mkshing 的分享:https://colab.research.google.com/github/mkshing/notebooks/blob/main/stable_video_diffusion_img2vid.ipynb

打开链接后,点击「代码执行程序」-「全部运行」就可以了,过程有点慢,感兴趣的小伙伴可以跑一下~

关于 Stable Video Diffusion 更多详细的介绍,可以查看论文:https://stability.ai/research/stable-video-diffusion-scaling-latent-video-diffusion-models-to-large-datasets

4. 参考网址

https://stability.ai/news/stable-video-diffusion-open-ai-video-model

版权归原作者 程序员X小鹿 所有, 如有侵权,请联系我们删除。