这个activation.py文件,这个文件是Yolov5 中使用的全部激活函数,不同版本可能里面的函数命名方式不一样,但是实现原理是一样的。

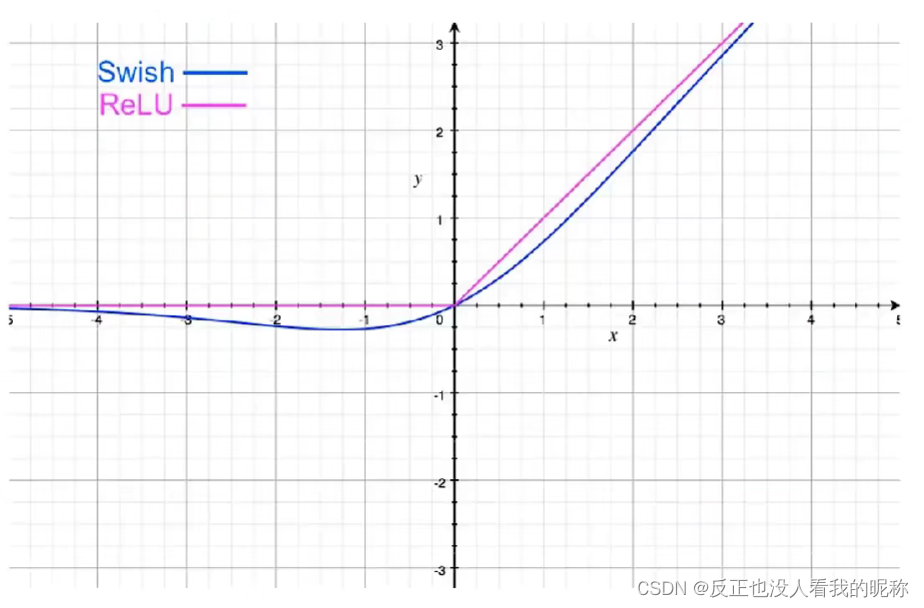

Swish函数

表达式

函数图像

源码

class SiLU(nn.Module): # export-friendly version of nn.SiLU()

@staticmethod

def forward(x):

return x * torch.sigmoid(x) # Swish函数 f(x) = x * sigmoid(x)

class Hardswish(nn.Module): # export-friendly version of nn.Hardswish()

@staticmethod

def forward(x):

# return x * F.hardsigmoid(x) # for torchscript and CoreML

return x * F.hardtanh(x + 3, 0., 6.) / 6. # for torchscript, CoreML and ONNX

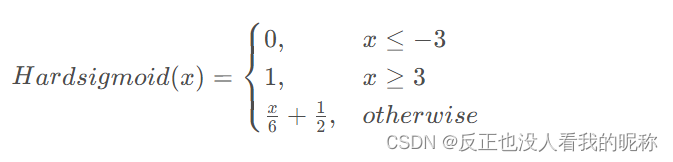

在源码中我们能看到除了原本的swish函数之外,还有一个Hardswish函数,这个原因是由于原本的swish函数要用到sigmoid函数,sigmoid函数是由指数构成的,在移动设备上的计算成本要高得多。Sigmoid激活函数可以用分段线性函数HardSigmoid拟合,已节约设备性能。

该函数采用分段函数的方式去拟合sigmoid:

但是其实在torch.nn中是有Hardswish这个类的,但是作者还是写了这个表达式,是因为在导出torchscript, CoreML and ONNX模型时,可能不支持,所有作者直接手写了一个。

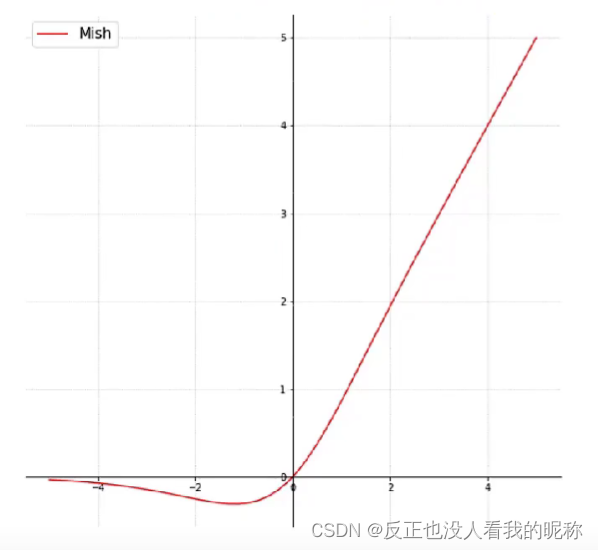

Mish函数

表达式

函数图像

函数图像

可以看出来他在负半轴是没有想Relu函数那样,那样直接截断的,比swish函数在负半轴效果更好一点。

源码

class Mish(nn.Module):

@staticmethod

def forward(x):

return x * F.softplus(x).tanh()

class MemoryEfficientMish(nn.Module):

class F(torch.autograd.Function):

@staticmethod

def forward(ctx, x):

ctx.save_for_backward(x)

return x.mul(torch.tanh(F.softplus(x))) # x * tanh(ln(1 + exp(x)))

@staticmethod

def backward(ctx, grad_output):

x = ctx.saved_tensors[0]

sx = torch.sigmoid(x)

fx = F.softplus(x).tanh()

return grad_output * (fx + x * sx * (1 - fx * fx))

def forward(self, x):

return self.F.apply(x)

看完源码,发现多了一个 MemoryEfficientMish,看名字不难理解是“节省内存的mish函数”

关键的就是这句代码 ** ctx.save_for_backward(x) ** 他通过save_for_backward函数可以将对象保存起来,用于后续的backward函数,然后会保留input的全部信息,并且避免in-place操作,导致的input在backward被修改的情况。

FReLU函数

这个函数是在ECCV2020上面提出了一种用于图像识别任务的简单但有效的激活函数,称为Funnel 激活函数(FReLU),它通过增加可忽略的空间条件开销将ReLU和PReLU扩展为2D激活函数。

这个函数他论文中的这幅图就能理解他的原理

这幅图最左边是Relu:他是x和0求最大值。中间的PRelu:x和pX求最大值。而最右边的FRelu是和一个面求最大值。增强了激活函数中的空间敏感度。增强了鲁棒性。

这个链接说的非常的清楚。

ECCV2020 | FReLU:旷视提出一种新的激活函数,实现像素级空间信息建模_AI算法修炼营的博客-CSDN博客

源码:

class FReLU(nn.Module):

def __init__(self, c1, k=3): # ch_in, kernel

super().__init__()

self.conv = nn.Conv2d(c1, c1, k, 1, 1, groups=c1, bias=False)

self.bn = nn.BatchNorm2d(c1)

def forward(self, x):

return torch.max(x, self.bn(self.conv(x)))

(说句题外话,激活函数这个东西调参的时候全是玄学.......就非得每一个就试一遍,才能知道,哪一个才是最适合数据集的.....有的时候都挺好,有的时候就是不行.....)

版权归原作者 反正也没人看我的昵称 所有, 如有侵权,请联系我们删除。