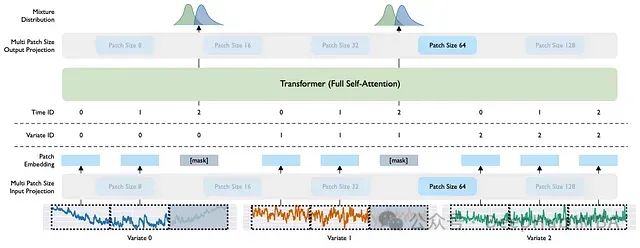

MOIRAI-MOE: 基于混合专家系统的大规模时间序列预测模型

MOIRAI-MOE 采用纯解码器架构,通过混合专家模型实现了频率无关的通用预测能力,同时显著降低了模型参数规模。

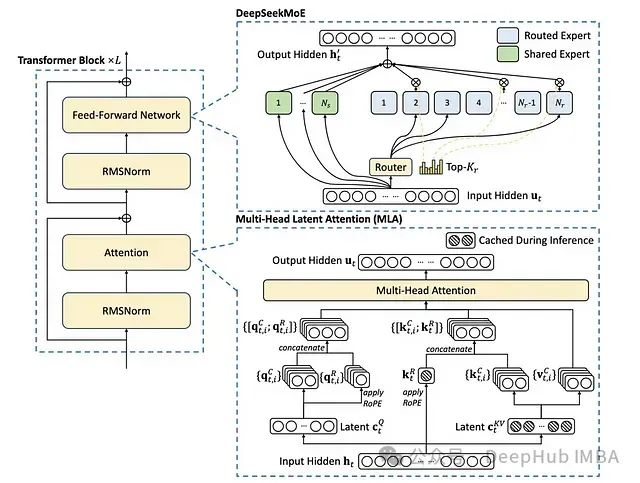

DeepSeek背后的技术基石:DeepSeekMoE基于专家混合系统的大规模语言模型架构

DeepSeekMoE是一种创新的大规模语言模型架构,通过整合专家混合系统(Mixture of Experts, MoE)、改进的注意力机制和优化的归一化策略,在模型效率与计算能力之间实现了新的平衡。