文章目录

0 简介

今天学长向大家分享一个毕业设计项目

毕业设计 深度学习车型检测算法(源码分享)

项目运行效果:

毕业设计 深度学习车型检测算法

项目获取:

https://gitee.com/sinonfin/algorithm-sharing

1 车型数据集及训练

** YOLOv5模型简介**

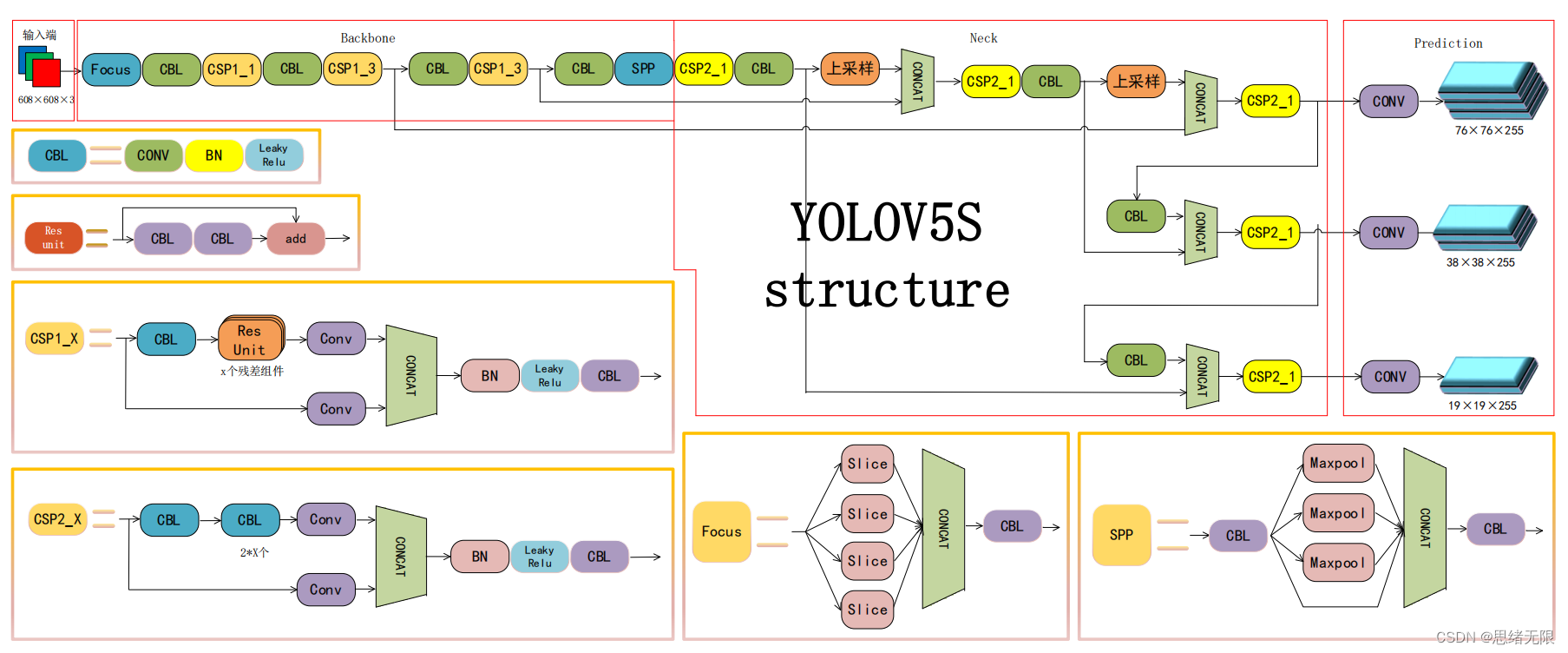

本文借助YOLOv5实现对不同大小车辆的类型进行识别,YOLOv5的调用、训练和预测都十分方便,并且它为不同的设备需求和不同的应用场景提供了大小和参数数量不同的网络。

YOLOv5模型是一个在COCO数据集上预训练的物体检测架构和模型系列,它是YOLO系列的一个延伸,能够很好的用来进行车型的特征提取,其网络结构共分为:input、backbone、neck和head四个模块,yolov5对yolov4网络的优点在于:在input端使用了Mosaic数据增强、自适应锚框计算、自适应图片缩放;

在backbone端使用了Focus结构与CSP结构;在neck端添加了FPN+PAN结构;在head端改进了训练时的损失函数,使用GIOU_Loss,以及预测框筛选的DIOU_nms。除了模型结构,yolov5使用Pytorch框架,对用户非常友好;代码易读;模型训练快速;能够直接对图像,视频进行推理;能直接部署到手机应用端;预测速度非常快。

(1)主干部分:使用了Focus网络结构,具体操作是在一张图片中每隔一个像素拿到一个值,这个时候获得了四个独立的特征层,然后将四个独立的特征层进行堆叠,此时宽高信息就集中到了通道信息,输入通道扩充了四倍。该结构在YoloV5第5版之前有所应用,最新版本中未使用。

(2)数据增强:Mosaic数据增强、Mosaic利用了四张图片进行拼接实现数据中增强,优点是可以丰富检测物体的背景,且在BN计算的时候可以计算四张图片的数据。

(3)多正样本匹配:在之前的Yolo系列里面,在训练时每一个真实框对应一个正样本,即在训练时,每一个真实框仅由一个先验框负责预测。YoloV5中为了加快模型的训练效率,增加了正样本的数量,在训练时,每一个真实框可以由多个先验框负责预测。

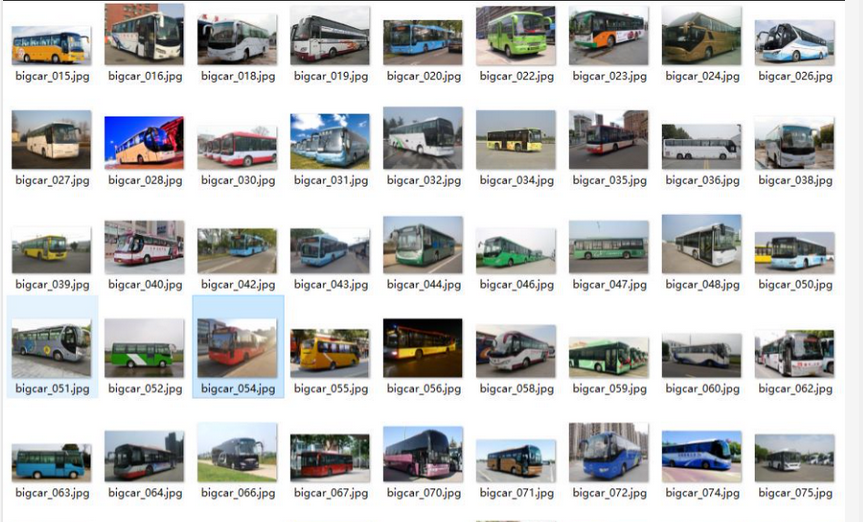

车型识别数据集

这里我们使用的车型数据集,其中训练集包含1488张图片,验证集包含507张图片,测试集包含31张图片,共计2026张图片。部分图片和标注情况如下图所示。

每张图像均提供了图像类标记信息,图像中车型的bounding box,车型的关键part信息,以及车型的属性信息,数据集并解压后得到如下的图片

该数据集分为7类,分别有小型车,中型车,大型车,小型卡车,大型卡车,油罐车,特种车。

Chinese_name = {'tiny-car': "小型车", 'mid-car': "中型车", 'big-car': "大型车", 'small-truck': "小型卡车",

'big-truck': "大型卡车", 'oil-truck': "油罐车", 'special-car': "特种车"}

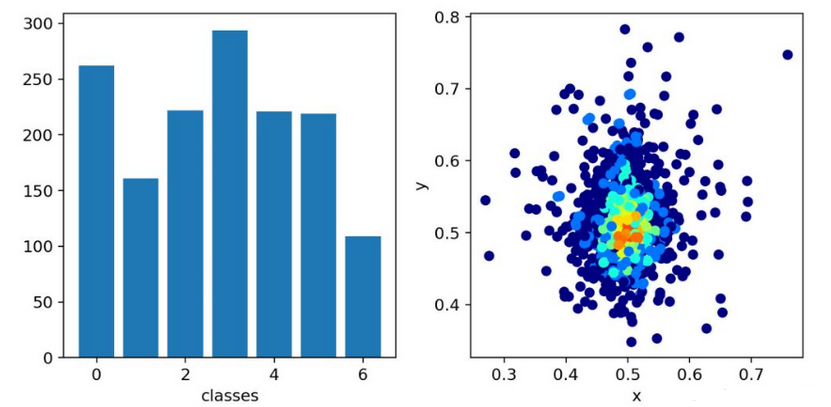

我们分析一下数据集的组成结构,第4类也就是小型卡车的的图片最多,并且x,y坐标主要集中在0.5,0.5的位置。

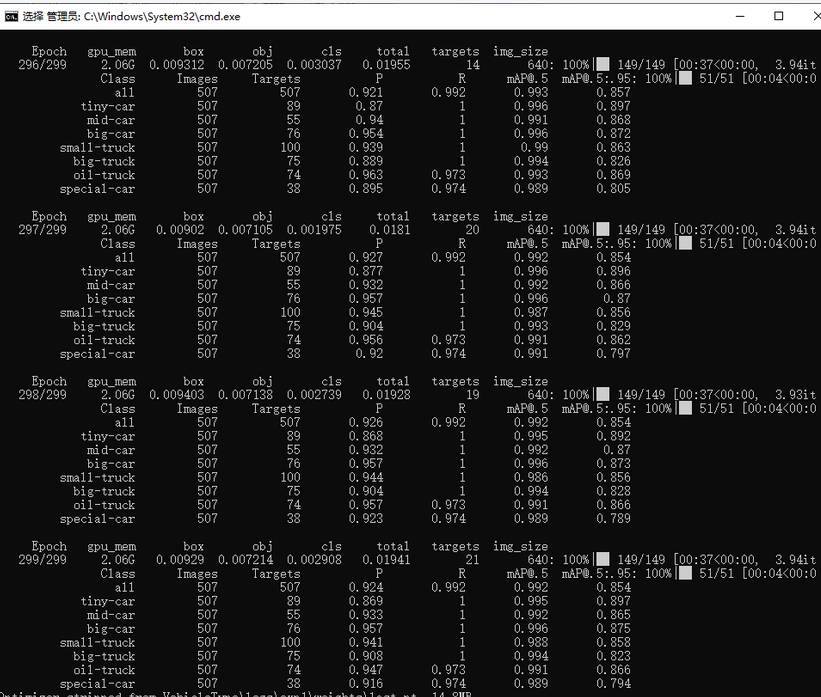

这里我们开始训练和测试自己的数据集,在cmd终端中运行train.py进行训练,以下是训练过程中的结果截图。

在深度学习中,我们通常通过损失函数下降的曲线来观察模型训练的情况。而YOLOv5训练时主要包含三个方面的损失:矩形框损失(box_loss)、置信度损失(obj_loss)和分类损失(cls_loss),在训练结束后,我们也可以在logs目录下找到生成对若干训练过程统计图。下图为博主训练车型类识别的模型训练曲线图。

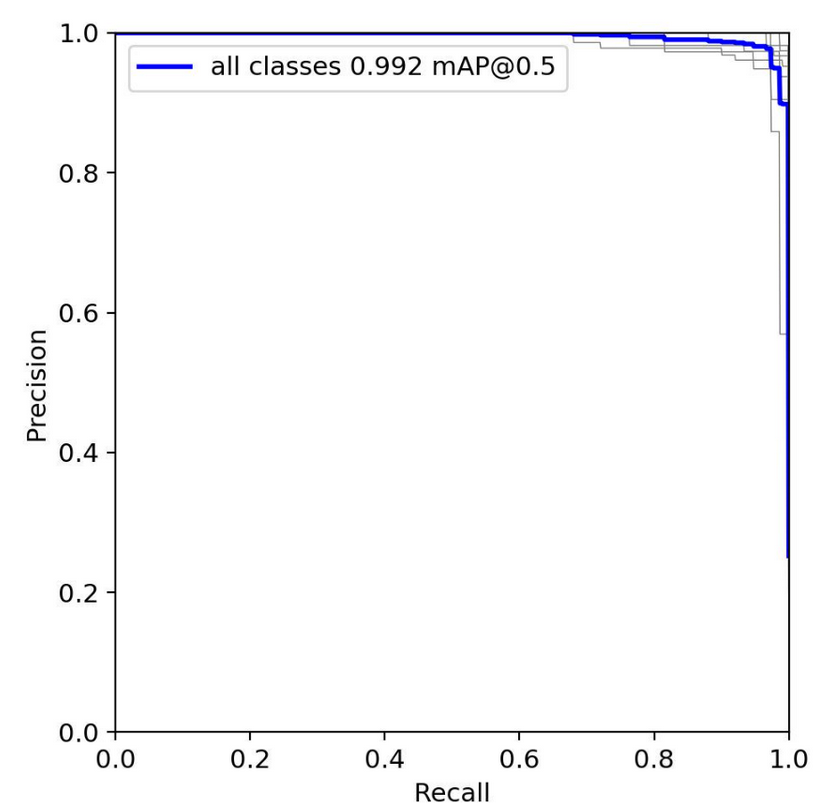

一般我们会接触到两个指标,分别是召回率recall和精度precision,两个指标p和r都是简单地从一个角度来判断模型的好坏,均是介于0到1之间的数值,其中接近于1表示模型的性能越好,接近于0表示模型的性能越差,为了综合评价目标检测的性能,一般采用均值平均密度map来进一步评估模型的好坏。我们通过设定不同的置信度的阈值,可以得到在模型在不同的阈值下所计算出的p值和r值,一般情况下,p值和r值是负相关的,绘制出来可以得到如下图所示的曲线,其中曲线的面积我们称AP,目标检测

以PR-curve为例,你可以看到我们的模型在验证集上的均值平均准确率为0.992。

2 车型检测识别

在训练完成后得到最佳模型,接下来我们将帧图像输入到这个网络进行预测,从而得到预测结果,预测方法(testVideo.py)部分的代码如下所示:

def predict(img):

img = torch.from_numpy(img).to(device)

img = img.half() if half else img.float()

img /= 255.0

if img.ndimension() == 3:

img = img.unsqueeze(0)

t1 = time_synchronized()

pred = model(img, augment=False)[0]

pred = non_max_suppression(pred, opt.conf_thres, opt.iou_thres, classes=opt.classes,

agnostic=opt.agnostic_nms)

t2 = time_synchronized()

InferNms = round((t2 - t1), 2)

return pred, InferNms

def plot_one_box(img, x, color=None, label=None, line_thickness=None):

# Plots one bounding box on image img

tl = line_thickness or round(0.002 * (img.shape[0] + img.shape[1]) / 2) + 1 # line/font thickness

color = color or [random.randint(0, 255) for _ in range(3)]

c1, c2 = (int(x[0]), int(x[1])), (int(x[2]), int(x[3]))

cv2.rectangle(img, c1, c2, color, thickness=tl, lineType=cv2.LINE_AA)

if label:

tf = max(tl - 1, 1) # font thickness

t_size = cv2.getTextSize(label, 0, fontScale=tl / 3, thickness=tf)[0]

c2 = c1[0] + t_size[0], c1[1] - t_size[1] - 3

cv2.rectangle(img, c1, c2, color, -1, cv2.LINE_AA) # filled

cv2.putText(img, label, (c1[0], c1[1] - 2), 0, tl / 3, [225, 255, 255], thickness=tf, lineType=cv2.LINE_AA)

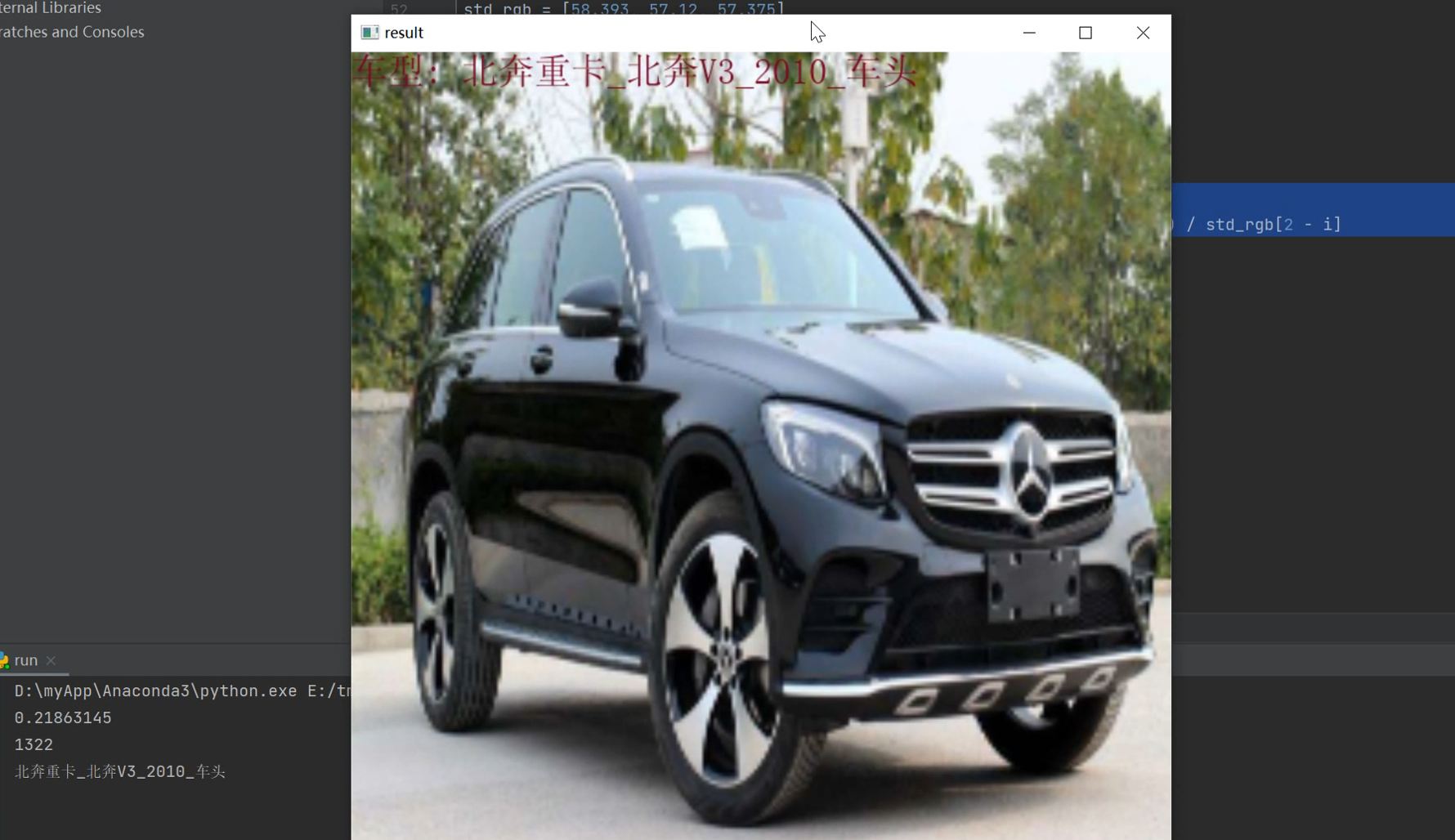

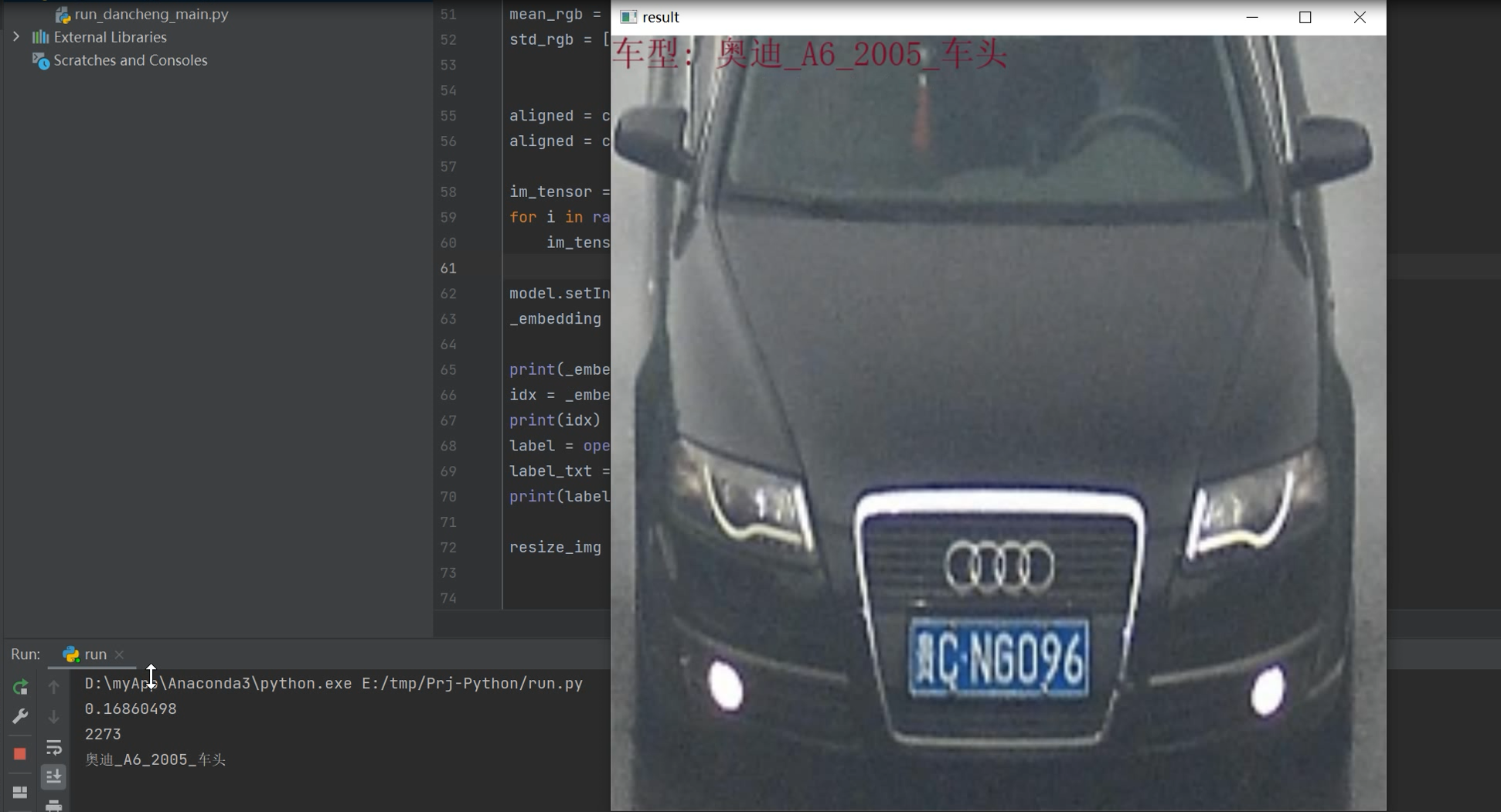

执行得到的结果如下图所示,图中车型的种类和置信度值都标注出来了,预测速度较快。基于此模型我们可以将其设计成一个带有界面的系统,在界面上选择图片、视频或摄像头然后调用模型进行检测。

if __name__ == '__main__':

# video_path = 0

video_path = "./UI_rec/test_/test.mp4"

# 初始化视频流

vs = cv2.VideoCapture(video_path)

(W, H) = (None, None)

frameIndex = 0 # 视频帧数

try:

prop = cv2.CAP_PROP_FRAME_COUNT

total = int(vs.get(prop))

# print("[INFO] 视频总帧数:{}".format(total))

# 若读取失败,报错退出

except:

print("[INFO] could not determine # of frames in video")

print("[INFO] no approx. completion time can be provided")

total = -1

fourcc = cv2.VideoWriter_fourcc(*'XVID')

ret, frame = vs.read()

vw = frame.shape[1]

vh = frame.shape[0]

print("[INFO] 视频尺寸:{} * {}".format(vw, vh))

output_video = cv2.VideoWriter("./results.avi", fourcc, 20.0, (vw, vh)) # 处理后的视频对象

# 遍历视频帧进行检测

while True:

# 从视频文件中逐帧读取画面

(grabbed, image) = vs.read()

# 若grabbed为空,表示视频到达最后一帧,退出

if not grabbed:

print("[INFO] 运行结束...")

output_video.release()

vs.release()

exit()

# 获取画面长宽

if W is None or H is None:

(H, W) = image.shape[:2]

image = cv2.resize(image, (850, 500))

img0 = image.copy()

img = letterbox(img0, new_shape=imgsz)[0]

img = np.stack(img, 0)

img = img[:, :, ::-1].transpose(2, 0, 1) # BGR to RGB, to 3x416x416

img = np.ascontiguousarray(img)

pred, useTime = predict(img)

det = pred[0]

p, s, im0 = None, '', img0

if det is not None and len(det): # 如果有检测信息则进入

det[:, :4] = scale_coords(img.shape[1:], det[:, :4], im0.shape).round() # 把图像缩放至im0的尺寸

number_i = 0 # 类别预编号

detInfo = []

for *xyxy, conf, cls in reversed(det): # 遍历检测信息

c1, c2 = (int(xyxy[0]), int(xyxy[1])), (int(xyxy[2]), int(xyxy[3]))

# 将检测信息添加到字典中

detInfo.append([names[int(cls)], [c1[0], c1[1], c2[0], c2[1]], '%.2f' % conf])

number_i += 1 # 编号数+1

label = '%s %.2f' % (names[int(cls)], conf)

# 画出检测到的目标物

plot_one_box(image, xyxy, label=label, color=colors[int(cls)])

# 实时显示检测画面

cv2.imshow('Stream', image)

image = cv2.resize(image, (vw, vh))

output_video.write(image) # 保存标记后的视频

if cv2.waitKey(1) & 0xFF == ord('q'):

break

# print("FPS:{}".format(int(0.6/(end-start))))

frameIndex += 1

3 实现效果

项目运行效果:

毕业设计 深度学习车型检测算法

最后

项目获取:

版权归原作者 A毕设分享家 所有, 如有侵权,请联系我们删除。