Hadoop伪分布安装。主要参考《大数据技术原理与应用》第三版。

1. 更新apt和安装VIm编辑器

命令如下:

sudo apt-get update

提示输入密码,完成密码输入即可自动更新

可以使用Vim编辑器完成文件创建与修改,安装Vim命令如下:

sudo apt-get install vim

安装过程提示Do you want to continue? [Y/n],输入y,回车即可继续(其他安装遇到相同问题也是如此)

2. 安装SSH

hadoop的NameNode需要启动集群所有机器的hadoop守护进程,主要通过SSH登录实现。为顺利从主节点无密码地登录从节点每台机器,需要安装SSH服务器和客户端。Ubuntu已安装SSH客户端,先只需安装SSH服务端即可,命令如下:

sudo apt-get install openssh-server

安装完成后,可以通过下面命令登录本机

ssh localhost

出现Are you sure you want to continue connecting (yes/no/[fingerprint])?

输入 yes 后回车,然后输入密码即可。

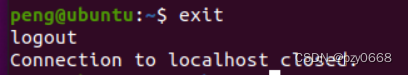

退出ssh登录,生成密钥并加入授权。

退出 exit

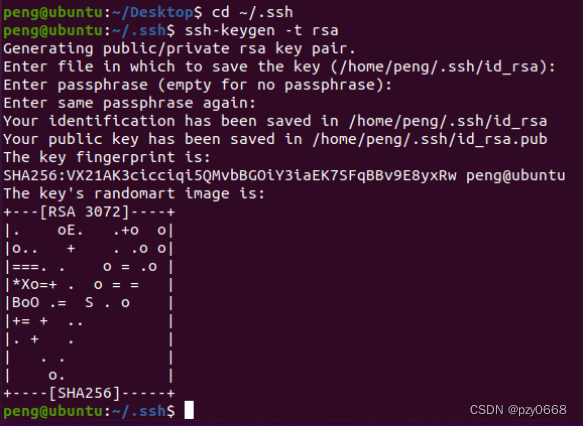

进入 ~/.ssh 目录,生成密钥

cd ~/.ssh/ # 若没有该目录,请先执行一次ssh localhost

ssh-keygen -t rsa # 会有提示,都按回车就可以

输入上面命令后,一直按回车即可生成密钥。

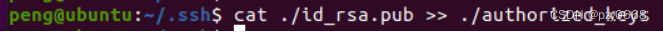

将id_rsa.pub文件的内容追加到authorized_keys文件中

cat id_rsa.pub >> authorized_keys # 加入授权

对于伪分布来说,ssh localhost 命令能够免密钥登录,就ok了。

3. 查看IP

(1)安装net-tools包

sudo apt install net-tools

(2)通过 ifconfig 查看本机ip信息

4. 安装Java环境

提前准备好JDK1.8,放到ubuntu中,如果在windows上, 可以直接复制,到ubuntu上粘贴即可。

先在/home/peng目录下创建bigdata文件夹。peng是我的用户名,根据实际的修改即可。

mkdir /home/peng/bigdata

将安装文件放到该目录下。然后将继续创建目录存放解压的JDK文件。

cd /usr/lib

sudo mkdir jvm

将JDK解压到 /usr/lib/jvm 目录去

cd

cd bigdata

sudo tar -zxvf jdk-8u162-linux-x64.tar.gz -C /usr/lib/jvm

设置环境变量

vim ~/.bashrc

可在开头添加下面几行,注意,进入编辑文本窗口后, 按 字母 i 进入编辑每行开头的# 号代表注释,保持并退出编辑: 先按 ESC, 再按 冒号:,再按 wq 。 退出不保存是 先按ESC,再按 q!

export JAVA_HOME=/usr/lib/jvm/jdk1.8.0_162

export JRE_HOME=${JAVA_HOME}/jre

export CLASSPATH=.:${JAVA_HOME}/lib:${JRE_HOME}/lib

export PATH=${JAVA_HOME}/bin:$PATH

保存并退出编辑,下面命令让.bashrc文件生效:

source ~/.bashrc

通过java -version 查看是否安装成功,出现如下说明安装成功。

5. Hadoop伪分布安装

伪分布安装,仅需要 修改 core-site.xml 和 hdfs-site.xml文件即可.

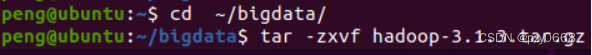

先进入bigdata文件夹解压hadoop压缩包。

cd ~/bigdata

tar -zxvf hadoop-3.1.3.tar.gz

解压完成后,进入 hadoop/etc/hadoop 目录完成上面文件配置。

cd hadoop-3.1.3/etc/hadoop

vim core-site.xml

core-site.xml配置如下, 注意 补充好<configuration>内容即可:

<configuration>

<property>

<name>hadoop.tmp.dir</name>

<value>/home/peng/bigdata/hadoopdata/</value>

<description>需要先创建该目录</description>

</property>

<property>

<name>fs.defaultFS</name>

<value>hdfs://localhost:9000</value>

</property>

</configuration>

mkdir /home/peng/bigdata/hadoopdata

vim hdfs-site.xml

hdfs-site.xml配置如下:

<configuration>

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>/home/peng/bigdata/hadoopdata/dfs/name</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>/home/peng/bigdata/hadoopdata/dfs/data</value>

</property>

</configuration>

修改坏境变量

vim ~/.bashrc

添加 HADOOP_HOME

export HADOOP_HOME=/home/peng/bigdata/hadoop-3.1.3

export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

使改动生效:

source ~/.bashrc

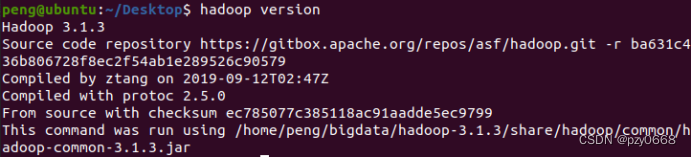

查看Hadoop版本信息

格式化文件系统

hadoop namenode -format

注:若有需要再次格式化,请将$HADOOP_HOME/logs文件夹里面内容清空。以及hadoopdata文件夹里面的内容清空。

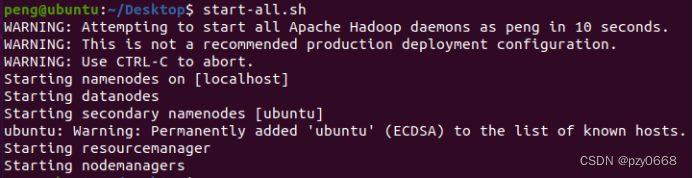

成功后,可以启动集群,启动hdfs和yarn

start-all.sh

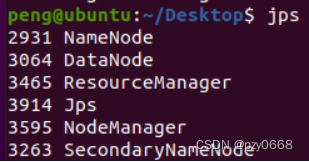

Jps查看进程,NameNode、Datanode、ResourceManager、NodeManager、SecondaryNameNode都齐全证明配置成功。

网页端查看HDFS文件系统,在浏览器输入:http://localhost:9870/ ,注意,如果用的是hadoop2,端口号是 50070

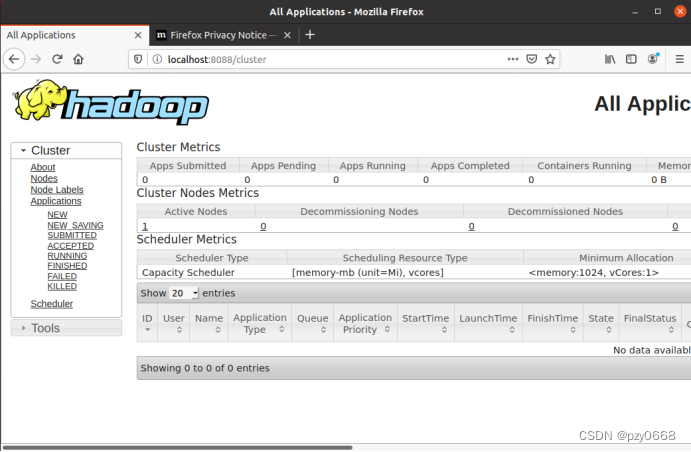

网页端查看YARN,在浏览器输入:

至此,Hadoop伪分布安装已完成。

建议看官网:

Apache Hadoop 3.1.3 – Hadoop: Setting up a Single Node Cluster.

版权归原作者 pzy0668 所有, 如有侵权,请联系我们删除。