Linux环境搭建Spark分为两个版本,分别是Scala版本和Python版本。

一、 安装Pyspark

本环境以 Python 环境为例。

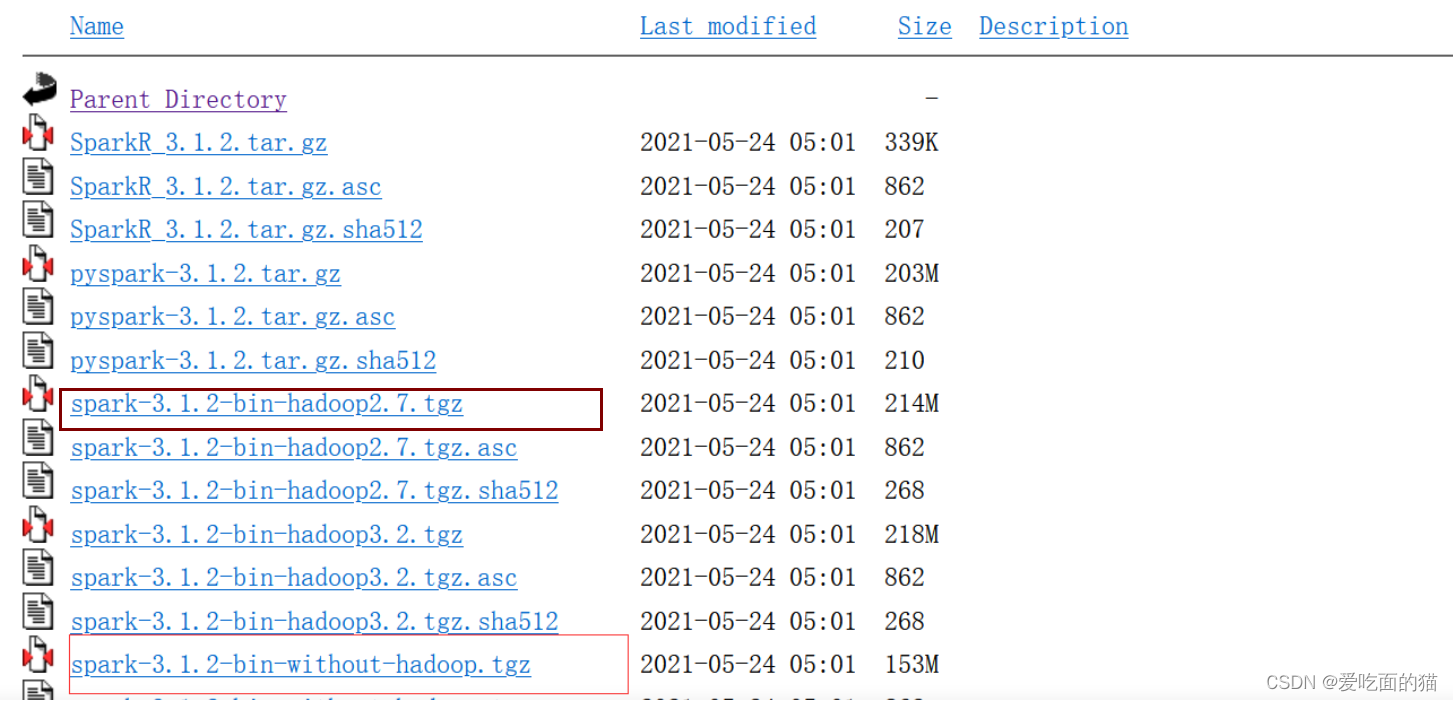

1、下载spark

下载网址:https://archive.apache.org/dist/spark

下载安装包:根据自己环境选择合适版本,本环境以spark3.0版本为案例。

- 根据hadoop版本下载下载 spark-3.0.0-bin-hadoop2.7.tgz / spark-3.0.0-bin-hadoop3.2.tgz

- 如果不依赖hadoop,则下载spark-3.0.0-bin-without-hadoop.tgz

- 只安装pyspark下载pyspark-3.0.0.tar.gz

个人推荐带有hadoop版本 如 spark-3.0.0-bin-hadoop3.2.tgz ,将来可以使用hadoop,也可以使用python环境。

2、上传spark安装包到目录

3、解压spark安装包并重命名

重命名主要是为了便于配置环境变量

版权归原作者 2401_83816794 所有, 如有侵权,请联系我们删除。