一、问题

现象

Spark 任务速度变慢,也不失败。

DataNode 内存足够 CPU 负载不高 GC 时间也不长。

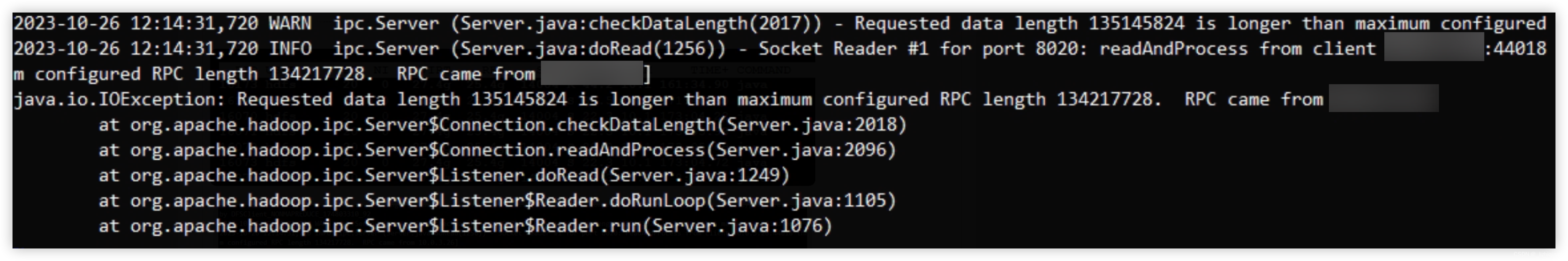

查看 DataNode 日志,发现有些日志出现很多 Netty RPC 超时。超时的 destination 是一个 NameNode 节点,然后查看 NameNode 节点的日志,报错如下:

二、解决方案

查找对应 Hadopo 源码

源码

org.apache.hadoop.ipc.Server.Connection#checkDataLength

privatevoidcheckDataLength(int dataLength)throwsIOException{if(dataLength <0){String error ="Unexpected data length "+ dataLength +"!! from "+getHostAddress();LOG.warn(error);thrownewIOException(error);}elseif(dataLength > maxDataLength){String error ="Requested data length "+ dataLength +" is longer than maximum configured RPC length "+

maxDataLength +". RPC came from "+getHostAddress();LOG.warn(error);thrownewIOException(error);// <-------------- 异常从此处抛出来}}this.maxDataLength = conf.getInt(CommonConfigurationKeys.IPC_MAXIMUM_DATA_LENGTH,CommonConfigurationKeys.IPC_MAXIMUM_DATA_LENGTH_DEFAULT);/** Max request size a server will accept. */publicstaticfinalStringIPC_MAXIMUM_DATA_LENGTH="ipc.maximum.data.length";/** Default value for IPC_MAXIMUM_DATA_LENGTH. */publicstaticfinalintIPC_MAXIMUM_DATA_LENGTH_DEFAULT=64*1024*1024;

修改NameNode的hdfs-site.xml配置文件,添加以下配置:

<property><name>ipc.maximum.data.length</name><value>67108864</value><description>This indicates the maximum IPC message length (bytes) that can be

accepted by the server. Messages larger than this value are rejected by the

immediately to avoid possible OOMs. This setting should rarely need to be

changed.

</description></property>

64M -> 256M

67108864 * 4 = 268435456

允许ipc通讯最大的数据包为256MB,默认配置为64MB。

最后重启 NameNode,再重启 DataNode。

版权归原作者 _lizhiqiang 所有, 如有侵权,请联系我们删除。