文章目录

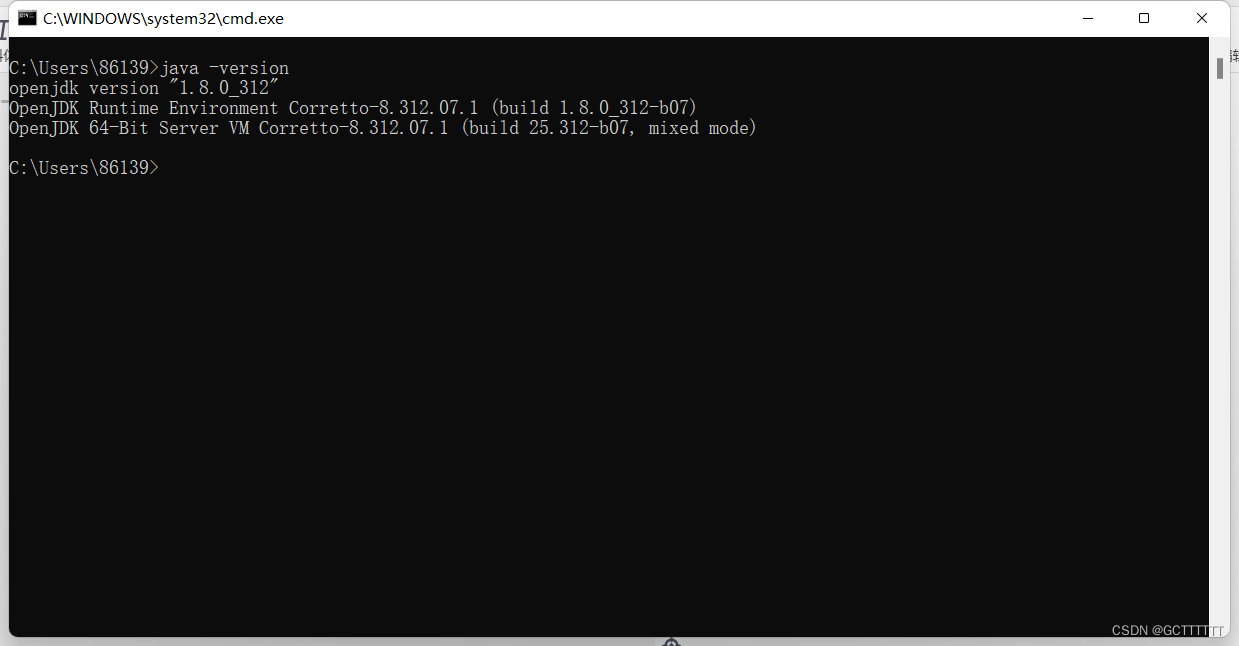

1、查看是否安装好了Java开发环境

在cmd中输入

java -version

若能成功显示java jdk的版本号则代表java环境已安装成功(注意要配置好JAVA_HOME,后面步骤中会用到)

若还未安装或配置Java JDK,可以参考以下链接进行安装:Java JDK安装和配置

2、下载安装Hadoop所需要的文件

- Hadoop3.1.0版本的安装包:https://archive.apache.org/dist/hadoop/common/hadoop-3.1.0/hadoop- 3.1.0.tar.gz

- Windows环境安装所需的bin:https://github.com/s911415/apache-hadoop-3.1.0-winutils

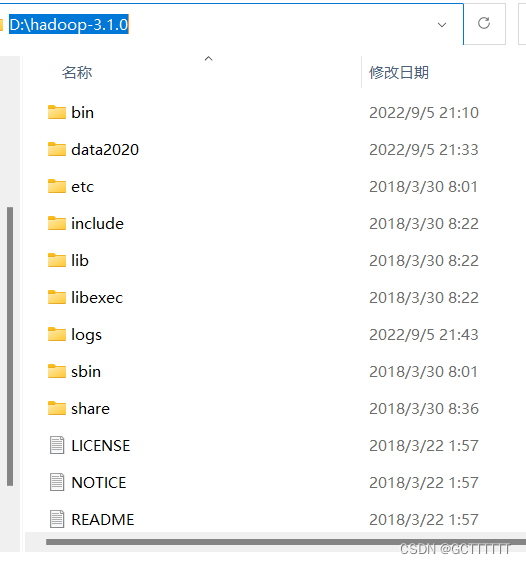

3、解压已下载的文件

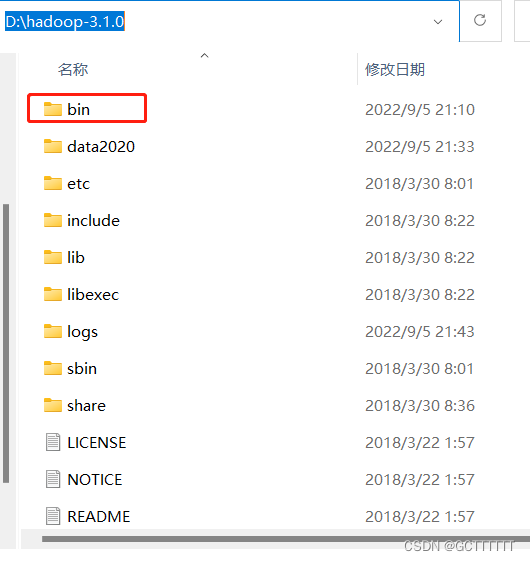

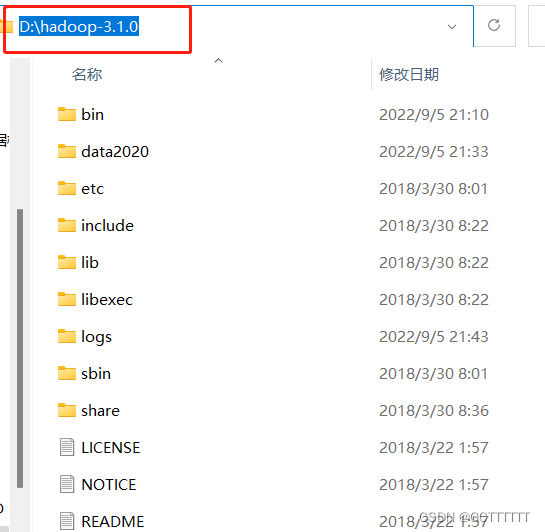

我的hadoop-3.1.0解压后文件夹的路径为D:\hadoop-3.1.0

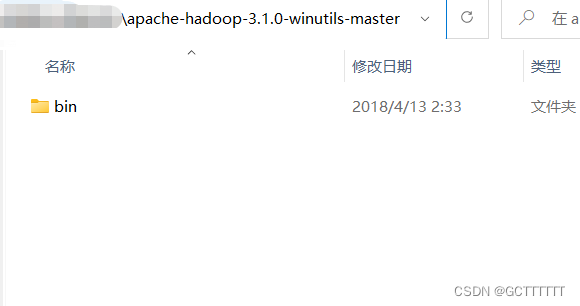

4、替换原安装包的bin文件夹

可以发现apache-hadoop-3.1.0-winutils-master这个文件夹解压后里面只有bin这一个文件夹,我们将这个bin文件夹复制到hadoop-3.1.0文件夹中替换原有的bin文件夹

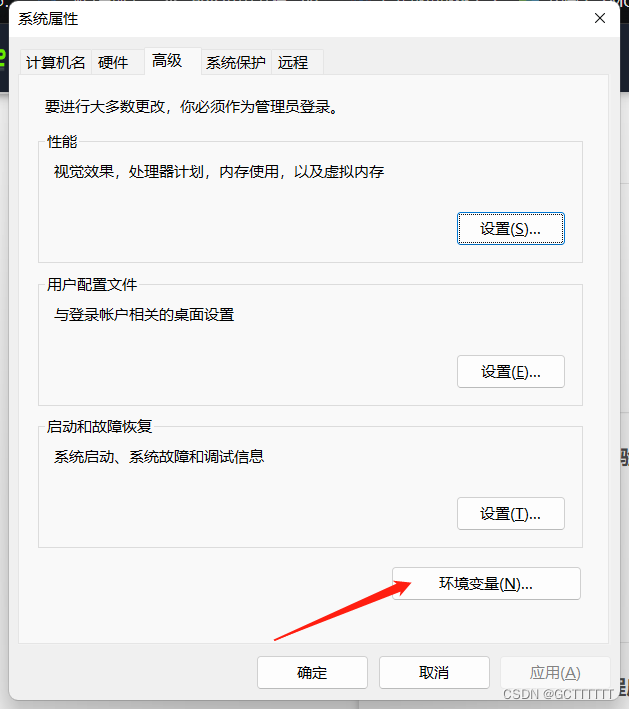

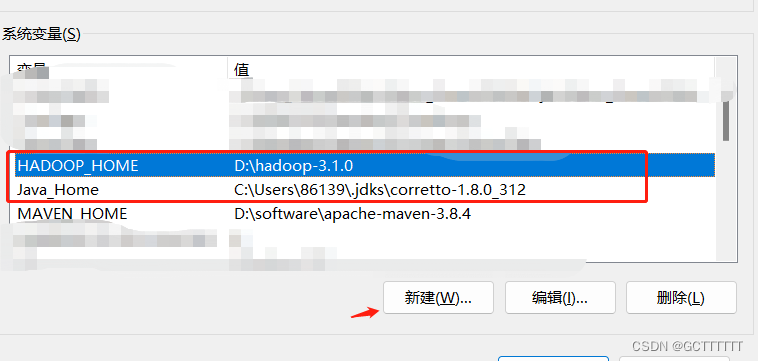

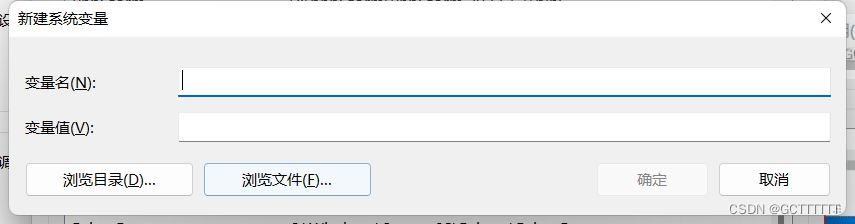

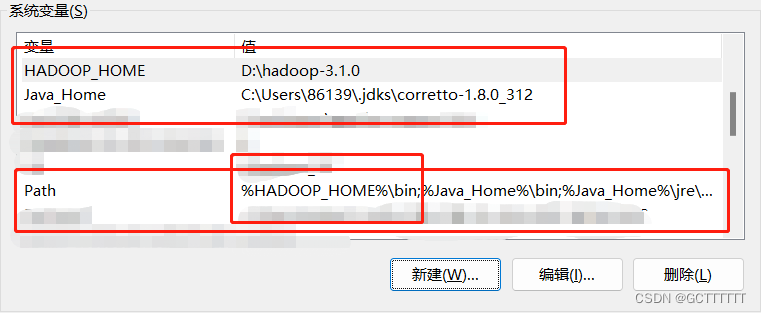

5、配置Hadoop环境变量

在新建系统变量中:变量名填

HADOOP_HOME

,变量值填hadoop-3.1.0对应的路径(比如我的是D:\hadoop-3.1.0)

顺便可以检查一下JAVA_HOME有没有配置好,后面会用到

然后点击Path变量进行编辑,在最前面加上

%HADOOP_HOME%\bin;

(记得加分号和别的隔开),配置完后如图所示:

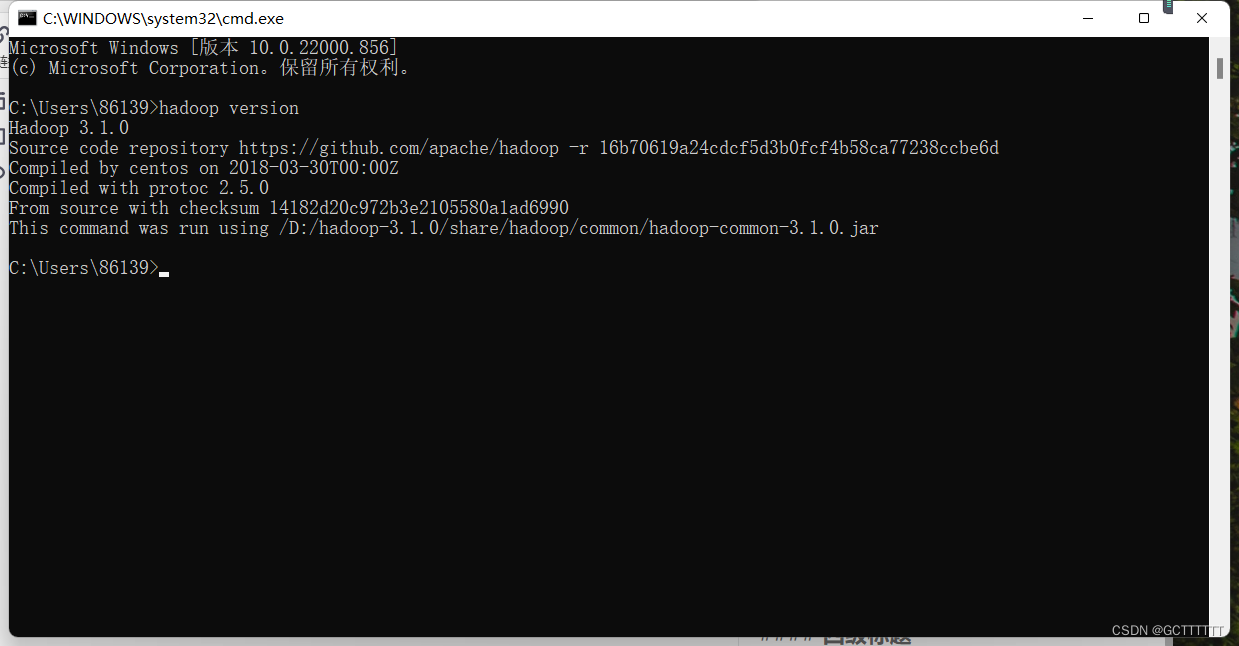

6、检查环境变量是否配置成功

配置好环境变量后,win+R 输入cmd打开命令提示符,然后输入

hadoop version

,按回车,如果出现如图所示版本号,则说明安装成功

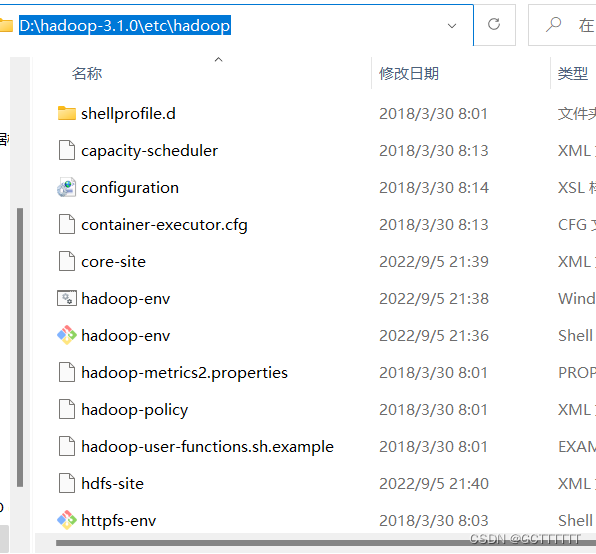

7、配置hadoop的配置文件

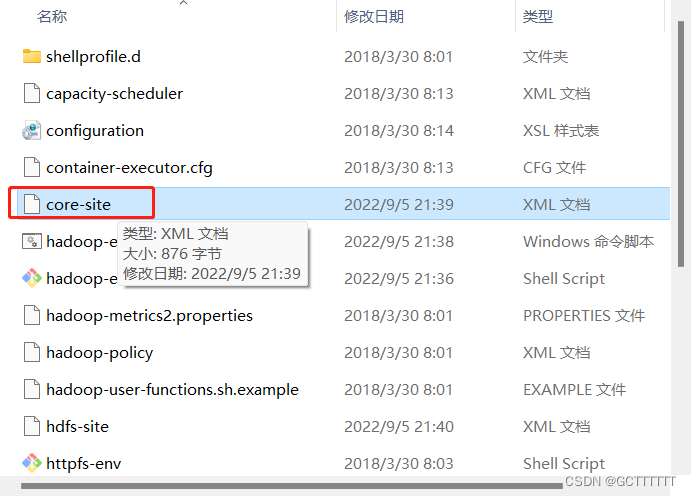

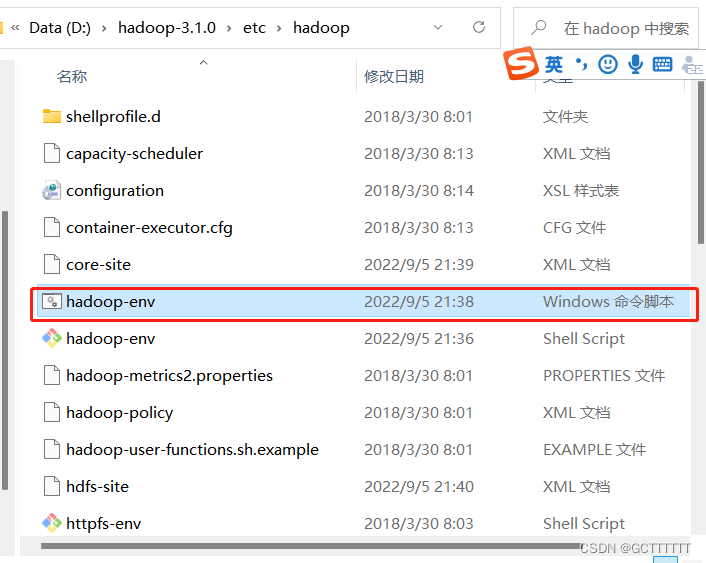

进入到\hadoop-3.1.0\etc\hadoop文件夹

1. 配置core-site.xml文件

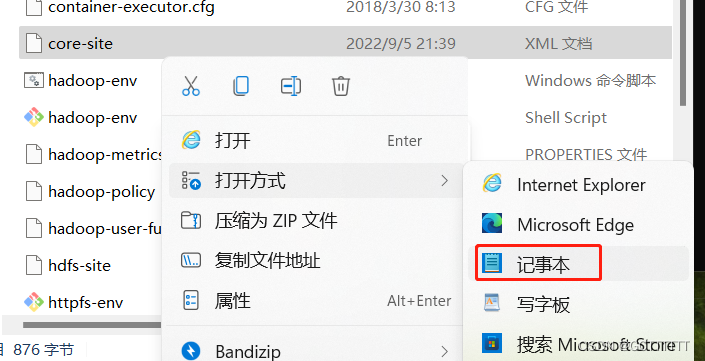

以记事本或其他文本编辑器打开:

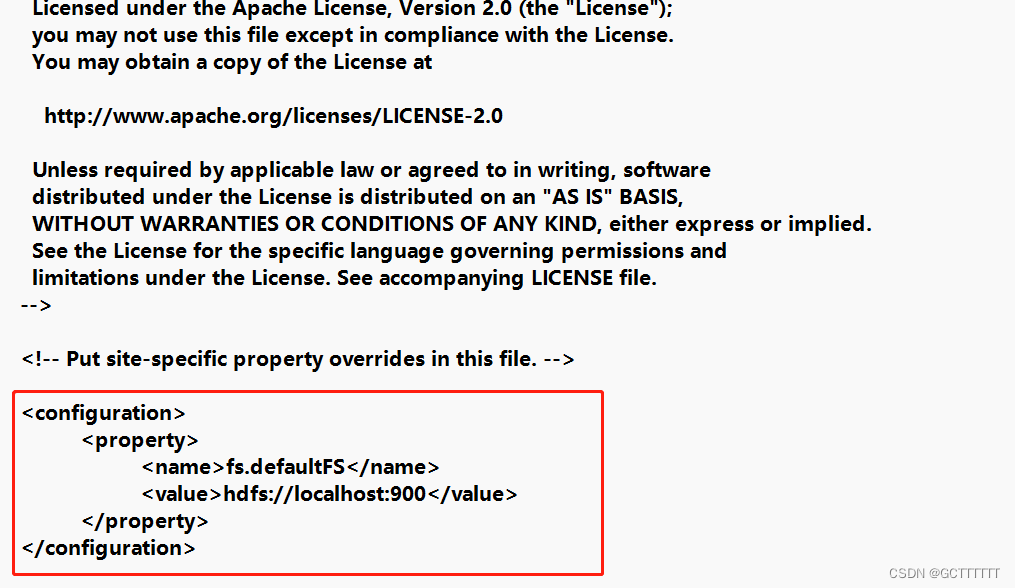

找到文档最后的""标签

填入以下内容:

<configuration><property><name>fs.defaultFS</name><value>hdfs://localhost:900</value></property></configuration>

注意:最后只有一个configuration标签!可以先去掉原来的configuration标签将以上内容复制粘贴到文档最后;或者将以上内容中configuration标签内的内容复制粘贴到原本文档中的configuration标签中!(最后文档内只能有一个configuration标签,以下几个配置文件也是如此)

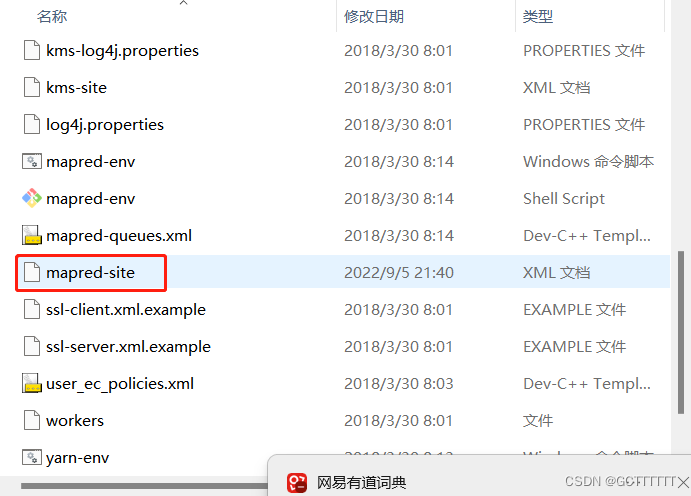

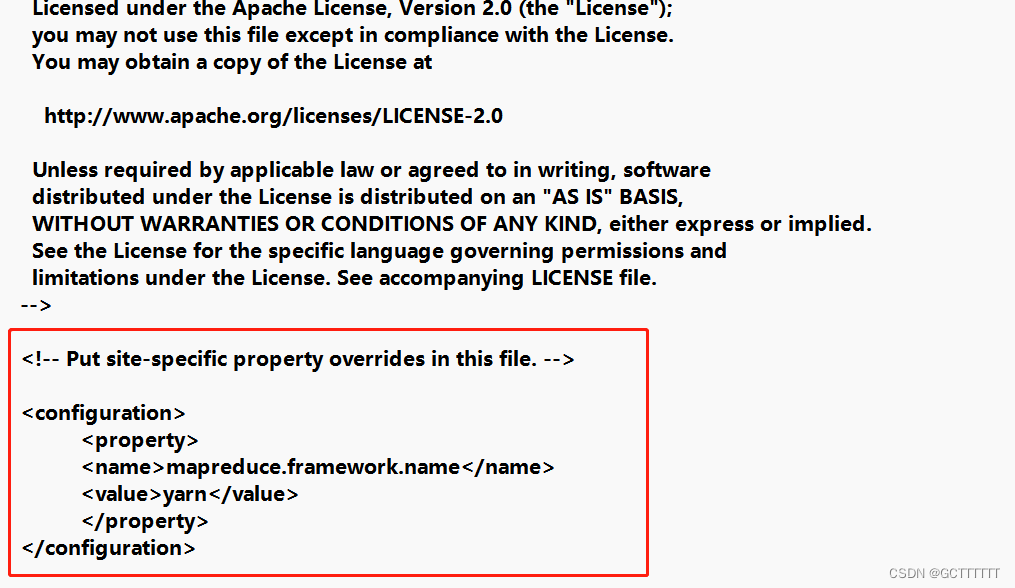

2. 配置mapred-site.xml

同样也是在文档末尾添加以下内容:

<configuration><property><name>mapreduce.framework.name</name><value>yarn</value></property></configuration>

如图所示:

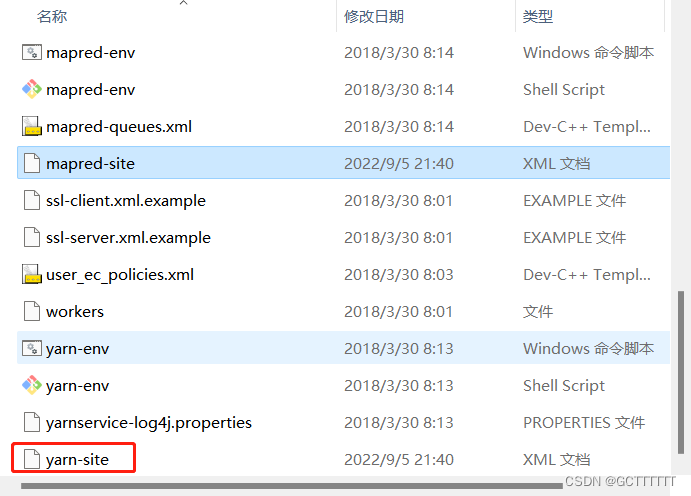

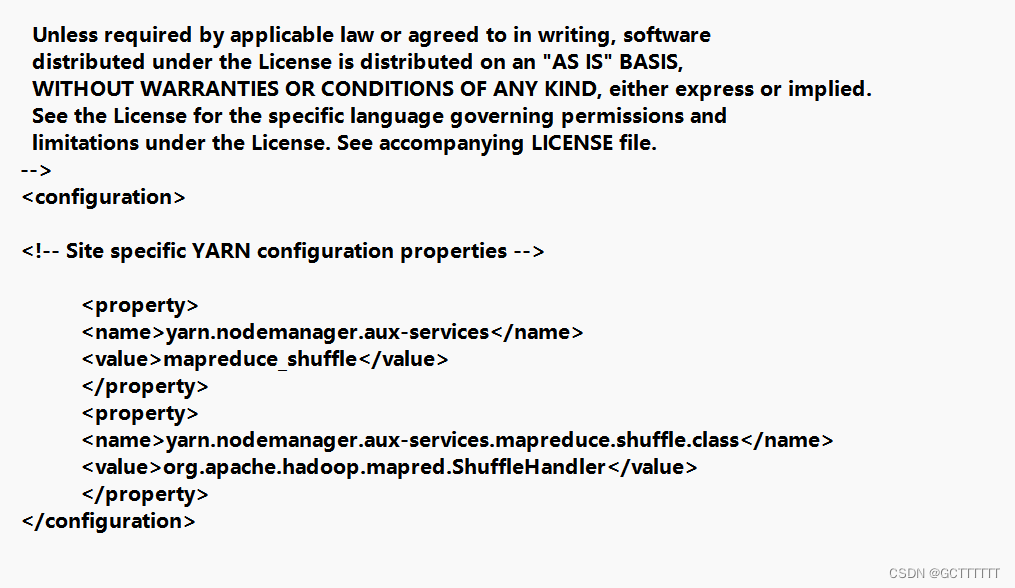

3. 配置yarn-site.xml

文档末尾添加以下内容:

<configuration><property><name>yarn.nodemanager.aux-services</name><value>mapreduce_shuffle</value></property><property><name>yarn.nodemanager.auxservices.mapreduce.shuffle.class</name><value>org.apache.hadoop.mapred.ShuffleHandler</value></property></configuration>

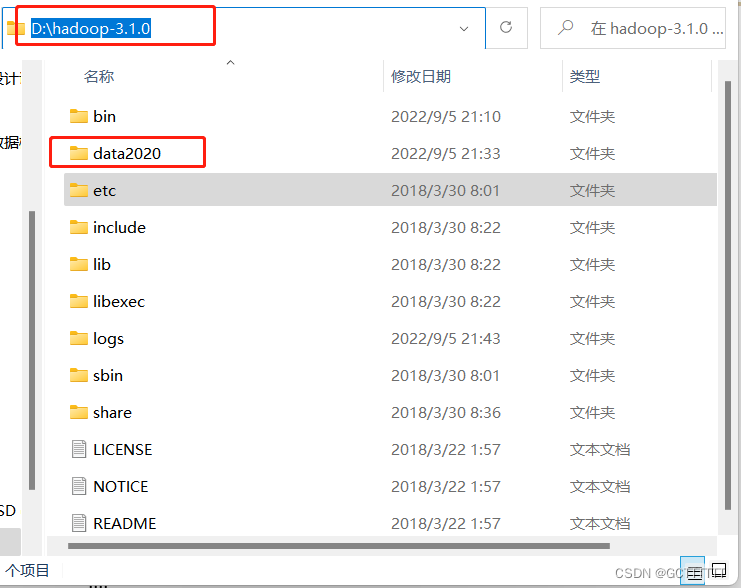

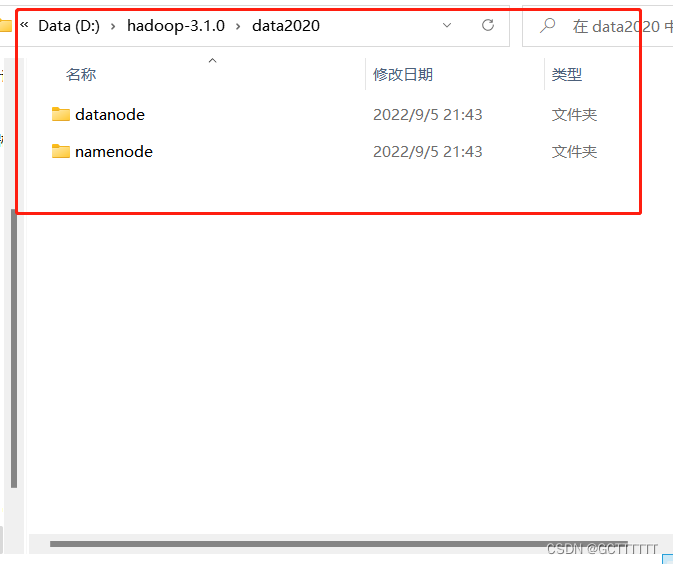

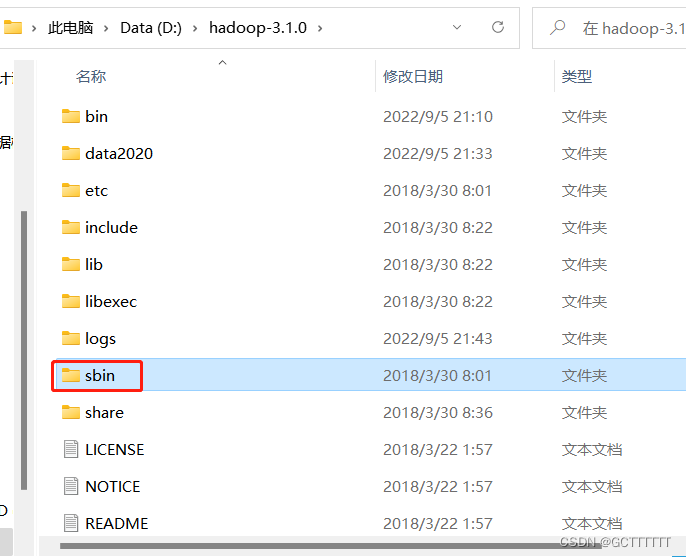

4. 新建namenode文件夹和datanode文件夹

- 在D:\hadoop-3.1.0创建

data2020文件夹(这个也可以是别的名字,但后面配置要对应修改)

- 在data2020文件夹中(D:\hadoop-3.1.0\data2020)创建

datanode和namenode文件夹

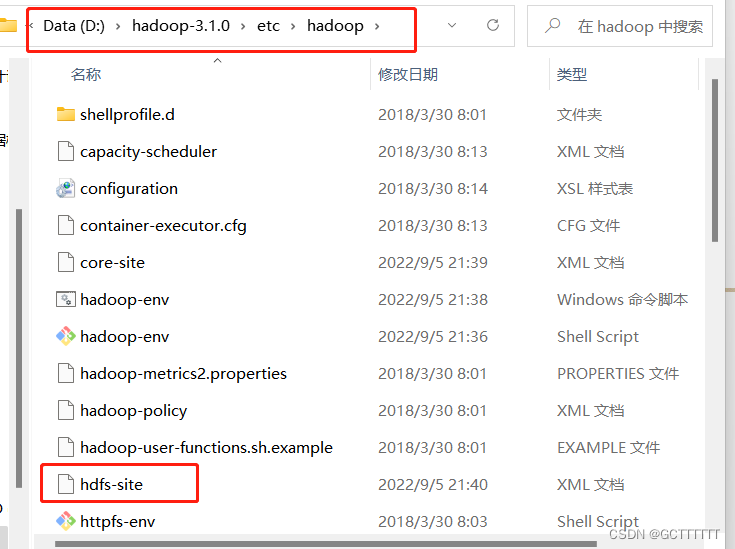

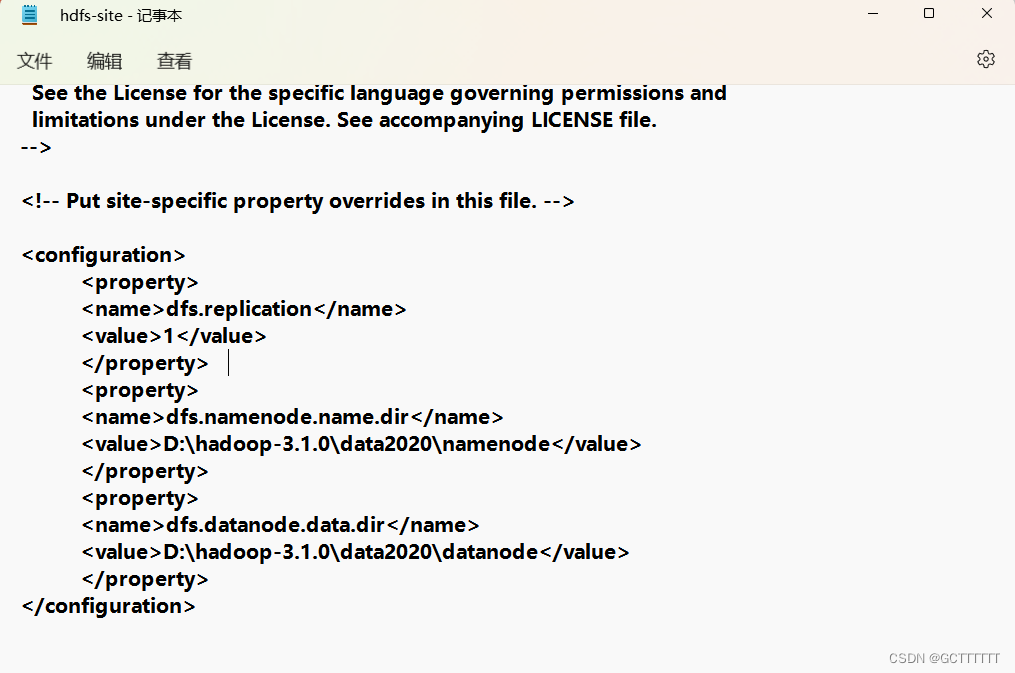

5. 配置hdfs-site.xml

在文档底部配置如下内容:

<configuration><property><name>dfs.replication</name><value>1</value></property><property><name>dfs.namenode.name.dir</name><value>D:\hadoop-3.1.0\data2020\namenode</value></property><property><name>dfs.datanode.data.dir</name><value>D:\hadoop-3.1.0\data2020\datanode</value></property></configuration>

注意两个标签中的地址是刚刚创建的datanode和namenode的对应地址

配置后如图所示:

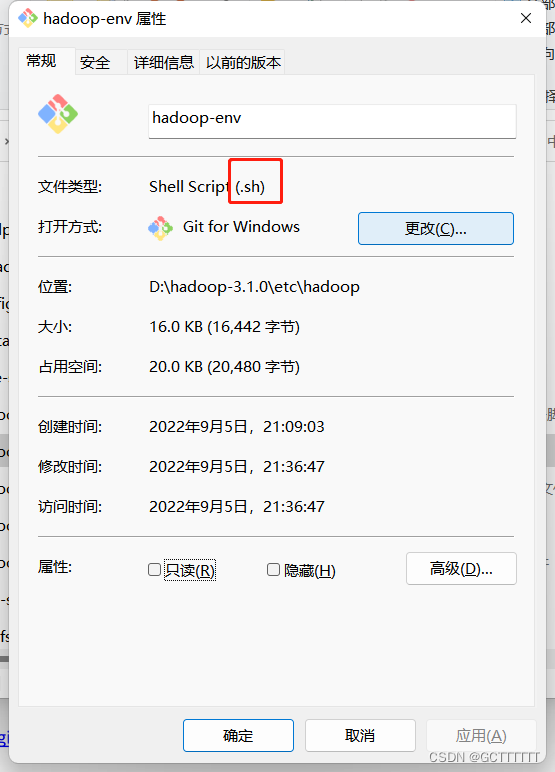

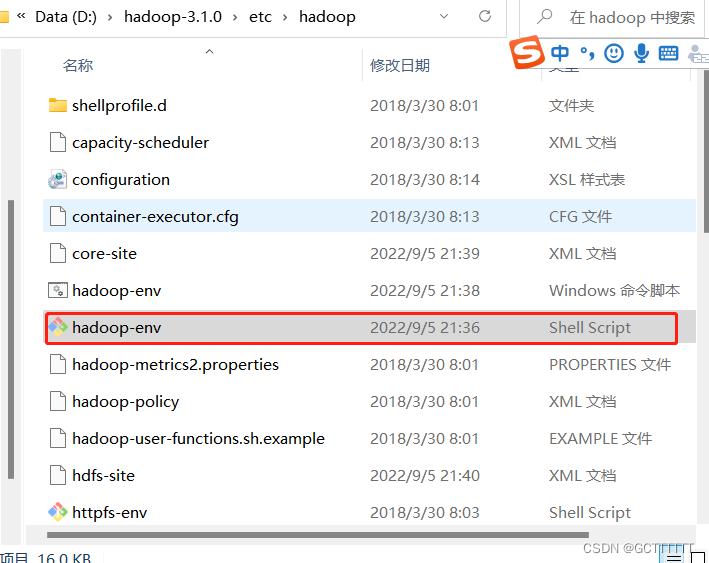

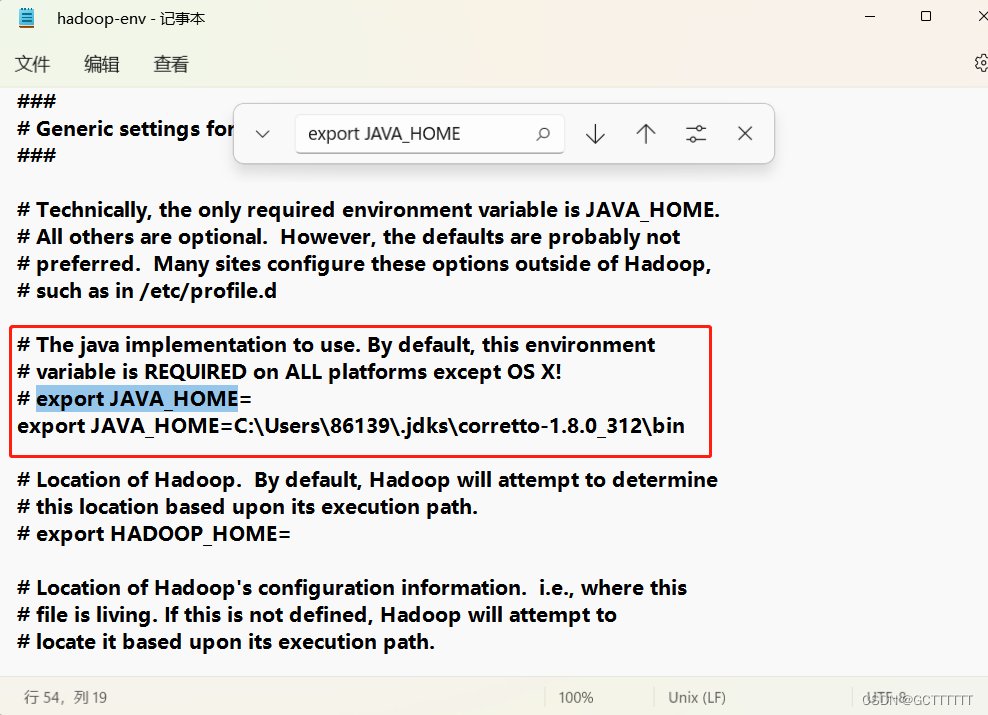

6、配置hadoop-env.sh

注意!!hadoop-env.sh是.sh文件!有两个“hadoop-env”,一个是cmd文件,一个是sh文件,不要搞混了!

可以右键文件,点击属性,查看该文件的类型:

打开hadoop-env.sh

使用查找功能(ctrl+f)查找

export JAVA_HOME

,找到相应的位置:

在#export JAVA_HOME=下面一行配置自己电脑上对应的JAVA_HOME/bin路径,注意是以bin结尾的!!

JAVA_HOME的具体路径在环境变量中查找到

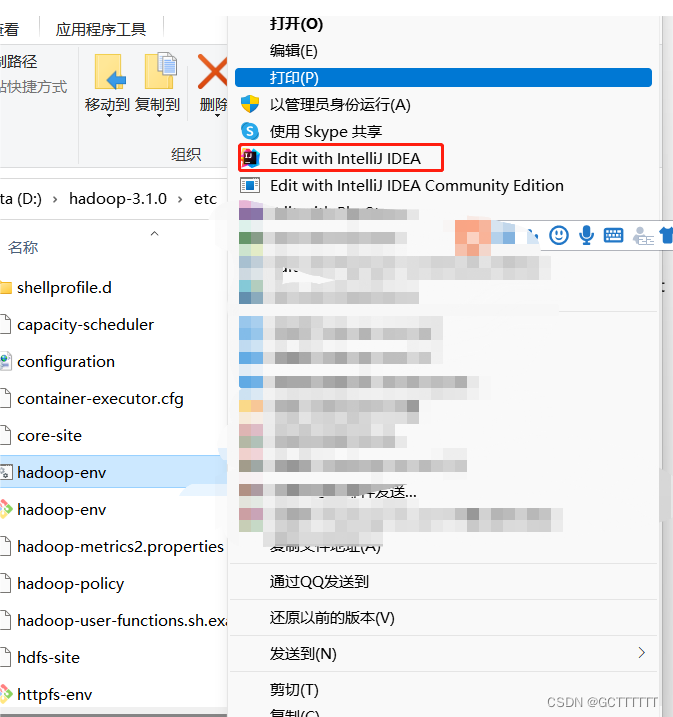

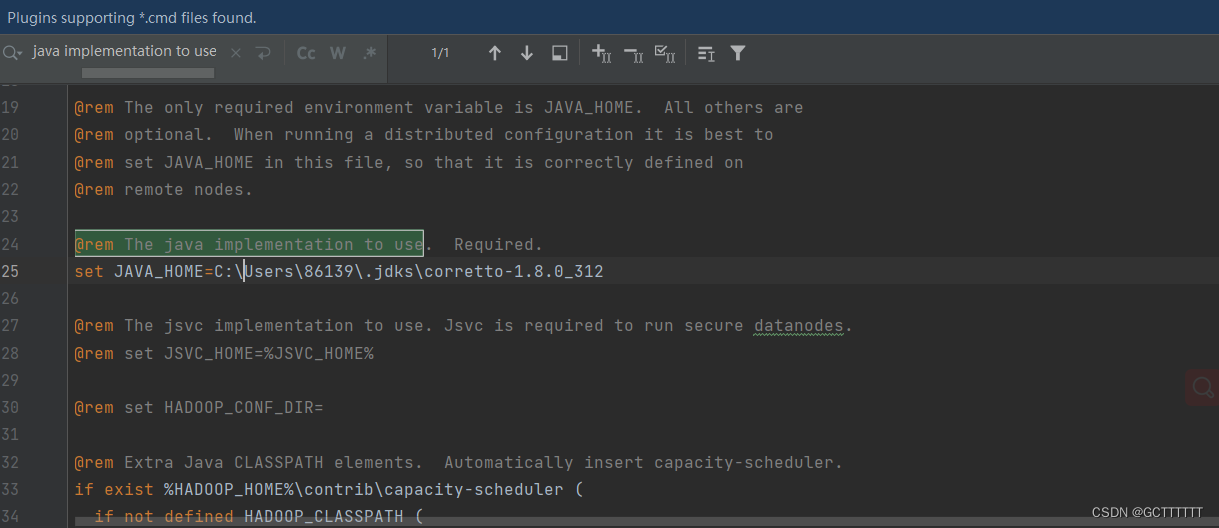

7、配置hadoop-env.cmd

注意是.cmd文件!!

.cmd文件无法用记事本打开的话,可以右键用Intellij IDEA打开并编辑

打开后使用查找功能(ctrl+f),输入

@rem The java implementation to use

查找到对应行

在set JAVA_HOME那一行将自己的JAVA_HOME路径配置上去

到这里配置文件就配置完了,注意每个文件配置完后记得保存!!

8、启动Hadoop服务

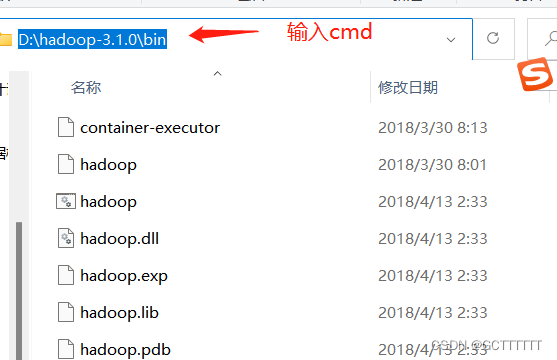

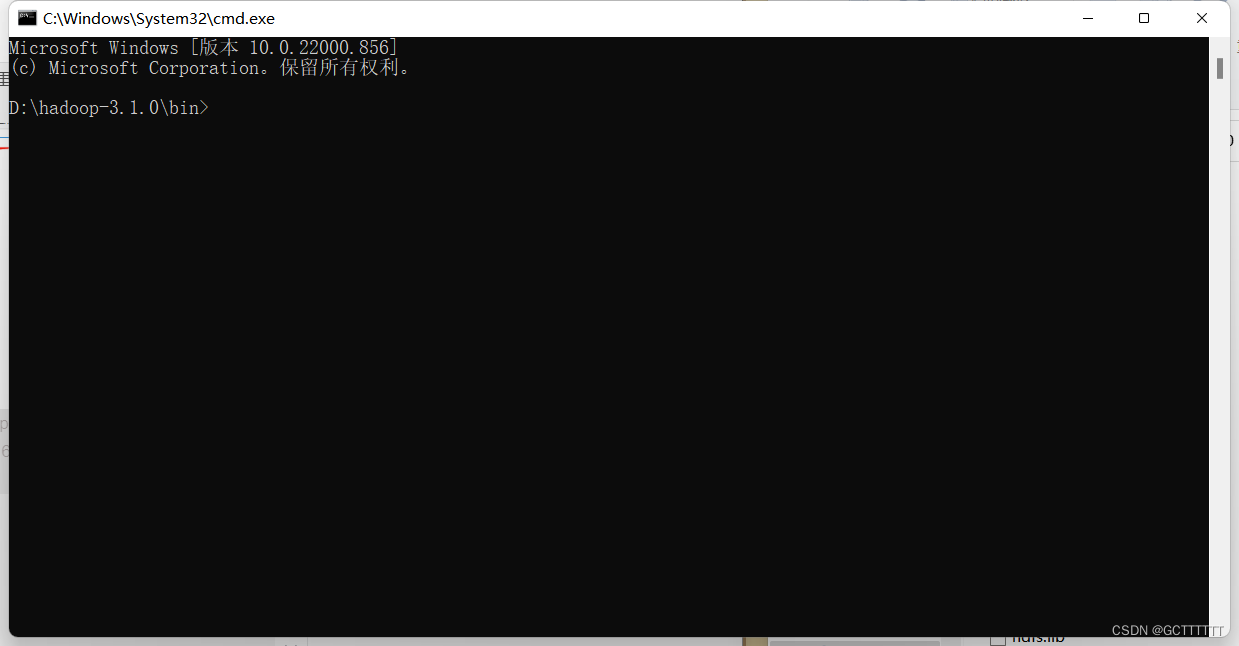

在cmd中进入到D:\hadoop-3.1.0\bin路径

或者直接在对应的文件夹里面输入cmd进入

输入

hdfs namenode –format

命令

如果没报错的话,证明配置文件没出问题!

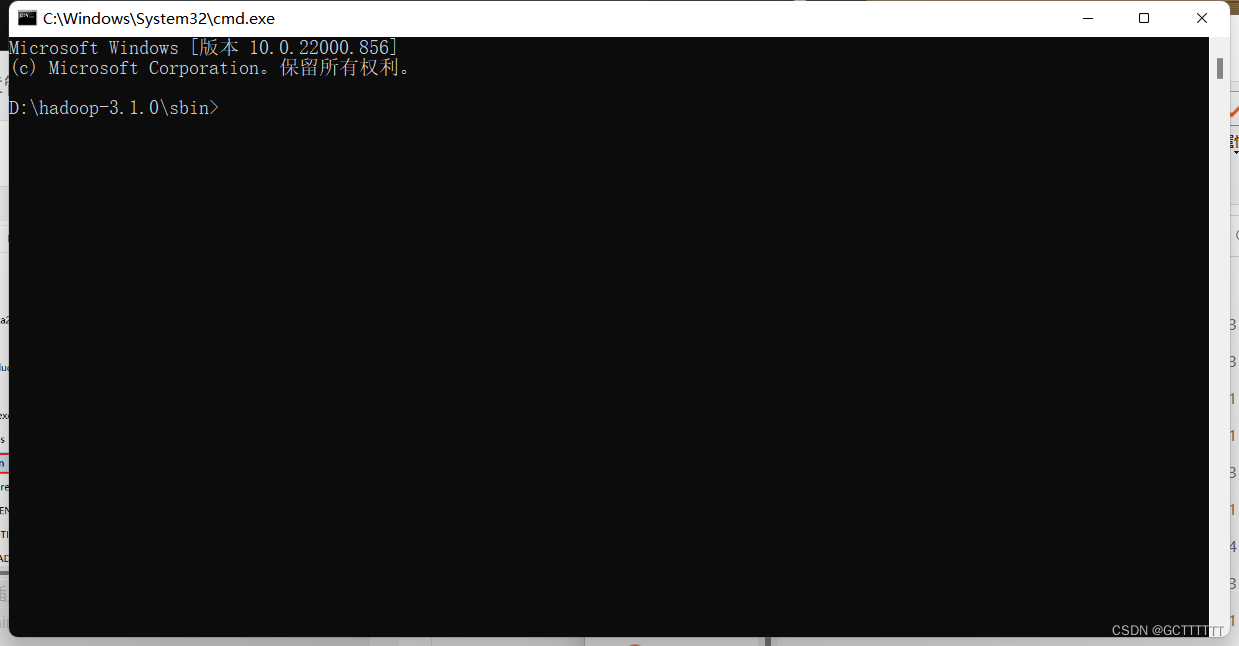

然后再进入到D:\hadoop-3.1.0\sbin路径

注意,是sbin,不是bin!!

输入

start-dfs.cmd

命令,会跳出两个窗口,不要关掉它们!

再输入

start-yarn.cmd

,命令,又会再出现两个窗口,也不要关!

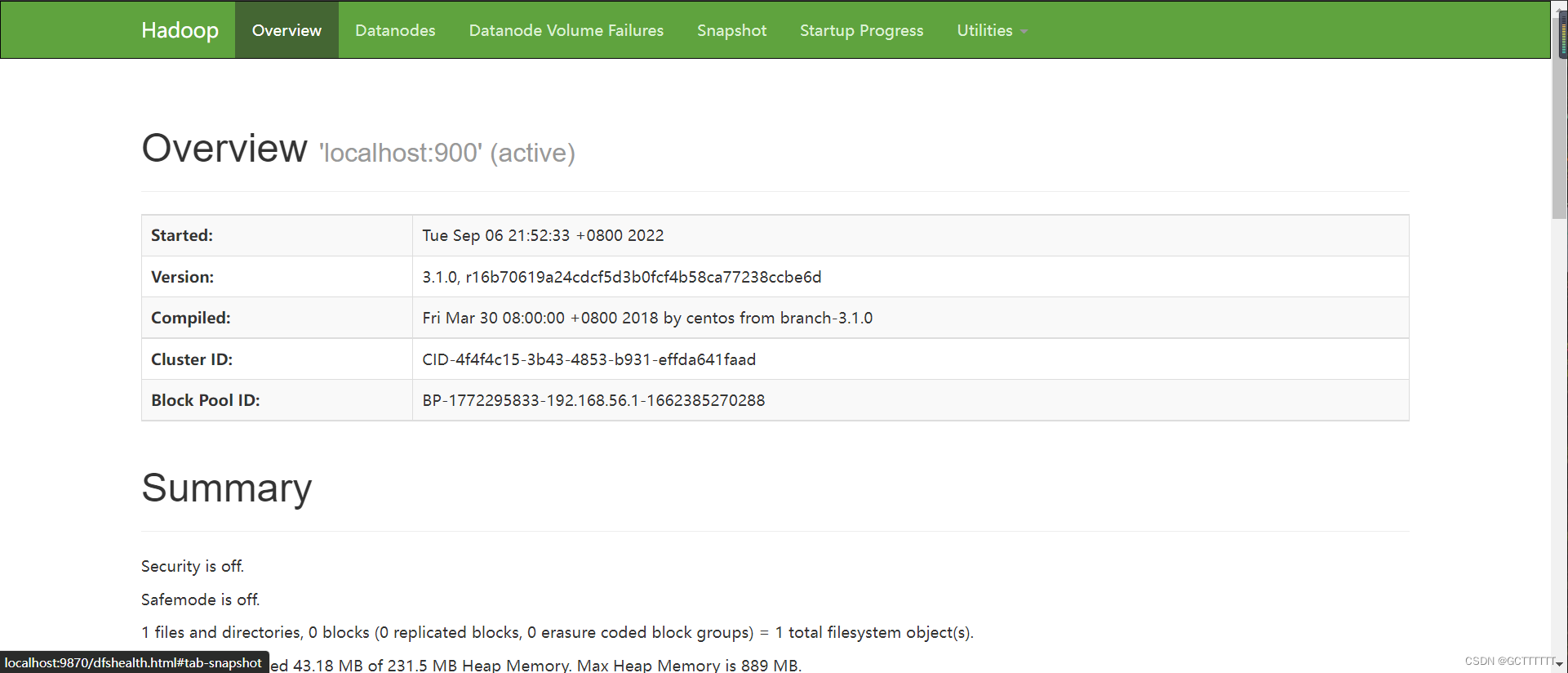

接着在浏览器中访问http://localhost:9870/

如果成功出现以下界面则代表Hadoop安装和配置完成啦!!

版权归原作者 GCTTTTTT 所有, 如有侵权,请联系我们删除。