自从ChatGPT火爆以来,各种通用的大型模型层出不穷,GPT4、SAM等等,本周一Meta 又开源了新的语音模型MMS,这个模型号称支持4000多种语言,并且发布了支持1100种语言的预训练模型权重,最主要的是这个模型不仅支持ASR,还支持TTS,也就是说不仅可以语音转文字,还可以文字转语音。

因为以前对语音方面没有研究,所以我就查阅了一下资料,世界上一共有 7,000 多种语言(我一直以为只有几百),目前的语音识别技术目前仅能覆盖100多种,其实我觉得100多种已经够用了,当然如果有特殊的研究需要那要另说。

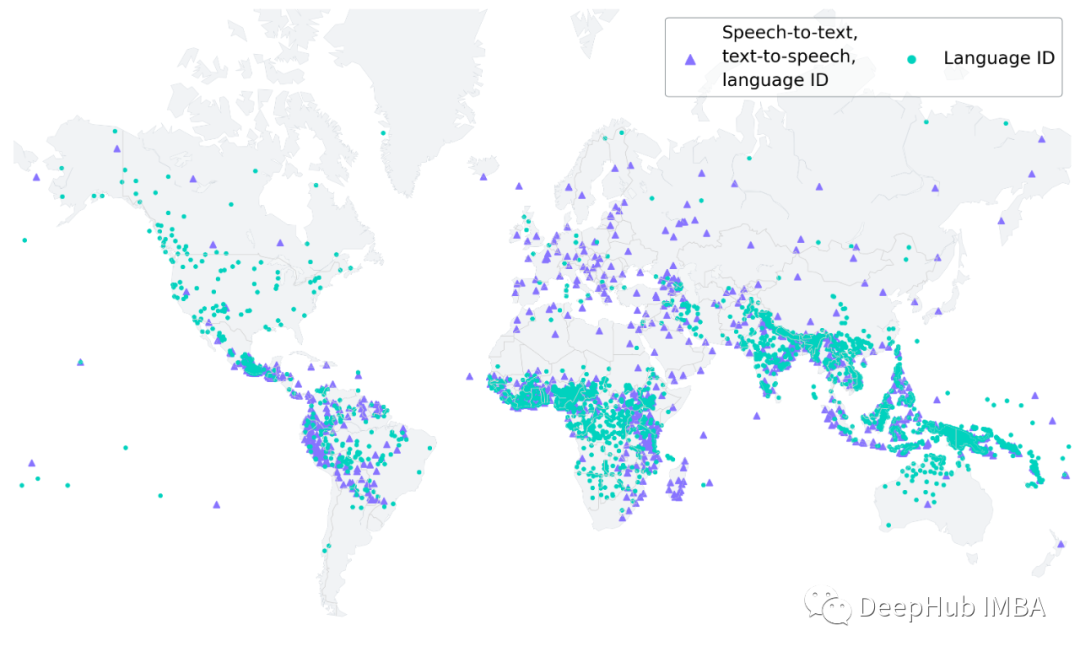

Facebook (Meta) AI 的最新大型多语言语音 (MMS) 项目可以为 1,100 多种语言提供语音转文本、文本转语音等功能。这是现有模型的 10 倍!它的官网blog上特别提到了Tatuyo 语,只有几百人在使用。这其实对于日常来说没什么用,但是对于研究来说这是一个很好的例子,因为只有几百人如何找到并有效的提炼数据集呢?

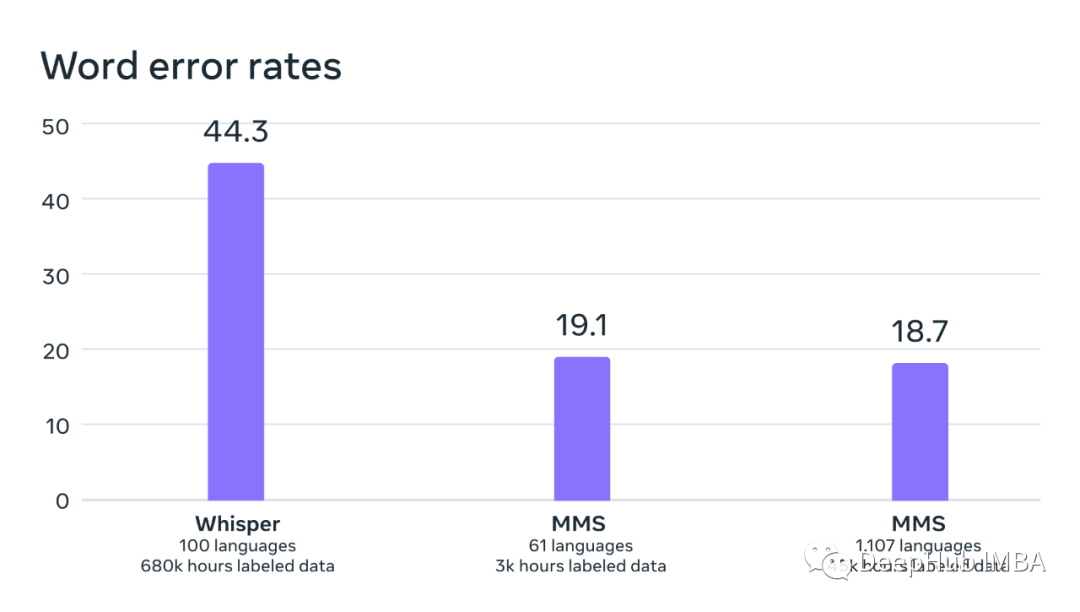

Meta 与 OpenAI 的 Whisper 做了详细的对比,在数据上训练的模型实现了一半的单词错误率,并且训练数据更少:

可以看到它的训练数据只有45k 小时的标注数据,要比Whisper少10倍,而语言支持也多了10倍,这是一个大的提高。在blog中还特意提到了使用了 《圣经》这种流传广泛,翻译语种多的内容作为数据集,我觉得这是一个很好方向。

MMS 项目还利用了 wav2vec 2.0 自监督语音表示学习技术的优势。在 1,400 种语言的大约 500,000 小时的语音数据上进行自监督的训练,明显减少了对标记数据的依赖。然后针对特定的语音任务对生成的模型进行微调,例如多语言语音识别和语言识别。

Whisper 的效果对于我来说就已经非常好了,我也一直在使用他做为语言转文字的工具,如果MMS的效果更好,那对于我们来说简直太棒了,并且MMS还支持 language identification (LID) 也就说可以自动识别所说的语言,但是经过我的测试,这个对于支持这么多种语言的模型来说有一个致命的错误,就是转录或错误解释可能会导致冒犯性或不准确的语言。

还记得大张伟吗,越是准确的模型越会出问题:

这种多语言语音模型的出现使得语言障碍将被打破,来自全球每个角落人们都可以通过声音正常的交流。还记得META烂尾的VR和AR应用吗,我觉得MMS应该是它们VR的一个子项目,VR烂尾很正常,但是这个MMS会为我们带来更多的进步。

最后地址,里面有预训练模型下载和安装方法:

https://github.com/facebookresearch/fairseq/tree/main/examples/mms