整体过程较为顺利,yolov5使用起来非常友好。

yolov5开源网址:

GitHub - ultralytics/yolov5: YOLOv5 🚀 in PyTorch > ONNX > CoreML > TFLite

一、数据集准备

更新后的数据集:🍞正在为您运送作品详情

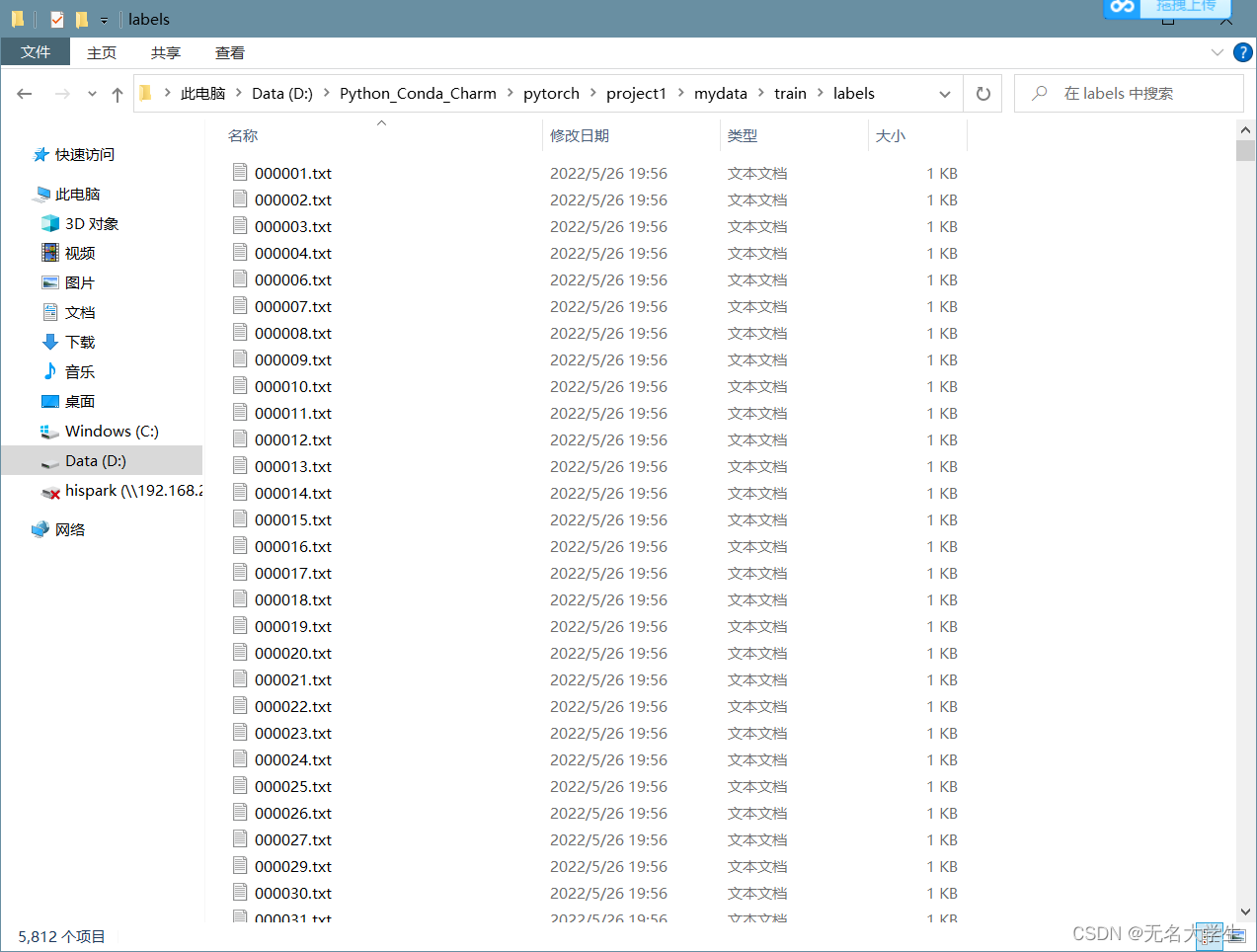

上面这个链接里的数据集源于KITTI,数据已处理,可以直接使用,已经改成darknet需要的数据格式,可直接用于yolov5。

共5个G,6600左右张图片,只保留了car类型。

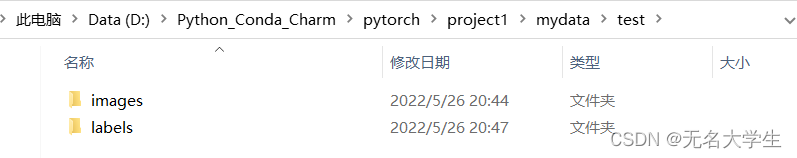

里面

每个文件夹中对应图片和标签

txt内部格式:

原文:

我的数据集:

,

,

valid中也是,需要注意的labels必须是txt文件

labelme生成的可能是json或xml,用python脚本提取信息并转换。

二、项目配置

1、安装pytorch和cuda,并创建新项目

可参考这个视频:

Windows安装Anaconda,创建pytorch环境,pycharm配置环境_无名大学生的博客-CSDN博客

建议环境配置后,把这个yolov5文件夹放进去,这样之后所有需要这个环境的就直接在这个项目中创建或运行即可。

2、安装所需要的库

yolov5-master中有个requirements.txt

在终端中输入:

pip install -r requirements.txt

pycharm会自动帮你安装所需要的库,非常方便

3、运行detect.py验证

运行成功会生成 runs 文件夹

可以看到结果:

4、修改yolov5命令行参数

根据我们训练的要求,修改命令行参数,在 train.py

只需要修改三个地方:

第一个参数yolov5s是在models里s、m、l几种不同大小的网络模型,s是最基础的也是跑起来最快的,选择一种。

同时在对应的yaml中修改分类数

第二个参数mydata.yaml,这是需要自己新建的

前两行是路径,后为分类数,和各自标签。

我的数据集是放在:

三、开始训练

运行train.py,开始训练

四、训练结果

训练后会生成runs,里面的train文件夹中是训练结果,有这么多东西

weights中best.pt是最好的结果的权重,用它来做测试

修改detect.py中的命令行参数

把需要测试的图片放在data/images中,生成的结果还是在runs/detect/中

注意的是,yolov5给了丰富的接口

直接放mp4也可以,他会自己截成一帧帧再检测,最后再换你一个mp4

over

版权归原作者 无名大学生 所有, 如有侵权,请联系我们删除。