Apache Spark简介

Apache Spark是一个用于大规模数据处理的开源统一分析引擎,由加州大学伯克利分校AMPLab开发并于2010年开源。作为一个通用的大数据处理平台,Spark提供了高性能的内存计算能力和丰富的数据处理API,支持批处理、流处理、机器学习、图计算等多种应用场景。

自开源以来,Spark迅速成为大数据处理领域最受欢迎的开源项目之一。据统计,目前已有超过2000名贡献者参与Spark的开发,包括80%的财富500强公司在内的数千家企业都在使用Spark进行大规模数据分析。Spark强大的功能和广泛的应用使其成为当今最重要的大数据处理框架之一。

Spark的核心特性

Spark具有以下几个核心特性,使其成为大数据处理的理想选择:

- 统一的计算引擎:Spark提供了统一的计算引擎,可以支持批处理、流处理、机器学习、图计算等多种应用场景。用户可以在同一个程序中无缝地组合使用这些不同类型的处理。

- 内存计算:Spark基于内存计算,中间结果存储在分布式内存中,大大提高了数据处理速度。相比于MapReduce等基于磁盘的计算框架,Spark在迭代计算场景下可以提供10-100倍的性能提升。

- 丰富的API:Spark为Scala、Java、Python和R语言提供了丰富的API,同时还提供了SQL接口,方便不同背景的开发人员使用。

- 易用性:Spark提供了80多个高级算子,大大简化了分布式程序的编写。用户可以轻松地使用这些算子来表达复杂的数据处理逻辑。

- 通用性:Spark可以运行在多种集群管理器上(如Hadoop YARN、Apache Mesos等),并且支持从多种数据源(如HDFS、HBase、Cassandra等)读取数据。

- 活跃的生态系统:Spark拥有丰富的生态系统,包括用于结构化数据处理的Spark SQL、用于流处理的Spark Streaming、用于机器学习的MLlib以及用于图计算的GraphX等组件。

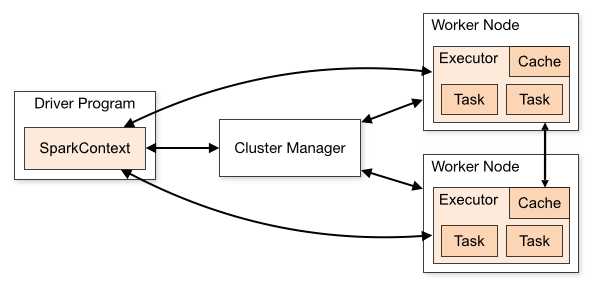

Spark的架构设计

Spark采用了主从架构设计,主要包括以下几个组件:

- Driver Program:驱动程序,负责创建SparkContext,提交作业并协调各个组件的工作。

- Cluster Manager:集群管理器,负责管理集群资源,如YARN、Mesos或Spark自带的Standalone模式。

- Worker Node:工作节点,负责执行具体的计算任务。

- Executor:执行器,运行在工作节点上,负责执行具体的计算任务并缓存数据。

在这个架构中,Driver Program会将用户程序转换为一系列的任务,然后通过Cluster Manager分配资源并将任务分发给各个Worker Node上的Executor执行。Executor之间可以直接通信,大大提高了数据传输效率。

Spark的核心概念

为了更好地理解Spark的工作原理,我们需要了解以下几个核心概念:

- RDD (Resilient Distributed Dataset):弹性分布式数据集,是Spark中最基本的数据抽象,代表一个不可变、可分区、里面的元素可并行计算的集合。

- DataFrame:基于RDD的一种更高级的数据抽象,类似于关系型数据库中的表,具有schema信息。

- Dataset:DataFrame的一种强类型版本,提供了编译时类型检查的能力。

- SparkSession:Spark 2.0引入的统一入口点,用于创建DataFrame、Dataset等。

- Transformation和Action:Spark中的操作分为Transformation(转换)和Action(动作)两种。Transformation操作(如map、filter等)会生成新的RDD,而Action操作(如count、collect等)会触发实际的计算。

Spark的使用方法

使用Spark进行数据处理通常包括以下步骤:

- 创建SparkSession:

from pyspark.sql import SparkSession

spark = SparkSession.builder \

.appName("MySparkApp") \

.getOrCreate()

- 加载数据:

df = spark.read.csv("path/to/data.csv", header=True, inferSchema=True)

- 数据处理:

result = df.filter(df.age > 18) \

.groupBy("department") \

.agg({"salary": "avg"})

- 输出结果:

result.show()

- 关闭SparkSession:

spark.stop()

Spark生态系统

Spark不仅仅是一个计算引擎,它还拥有丰富的生态系统,包括:

- Spark SQL:用于处理结构化数据的模块,提供SQL接口。

- Spark Streaming:用于处理实时流数据的模块。

- MLlib:Spark的机器学习库,提供常用的机器学习算法。

- GraphX:用于图计算的模块。

- SparkR:Spark的R语言接口。

这些组件共同构成了一个强大的大数据处理平台,能够满足各种复杂的数据处理需求。

Spark在大数据生态系统中的地位

作为一个统一的大数据处理平台,Spark在大数据生态系统中占据着重要地位。它能够与多种数据源和存储系统集成,如Hadoop HDFS、Apache Hive、Apache HBase等。同时,Spark还支持多种集群管理器,如Hadoop YARN、Apache Mesos等。

Spark的高性能和易用性使其成为许多企业进行大数据分析的首选工具。在数据科学、机器学习、实时分析等领域,Spark都有着广泛的应用。

Spark的性能优化

尽管Spark已经提供了优秀的性能,但在实际使用中,我们仍然可以通过一些方法来进一步优化Spark应用的性能:

- 合理设置分区:适当的分区数可以提高并行度,充分利用集群资源。

- 缓存重用数据:对于需要多次使用的数据,可以使用cache()或persist()方法将其缓存在内存中。

- 避免shuffle:shuffle操作会导致大量的网络传输,应尽量避免或减少shuffle操作。

- 使用广播变量:对于需要在多个任务中使用的小型只读数据,可以使用广播变量来减少数据传输。

- 调整执行器配置:合理设置执行器的数量和内存大小,可以提高资源利用率。

Spark的未来发展

作为一个活跃的开源项目,Spark正在持续演进和发展。未来的发展方向主要包括:

- 进一步提高性能:通过优化执行引擎、改进内存管理等方式,进一步提高Spark的处理速度。

- 增强与AI/ML的集成:加强与TensorFlow、PyTorch等深度学习框架的集成,提供更强大的机器学习和人工智能能力。

- 改进流处理能力:增强Structured Streaming的功能,提供更灵活和强大的流处理能力。

- 简化API:继续简化API,提高易用性,降低学习门槛。

- 云原生支持:增强与Kubernetes等云原生技术的集成,更好地支持云环境下的部署和使用。

结语

Apache Spark作为一个强大而灵活的大数据处理平台,已经成为大数据领域不可或缺的工具。它的高性能、易用性和丰富的生态系统使其能够适应各种复杂的数据处理需求。无论是批处理、流处理、机器学习还是图计算,Spark都能够提供出色的解决方案。

随着大数据和人工智能技术的不断发展,Spark也在持续演进,不断增强其功能和性能。相信在未来,Spark将继续在大数据处理领域发挥重要作用,为企业和组织提供更强大的数据分析能力。

对于想要进入大数据领域的开发者来说,学习和掌握Spark无疑是一个明智的选择。通过深入了解Spark的原理和使用方法,你将能够更好地应对各种大数据处理挑战,成为一名出色的大数据工程师.

文章链接:www.dongaigc.com/a/apache-spark-unified-analytics-engine

https://www.dongaigc.com/a/apache-spark-unified-analytics-engine

版权归原作者 m0_56734068 所有, 如有侵权,请联系我们删除。