人工智能安全政策与标准

政策文件

大致可分为三类:法律法规和伦理规范、推动产业落地政策以及推动技术创新发展政策

2016年-《“十三五”国家科技创新规划》 重点发展大数据驱动的类人工智能技术方法,在基于大数据分析的类人工智能方向实现重要突破

2017年-新一代人工智能发展规划 → 人工智能上升至国家战略高度

2019年10月-新一代人工智能伦理规范

2019年-人工智能安全标准化白皮书

2021年-人工智能标准化白皮书

2021年4月 人工智能核心技术产业白皮书

第十四个五年规划和2035年远景目标纲要

“发展算法推理训练场景,推动通用化和行业性人工智能开放平台建设”

在前沿基础理论、专用芯片、深度学习框架等前沿领域重点攻关,实现一批具有前瞻性、战略性的国家重大科技项目

2017年-新一代人工智能发展规划

三步战略目标

到2020年人工智能总体技术和应用与世界先进水平同步;

到2025年人工智能基础理论实现重大突破、技术与应用部分达到世界领先水平;(成为带动我国产业升级和经济转型的主要动力)

到2030年人工智能理论、技术与应用总体达到世界领先水平,成为世界主要人工智能创新中心。(智能社会取得明显成效)

提出要求 建立人工智能安全监管和评估体系

加强人工智能对国家安全和保密领域影响的研究和评估,

完善人、技、物、管配套的安全防护体系,构建人工智能安全检测预警机制

2019年-人工智能安全标准化白皮书

加速发展新阶段

三大驱动因素:算法、算力、数据

上升国家战略高度

《新一代人工智能发展规划》

加强人工智能标准框架体系研究;

逐步建立并完善人工智能基础共性、互联互通、行业应用、网络安全、隐私保护等技术标准

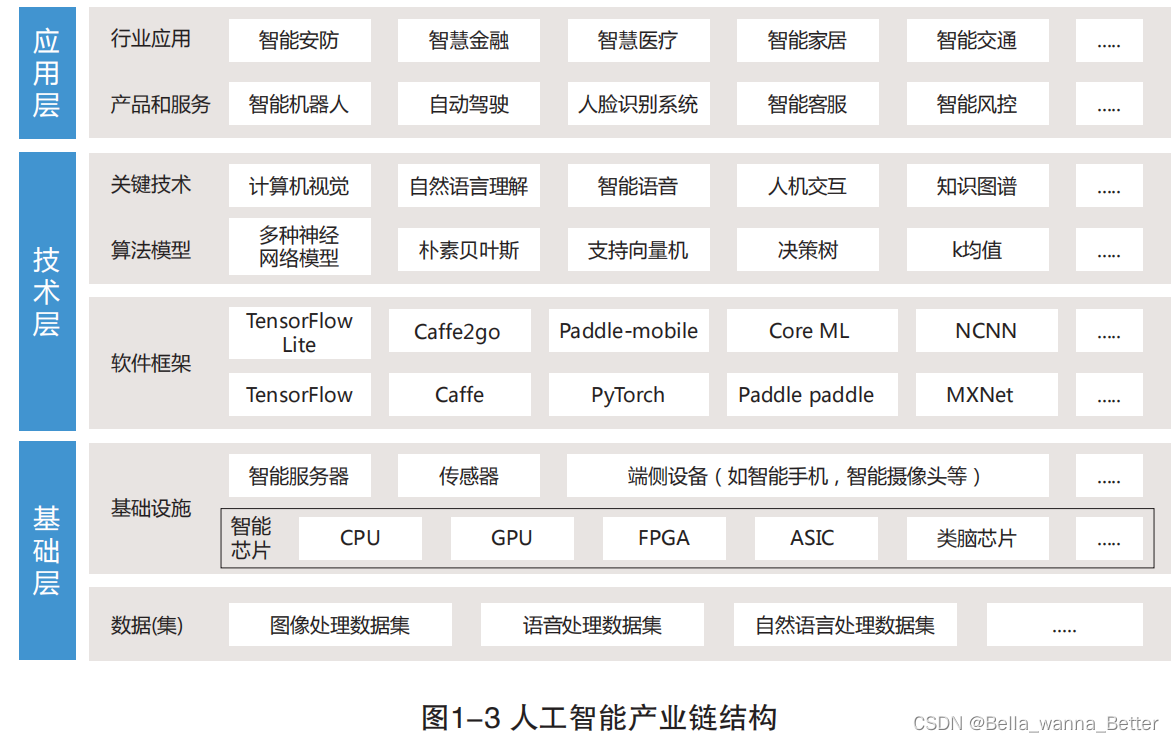

人工智能产业链

基础层、技术层、应用层

人工智能安全风险分析与内涵

白皮书中提到了“人工智能资产”

在企业应用中,的确将人工智能视为一种资产,期望通过人工智能获得一定的效益。

人工智能资产主要由数据、算法模型、基础设施、产品服务及行业应用组成。

1、新的攻击威胁

攻击方法:对抗样本的攻击、数据投毒、模型窃取、人工智能系统攻击

攻击影响:模型的训练、测试和推断过程中均可能遭受攻击;危害数据和模型的机密性、完整性和可用性。

2、人工智能安全隐患

①算法模型安全隐患:算法是人写的,模型也是人写的,极易存在缺陷。

准确性和鲁棒性平衡、数据依赖、实时场景下的可靠性挑战;

数据偏见;

“黑箱特征”:可解释性和透明性不足

②数据安全与隐私保护隐患:采集数据、使用数据、存储数据都不同程度的滥用泄露。

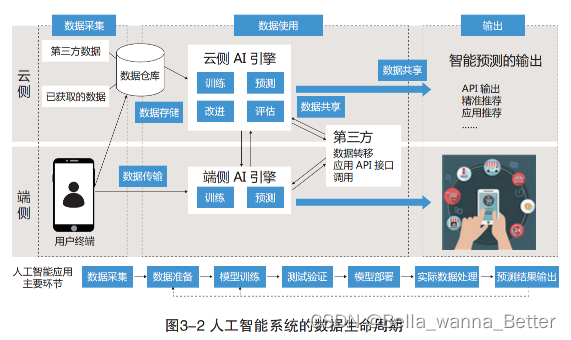

这里提到了人工智能数据生命周期的概念

③基础设施安全隐患:基础设施定义为人工智能产品和应用依赖的软硬件。

开源算法、软件框架(Pytorch\Tensorflow)、芯片、服务设备、端侧算力....

系统的复杂运行环境和潜在状态

④应用安全隐患:自动驾驶(黑客远程入侵控制导致撞车)、生物特征识别(小学生用照片成功忽悠人脸识别)、智能音箱等等。

⑤人工智能滥用:利用语音合成技术假扮受害人亲属实施诈骗、人工智能技术破解登录验证码的效果越来越好、且难以防范、利用人工智能技术模仿人类,如换脸、手写伪造、人声伪造、聊天机器人。

安全影响:

国家安全影响:人工智能可用于构建新型军事打击力量,对国防安全造成威胁。

社会伦理挑战:就业影响;社交影响;法律体系的冲击(机器事故谁来担责?)

人身安全风险:由于漏洞缺陷或恶意攻击等原因损害人身安全

(智能医疗设备、无人汽车、自动武器)

人工智能安全内涵

- 人工智能安全属于网络安全的一部分

- 该白皮书依据《网络安全法》对网络安全的定义,定义了人工智能安全

- 人工智能安全是指通过采取必要措施,防范对人工智能系统的攻击、侵入、干扰、破坏和非法使用以及意外事故,使人工智能系统处于稳定可靠运行的状态,以及遵循人工智能以人为本、权责一致等安全原则,保障人工智能算法模型、数据、系统、产品应用的完整性、保密性、可用性、鲁棒性、透明性、公平性和隐私的能力。---采取 措施防范 安全风险目标 系统稳定可靠运行遵循 安全原则保障 人工智能资产的8个安全属性---

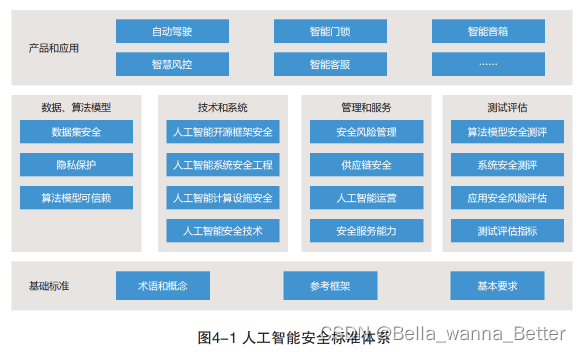

人工智能安全标准体系

人工智能实践

B.1 百度人工智能安全实践:整体解决方案——AdvBox,对抗样本的增强。

B.2 猎户星空人工智能安全实践:豹小秘、豹花瓶等产品,严格按照各种技术要求进行平台建设。

B.3 清华大学人工智能安全实践:人工智能对抗性攻防,RealSafe是开源标准程序库,业界可以免费对其进行非商业用途使用 B.4 依图人工智能安全应用实践:典型人工智能安全问题,依图提出了人工智能系统安全技术的相关要求与解决方案。依图将人工智能系统分为了设备要素和网络要素两大要素的安全

B.5 IBM人工智能安全实践:人工智能三原则,人工智能公平360工具箱”(AIF360);AIF360可帮助检测、缓解或消除机器学习模型中的偏见 B.6 深信服人工智能安全实践:深信服安全云脑具备威胁情报和未知威胁检测能力

B.7 360 人工智能安全实践:360通过基于人工智能分析的360“安全大脑”,打造智能交通安全动态防御体系,全面保障智能交通安全 B.8 阿里巴巴人工智能安全实践:实人认证、问答型对抗验证码 B.9 华为人工智能安全实践:华为结合人工智能技术提出了防偷窥和用户隐私保护的解决方案。手机利用人工智能技术可以检测到是否存在机主/非机主、多人注视屏幕的情况,当手机识别出有陌生人或多人注视屏幕时,会将手机屏幕显示的私密信息自动 隐藏,以便保护用户的隐私信息

2021年-人工智能标准化白皮书

AI产业链

人工智能产业链包括基础层、技术层和应用层

基础层:数据、算力

技术层:各类算法与深度学习技术,通过深度学习框架和开放平台实现对技术和算法的封装

应用层:人工智能技术与各个行业的深度融合

基础层

华为、寒武纪、中星微 推理芯片产品

- 问题

硬件指令集、标准规范

使能软件与硬件的兼容性和融合程度

数据规范

- 趋势芯片与应用场景结合的产业生态高效利用数据

技术层

- 问题

泛化型弱,技术瓶颈

深度学习框架生态建设程度不够。在算法、芯片、终端和场景应用方面都依赖国外的深度学习框架生态。

人工智能测试体系不够全面

「一是测试重复度高。现有测试基准的测试内容和模型重复度高,但又有遗漏;

二是体系化设计与建设有待加强,尚未形成成熟的功能、性能测试基准;

三是人工智能测试标准体系还未形成,公平性和权威性有待完善。」

人工智能产业生态

基础层

基础层按照服务的线条被划分成芯片服务、云服务、机器学习平台和数据服务等,它们都是整个 AI 行业最底层服务提供者;

在基础层,讯飞的开放平台、百度大脑、腾讯云是我们接触比较多的机器学习平台,阿里云、百度云是做得比较好的云服务提供商。

技术层

在技术层,按照技术类别分为计算机视觉、语音识别、自然语言处理、知识图谱等;

在技术层,有我们熟悉的“视觉四小龙”(商汤、依图、云从、旷视),主要是提供计算机视觉服务,最常见的应用场景就是人脸识别了;还有科大讯飞、云知声、思必驰等,主要提供语音识别、语音合成、语音分析等服务。

应用层

在应用层,按行业分为零售、金融、教育、工业、互联网、医疗、安防、政务、交通、自主无人系统等;

在应用层,有我们熟悉些大疆无人机、京东的零售、滴滴打车服务、字节跳动的头条推荐等。

全链服务

除了以上讲的几个层,在整个 AI 产业生态中,BAT 等大厂还提供了全链条的服务,它们既做了最底层的基础服务,比如云服务、机器学习平台;也做技术层,比如 BAT 也有自家的计算机视觉、语音识别等能力;同时,它们也有应用层的整套方案,比如百度大脑。

版权归原作者 Bella_wanna_Better 所有, 如有侵权,请联系我们删除。