datadir=/var/lib/mysql

#bind-address=127.0.0.1

定义清除过期日志的时间(这里设置为7天)

expire_logs_days=7

设置client连接mysql时的字符集,防止乱码

init_connect=‘SET NAMES utf8mb4’

是否对sql语句大小写敏感,1表示不敏感

lower_case_table_names=1

执行sql的模式,规定了sql的安全等级, 暂时屏蔽,my.cnf文件中配置报错

#sql_mode=STRICT_TRANS_TABLES,NO_AUTO_CREATE_USER,NO_ENGINE_SUBSTITUTION

事务隔离级别,默认为可重复读,mysql默认可重复读级别(此级别下可能参数很多间隙锁,影响性能)

transaction_isolation=READ-COMMITTED

TIMESTAMP如果没有显示声明NOT NULL,允许NULL值

explicit_defaults_for_timestamp=true

#它控制着mysqld进程能使用的最大文件描述(FD)符数量。

#需要注意的是这个变量的值并不一定是你设定的值,mysqld会在系统允许的情况下尽量获取更多的FD数量

open_files_limit=65535

允许最大连接数

max_connections=200

#最大错误连接数

max_connect_errors=600

[client]

default-character-set=utf8mb4 # 设置mysql客户端默认字符集

### 启动mysql命令【脚本命令】

docker-compose -f /Users/shenyijie/data/docker-file/mysql-docker.yml -p mysql up -d

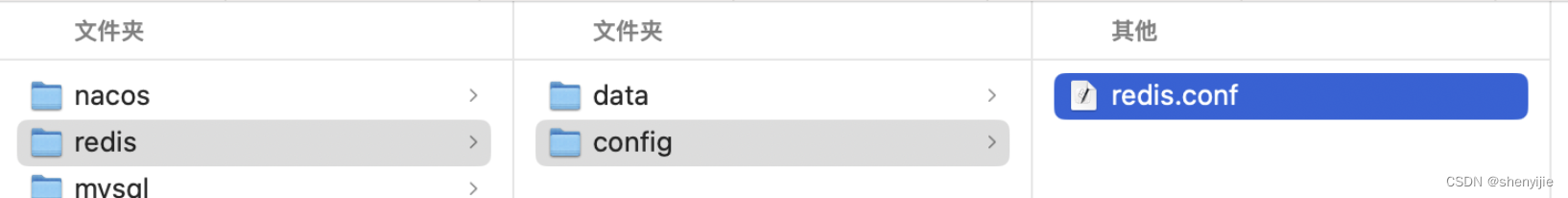

## 2、docker部署redis

`提示:主要包括redis配置文件redis.conf; redis-docker.yml`

### redis-docker.yml【docker-compose文件】

version: “3”

services:

cc-redis:

restart: always

image: redis:6.2.7

container_name: cc-redis

restart: always

hostname: cc-redis

environment:

REDIS_PASSWORD: X2I^KH!v

TZ: Asia/Shanghai

ports:

- “6379:6379”

volumes: - ‘/etc/localtime:/etc/localtime:ro’

- ‘/Users/shenyijie/data/soft/redis/config/redis.conf:/etc/redis/redis.conf:rw’

- ‘/Users/shenyijie/data/soft/redis/data:/data:rw’

command:

redis-server /etc/redis/redis.conf --appendonly yes

### redis.conf【配置信息】

开启保护

protected-mode yes

绑定监听IP地址

bind 0.0.0.0

自定义密码

#requirepass X2I^KH!v

port 6379

timeout 0

900s内至少一次写操作则执行bgsave进行RDB持久化

save 900 1

save 300 10

save 60 10000

rdbcompression yes

dbfilename dump.rdb

dir /data

appendonly yes

appendfsync everysec

### redis启动命令【脚本命令】

docker-compose -f /Users/shenyijie/data/docker-file/redis-docker.yml -p redis up -d

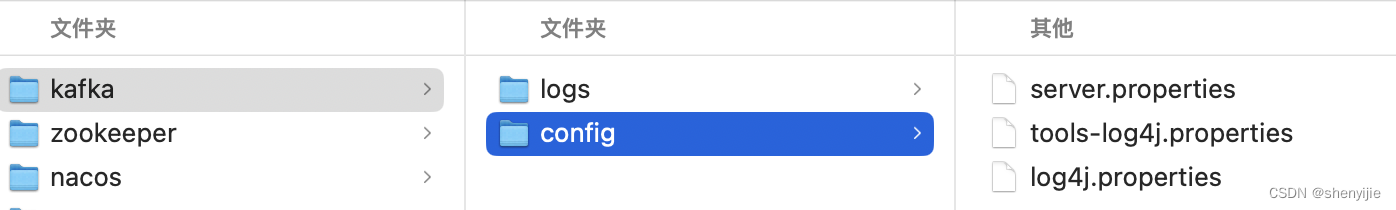

## docker部署kafka

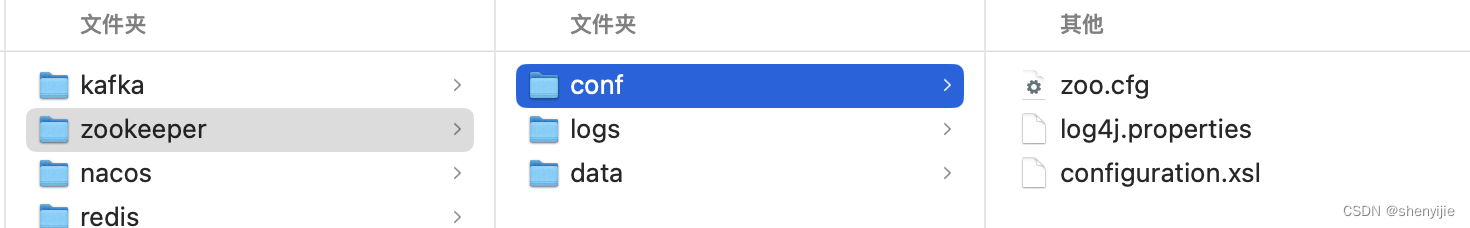

`提示:由于kafka3.0以下版本依赖zookeeper,所以本脚本一键部署,包含zookeeper。`

zookeeper配置:zoo.cfg

kafka配置:server.properties

### kafka-docker.yml【docker-compose文件】

version: “3”

services:

cc-zookeeper:

restart: unless-stopped

image: wurstmeister/zookeeper:latest

container_name: cc-zookeeper

hostname: cc-zookeeper

privileged: true

ports:

- “2181:2181”

volumes: - “/Users/shenyijie/data/soft/zookeeper/conf:/opt/zookeeper/conf:rw”

- “/Users/shenyijie/data/soft/zookeeper/data:/opt/zookeeper/data:rw”

- “/Users/shenyijie/data/soft/zookeeper/logs:/opt/zookeeper/datalog:rw”

kafka:

restart: unless-stopped

image: wurstmeister/kafka:latest

container_name: cc-kafka

privileged: true

depends_on:

- cc-zookeeper

environment:

KAFKA_BROKER_ID: 0

KAFKA_ZOOKEEPER_CONNECT: cc-zookeeper:2181

KAFKA_ADVERTISED_HOST_NAME: localhost

KAFKA_LISTENERS: PLAINTEXT://0.0.0.0:9092

TZ: Asia/Shanghai

volumes: - “/Users/shenyijie/data/soft/kafka/config:/opt/kafka/config”

- “/Users/shenyijie/data/soft/kafka/logs:/opt/kafka/logs”

- “/Users/shenyijie/data/soft/kafka:/kafka”

ports: - “9092:9092”

### zookeeper配置zoo.cfg【配置信息】

心跳间隔

tickTime=2000

初始化客户端连接时间

initLimit=10

最长不能超过多少个tickTime的时间长度,总的时间长度就是5*2000=10秒。

syncLimit=5

dataDir=/opt/zookeeper/data

dataLogDir=/opt/zookeeper/datalog

the port at which the clients will connect

clientPort=2181

保留3个快照数量

autopurge.snapRetainCount=3

每3小时清除一次日志

autopurge.purgeInterval=1

#使用外网ip时本机zookeeper的ip地址应该配置成0.0.0.0:2888:3888

#server.1=0.0.0.0:2888:3888

#server.2=xxx.xxx.xxx.160:2888:3888

版权归原作者 2401_85155180 所有, 如有侵权,请联系我们删除。