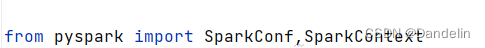

前景提要:在学习黑马程序员python课程的pyspark实战部分时按照下图导入pysark包时发现sparkconf和sparkcontext无法找到,报错为Cannot find reference 'Sparkconf/Sparkcontext' in 'pyspark.py',在网上搜索尝试一系列方法后并未解决。

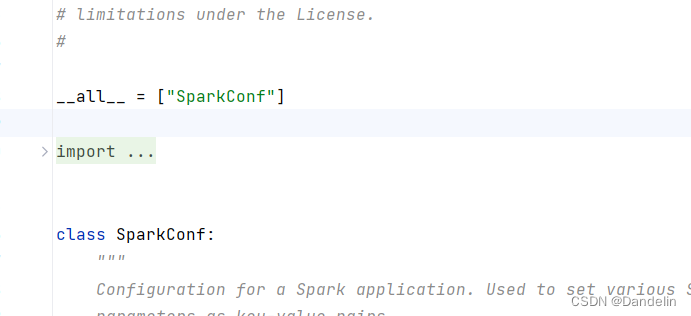

解决过程:通过everything软件快捷搜索磁盘找到pyspark目录,发现有conf.py和context.py两个文件,猜测与导入的包有关联,用pycharm打开conf.py发现在其中创建了Sparkconf的类

解决方法1:直接将将源py文件的from pyspark import Sparkconf,Sparkcontext改为 from pyspark import conf,context 成功

解决方法2:找到conf.py和context.py文件使用pycharm打开后,关闭pycharm再次打开,发现

from pyspark import Sparkconf,Sparkcontext 可以成功使用

问题分析:怀疑是pycharm未加载到conf.py和context.py文件中相关的函数

版权归原作者 Dandelin 所有, 如有侵权,请联系我们删除。