以下操作需要科学上网

一、获取模型

有两种方式,首先你要拥有一个Google账户用于登陆Google云端硬盘

1.使用他人提供的模型链接直接在Google云端硬盘中添加快捷连接(推荐)

现在你的Google云端硬盘新建一个文件夹命名为stableckpt

模型连接

当你点击模型连接后应当是下面这个情况:

随后右击图片中的stableckpt,随后应为下图

点击其中的将快捷方式添加到云端硬盘,随后应为下图

选择我的云端硬盘,单击添加快捷方式即可。

但是缺点是模型数量少,只有两个,若是要选择多种模型请参照方法2

2.自己上传模型到Google云端硬盘

全部模型

在这个分享文件中,有许多模型文件,其中animevae.pt和modules文件是必需的,剩下的可以根据需要进行上传(注意所有文件都要在stableckpt此文件名下,stableckpt在云盘根目录下)

文件路径如下图

二、colab上进行操作

第一步:加载Google云盘

from google.colab import drive

drive.mount('/content/drive')

运行后,选择你登陆Google云端硬盘的账户即可

第二步:克隆git仓库

!git clone https://github.com/alphanemeless/stable-diffusion-webui.git -b static_branch

%cd stable-diffusion-webui

第三步:安装依赖

!COMMANDLINE_ARGS="--exit" REQS_FILE="requirements.txt" python launch.py

第四步:部署模型

!cp /content/drive/MyDrive/stableckpt/animefull-final-pruned/model.ckpt /content/stable-diffusion-webui/models/Stable-diffusion/final-pruned.ckpt

!cp /content/drive/MyDrive/stableckpt/animevae.pt /content/stable-diffusion-webui/models/Stable-diffusion/final-pruned.vae.pt

!mkdir /content/stable-diffusion-webui/models/hypernetworks

!cp -r /content/drive/MyDrive/stableckpt/modules/modules/* /content/stable-diffusion-webui/models/hypernetworks

!rm /content/stable-diffusion-webui/repositories/stable-diffusion/configs/stable-diffusion/v1-inference.yaml

!cp /content/drive/MyDrive/stableckpt/animefull-final-pruned/config.yaml /content/stable-diffusion-webui/repositories/stable-diffusion/configs/stable-diffusion/v1-inference.yaml

在各种模型文件夹中,其模型命名都为model.ckpt和config.yaml,所以如需更改模型只需将上述代码第一行和第五行中的模型名称更改即可(上面的为animefull-final-pruned,可以替换成其它的例如animesfw-latest)

第五步:进行部署

!COMMANDLINE_ARGS="--deepdanbooru --share --gradio-debug --gradio-auth me:qwerty" REQS_FILE="requirements.txt" python launch.py

上述代码中me:qwerty为可以更改内容,代表你一会登陆的账号和密码。格式为账号:密码

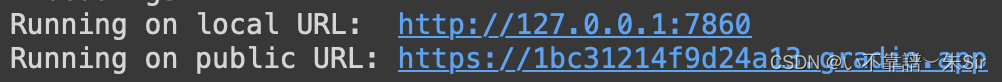

运行后你会看到:

其中需要点击第二个连接将,即public URL,随后出现一个登陆界面,输入账号密码即可。

第六步:进行预测

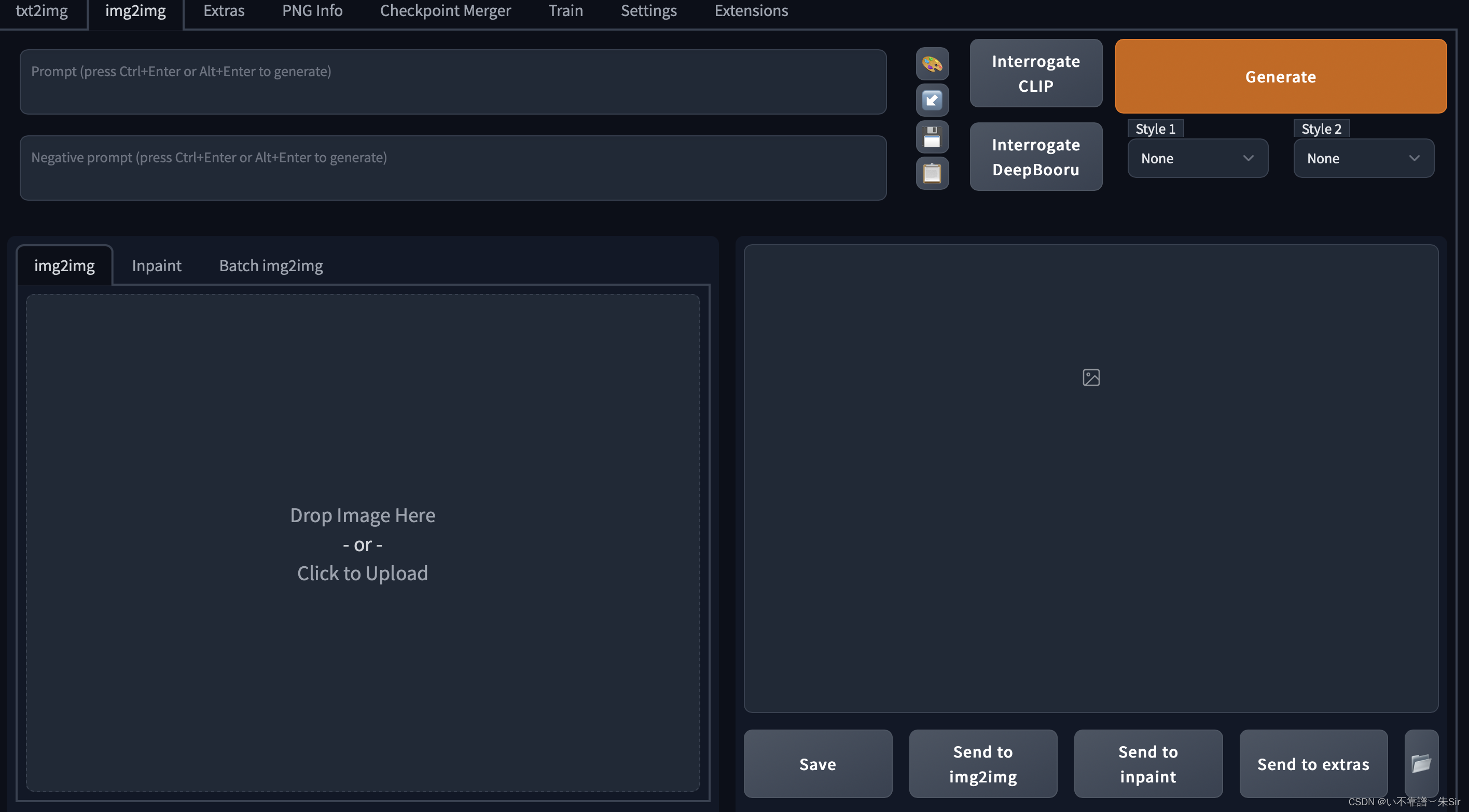

预测界面如下:

txt2img部分

Prompt为输入文字,Negative prompt是你不希望在图像中看到的,Sampling Steps为训练步数,Sampling method为训练方式(默认欧拉), Width Height为图片大小(越大时间越长),Generate即生成。

img2img部分

将你选择的图片上传,并进行训练。(图片设置在页面下面)

推荐一个提供tag的网站

最后

在训练时图片大小尽量不要设置过大,10241024左右比较好,直接拉满会大概率卡死出不来图片(至少我是这样,白浪费了20多分钟)。默认512512生成后,可以超分辨率到比较清晰的图片,给大家放两张图片。第一张是novelai直接生成的,第二张是用adobe超分辨率生成的,第三张是使用Real-ESRGAN超分辨率生成的(不知道csdn压不压缩画质...)。

如果看的人多的话,我试试在国内云平台上部署一下😄

版权归原作者 い不靠譜︶朱Sir 所有, 如有侵权,请联系我们删除。