一、拉取镜像

docker pull elasticsearch:7.2.0

docker pull mobz/elasticsearch-head:5

docker pull kibana:7.2.0

docker pull logstash:7.2.0

二、 运行容器

-p (小写)映射端口号,主机端口:容器端口

-P(大写)随机为容器指定端口号

-v 进行容器的挂载

–name 指定容器别名

–net 连接指定网络

-e 指定启动容器时的环境变量

-d 后台运行容器

–privileged=true 使容器有权限挂载目录

ElasticSearch 的默认端口是 9200,把宿主环境 9200 端口映射到 Docker 容器中的 9200 端口,容器命名为 es。

docker run -d --restart=always --name es -p 9200:9200 -p 9300:9300 -e "discovery.type=single-node" elasticsearch:7.2.0

三、 配置跨域

3.1 进入容器

docker exec -it es /bin/bash

3.2 进行配置

# 进入配置文件夹

cd config

# 修改配置文件

vi elasticsearch.yml

# 加入跨域配置

http.cors.enabled: true

http.cors.allow-origin: "*"

3.3 重启容器

由于修改了配置,因此需要重启 ElasticSearch 容器。

docker restart es

3.4 访问

四、 运行 kibana 容器

docker run -d --restart=always --name kibana --link es:elasticsearch -p 5601:5601 kibana:7.2.0

4.1 设置中文

# 进入容器

docker exec -it kibana /bin/bash

# 进入配置文件夹

cd config

# 修改配置文件

vi kibana.yml

# 修改elasticsearch连接(如果是本机部署,ip需填写内网ip)

elasticsearch.hosts: [ "http://elasticsearch的ip地址:端口号" ]

# 加入中文配置(保存后重启kibana)

i18n.locale: "zh-CN"

4.2 安装ik分词器

安装ik分词器,下载ik.zip(

版本必须和elasticsearch相同)

https://github.com/medcl/elasticsearch-analysis-ik/releases

# 下载ik分词器

https://github.com/medcl/elasticsearch-analysis-ik/releases/download/v7.2.0/elasticsearch-analysis-ik-7.2.0.zip

# 解压后通过ftp上传到服务器下

# 将这个文件夹拷贝到elasticsearch中

docker cp /home/silence/elk/ik es:/usr/share/elasticsearch/plugins

# 查看是否拷贝成功,进入elasticsearch/plugins/ik中:

docker exec -it es /bin/bash

cd /usr/share/elasticsearch/plugins

ls

cd ik

ls

# 重新启动elasticsearch容器

docker restart es

五、 运行 Head 容器

docker run -d --restart=always --name es_head -p 9100:9100 mobz/elasticsearch-head:5

转载:Docker 简单部署 ElasticSearch

六、 安装 LogStash

docker pull logstash:7.2.0

docker run -d --restart=always --name logstash -p 5044:5044 -p 9600:9600 logstash:7.2.0

6.1 进入容器

docker exec -it logstash /bin/bash

6.2 修改 config 下的 logstash.yml 文件,主要修改 es 的地址(如果是本机部署,ip需填写内网ip):

vi config/logstash.yml

http.host: "0.0.0.0"

xpack.monitoring.elasticsearch.hosts: [ "http://elasticsearch的ip:端口号" ]

# 保存退出

:wq

6.3 修改 pipeline 下的 logstash.conf 文件:

vi pipeline/logstash.yml

input {

tcp {

mode => "server"

host => "0.0.0.0" # 允许任意主机发送日志

port => 5044

codec => json_lines # 数据格式

}

}

output {

elasticsearch {

hosts => ["http://elasticsearch的ip:端口号"] # ElasticSearch 的地址和端口(如果是本机部署,ip需填写内网ip)

index => "elk" # 指定索引名

codec => "json"

}

stdout {

codec => rubydebug

}

}

# 保存退出

:wq

6.4 查看日志

docker logs -f logstash

6.5 重新启动elasticsearch容器

docker restart logstash

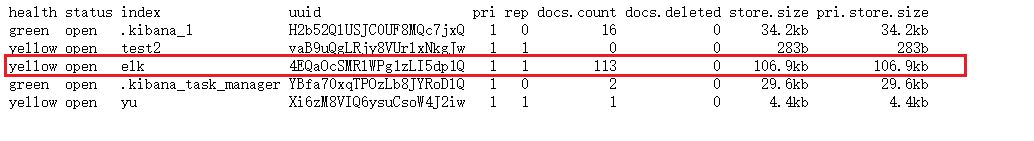

6.6 查看es是否获取数据

http://localhost:9200/_cat/indices?v

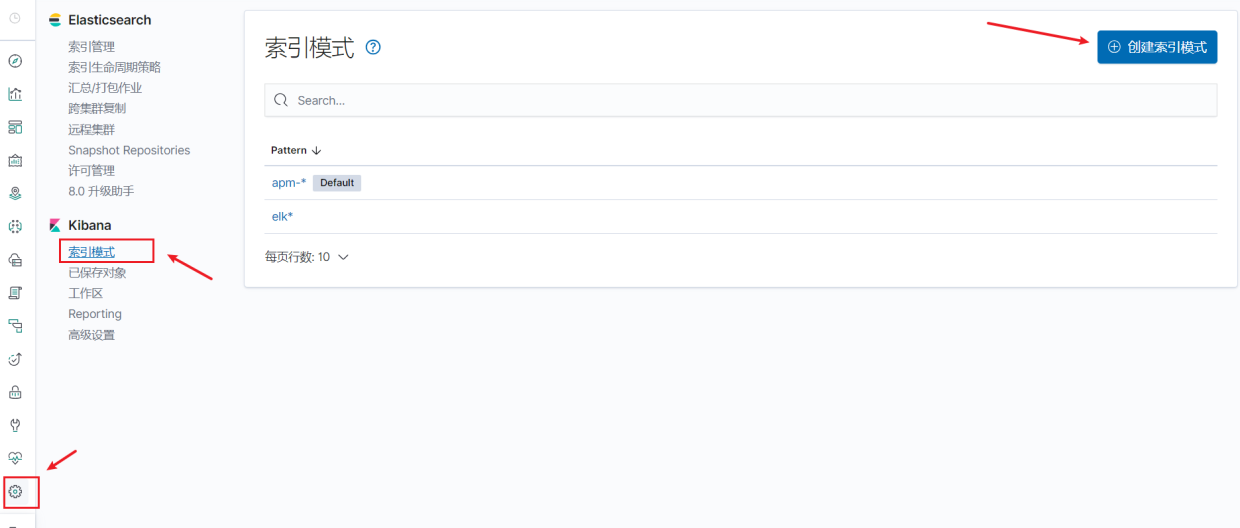

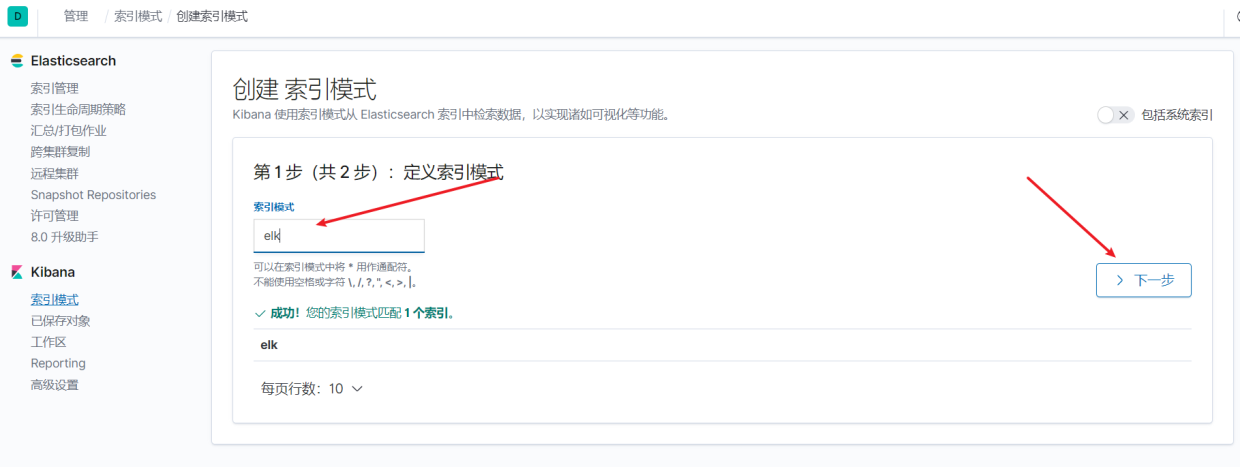

6.7 Kibana新建索引模式

转载:Docker快速搭建部署ELK实战详解

转载:Docker安装ELK详细步骤

七、Springboot通过log4j2+logstash整合日志

7.1

pom.xml

文件中增加log4j2相关依赖

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

<exclusions><!-- 去掉logback配置 -->

<exclusion>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-logging</artifactId>

</exclusion>

</exclusions>

</dependency>

<!--log4j2 相关版本最好选择最新版本-->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-log4j2</artifactId>

</dependency>

7.2

application-dev.yml

引入log4j2.xml日志配置文件

# log4j2日志配置文件

logging:

config: classpath:config/log4j2-dev.xml

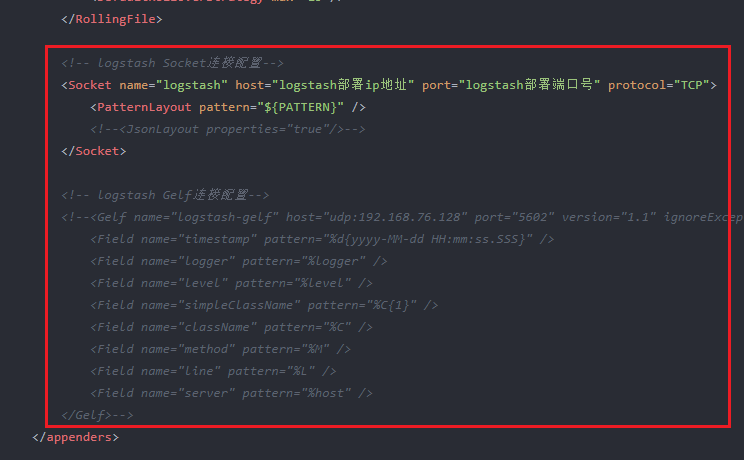

7.3

log4j2-dev.xml

文件配置

logstash两种连接方式:

Socket连接

/

Gelf连接

<?xml version="1.0" encoding="UTF-8"?>

<!--Configuration后面的status,这个用于设置log4j2自身内部的信息输出,可以不设置,当设置成trace时,你会看到log4j2内部各种详细输出-->

<!--monitorInterval:Log4j能够自动检测修改配置 文件和重新配置本身,设置间隔秒数-->

<configuration monitorInterval="5">

<!--日志级别以及优先级排序: OFF > FATAL > ERROR > WARN > INFO > DEBUG > TRACE > ALL -->

<!--变量配置-->

<Properties>

<!-- 格式化输出:%date表示日期,%thread表示线程名,%-5level:级别从左显示5个字符宽度 %msg:日志消息,%n是换行符-->

<!-- %logger{36} 表示 Logger 名字最长36个字符 -->

<property name="LOG_PATTERN" value="%d{yyyy-MM-dd HH:mm:ss.SSS} [%thread] [%p] [%c:%L] --- %m%n" />

<Property name="PATTERN">{"host": "%host", "logger": "%logger", "level": "%level", "message": "[%thread] [%c:%L] --- %message"}%n</Property>

<!-- 定义日志存储的路径,不要配置相对路径 -->

<property name="FILE_PATH" value="C:/springSecurity/" />

<property name="FILE_NAME" value="securitylog" />

</Properties>

<appenders>

<console name="Console" target="SYSTEM_OUT">

<!--输出日志的格式-->

<PatternLayout pattern="${LOG_PATTERN}"/>

<!--控制台只输出level及其以上级别的信息(onMatch),其他的直接拒绝(onMismatch)-->

<ThresholdFilter level="Debug" onMatch="ACCEPT" onMismatch="DENY"/>

</console>

<!--文件会打印出所有信息,这个log每次运行程序会自动清空,由append属性决定,适合临时测试用-->

<File name="Filelog" fileName="${FILE_PATH}/test.log" append="false">

<PatternLayout pattern="${LOG_PATTERN}"/>

</File>

<!-- 这个会打印出所有的info及以下级别的信息,每次大小超过size,则这size大小的日志会自动存入按年份-月份建立的文件夹下面并进行压缩,作为存档-->

<RollingFile name="RollingFileInfo" fileName="${FILE_PATH}/info.log" filePattern="${FILE_PATH}/${FILE_NAME}-INFO-%d{yyyy-MM-dd}_%i.log.gz">

<!--控制台只输出level及以上级别的信息(onMatch),其他的直接拒绝(onMismatch)-->

<ThresholdFilter level="info" onMatch="ACCEPT" onMismatch="DENY"/>

<PatternLayout pattern="${LOG_PATTERN}"/>

<Policies>

<!--interval属性用来指定多久滚动一次,默认是1 hour-->

<TimeBasedTriggeringPolicy interval="1"/>

<SizeBasedTriggeringPolicy size="10MB"/>

</Policies>

<!-- DefaultRolloverStrategy属性如不设置,则默认为最多同一文件夹下7个文件开始覆盖-->

<DefaultRolloverStrategy max="15"/>

</RollingFile>

<!-- 这个会打印出所有的warn及以下级别的信息,每次大小超过size,则这size大小的日志会自动存入按年份-月份建立的文件夹下面并进行压缩,作为存档-->

<RollingFile name="RollingFileWarn" fileName="${FILE_PATH}/warn.log" filePattern="${FILE_PATH}/${FILE_NAME}-WARN-%d{yyyy-MM-dd}_%i.log.gz">

<!--控制台只输出level及以上级别的信息(onMatch),其他的直接拒绝(onMismatch)-->

<ThresholdFilter level="warn" onMatch="ACCEPT" onMismatch="DENY"/>

<PatternLayout pattern="${LOG_PATTERN}"/>

<Policies>

<!--interval属性用来指定多久滚动一次,默认是1 hour-->

<TimeBasedTriggeringPolicy interval="1"/>

<SizeBasedTriggeringPolicy size="10MB"/>

</Policies>

<!-- DefaultRolloverStrategy属性如不设置,则默认为最多同一文件夹下7个文件开始覆盖-->

<DefaultRolloverStrategy max="15"/>

</RollingFile>

<!-- 这个会打印出所有的error及以下级别的信息,每次大小超过size,则这size大小的日志会自动存入按年份-月份建立的文件夹下面并进行压缩,作为存档-->

<RollingFile name="RollingFileError" fileName="${FILE_PATH}/error.log" filePattern="${FILE_PATH}/${FILE_NAME}-ERROR-%d{yyyy-MM-dd}_%i.log.gz">

<!--控制台只输出level及以上级别的信息(onMatch),其他的直接拒绝(onMismatch)-->

<ThresholdFilter level="error" onMatch="ACCEPT" onMismatch="DENY"/>

<PatternLayout pattern="${LOG_PATTERN}"/>

<Policies>

<!--interval属性用来指定多久滚动一次,默认是1 hour-->

<TimeBasedTriggeringPolicy interval="1"/>

<SizeBasedTriggeringPolicy size="10MB"/>

</Policies>

<!-- DefaultRolloverStrategy属性如不设置,则默认为最多同一文件夹下7个文件开始覆盖-->

<DefaultRolloverStrategy max="15"/>

</RollingFile>

<!-- 这个会打印出所有的error及以下级别的信息,每次大小超过size,则这size大小的日志会自动存入按年份-月份建立的文件夹下面并进行压缩,作为存档-->

<RollingFile name="RollingFileDebug" fileName="${FILE_PATH}/debug.log" filePattern="${FILE_PATH}/${FILE_NAME}-ERROR-%d{yyyy-MM-dd}_%i.log.gz">

<!--控制台只输出level及以上级别的信息(onMatch),其他的直接拒绝(onMismatch)-->

<ThresholdFilter level="debug" onMatch="ACCEPT" onMismatch="DENY"/>

<PatternLayout pattern="${LOG_PATTERN}"/>

<Policies>

<!--interval属性用来指定多久滚动一次,默认是1 hour-->

<TimeBasedTriggeringPolicy interval="1"/>

<SizeBasedTriggeringPolicy size="10MB"/>

</Policies>

<!-- DefaultRolloverStrategy属性如不设置,则默认为最多同一文件夹下7个文件开始覆盖-->

<DefaultRolloverStrategy max="15"/>

</RollingFile>

<!-- logstash Socket连接配置-->

<Socket name="logstash" host="logstash部署ip地址" port="logstash部署端口号" protocol="TCP">

<PatternLayout pattern="${PATTERN}" />

<!--<JsonLayout properties="true"/>-->

</Socket>

<!-- logstash Gelf连接配置-->

<!--<Gelf name="logstash-gelf" host="udp:logstash部署ip地址" port="logstash部署端口号" version="1.1" ignoreExceptions="true">

<Field name="timestamp" pattern="%d{yyyy-MM-dd HH:mm:ss.SSS}" />

<Field name="logger" pattern="%logger" />

<Field name="level" pattern="%level" />

<Field name="simpleClassName" pattern="%C{1}" />

<Field name="className" pattern="%C" />

<Field name="method" pattern="%M" />

<Field name="line" pattern="%L" />

<Field name="server" pattern="%host" />

</Gelf>-->

</appenders>

<!--Logger节点用来单独指定日志的形式,比如要为指定包下的class指定不同的日志级别等。-->

<!--然后定义loggers,只有定义了logger并引入的appender,appender才会生效-->

<loggers>

<!--过滤掉spring和mybatis的一些无用的DEBUG信息-->

<logger name="org.mybatis" level="info" additivity="false">

<AppenderRef ref="Console"/>

</logger>

<!--监控系统信息-->

<!--若是additivity设为false,则 子Logger 只会在自己的appender里输出,而不会在 父Logger 的appender里输出。-->

<Logger name="org.springframework" level="info" additivity="false">

<AppenderRef ref="Console"/>

</Logger>

<Logger name="com.security.persisence" level="debug" additivity="false">

<AppenderRef ref="Console"/>

<appender-ref ref="RollingFileDebug"/>

</Logger>

<AsyncLogger name="com.security" level="info" includeLocation="false" >

<!--<appender-ref ref="Console"/>-->

<appender-ref ref="logstash" />

</AsyncLogger>

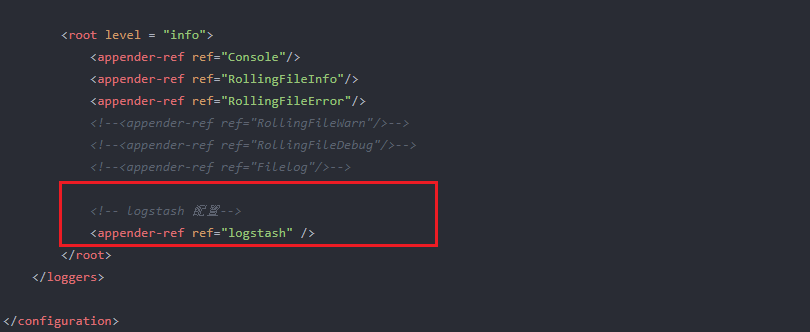

<root level = "info">

<appender-ref ref="Console"/>

<appender-ref ref="RollingFileInfo"/>

<appender-ref ref="RollingFileError"/>

<!--<appender-ref ref="RollingFileWarn"/>-->

<!--<appender-ref ref="RollingFileDebug"/>-->

<!--<appender-ref ref="Filelog"/>-->

<!-- logstash 配置-->

<appender-ref ref="logstash" />

</root>

</loggers>

</configuration>

转载:springboot集成log4j2 + logstash 异步输出日志

转载:Springboot通过log4j2+logstash整合日志到Elasticsearch中

记部署过程中遇到的问题以及解决方法

- 问题1: Kibana 在config/kibana.yaml 中修改host ,把默认的

http://elasticsearch:9200改为http://localhost:9200,启动报错,查看日志:

# docker logs 容器ID, 查看的日志信息:

2023-06-14 16:15:32 {"type":"log","@timestamp":"2023-06-14T08:15:32Z","tags":["warning","elasticsearch","admin"],"pid":1,"message":"No living connections"}

2023-06-14 16:15:32 {"type":"log","@timestamp":"2023-06-14T08:15:32Z","tags":["warning","task_manager"],"pid":1,"message":"PollError No Living connections"}

解决办法:

把

kibana.yaml

里面的host改为主机的真实IP(内网172网段ip)

- 问题2: logstash 修改文件:

config/logstash.yml、pipeline/logstash.yml文件时,把elasticsearch的hosts中的IP地址改为localhost/127.0.0.1时,启动报错,查看日志:

2023-06-14 16:01:53 [2023-06-14T08:01:53,270][WARN ][logstash.outputs.elasticsearch] Attempted to resurrect connection to dead ES instance, but got an error. {:url=>"http://127.0.0.1:9200/", :error_type=>LogStash::Outputs::ElasticSearch::HttpClient::Pool::HostUnreachableError, :error=>"Elasticsearch Unreachable: [http://127.0.0.1:9200/][Manticore::SocketException] Connection refused (Connection refused)"}

解决办法:

把

config/logstash.yml

、

pipeline/logstash.yml

文件里面

elasticsearch

的

hosts

IP地址改为主机的真实IP(内网172网段ip)

filebeat

未完善内容

docker pull docker.elastic.co/beats/filebeat:7.2.0

docker run -d --restart=always --name filebeat docker.elastic.co/beats/filebeat:7.2.0

版权归原作者 SILENCE_SPEAKS 所有, 如有侵权,请联系我们删除。