hadoop完全分布式集群搭建

本次搭建完全分布式集群用到的环境有:

jdk1.8.0

hadoop-2.7.7

本次搭建集群所需环境也给大家准备了,下载链接地址:https://share.weiyun.com/dk7WgaVk

密码:553ubk

本次完全分布式集群搭建需要提前建立好三台虚拟机,我分别把它们的主机名命名为:master,slave1,slave2

一.配置免密登陆

首先我们要实现三台虚拟机之间相互的ssh免密登陆

在master虚拟机上进行操作:

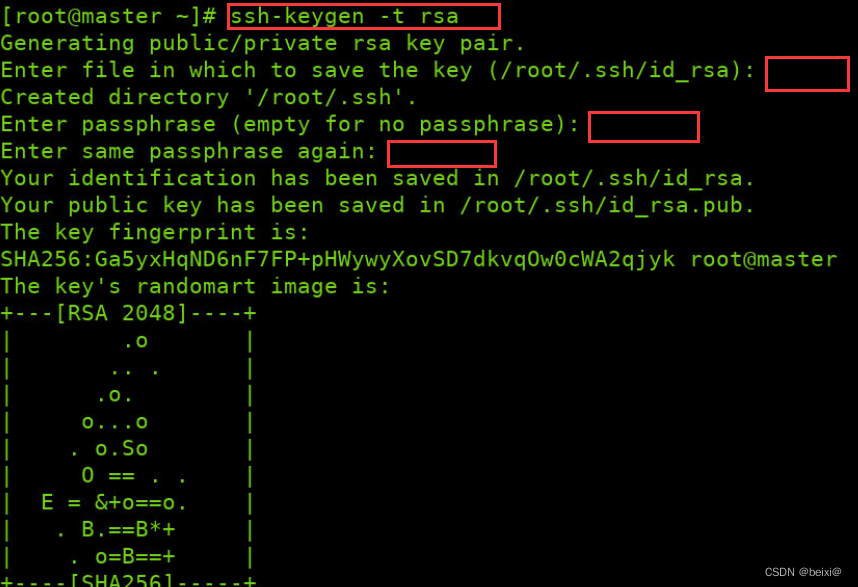

1. 创建ssh秘钥,输入如下命令,生成公私密钥,下方三个红框内都按回车键

ssh-keygen -t rsa

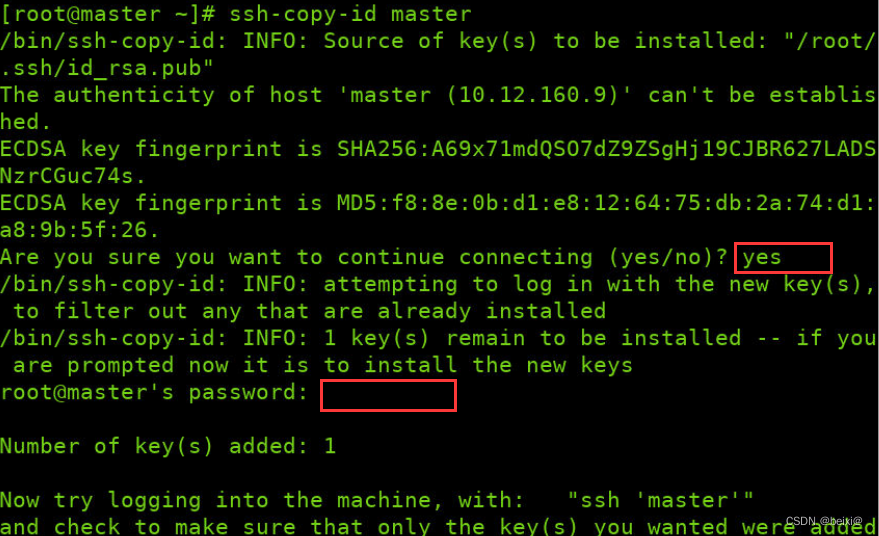

2.将公钥拷贝到本机实现免密登录,第一个红框位置输入yes,第二个红输位置输入自己虚拟机的登陆密码

ssh-copy-id master

跟上面的操作一样,我们在master中实现master对slave1,slave2的免密登录

ssh-copy-id slave1

ssh-copy-id slave2

同理,我们分别进入到slave1,slave2虚拟机中,进行以上同样的操作

ssh-copy-id master

ssh-copy-id slave1

ssh-copy-id slave2

三台虚拟机一共要执行3*3=9次的免密登录操作

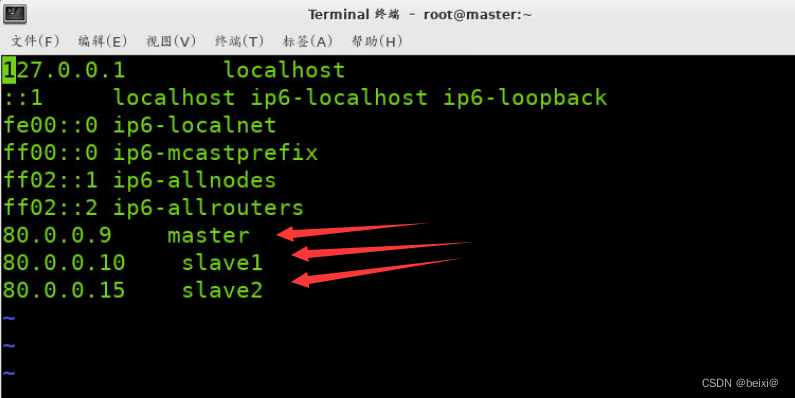

然后我们对master虚拟机上的/etc/hosts文件进行更改,设置IP映射

vi /etc/hosts

我们将三台虚拟机的ip地址,主机名如图所示进行添加,并键入:wq 保存并退出】

同理,我们切换到slave1,slave2虚拟机中对/etc/hosts文件进行同样的修改,保存并退出

二.配置java环境

1.我们在master主机上进行java环境的配置

首先,先把虚拟机环境中的jdk压缩文件解压到/opt目录下

tar -zxvf ~/ruanjian/jdk1.8.0_221.tar.gz -C /opt

进入/opt目录,将解压文件改名为java

cd /opt

mv jdk1.8.0_221 java

接下来修改环境变量

vi /etc/profile

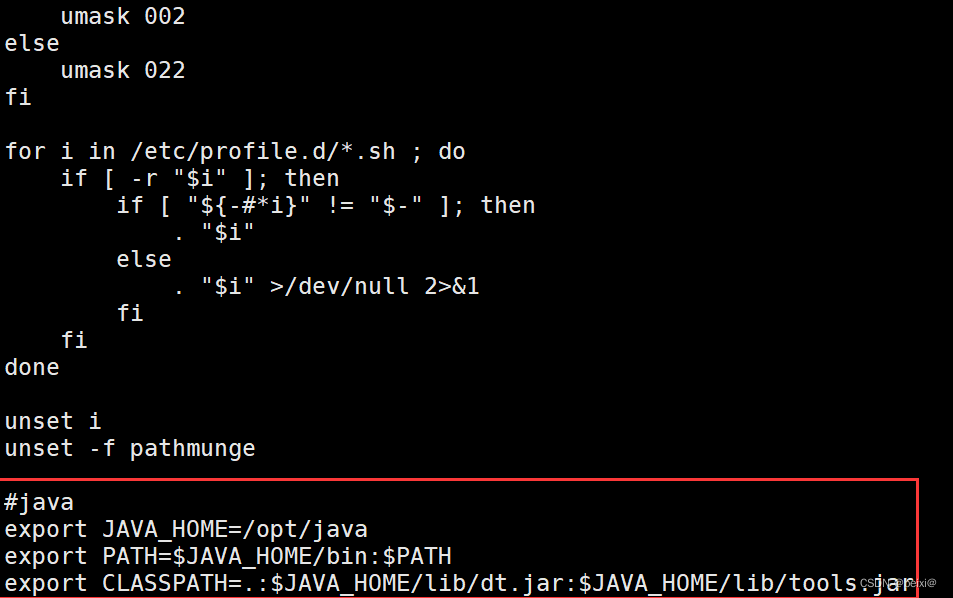

进入文件按下GG进入配置文件最后一行,添加如下信息:

exportJAVA_HOME=/opt/java #你java路径是啥这里就填啥exportPATH=$JAVA_HOME/bin:$PATHexportCLASSPATH=.:$JAVA_HOME/lib/dt.jar:$JAVA_HOME/lib/tools.jar

:wq保存配置信息

然后我们生效配置信息

source /etc/profile

最后验证一下java环境是否配置成功

java -version

如图所示,正确地显示了java的版本号,就配置成功啦~

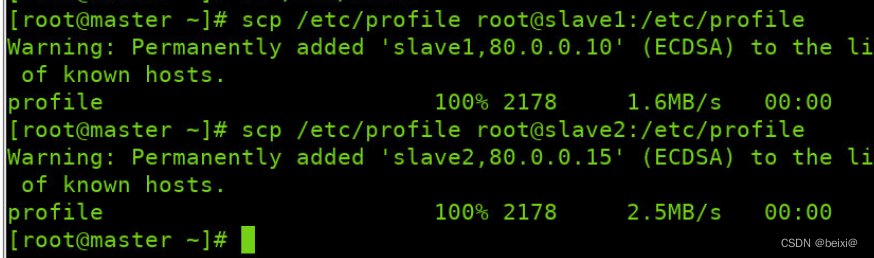

然后我们通过命令将java环境分发给slave1,slave2虚拟机中

scp /etc/profile root@slave1:/etc/profile

scp /etc/profile root@slave2:/etc/profile

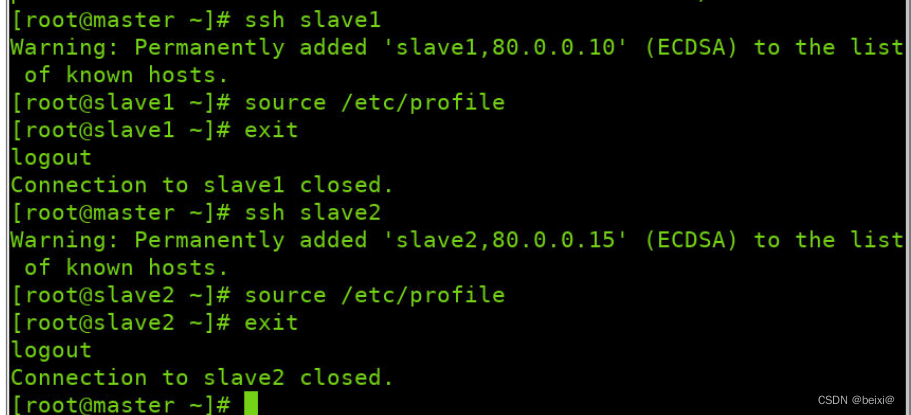

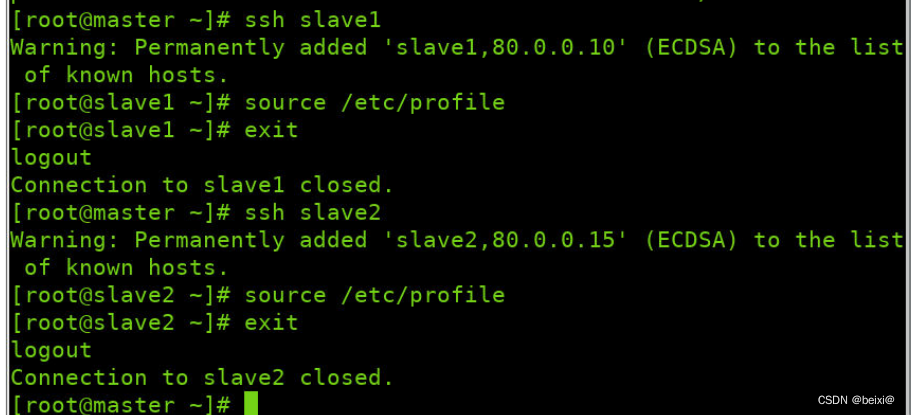

分别在slave1,slave2虚拟机中进行生效配置

ssh slave1

source /etc/profile

exitssh slave2

source /etc/profile

exit

三.hadoop的安装

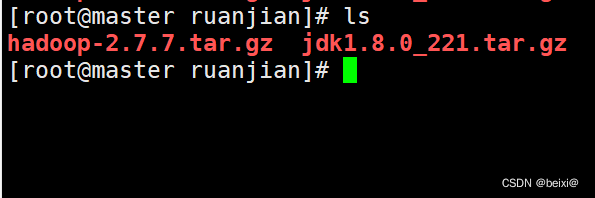

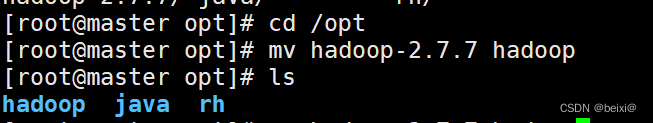

1. 将/root/runajian下的hadoop-2.7.7.tar.gz压缩包解压到/opt目录下,并将解压文件改名为hadoop

tar -zvxf /root/ruanjian/hadoop-2.7.7.tar.gz -C /opt

mv hadoop-2.7.7 hadoop

2.修改环境变量

vim /etc/profile

3.按键Shift+g键定位到最后一行,按键 i 切换到输入模式下,添加如下代码:

exportHADOOP_HOME=/opt/hadoop

exportPATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

4.按键ESC,按键:wq 保存并退出

5.生效刚刚的配置

source /etc/profile

6.同理将master的配置文件分发到slave1,slave2中

ssh slave1

source /etc/profile

exitssh slave2

source /etc/profile

exit

四.hadoop的配置

在/opt/hadoop/etc/hadoop里面,有六个需要配置的文件,分别为:

hadoop-env.sh

core-site.xml

yarn-site.xml

hdfs-site.xml

mapred-site.xml

slaves

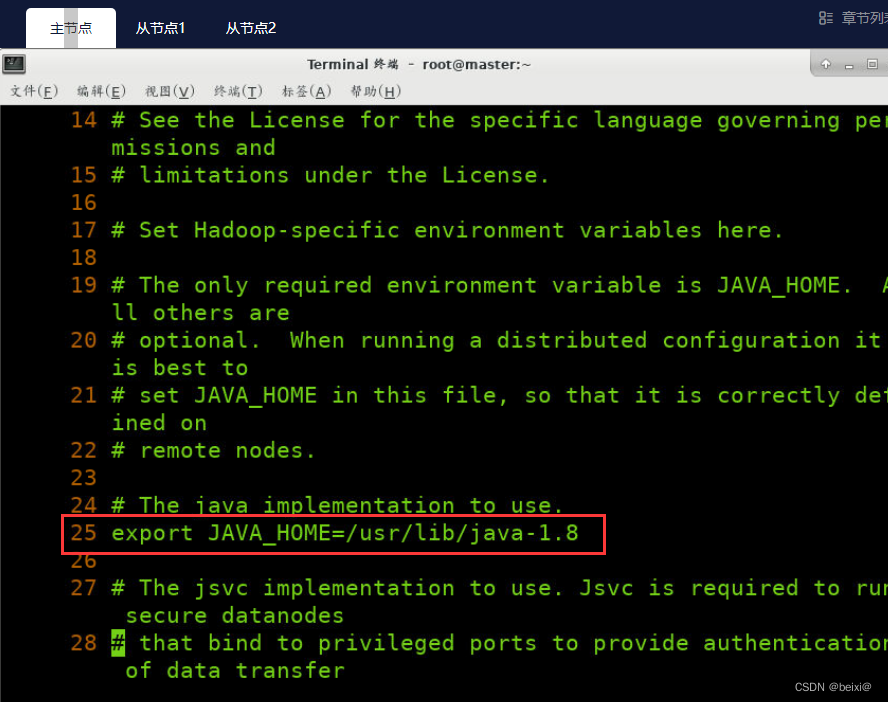

1.首先在master虚拟机中,对hadoop-env.sh文件进行操作

vi /opt/hadoop/etc/hadoop/hadoop-env.sh

在配置文件中,输入25gg定位到25行,修改java环境为自己配置的java环境路径,键入:wq保存并退出

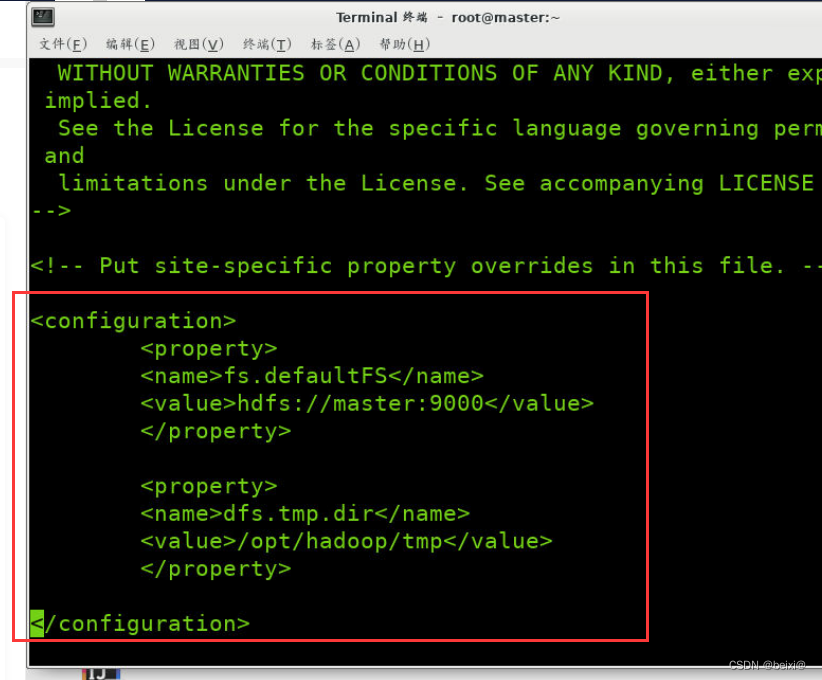

2.修改core-site.xml文件

vi /opt/hadoop/etc/hadoop/core-site.xml

进入配置文件,键入G定位到最后一行,在configuration标签内输入i命令添加以下代码:

<configuration><property><name>fs.defaultFS</name><value>hdfs://master:9000</value></property><property><name>hadoop.tmp.dir</name><value>/opt/hadoop/tmp</value></property></configuration>

3.修改hdfs-site.xml文件

vi /opt/hadoop/etc/hadoop/hdfs-site.xml

进入配置文件,键入G定位到最后一行,在configuration标签内输入i命令添加以下代码:

<configuration><property><name>dfs.namenode.http-address</name><value>master:50070</value></property><property><name>dfs.namenode.secondary.http-address</name><value>master:50090</value></property><property><name>dfs.replication</name><value>3</value></property><property><name>dfs.namenode.name.dir</name><value>/opt/hadoop/tmp/dfs/name</value></property><property><name>dfs.datanode.data.dir</name><value>/opt/hadoop/tmp/dfs/data</value></property></configuration>

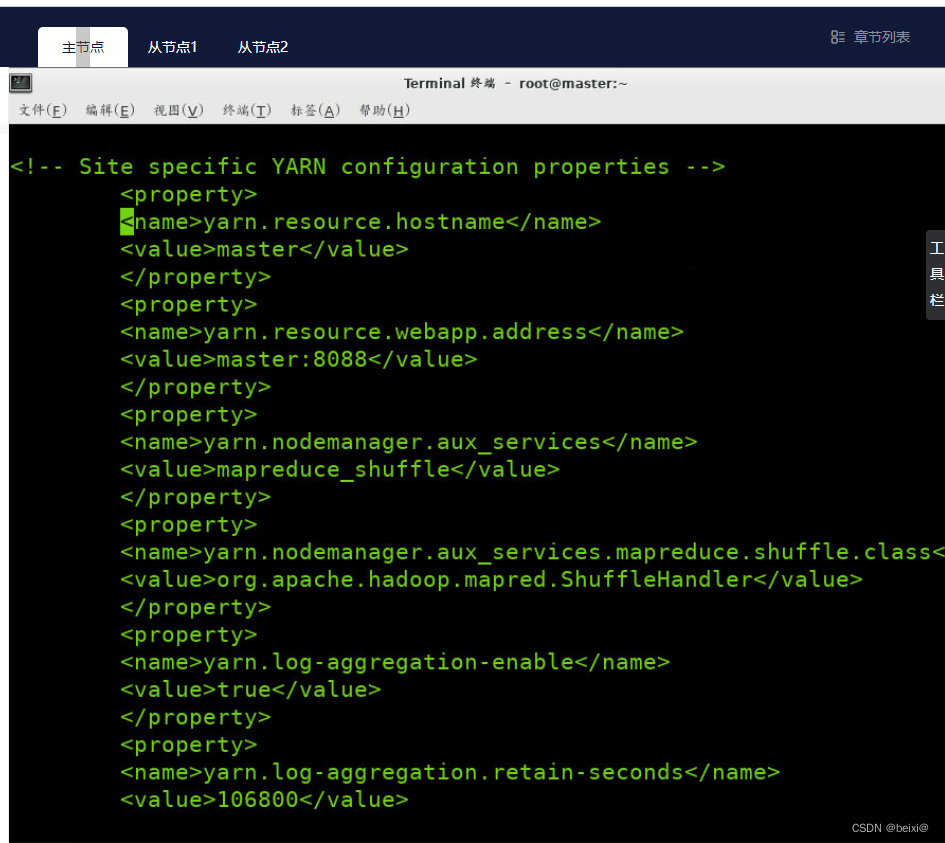

4.修改yarn-site.xml文件

vi /opt/hadoop/etc/hadoop/yarn-site.xml

进入配置文件,键入G定位到最后一行,在configuration标签内输入i命令添加以下代码:

<configuration><property><name>yarn.resourcemanager.hostsname</name><value>master</value></property><property><name>yarn.resourcemanager.webapp.address</name><value>master:8088</value></property><property><name>yarn.nodemanager.aux-services</name><value>mapreduce_shuffle</value></property><property><name>yarn.nodemanager.aux-services.mapreduce.shuffle.class</name><value>org.apache.hadoop.mapred.ShuffleHandler</value></property><property><name>yarn.log-aggregation-enable</name><value>true</value></property><property><name>yarn.log-aggregation.retain-seconds</name><value>106800</value></property><property><name>yarn.nodemanager.remote-app-log-dir</name><value>/user/container/logs</value></property></configuration>

5.在配置文件夹中,将模板文件mapred-site.xml.template复制一份为mapred-site.xml

cp /opt/haoop/etc/hadoop/mapred-site.xml.template /opt/haoop/etc/hadoop/mapred-site.xml

修改mapred-site.xml文件

vi /opt/hadoop/etc/hadoop/mapred-site.xml

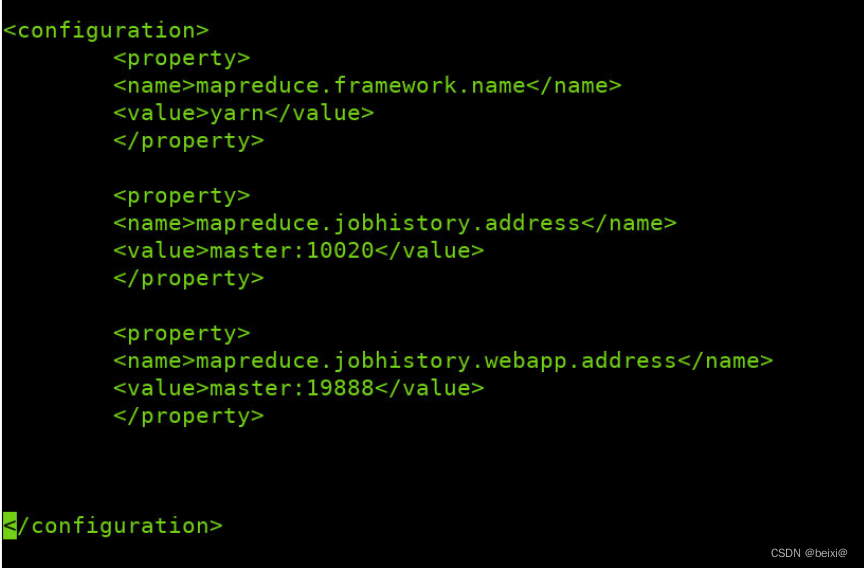

进入配置文件,键入G定位到最后一行,在configuration标签内输入i命令添加以下代码:

<configuration><property><name>mapreduce.framework.name</name><value>yarn</value></property><property><name>mapreduce.jobhistory.address</name><value>master:10020</value></property><property><name>mapreduce.jobhistory.webapp.address</name><value>master:19888</value></property></configuration>

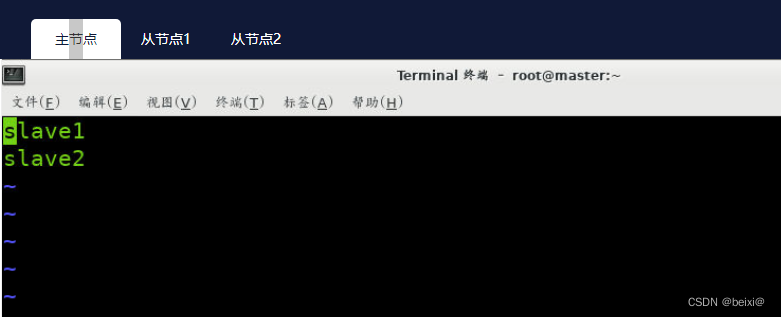

6.修改slaves文件

vi /opt/hadoop/etc/hadoop/slaves

进入配置文件后按dd删除第一行内容,再键入i进入输入模式,输入slave1,sleve2

7.将配置好的hadoop文件分发至slave1,slave2虚拟机中的/opt文件夹下

scp /opt/hadoop root@slave1:/opt/

scp /opt/hadoop root@slave2:/opt/

8.格式化namenode,在master虚拟机中进行

hdfs namenode -format

9.格式化后开启集群

start-all.sh

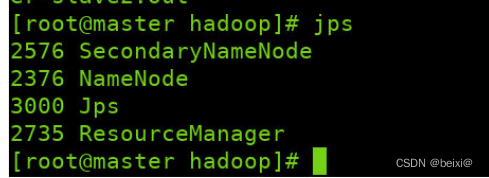

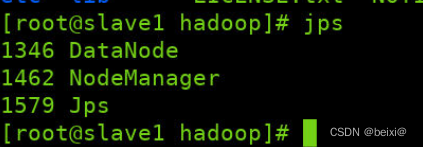

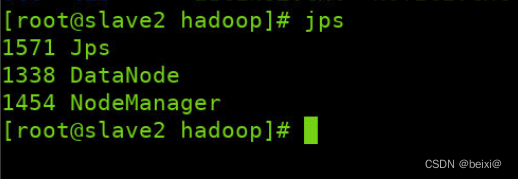

我们分别在master,slave1,slave2虚拟机中,通过jps命令查询集群是否开启成功

jps

master界面:

slave1界面:

slave2界面:

集群开启成功后,节点会如图显示:

Master: NameNode、ResourceManager、SecondaryNameNode

slave1: DataNode、NodeManager

slave2: DataNode、NodeManager

hadoop完全分布式集群搭建到此就完毕了,如果此篇文章对你有帮助或者喜欢,记得点赞关注收藏哦~

版权归原作者 beixi@ 所有, 如有侵权,请联系我们删除。