Spark任务执行流程

部署模式是根据Drvier和Executor的运行位置的不同划分的。client模式提交任务与Driver进程在同一个节点上,而cluster模式提交任务与Driver进程不在同一个节点。

部署模式是根据Drvier和Executor的运行位置的不同划分的。client模式提交任务与Driver进程在同一个节点上,而cluster模式提交任务与Driver进程不在同一个节点。

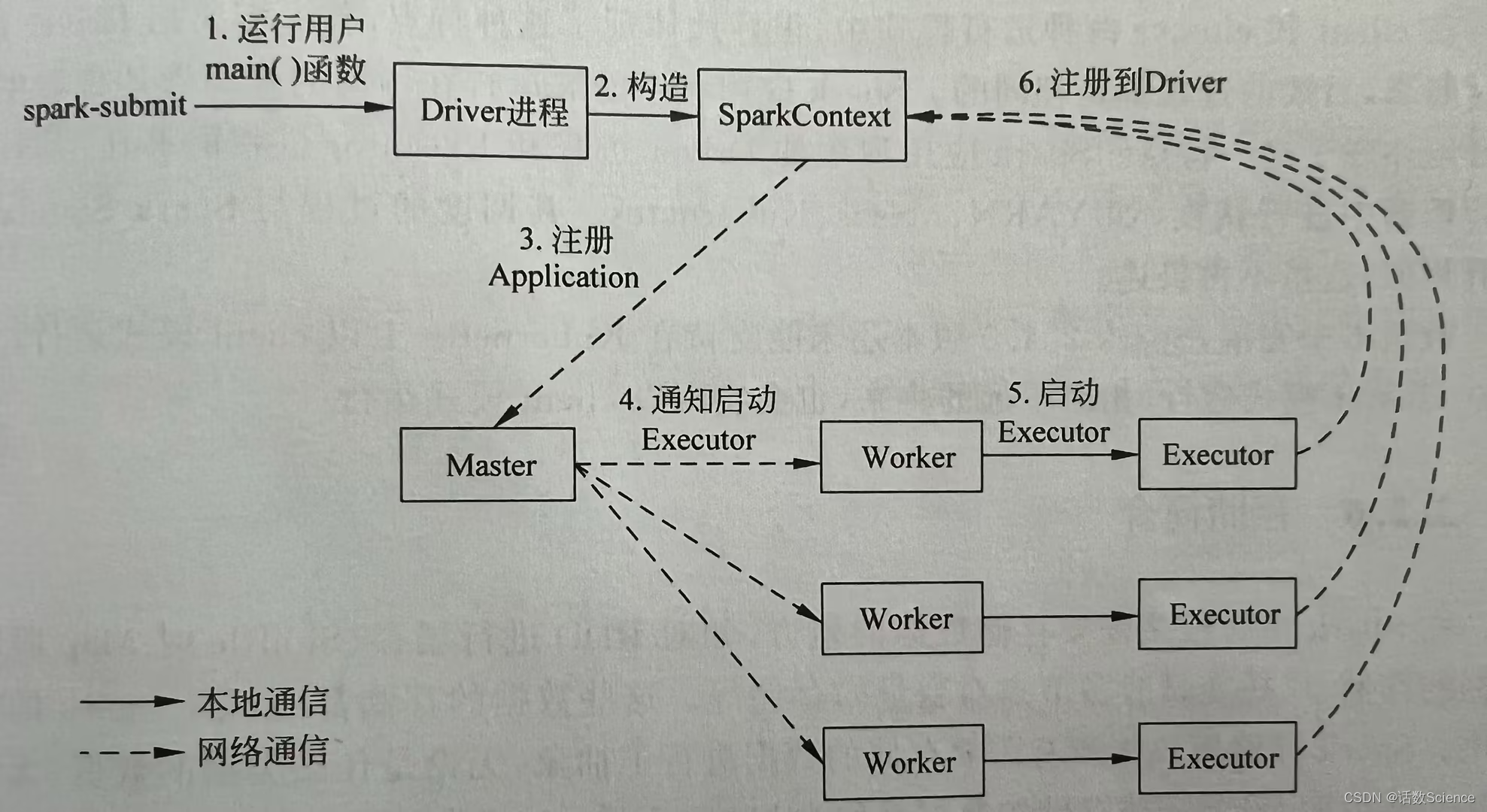

Client模式

Clinet模式是在spark-submit提交任务的节点上运行Driver进程。

执行流程:

- spark-submit脚本提交任务直接启动Driver进程运行main函数

- 构造SparkConext

- 向Master注册Application

- 由Master通知启动Executor

- Executor再注册到Driver

在 Spark 项目开发阶段,可以使用 client 模式对程序进行测试,此时,可以在本地看到比较全的日志信息。

Cluster模式

Cluster模式是在Worker节点上运行Driver进程。

执行流程:

- 由spark-submit脚本启动临时进程

- 通知Master在某个Worker上启动Driver进程运行main函数

- 初始化SparkConext

- 向Master注册Application

- 由Master通知启动Executor

- Executor再注册到Driver

Yarn任务运行流程

Yarn的组件主要包括:

- ResourceManager : 资源管理

- Application Master : 任务调度

- NodeManager : 节点管理,负责执行任务

当向YARN提交一个应用程序之后,YARN将分两个阶段运行程序:一是启动ApplicationMaster;二是由ApplicationMaster创建应用程序,然后为他申请资源,监控程序的运行,直至结束。

具体步骤:

- 用户向YARN中提交应用程序。

- ResourceManager为该应用程序分配第一个Container,要求它在这个Container中启动应用程序的ApplicationMaster。

- ApplicationMaster首先向ResourceManager注册,目的是让用户可以直接通过ResourceManager查看应用程序的运行状态,然后它将为各个任务申请资源,并监控它的运行状态,直到运行结束。

- ApplicationMaster向ResourceManager 的 scheduler申请和领取资源(通过RPC协议)。

- ApplicationMaster申请到资源后,便与对应的NodeManager通信,要求它启动任务(java进程)。

- NodeManager启动任务。

- 各个任务向ApplicationMaster汇报自己的状态和进度(通过RPC协议),以便让ApplicationMaster随时掌握各个任务的运行状态,从而可以在任务失败时重新启动任务。

- 应用程序运行完成后,ApplicationMaster向ResourceManager注销并关闭自己。

YARN-CLIENT模式

Driver是一个JVM进程,Driver就是我们写的Spark程序,我们写的Spark程序打包成jar包后通过spark-submit脚本提交,jar中的main方法通过jvm命令启动起来,Driver进程启动会执行我们的main函数。

Driver接收到属于自己Executor进程注册之后,就会去执行Spark作业代码。Driver会一样一行的去执行Spark代码,执行到某个action操作的时候,就会触发一个job,然后DAGScheduler会把job划分成一个一个的stage,为每个stage都创建指定数量的task;TaskScheduler将每个Stage的task分配到各个Executor上去执行,随后task就会执行算子函数。

Application Maser是YARN中的核心概念。Application Maser(ExecutorLauncher)负责Executor的申请,Driver负责Job和Stage的划分以及Task的创建、分配和调度。

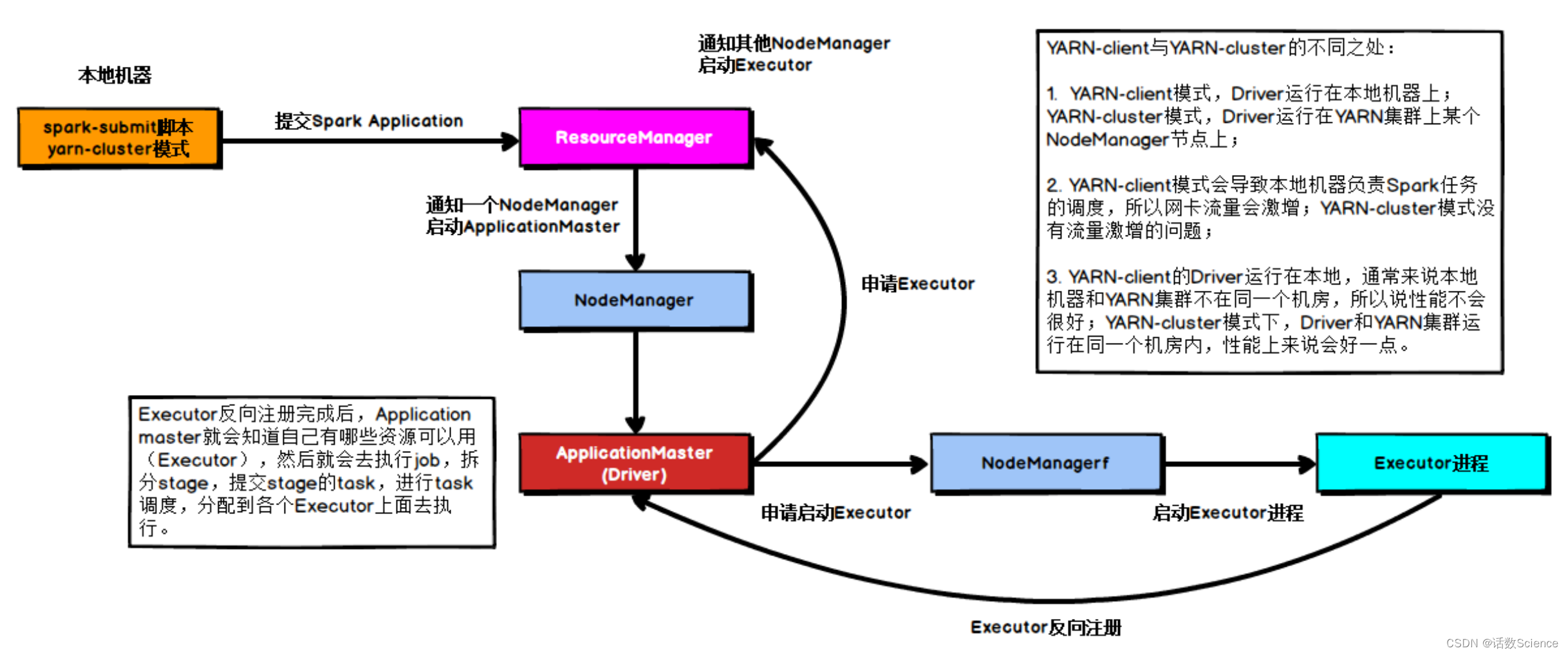

YARN-CLUSTER模式

YARN-client和YARN-cluster的不同之处:

- YARN-client模式,Driver运行在本地机器上; YARN-cluster模式,Driver运行在YARN集群上某个NodeManager节点上;

- YARN-client模式会导致本地机器负责Spark任务的调度,所以网卡流量会激增;YARN-cluster模式没有流量激增的问题;

- YARN-client的Driver运行在本地,通常来说本地机器和YARN集群不在同一个机房,所以说性能不会很好;YARN-cluster模式下,Driver和YARN集群运行在同一个机房内,性能上来说会好一点。

故障排查

**YARN-CLIENT **模式导致的网卡流量激增问 题

在 YARN-client 模式下,Driver 启动在本地机器上,而 Driver 负责所有的任务调度,需要与 YARN 集群上的多个 Executor 进行频繁的通信。

假设有 100 个 Executor, 1000 个 task,那么每个 Executor 分配到 10 个 task,之后, Driver 要频繁地跟 Executor 上运行的 1000 个 task 进行通信,通信数据非常多,并且通信频率特别高。这就导致有可能在 Spark 任务运行过程中,由于频繁大量的网络通讯,本地机器的网卡流量会激增。

注意,YARN-client 模式只会在测试环境中使用,而之所以使用 YARN-client 模式,是由于可以看到详细全面的 log 信息,通过查看 log,可以锁定程序中存在的问题,避免在生产环境下发生故障。

在生产环境下,使用的一定是 YARN-cluster 模式。在 YARN-cluster 模式下,就不会造成本地机器网卡流量激增问题,如果 YARN-cluster 模式下存在网络通信的问题,需要运维团队进行解决。

**YARN-CLUSTER **模式的 **JVM **栈内存溢出无法执行问题

当 Spark 作业中包含 SparkSQL 的内容时,可能会碰到 YARN-client 模式下可以运行,但是 YARN-cluster 模式下无法提交运行(报出 OOM 错误)的情况。

YARN-client 模式下,Driver 是运行在本地机器上的,Spark 使用的 JVM 的 PermGen 的配置,是本地机器上的 spark-class 文件,JVM 永久代的大小是 128MB,这个是没有问题的, 但是在 YARN-cluster 模式下,Driver 运行在 YARN 集群的某个节点上,使用的是没有经过配置的默认设置,PermGen 永久代大小为 82MB。

SparkSQL 的内部要进行很复杂的 SQL 的语义解析、语法树转换等等,非常复杂,如果 sql 语句本身就非常复杂,那么很有可能会导致性能的损耗和内存的占用,特别是对 PermGen 的占用会比较大。

所以,此时如果 PermGen 的占用好过了 82MB,但是又小于 128MB,就会出现 YARN- client 模式下可以运行,YARN-cluster 模式下无法运行的情况。

解决上述问题的方法时增加 PermGen 的容量,需要在 spark-submit 脚本中对相关参数进行设置,设置方法如代码清单所示。

--conf spark.driver.extraJavaOptions="-XX:PermSize=128M -XX:MaxPermSize=256M"

通过上述方法就设置了 Driver 永久代的大小,默认为 128MB,最大 256MB,这样就可以避免上面所说的问题。

版权归原作者 话数Science 所有, 如有侵权,请联系我们删除。