1.本地搭建

1.1.下载Flink

进入Flink官网,点击Downloads

往下滑动就可以看到 Flink 的所有版本了,看自己需要什么版本点击下载即可。

1.2.上传解压

上传至服务器,进行解压

tar -zxvf flink-1.17.1-bin-scala_2.12.tgz -C ../module/

1.3.启动Flink

#进入flink安装目录

cd /opt/module/flink-1.17.1/

#启动flink

bin/start-cluster.sh

查看进程 jps,正常启动!

1.4.查看 Web ui

启动成功后,访问http://[IP]:8081,可以对集群和任务进行监控管理。

1.5.关闭Flink

bin/stop-cluster.sh

2.集群搭建

角色分配。Flink 是典型的 Master-Slave 架构的分布式数据处理框架,其中 Master 角色对应着 JobManager,Slave 角色则对应 TaskManager。

三台测试。

服务器hadoop102hadoop103hadoop104角色

JobManager

TaskManager

TaskManager

2.1.下载并解压安装包

与本地搭建一致

2.2.修改集群配置

2.2.1修改 flink-conf.yaml 文件

#进入Flink 安装目录

cd /opt/module/flink-1.17.1/

#修改文件

vim conf/flink-conf.yaml

修改JobManager 节点地址.将 jobmanager.rpc.address 参数的值 改为 hadoop102 (根据自己的服务器名称),指定 hadoop 节点服务为 JobManager 节点。

2.2.2修改workers文件

vim conf/workers

hadoop103

hadoop104

指定 hadoop103、hadoop104 服务器 为 TaskManager 节点

2.3.分发安装目录

scp -r /opt/module/flink-1.17.1/ hadoop103:/opt/module/

scp -r /opt/module/flink-1.17.1/ hadoop104:/opt/module/

2.4.集群启动

在 hadoop102 服务器中 启动

bin/start-cluster.sh

查看 各服务器节点进程是否正常

hadoop102

hadoop103

hadoop104

2.5查看 Web ui

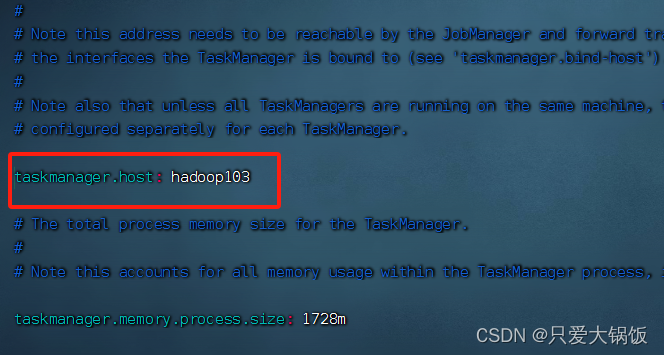

Available Task Slots显示为0,需要重新配置下 TaskManager节点的服务器(2台)中的 flink-conf.yaml 文件,将 taskmanager.host 参数值 改为 服务器的 ip或 主机名

重新启动 flink 集群,显示 正常。当前集群的 TaskManager 数量为 2;由于默认每个 TaskManager 的 Slot 数量为 1,所以总 Slot 数和可用 Slot 数都为 2。

3.测试

Flink学习之旅:(二)构建Flink demo工程并提交到集群执行-CSDN博客在idea中创建一个 名为 MyFlinkFirst 工程。https://blog.csdn.net/qq_35370485/article/details/133905729?spm=1001.2014.3001.5501

版权归原作者 只爱大锅饭 所有, 如有侵权,请联系我们删除。