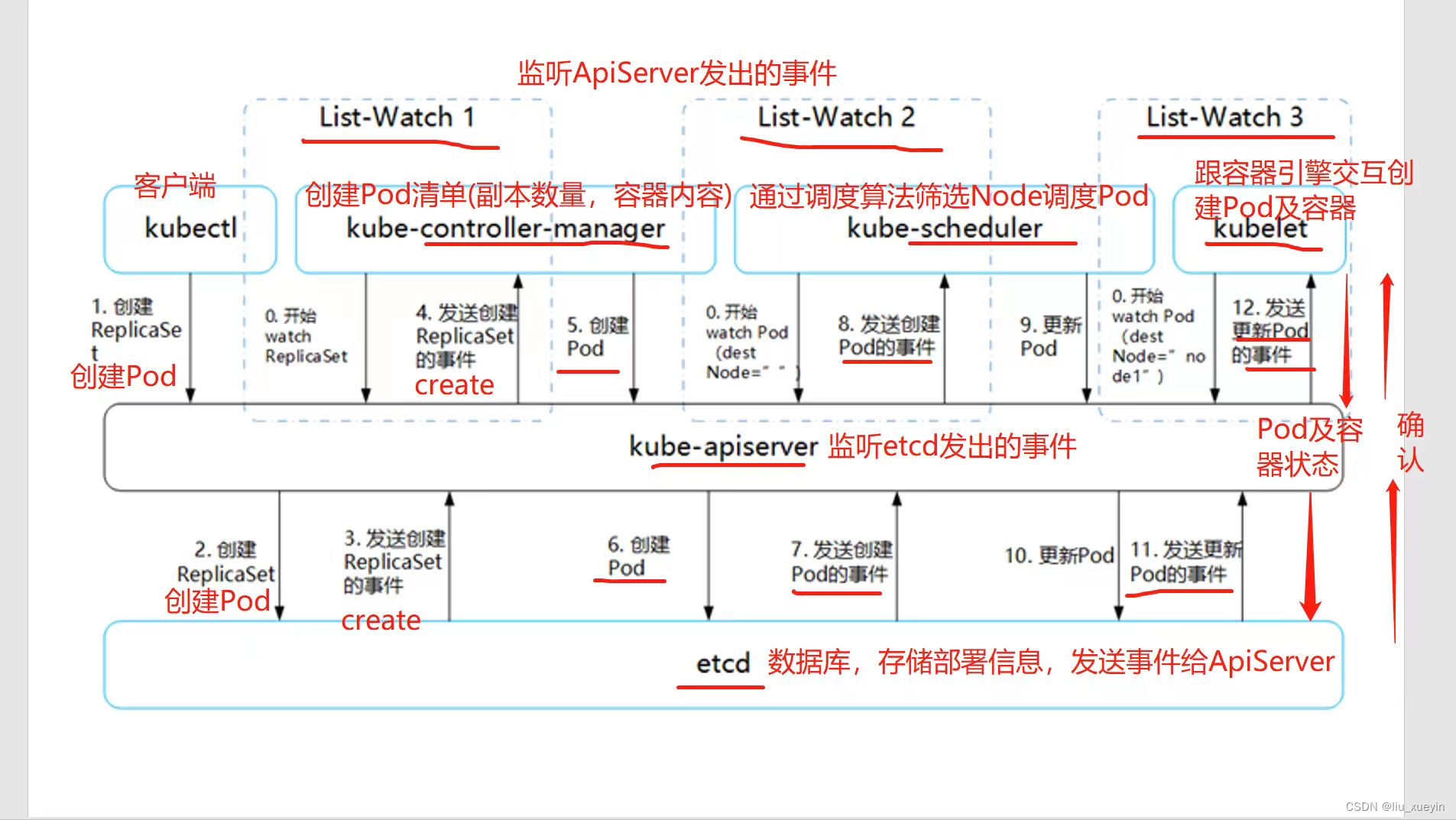

一、k8s的watch机制

Kubernetes 是通过 List-Watch 的机制进行每个组件的协作,保持数据同步的,每个组件之间的设计实现了解耦。

用户是通过 kubectl 根据配置文件,向 APIServer 发送命令,在 Node 节点上面建立 Pod 和 Container。

APIServer 经过 API 调用,权限控制,调用资源和存储资源的过程,实际上还没有真正开始部署应用。这里 需要 Controller Manager、Scheduler 和 kubelet 的协助才能完成整个部署过程。

在 Kubernetes 中,所有部署的信息都会写到 etcd 中保存。实际上 etcd 在存储部署信息的时候,会发送 Create 事件给 APIServer,而 APIServer 会通过监听(Watch)etcd 发过来的事件。其他组件也会监听(Watch)APIServer 发出来的事件。

Pod 是 Kubernetes 的基础单元,Pod 启动典型创建过程如下:

(1)这里有三个 List-Watch,分别是 Controller Manager(运行在 Master),Scheduler(运行在 Master),kubelet(运行在 Node)。 他们在进程已启动就会监听(Watch)APIServer 发出来的事件。

(2)用户通过 kubectl 或其他 API 客户端提交请求给 APIServer 来建立一个 Pod 对象副本。

(3)APIServer 尝试着将 Pod 对象的相关元信息存入 etcd 中,待写入操作执行完成,APIServer 即会返回确认信息至客户端。

(4)当 etcd 接受创建 Pod 信息以后,会发送一个 Create 事件给 APIServer。

(5)由于 Controller Manager 一直在监听(Watch,通过https的6443端口)APIServer 中的事件。此时 APIServer 接受到了 Create 事件,又会发送给 Controller Manager。

(6)Controller Manager 在接到 Create 事件以后,调用其中的 Replication Controller 来保证 Node 上面需要创建的副本数量。一旦副本数量少于 RC 中定义的数量,RC 会自动创建副本。总之它是保证副本数量的 Controller(PS:扩容缩容的担当)。

(7)在 Controller Manager 创建 Pod 副本以后,APIServer 会在 etcd 中记录这个 Pod 的详细信息。例如 Pod 的副本数,Container 的内容是什么。

(8)同样的 etcd 会将创建 Pod 的信息通过事件发送给 APIServer。

(9)由于 Scheduler 在监听(Watch)APIServer,并且它在系统中起到了“承上启下”的作用,“承上”是指它负责接收创建的 Pod 事件,为其安排 Node;“启下”是指安置工作完成后,Node 上的 kubelet 进程会接管后继工作,负责 Pod 生命周期中的“下半生”。 换句话说,Scheduler 的作用是将待调度的 Pod 按照调度算法和策略绑定到集群中 Node 上。

(10)Scheduler 调度完毕以后会更新 Pod 的信息,此时的信息更加丰富了。除了知道 Pod 的副本数量,副本内容。还知道部署到哪个 Node 上面了。并将上面的 Pod 信息更新至 API Server,由 APIServer 更新至 etcd 中,保存起来。

(11)etcd 将更新成功的事件发送给 APIServer,APIServer 也开始反映此 Pod 对象的调度结果。

(12)kubelet 是在 Node 上面运行的进程,它也通过 List-Watch 的方式监听(Watch,通过https的6443端口)APIServer 发送的 Pod 更新的事件。kubelet 会尝试在当前节点上调用 Docker 启动容器,并将 Pod 以及容器的结果状态回送至 APIServer。

(13)APIServer 将 Pod 状态信息存入 etcd 中。在 etcd 确认写入操作成功完成后,APIServer将确认信息发送至相关的 kubelet,事件将通过它被接受。

#注意:在创建 Pod 的工作就已经完成了后,为什么 kubelet 还要一直监听呢?原因很简单,假设这个时候 kubectl 发命令,要扩充 Pod 副本数量,那么上面的流程又会触发一遍,kubelet 会根据最新的 Pod 的部署情况调整 Node 的资源。又或者 Pod 副本数量没有发生变化,但是其中的镜像文件升级了,kubelet 也会自动获取最新的镜像文件并且加载。

总结:controller manager以及scheduler、kubelet组件会通过list-watch机制持续监听apiserver的事件,apiserver会通过list-watch机制监听etcd的事件

二、scheduler的调度策略

Scheduler 是 kubernetes 的调度器,主要的任务是把定义的 pod 分配到集群的节点上。其主要考虑的问题如下:

●公平:如何保证每个节点都能被分配资源

●资源高效利用:集群所有资源最大化被使用

●效率:调度的性能要好,能够尽快地对大批量的 pod 完成调度工作

●灵活:允许用户根据自己的需求控制调度的逻辑

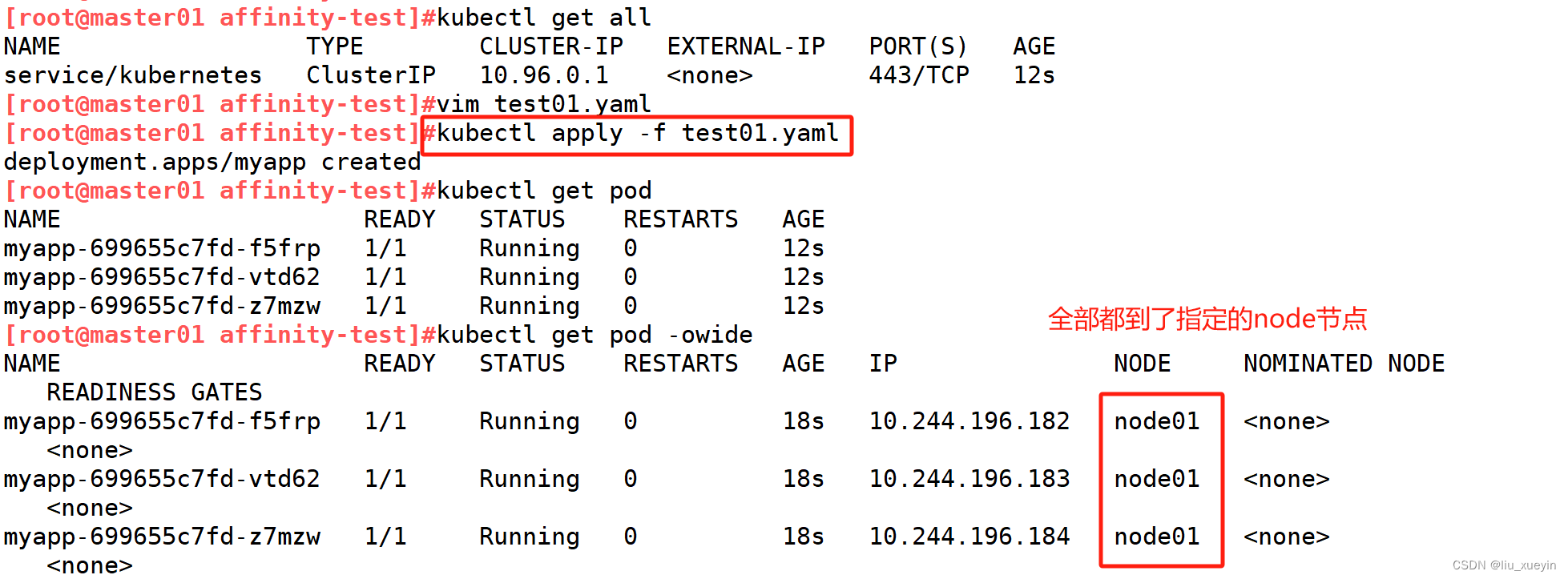

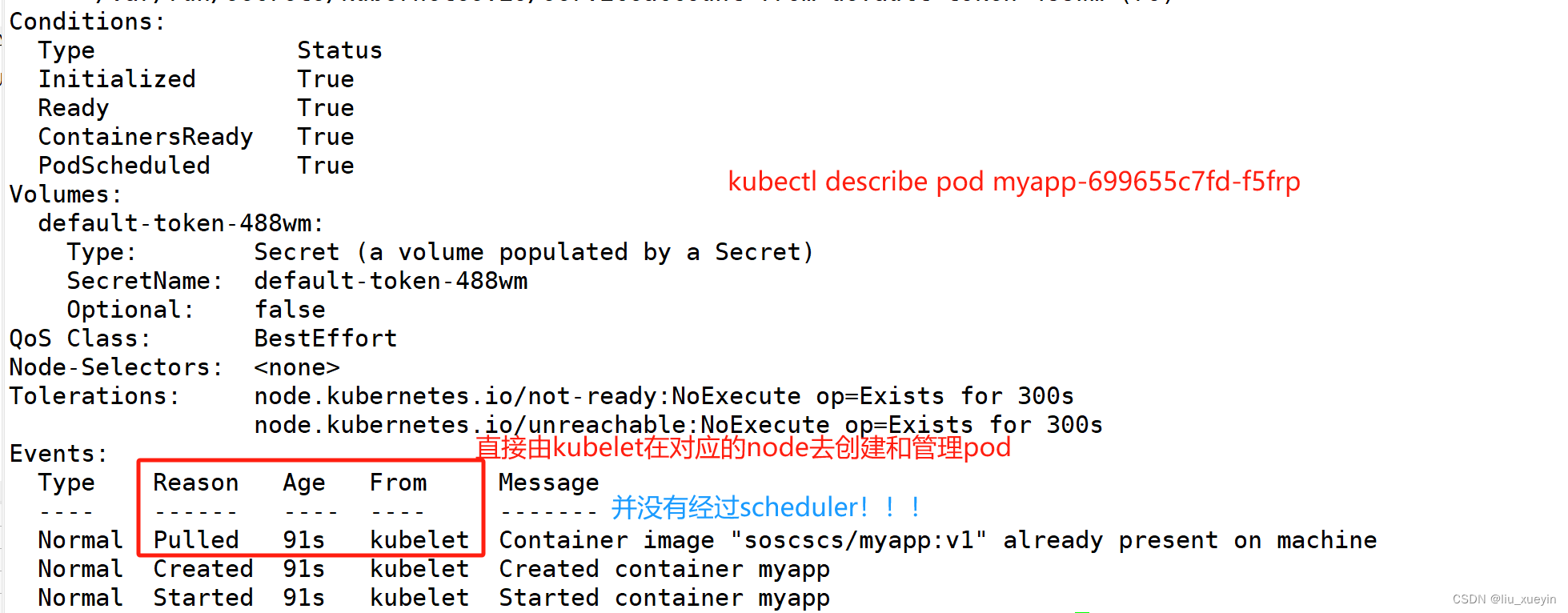

Sheduler 是作为单独的程序运行的,启动之后会一直监听 APIServer,获取 spec.nodeName 为空的 pod(如果是nodeName不为空,会直接由对应node节点的kubelet进行创建和管理pod),对每个 pod 都会创建一个 binding,表明该 pod 应该放到哪个节点上。

调度分为几个部分:首先是过滤掉不满足条件的节点,这个过程称为预算策略(predicate);然后对通过的节点按照优先级排序,这个是优选策略(priorities);最后从中选择优先级最高的节点。如果中间任何一步骤有错误,就直接返回错误。

Predicate(预选策略) 常见算法:

●PodFitsResources:节点上剩余的资源是否大于 pod 请求的资源。(根据requests限制判定)

●PodFitsHost:如果 pod 指定了 NodeName,检查节点名称是否和 NodeName 匹配。

●PodFitsHostPorts:节点上已经使用的 port 是否和 pod 申请的 port 冲突。

●PodSelectorMatches:过滤掉和 pod 指定的 label 不匹配的节点。

●NoDiskConflict:已经 mount 的 volume 和 pod 指定的 volume 不冲突,除非它们都是只读。

如果在 predicate 过程中没有合适的节点,pod 会一直在 pending 状态,不断重试调度,直到有节点满足条件。 经过这个步骤,如果有多个节点满足条件,就继续 priorities 过程:按照优先级大小对节点排序。

优先级由一系列键值对组成,键是该优先级项的名称,值是它的权重(该项的重要性)。有一系列的常见的优先级选项包括:

priorities(优选策略)常见的算法有:

●LeastRequestedPriority:通过计算CPU和Memory的使用率来决定权重,使用率越低权重越高。也就是说,这个优先级指标倾向于资源使用比例更低的节点。

●BalancedResourceAllocation:节点上 CPU 和 Memory 使用率越接近,权重越高。这个一般和上面的一起使用,不单独使用。比如 node01 的 CPU 和 Memory 使用率 20:60,node02 的 CPU 和 Memory 使用率 50:50,虽然 node01 的总使用率比 node02 低,但 node02 的 CPU 和 Memory 使用率更接近,从而调度时会优选 node02。

●ImageLocalityPriority:倾向于已经有要使用镜像的节点,镜像总大小值越大,权重越高。

通过算法对所有的优先级项目和权重进行计算,得出最终的结果。

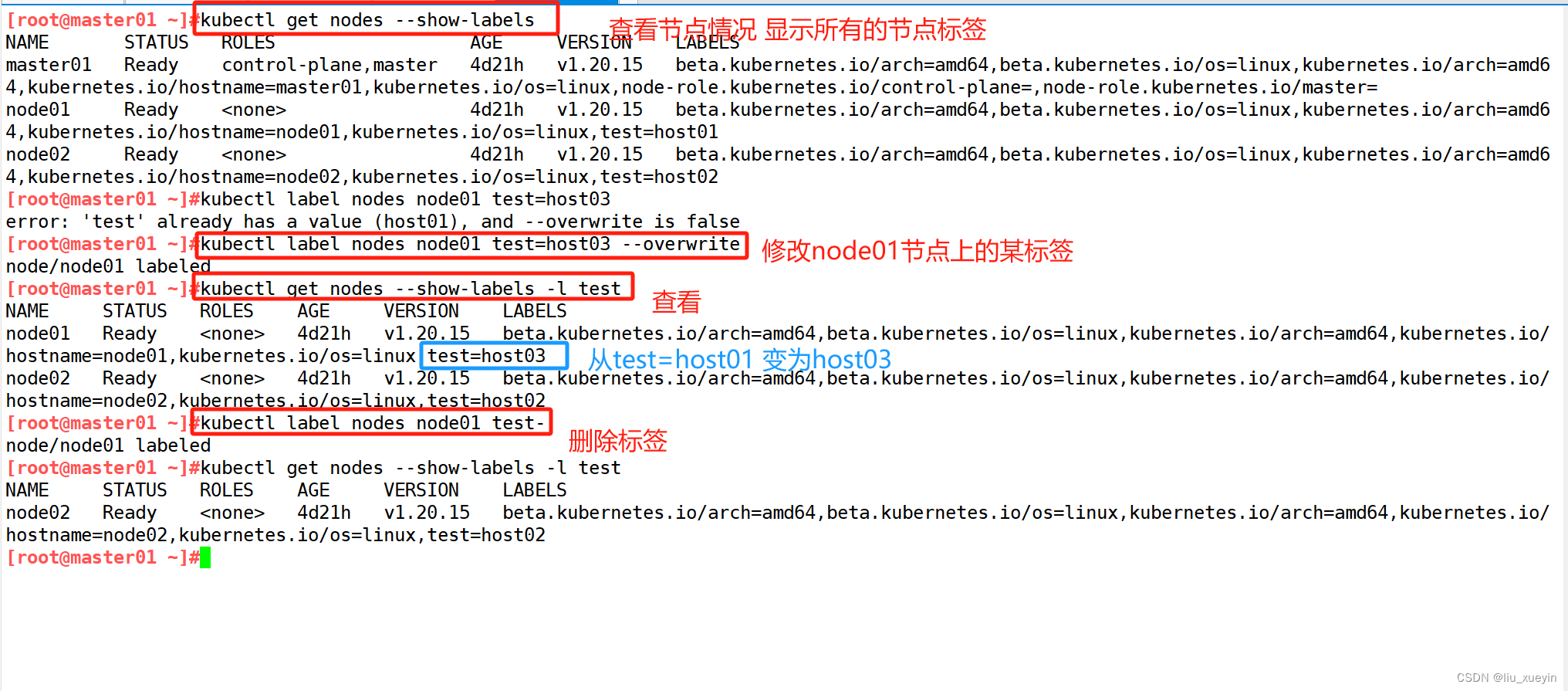

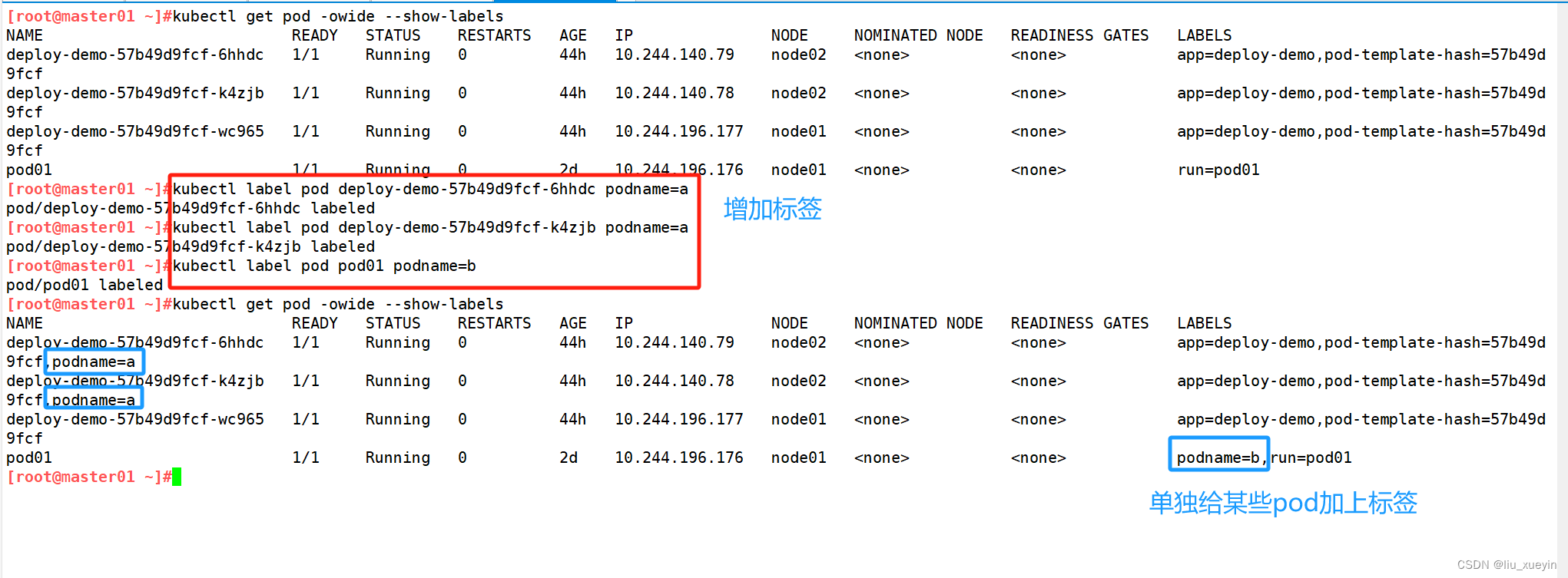

三、k8s的标签管理之增删改查

##增加标签

kubectl label -n 命名空间 资源类型 资源名称 标签键名=键值

##删除标签

kubectl label -n 命名空间 资源类型 资源名称 标签键名-(减号不能忽略)

##修改标签

kubectl label -n 命名空间 资源类型 资源名称 标签键名=新的键值 --overwrite

##查询标签

kubectl get -n 命名空间 资源类型 --show-label [-l 标签键名]或[-l 标签键名=键值](筛选)

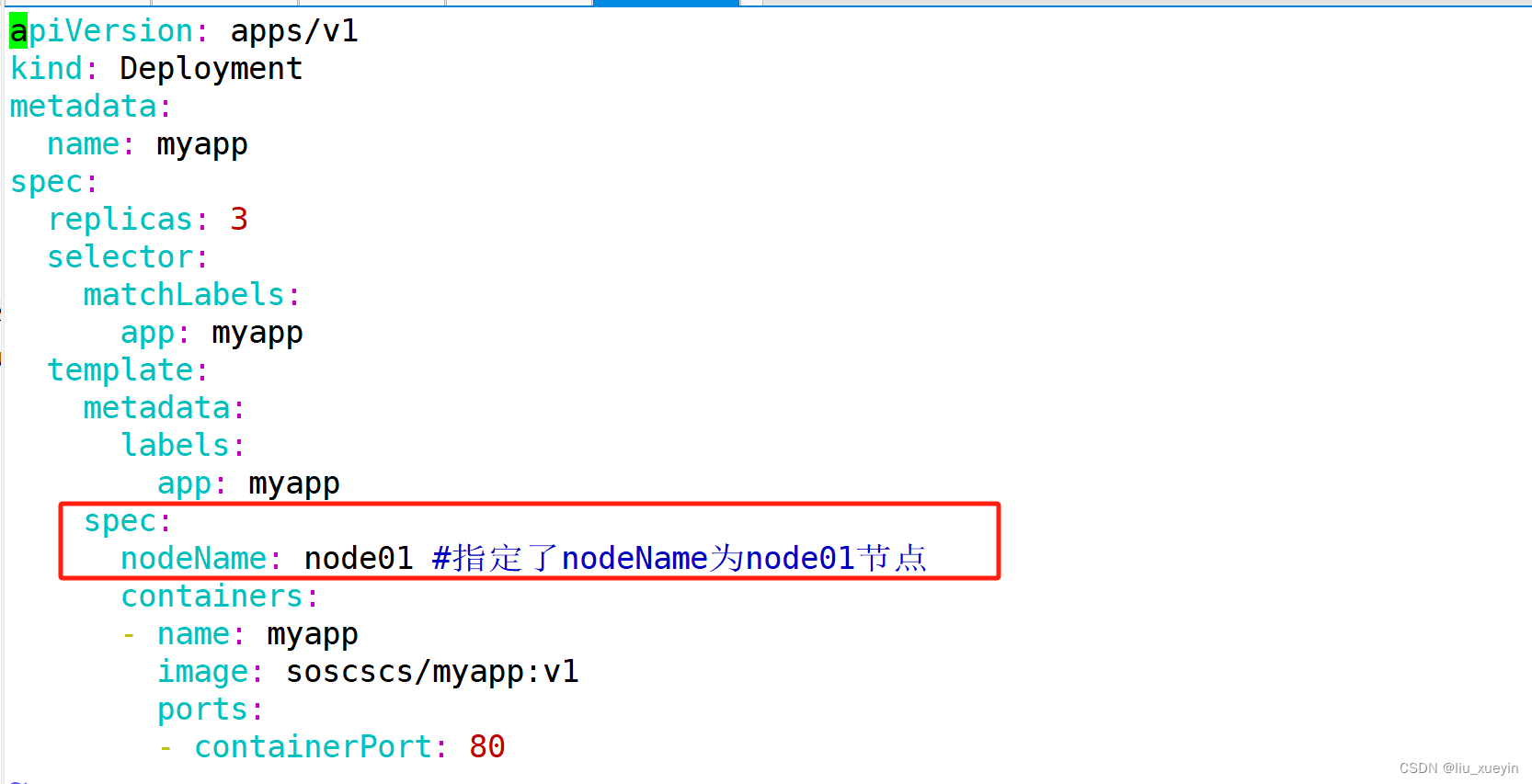

四、k8s的将pod调度到指定node的方法

方案一:指定nodeName

apiVersion: apps/v1

kind: Deployment

metadata:

name: myapp

spec:

replicas: 3

selector:

matchLabels:

app: myapp

template:

metadata:

labels:

app: myapp

spec:

nodeName: node01 #指定了nodeName为node01节点

containers:

- name: myapp

image: soscscs/myapp:v1

ports:

- containerPort: 80

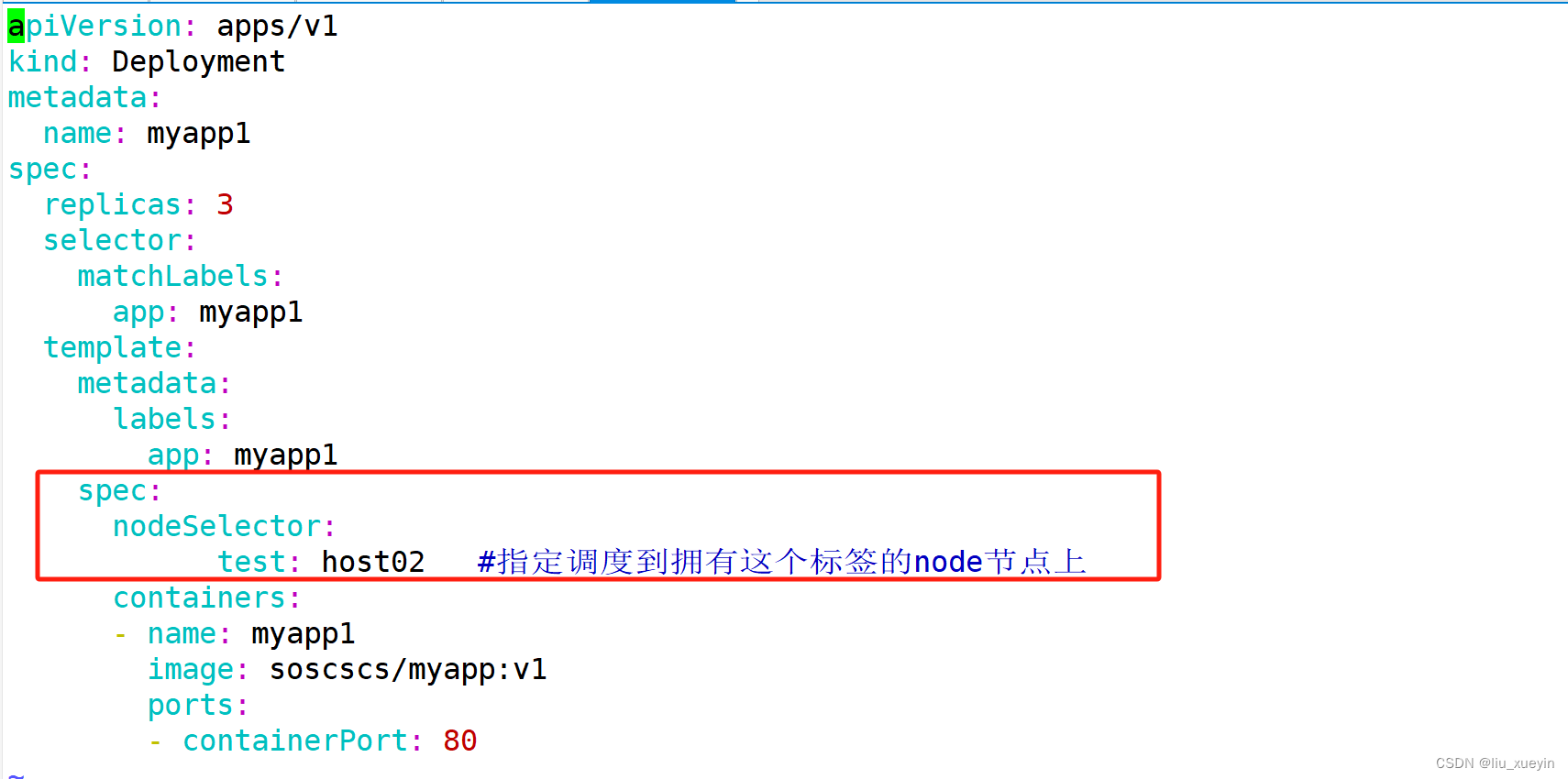

方案二:指定nodeSelector

通过 kubernetes 的 label-selector 机制选择节点,由调度器调度策略匹配 label,然后调度 Pod 到目标节点,该匹配规则属于强制约束

apiVersion: apps/v1

kind: Deployment

metadata:

name: myapp1

spec:

replicas: 3

selector:

matchLabels:

app: myapp1

template:

metadata:

labels:

app: myapp1

spec:

nodeSelector:

test: host02 #指定调度到拥有这个标签的node节点上

containers:

- name: myapp1

image: soscscs/myapp:v1

ports:

- containerPort: 80

如果我修改了node的标签,现在只有node02有这个test=host02的标签,验证会强制调度到所有的node02节点

如果我修改了node的标签,现在只有node02有这个test=host02的标签,验证会强制调度到所有的node02节点

现在我没有这个test=host02标签的node节点,验证是否会都处于pending状态

拓展 :关于nodeName和nodeSelector字段分析

**nodeName只能指定单个node节点,nodeSelector可以指定有相同标签的多个node节点 **

五、k8s的三大亲和性(灵活将pod调度到node的方法)

k8s集群的亲和性你可以约束一个 Pod 以便限制其只能在特定的节点上运行, 或优先在特定的节点上运行。有几种方法可以实现这点,推荐的方法都是用 标签选择算符来进行选择。 通常这样的约束不是必须的,因为调度器将自动进行合理的放置(比如,将 Pod 分散到节点上, 而不是将 Pod 放置在可用资源不足的节点上等等)。但在某些情况下,你可能需要进一步控制 Pod 被部署到哪个节点。例如,确保 Pod 最终落在连接了 SSD 的机器上, 或者将来自两个不同的服务且有大量通信的 Pod 被放置在同一个可用区。你可以使用下列方法中的任何一种来选择 Kubernetes 对特定 Pod 的调度:与节点标签匹配的 nodeSelector 亲和性与反亲和性 nodeName 字段 Pod 拓扑分布约束 节点标签 与很多其他 Kubernetes 对象类似,节点也有标签。 你可以手动地添加标签。 Kubernetes 也会为集群中所有节点添加一些标准的标签。说明: 这些标签的取值是取决于云提供商的,并且是无法在可靠性上给出承诺的。 例如,kubernetes.io/hostname 的取值在某些环境中可能与节点名称相同, 而在其他环境中会取不同的值。节点隔离/限制 通过为节点添加标签,你可以准备让 Pod 调度到特定节点或节点组上。 你可以使用这个功能来确保特定的 Pod 只能运行在具有一定隔离性、安全性或监管属性的节点上。如果使用标签来实现节点隔离,建议选择节点上的 kubelet 无法修改的标签键。 这可以防止受感染的节点在自身上设置这些标签,进而影响调度器将工作负载调度到受感染的节点。NodeRestriction 准入插件防止 kubelet 使用 node-restriction.kubernetes.io/ 前缀设置或修改标签。要使用该标签前缀进行节点隔离:确保你在使用节点鉴权机制并且已经启用了 NodeRestriction 准入插件。 将带有 node-restriction.kubernetes.io/ 前缀的标签添加到 Node 对象, 然后在节点选择算符中使用这些标签。 例如,example.https://kubernetes.io/zh/docs/concepts/scheduling-eviction/assign-pod-node/

三大亲和性

(1)节点亲和性

pod.spec.nodeAffinity

●preferredDuringSchedulingIgnoredDuringExecution:软策略

●requiredDuringSchedulingIgnoredDuringExecution:硬策略

(2)Pod 亲和性或反亲和性

pod.spec.affinity.podAffinity/podAntiAffinity

●preferredDuringSchedulingIgnoredDuringExecution:软策略

●requiredDuringSchedulingIgnoredDuringExecution:硬策略

数值运算关系

●In:label 的值在某个列表中

●NotIn:label 的值不在某个列表中

●Gt:label 的值大于某个值

●Lt:label 的值小于某个值

●Exists:某个 label 存在

●DoesNotExist:某个 label 不存在

承接上k8s的将pod调度到指定node的方法

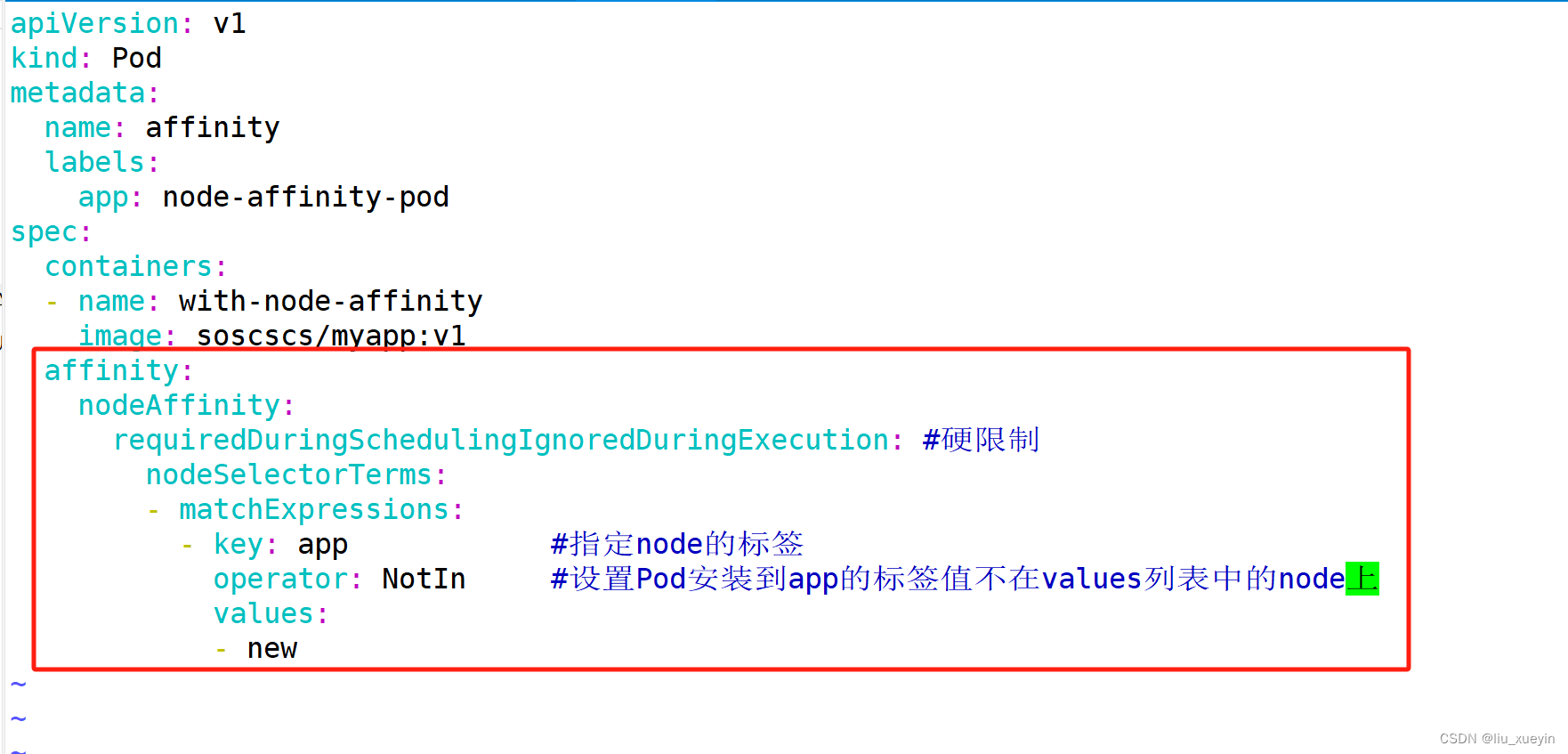

方案三:node亲和性

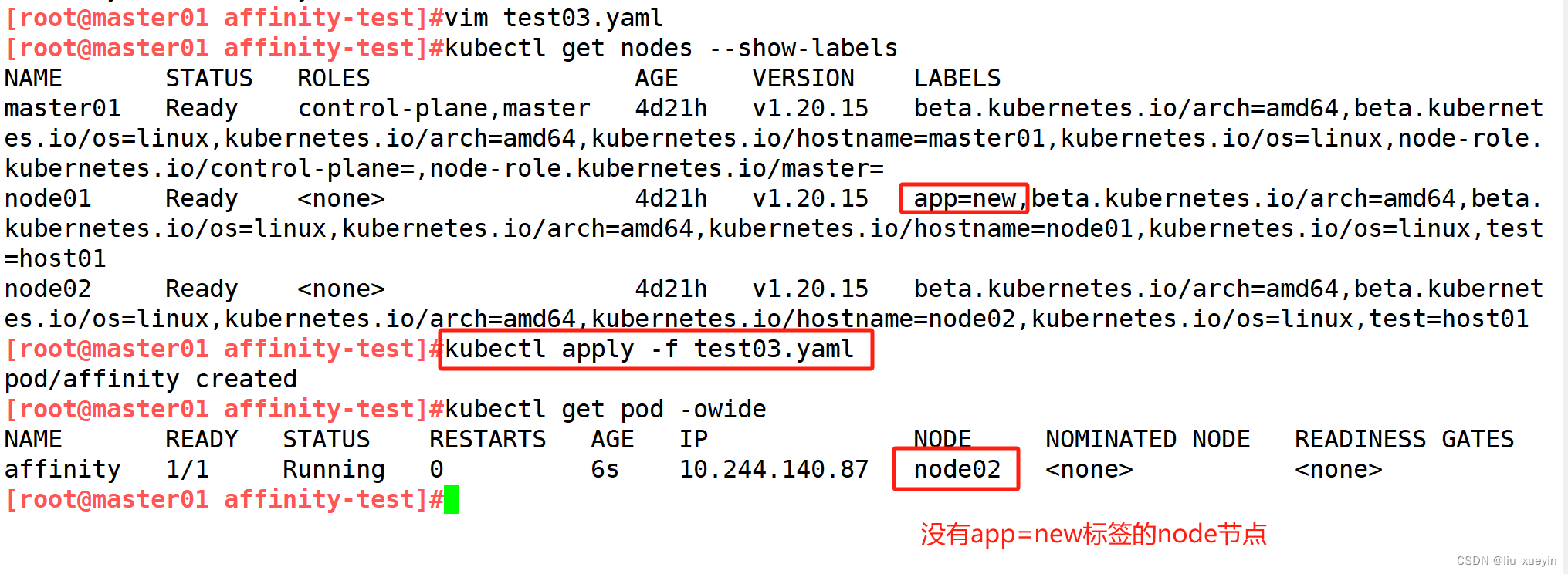

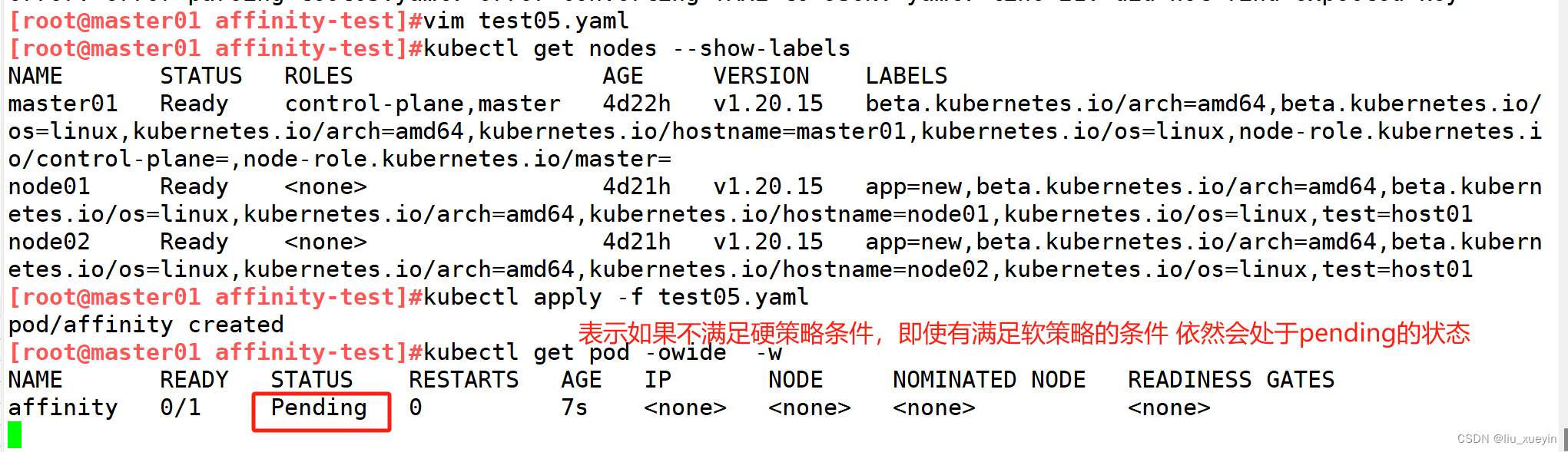

首先 关于硬策略测试 为强制满足才行

apiVersion: v1

kind: Pod

metadata:

name: affinity

labels:

app: node-affinity-pod

spec:

containers:

- name: with-node-affinity

image: soscscs/myapp:v1

affinity:

nodeAffinity:

requiredDuringSchedulingIgnoredDuringExecution: #硬限制

nodeSelectorTerms:

- matchExpressions:

- key: app #指定node的标签

operator: NotIn #设置Pod安装到app的标签值不在values列表中的node上

values:

- new

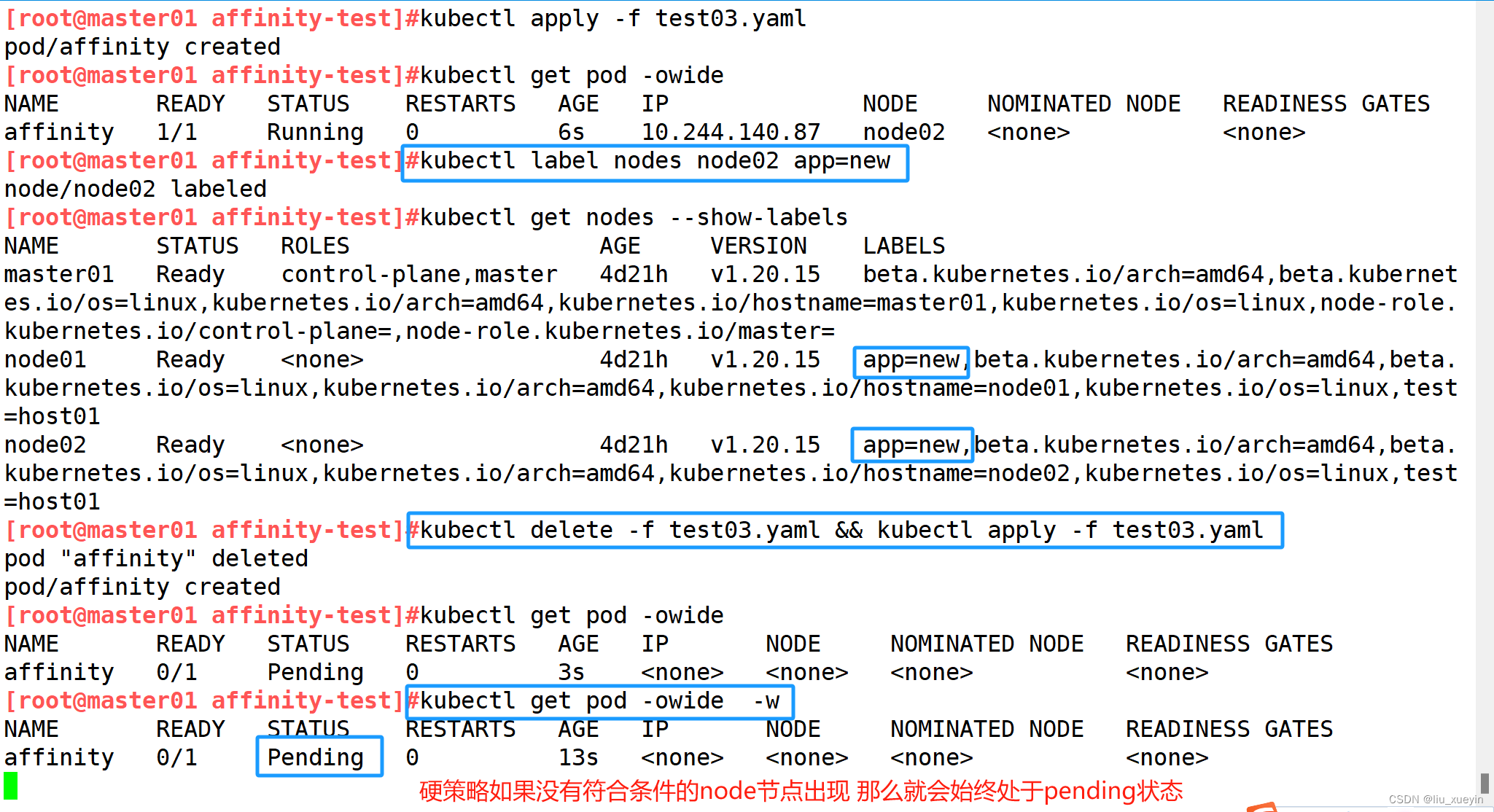

#如果硬策略不满足条件,Pod 状态一直会处于 Pending 状态。

#如果硬策略不满足条件,Pod 状态一直会处于 Pending 状态。

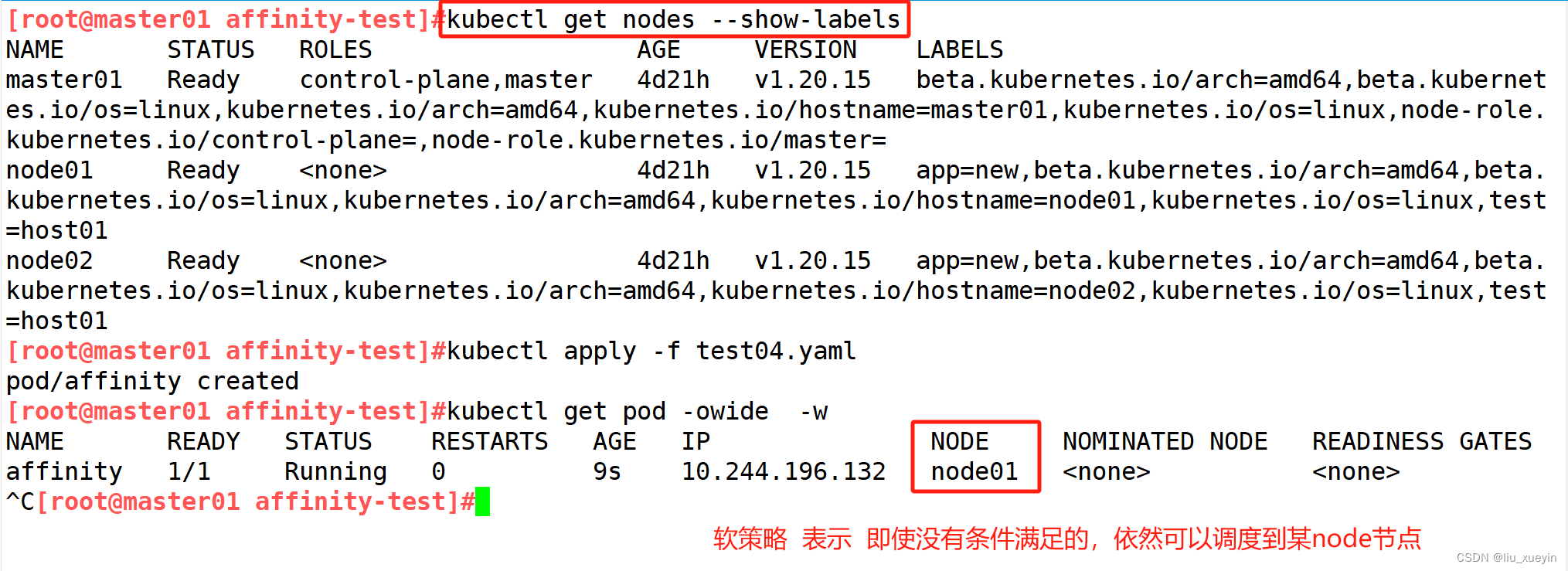

关于 preferredDuringSchedulingIgnoredDuringExecution:软策略

apiVersion: v1

kind: Pod

metadata:

name: affinity

labels:

app: node-affinity-pod

spec:

containers:

- name: with-node-affinity

image: soscscs/myapp:v1

affinity:

nodeAffinity:

preferredDuringSchedulingIgnoredDuringExecution: #软策略

- weight: 1 #如果有多个软策略选项的话,权重越大,优先级越高,范围是1-100

preference:

matchExpressions:

- key: app

operator: NotIn

values:

- new

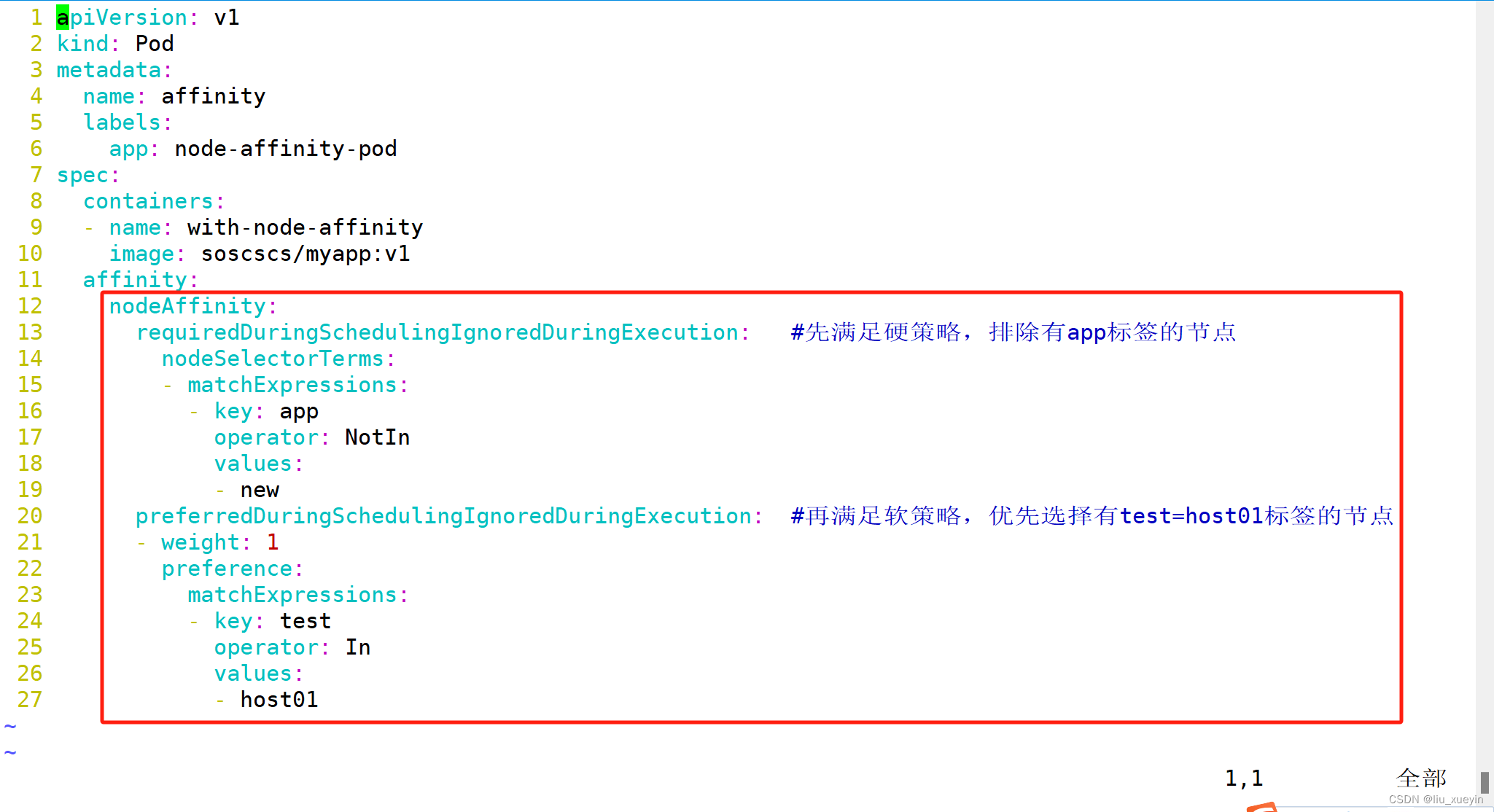

如果同时设置了硬策略和软策略

apiVersion: v1

kind: Pod

metadata:

name: affinity

labels:

app: node-affinity-pod

spec:

containers:

- name: with-node-affinity

image: soscscs/myapp:v1

affinity:

nodeAffinity: requiredDuringSchedulingIgnoredDuringExecution: #先满足硬策略,排除有app标签的节点

nodeSelectorTerms:

- matchExpressions:

- key: app

operator: NotIn

values:

- new

preferredDuringSchedulingIgnoredDuringExecution: #再满足软策略,优先选择有test=host01标签的节点

- weight: 1

preference:

matchExpressions:

- key: test

operator: In

values:

- host01

方案四:pod亲和性

调度策略匹配标签操作符 拓扑域支持调度目标nodeAffinity主机In, NotIn, Exists,DoesNotExist, Gt, Lt 否指定主机podAffinityPodIn, NotIn, Exists,DoesNotExist 是Pod与指定Pod同一拓扑域podAntiAffinityPodIn, NotIn, Exists,DoesNotExist 是Pod与指定Pod不在同一拓扑域

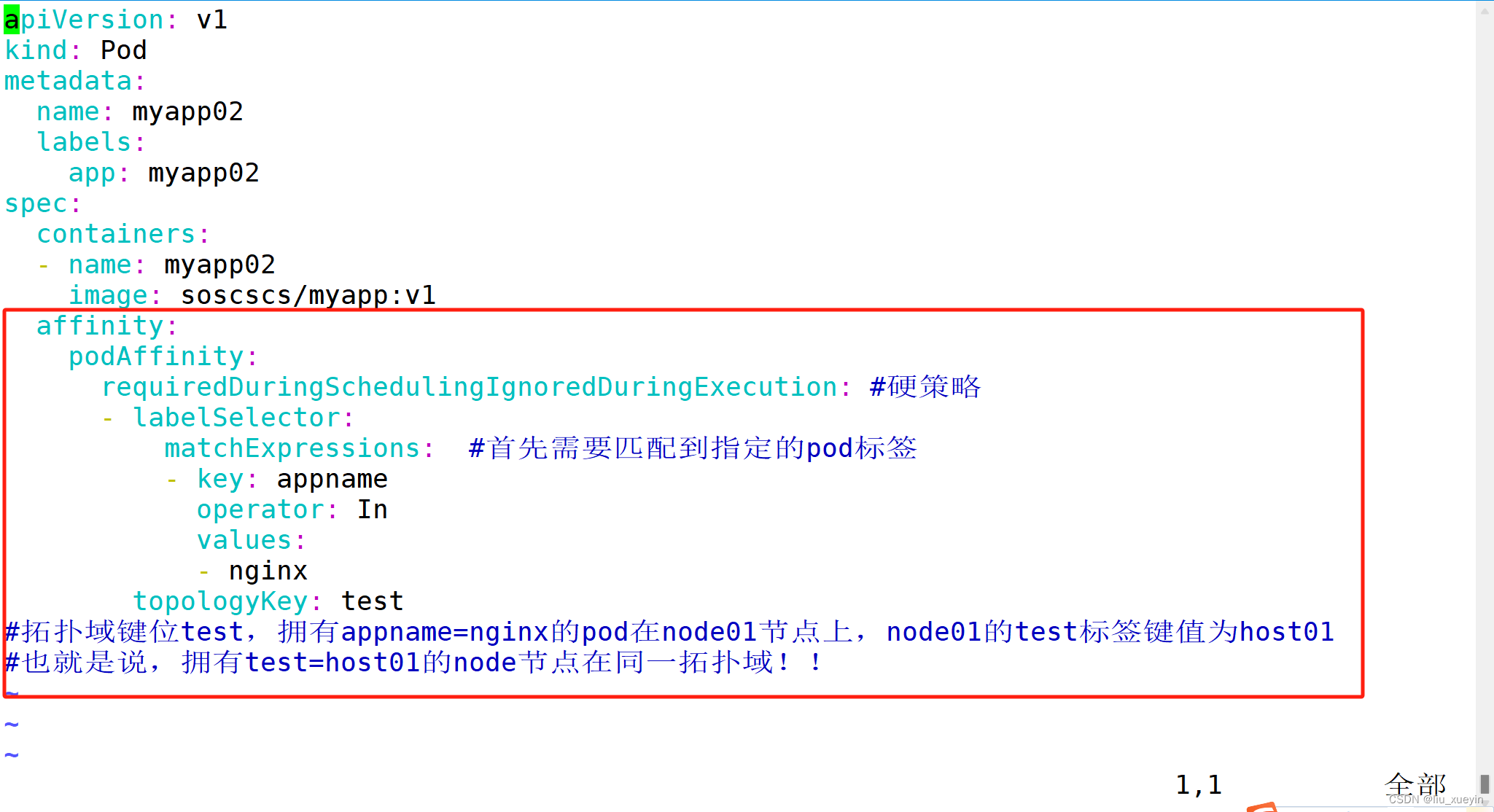

硬策略

apiVersion: v1

kind: Pod

metadata:

name: myapp02

labels:

app: myapp02

spec:

containers:

- name: myapp02

image: soscscs/myapp:v1

affinity:

podAffinity:

requiredDuringSchedulingIgnoredDuringExecution: #硬策略

- labelSelector:

matchExpressions: #首先需要匹配到指定的pod标签

- key: appname

operator: In

values:

- nginx

topologyKey: test

#拓扑域键位test,拥有appname=nginx的pod在node01节点上,node01的test标签键值为host01

#也就是说,拥有test=host01的node节点在同一拓扑域!!

#仅当节点和至少一个已运行且有键为“appname”且值为“nginx”的标签 的 Pod 处于同一拓扑域时,才可以将该 Pod 调度到节点上。 (更确切的说,如果节点 N 具有带有键 test和某个值 V 的标签,则 Pod 有资格在节点 N 上运行,以便集群中至少有一个具有键 test 和值为 V 的节点正在运行具有键“appname”和值 “nginx”的标签的 pod。)

#topologyKey 是节点标签的键。如果两个节点使用此键标记并且具有相同的标签值,则调度器会将这两个节点视为处于同一拓扑域中。 调度器试图在每个拓扑域中放置数量均衡的 Pod。

#如果 kgc 对应的值不一样就是不同的拓扑域。比如 Pod1 在test=host02 的 Node 上,Pod2 在 test=host01 的 Node 上,Pod3 在 test=host02 的 Node 上,则 Pod2 和 Pod1、Pod3 不在同一个拓扑域,而Pod1 和 Pod3在同一个拓扑域。

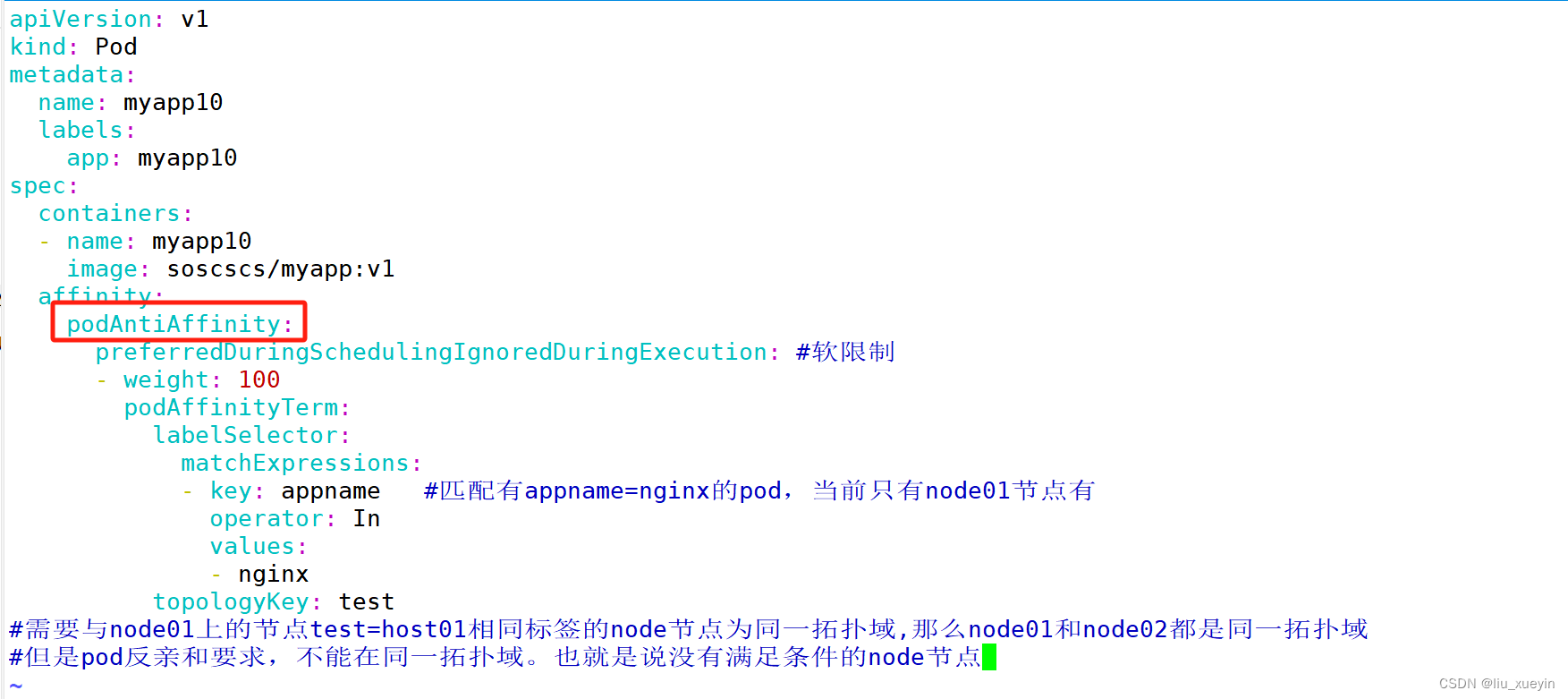

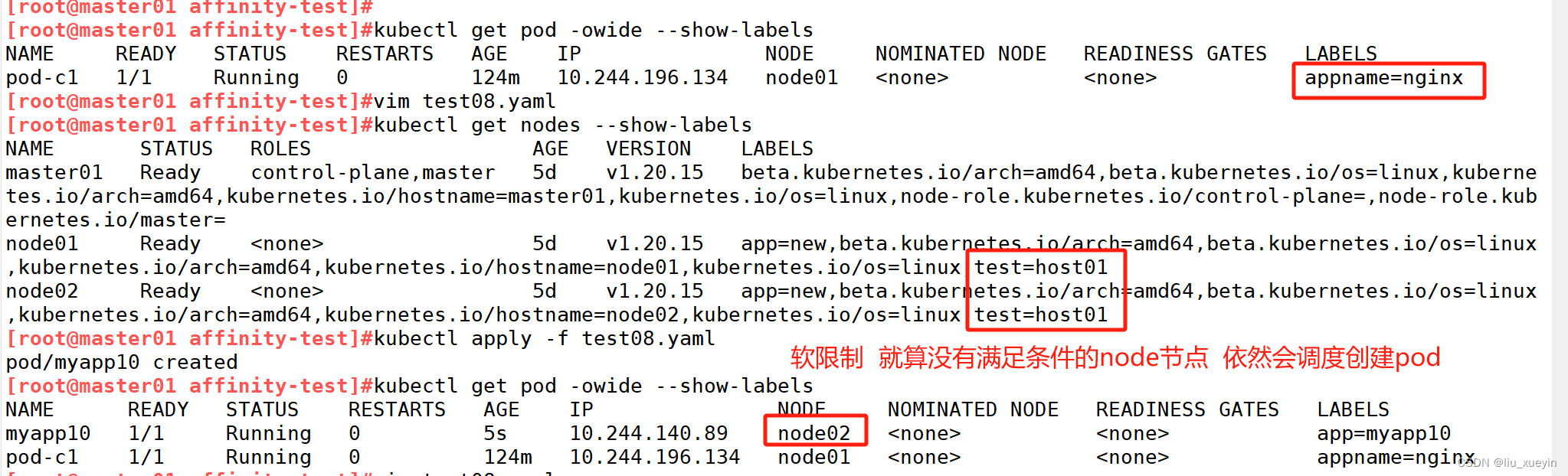

方案五:节点反亲和性

apiVersion: v1

kind: Pod

metadata:

name: myapp10

labels:

app: myapp10

spec:

containers:

- name: myapp10

image: soscscs/myapp:v1

affinity:

podAntiAffinity:

preferredDuringSchedulingIgnoredDuringExecution: #软限制

- weight: 100

podAffinityTerm:

labelSelector:

matchExpressions:

- key: appname #匹配有appname=nginx的pod,当前只有node01节点有

operator: In

values:

- nginx

topologyKey: test

#需要与node01上的节点test=host01相同标签的node节点为同一拓扑域,那么node01和node02都是同一拓扑域

#但是pod反亲和要求,不能在同一拓扑域。也就是说没有满足条件的node节点

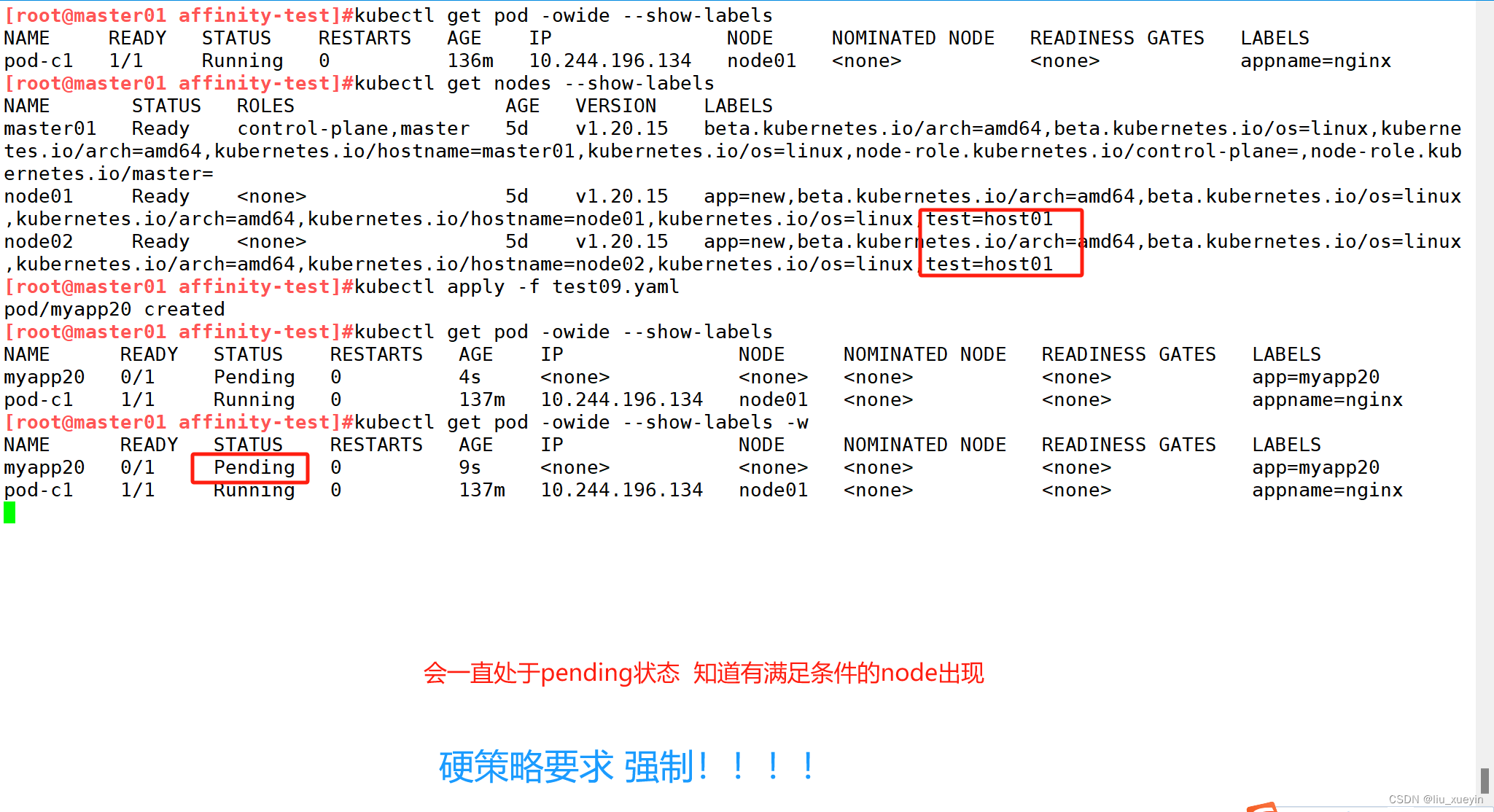

现在改为硬策略

apiVersion: v1

kind: Pod

metadata:

name: myapp20

labels:

app: myapp20

spec:

containers:

- name: myapp20

image: soscscs/myapp:v1

affinity:

podAntiAffinity:

requiredDuringSchedulingIgnoredDuringExecution: #改为硬策略

- labelSelector:

matchExpressions:

- key: appname #还是需要找到有appname=nginx标签的pod,目标pod在node01节点

operator: In

values:

- nginx

topologyKey: test #现在pod反亲和,node01的test=host01为同一拓扑域的还有node02,所以没有满足条件的node

六、总结:

如何指定node节点调度Pod?(未完待续)

- 1)使用 nodeName 字段指定node节点名称

- 2)使用nodeselector 字段指定node节点的标签

- 3)使用节点亲和性Pod亲和性 Pod反亲和性

Pod的3种亲和性有哪些?

- 节点亲和性(nodeAffinity):匹配指定node节点的标签,将待部署的pod调度到满足条件的node节点上

- Pod亲和性(podAffinity):匹配指定pod的标签,将待部署的Pod调度到与指定Pod所在的node节点处于同一个拓扑域的node节点上(如果有多个node节点属于同一个拓扑域,通过pod亲和性部署Pod时,scheduler会试图将pod均衡的调度到处于同一个拓扑域的node节点上)

- Pod反亲和性(podAntiAffinity):匹配指定pod的标签,将待部署的pod调度到与指定pod所在的node节点处于不同的拓扑域的node节点上(如果有多个nde节点不属于同一个拓扑域,通过pod反亲和性部署?od时,scheduler会试图将Pod均衡的调度到不处于同一个拓扑域的node节点上)

如何判断node节点是否在同一个拓扑域?

根拓扑域key(topologyKey)判断,如果有其它node节点拥有与指定Pod所在的node节点相同的拓扑域key和yalue,那么这些node节点就属千同一个拓扑域

亲和性的2种策略?

- 硬策略(reguired..):要强制性的满足条件,如果没有满足条件的node节点,Pod会处于pending状态,直到有符合条件的node节点出现可理解成必须要满足条件,不满足不行,

- 软策略(preferred....):非强制性的,会优先选择满足条件的node节点进行调度,即使没有满足条件的node节点,Pod依然会完成调度。可理解成最好能满足条件,不满足也行

版权归原作者 运维菜鸟XY 所有, 如有侵权,请联系我们删除。