Dask库一个神奇处理大数据在python的库

Dask库,一个神奇处理大数据的库

什么是 Dask?

- Dask 是一个灵活的并行计算库,旨在处理大规模数据集.它提供了类似于 Pandas 和 NumPy 的数据结构,但能够有效地处理比内存更大的数据集.Dask 可以在单台机器或分布式集群中运行,使得大规模数据处理变得更加容易.

如何使用 Dask 库?

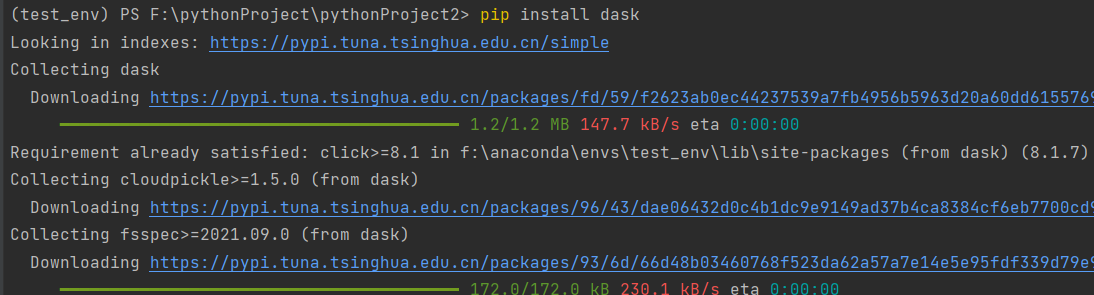

安装 Dask:

pip install dask

导入 Dask 模块:

#在Python脚本或Jupyter Notebook 中导入所需的 Dask 模块,如

import dask.

创建 Dask 数据结构:

- 使用 Dask 提供的 DataFrame(dask.dataframe)或 Array(dask.array)等数据结构处理大型数据集.

应用 Dask 操作:

- 利用 Dask 提供的并行化操作,对数据进行处理、转换和分析

执行计算:

- 通过调用.compute()方法将延迟计算触发执行,并获取结果.

优缺点

优点:

可扩展性:

- Dask 可以处理比内存更大的数据集,并支持分布式计算.

并行性:

- Dask 提供了并行化操作,能够以并行方式处理数据计算任务.

与其它库兼容:

- Dask 与常见的 Python 数据处理库(如 NumPy、Pandas 和 Scikit-learn)兼容.

缺点:

学习曲线:

- 对于新手来说,学习如何正确使用 Dask 可能需要一些时间.

性能开销:

- 由于需要管理分布式计算,可能存在一些性能开销.

复杂性:

- 处理分布式计算的复杂性可能增加代码的复杂性.

示例案例分析

- 假设我们有一个大型 CSV 文件,其中包含销售数据,我们想要使用 Dask 处理该文件.以下是一些示例代码:

import dask.dataframe as dd

# 从 CSV 文件创建 Dask DataFrame

df = dd.read_csv('sales_data.csv')

# 查看数据集的前几行print(df.head())

# 进行分组聚合操作

total_sales = df.groupby('product_category').total_sales.sum()

# 执行计算

result = total_sales.compute()print(result)

- 在这个示例中,我们使用 Dask 读取大型 CSV 文件,并使用分组聚合操作计算每个产品类别的总销售额.最后,通过调用.compute()方法,我们触发计算并获取结果.

如何使用dask 进行超参数优化?

- 超参数优化是机器学习模型调参的重要步骤之一,可以通过网格搜索、随机搜索或贝叶斯优化等技术来找到最佳超参数组合。在使用 Dask 进行超参数优化时,通常会结合其并行计算能力来加快搜索过程。以下是如何使用 Dask 进行超参数优化的一般步骤:

选择超参数搜索方法:

- 确定使用的超参数优化方法,例如网格搜索、随机搜索、贝叶斯优化等

定义模型和评估指标:

- 选择要调参的机器学习模型,并确定用于评估模型性能的指标(如准确率、F1 分数等)

创建超参数空间:

- 定义超参数的搜索空间,包括每个超参数可能的取值范围

设置并行计算:

- 利用 Dask 的并行计算功能,将超参数搜索过程分布在多个核心或节点上以加速搜索过程

执行超参数搜索:

- 根据选定的优化方法,在超参数空间中搜索最佳超参数组合,并评估模型性能

选择最佳超参数组合:

- 根据评估指标选择性能最佳的超参数组合作为最终模型的参数。

- 下面是一个简单示例,展示如何使用 Dask 和 Scikit-learn 结合进行并行超参数优化:

from dask.distributed import Client

from dask_ml.model_selection import GridSearchCV

from sklearn.ensembleimport RandomForestClassifier

from sklearn.datasets import make_classification

# 创建 Dask 客户端

client = Client()

# 创建随机森林分类器

clf = RandomForestClassifier()

# 定义超参数搜索空间

param_grid = {'n_estimators': [10, 100, 1000],

'max_depth': [None, 10, 20]}

# 创建 GridSearchCV 对象

grid_search = GridSearchCV(clf, param_grid, scoring='accuracy')

# 生成示例数据

X, y = make_classification(n_samples=1000, n_features=20)

# 执行超参数搜索with client:

grid_search.fit(X, y)

# 获取最佳超参数组合和对应性能

best_params = grid_search.best_params_

best_score = grid_search.best_score_

print("Best Parameters:", best_params)print("Best Score:", best_score)

- 在这个示例中,我们使用了Dask提供的GridSearchCV类来执行并行化的网格搜索超参数优化流程.通过与Scikit-learn 结合使用,我们可以方便地利用Dask的并行计算能力来加速超参数搜索.

- 感谢大家的关注和支持!想了解更多Python编程精彩知识内容,请关注我的 微信公众号:python小胡子,有最新最前沿的的python知识和人工智能AI与大家共享,同时,如果你觉得这篇文章对你有帮助,不妨点个赞,并点击关注.动动你发财的手,万分感谢!!!

版权归原作者 python茶水实验室 所有, 如有侵权,请联系我们删除。