实验目的:掌握Spark Standalone部署模式

实验方法:基于centos7部署Spark standalone模式集群

实验步骤:

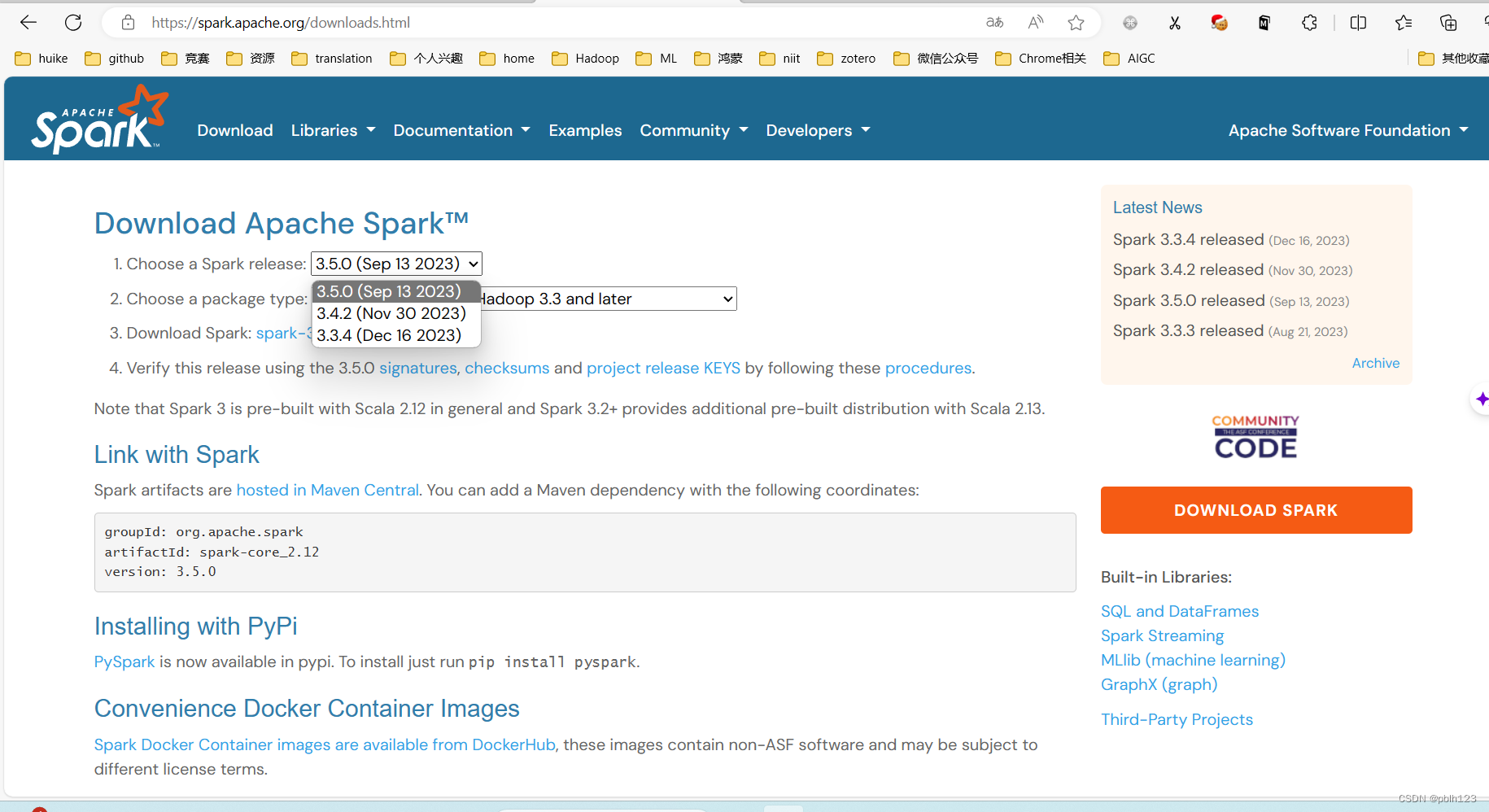

一、下载spark软件

下载的时候下载与自己idea里对应版本的spark

News | Apache Spark

选择任意一个下载即可

- spark 3.4.1

- spark 3.4.2

二、安装Standalone模式部署spark

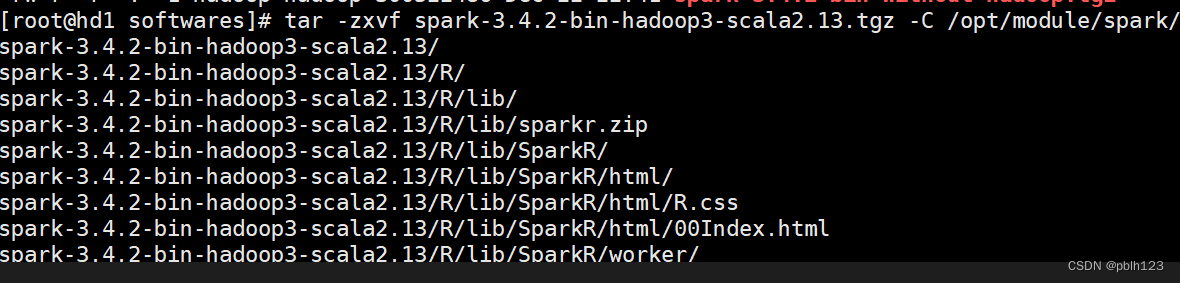

将下载好的spark软件上传到指定的linux集群中

# 解压到指定目录

tar -zxvf spark-3.4.2-bin-hadoop3-scala2.13.tgz -C /opt/module/spark/

# 更改所有权

chown -R hadoop:hadoop spark-3.4.2-bin-hadoop3-scala2.13/

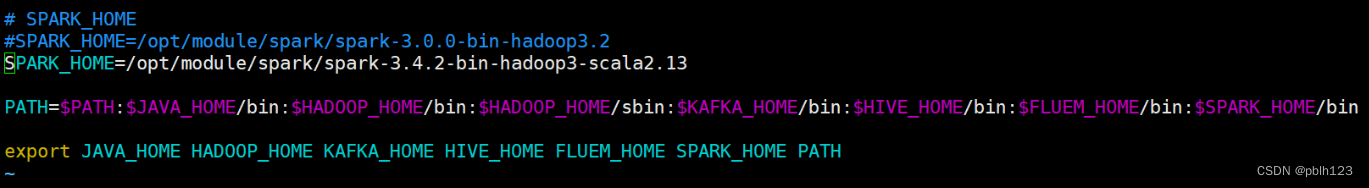

配置环境变量

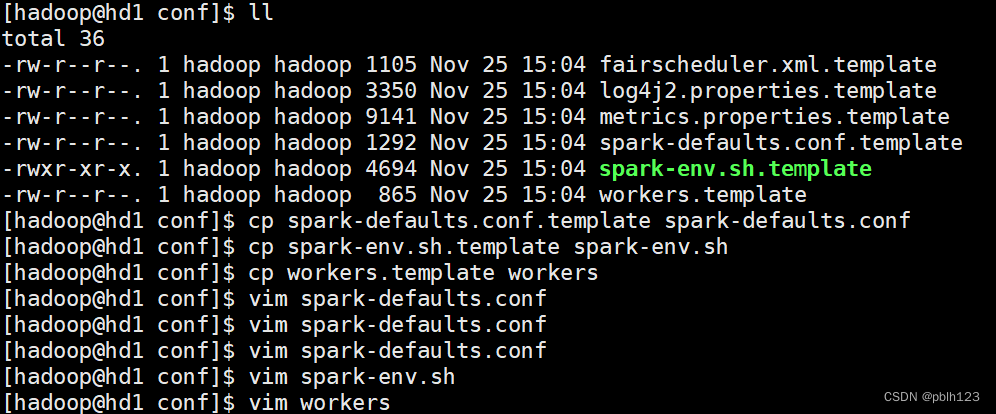

配置Spark配置文件

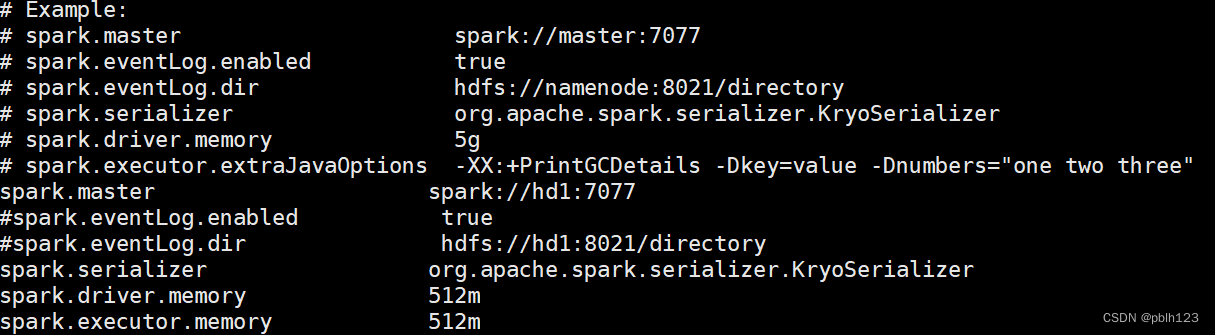

spark-defaults.conf

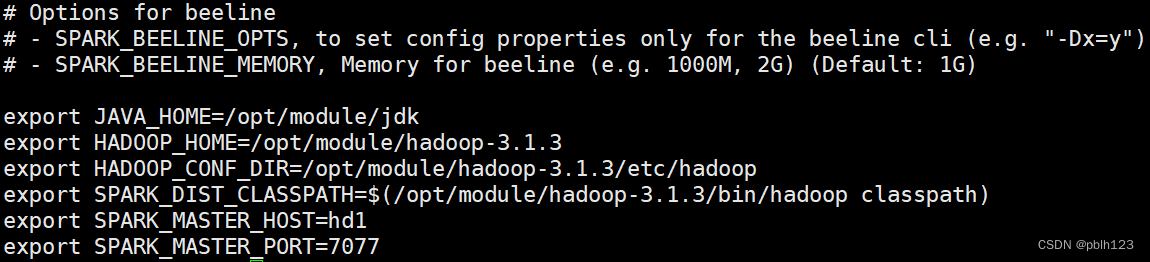

spark-env.sh

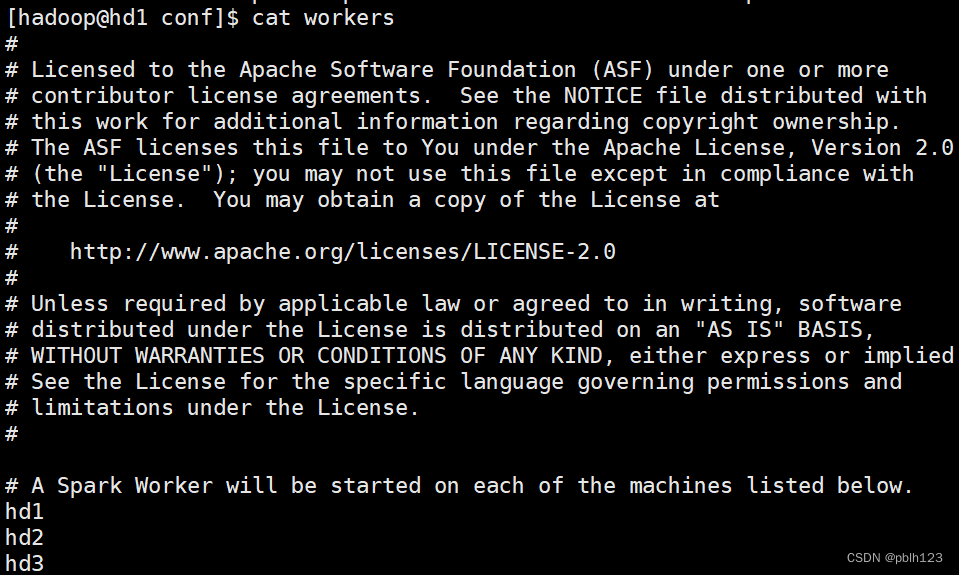

workers

spark-defaults.conf配置如下

spark-env.sh配置如下

workers配置如下

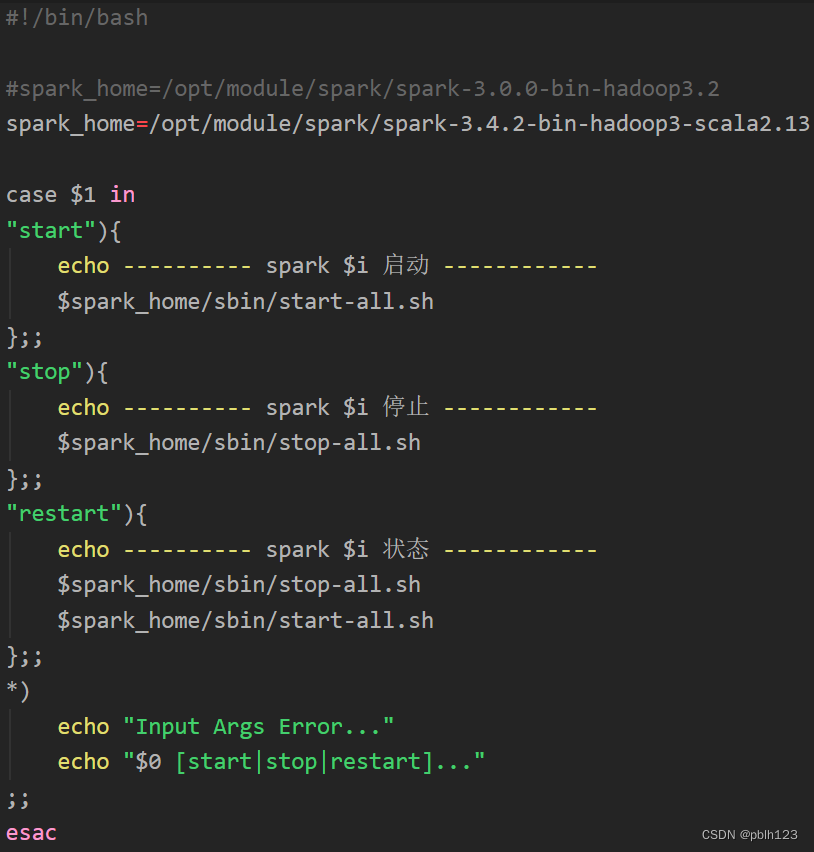

配置spark一键启动脚本

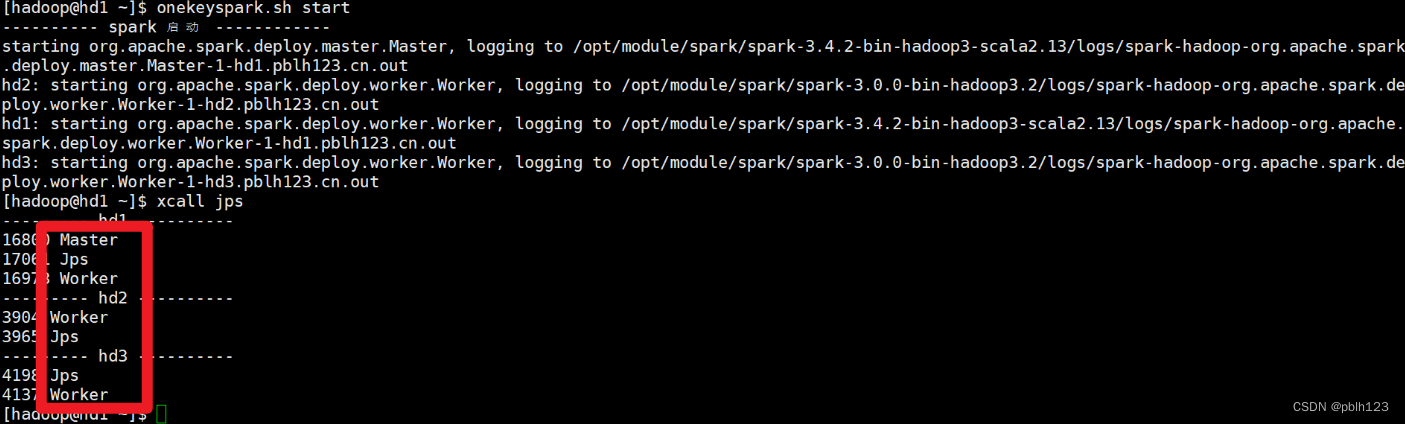

启动spark standalone模式集群

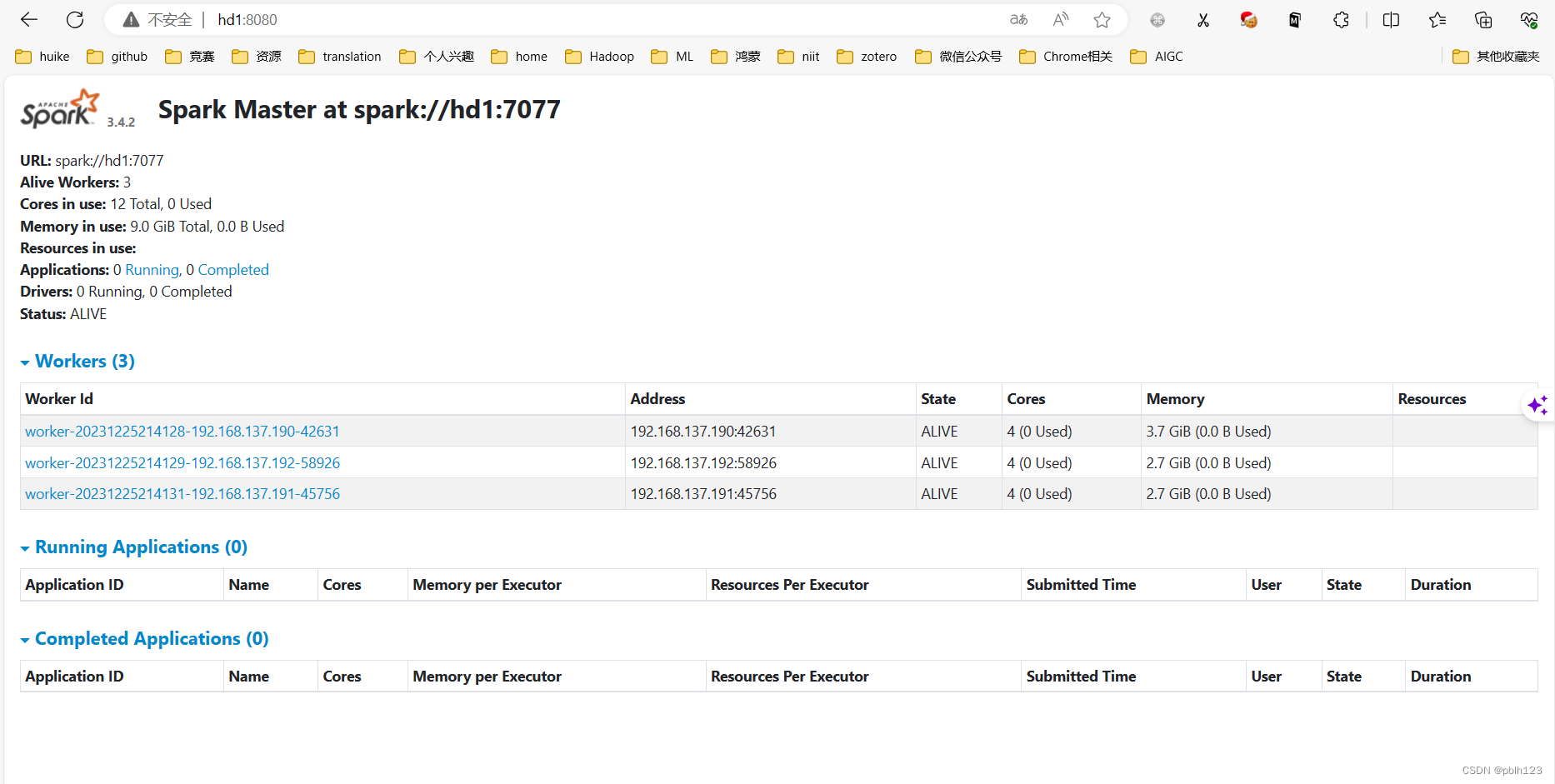

三、验证Spark Standalone模式集群

登录hd1节点查看spark webUI 【记得改成自己对应的集群ip】

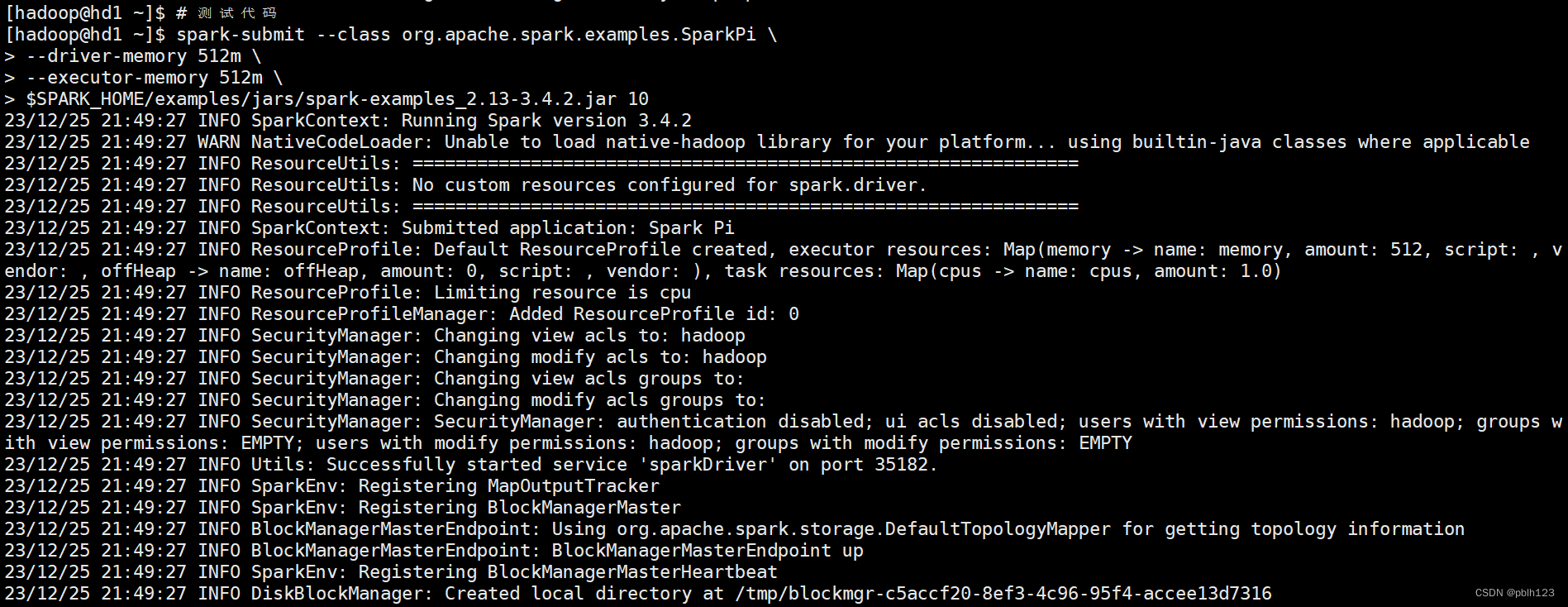

# 测试代码

spark-submit --class org.apache.spark.examples.SparkPi \

--driver-memory 512m \

--executor-memory 512m \

$SPARK_HOME/examples/jars/spark-examples_2.13-3.4.2.jar 10

spark-submit --class org.apache.spark.examples.SparkPi \

$SPARK_HOME/examples/jars/spark-examples_2.13-3.4.2.jar 10

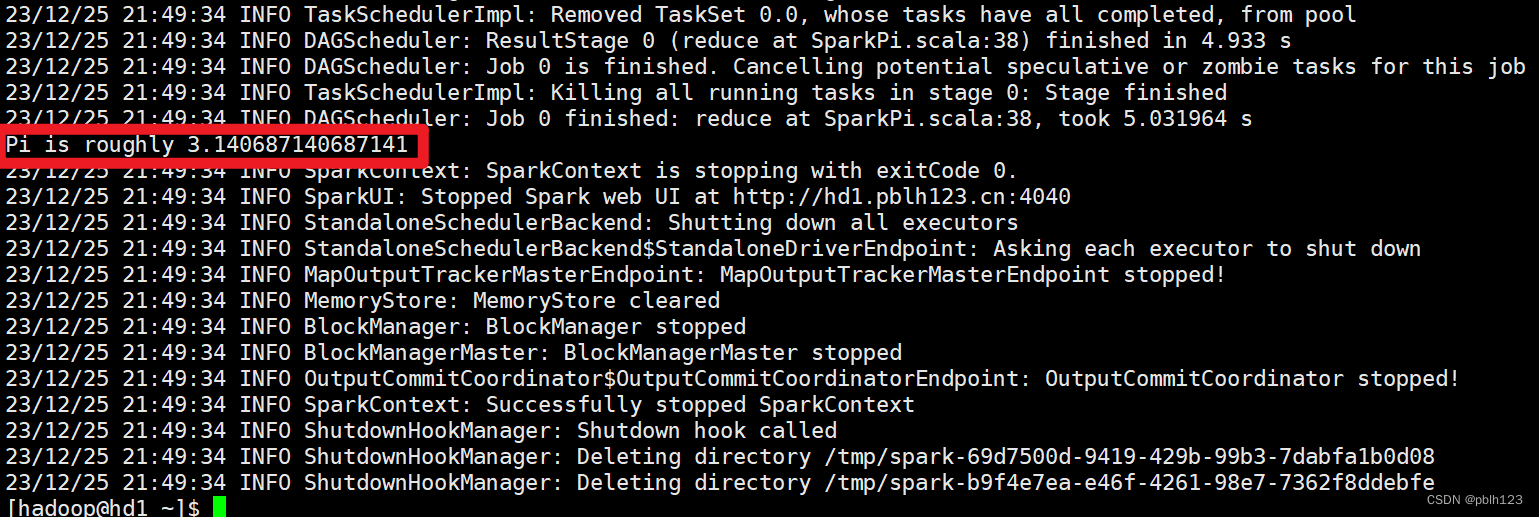

实验结果:基于centos7完成Spark standalone模式集群部署

分析一个小工具,文件同步工具xsync,该工具可以将hd1节点上文件,文件夹分发到hd1,hd2,hd3节点

版权归原作者 pblh123 所有, 如有侵权,请联系我们删除。