一:首先下载Scala和spark的安装包

Scala安装包

All Available Versions | The Scala Programming Language (scala-lang.org)

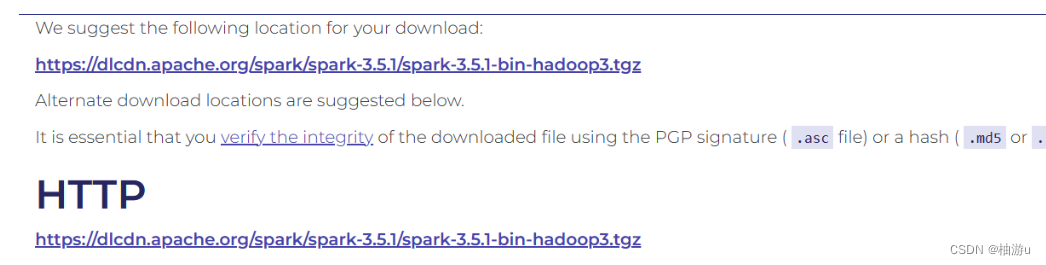

spark安装包

Apache Download Mirrors

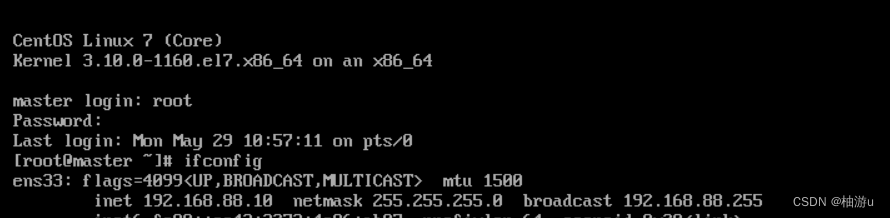

二:启动虚拟机查看ip

修改网关连接xshell

将安装包使用xftp导入到虚拟机

三,Scala的安装配置

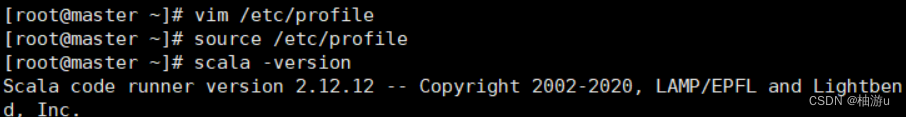

解压安装包 tar -zxvf /opt/scala-2.12.12.tgz -C /opt/

配置环境变量

vim /etc/profile

#SCALA

export SCALA_HOME=/opt/scala-2.12.12

export PATH=$PATH:${SCALA_HOME}/bin

使用source /etc/profile使环境生效,然后再用scala -version查看安装成功没,出现2.12.12即为成功。

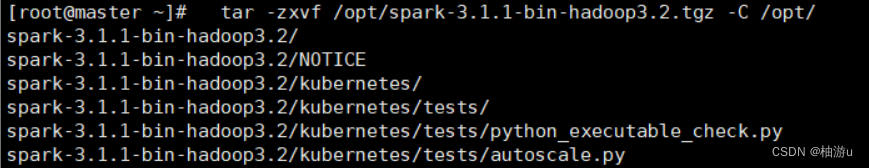

四,进行spark的安装部署

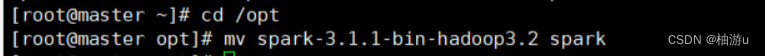

解压spark安装包 tar -zxvf /opt/spark-3.1.1-bin-hadoop3.2.tgz -C /opt/

修改名字以便操作

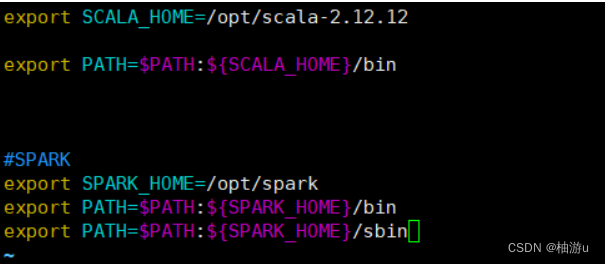

配置环境变量 vim /etc/profile

#SPARK

export SPARK_HOME=/opt/spark

export PATH=$PATH:${SPARK_HOME}/bin

export PATH=$PATH:${SPARK_HOME}/sbin

使用source /etc/profile使环境生效

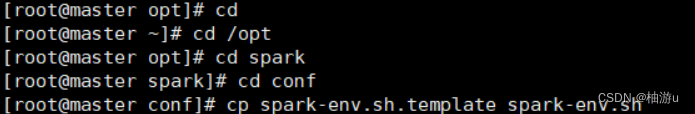

修改配置文件 进入spark里的conf目录备份文件

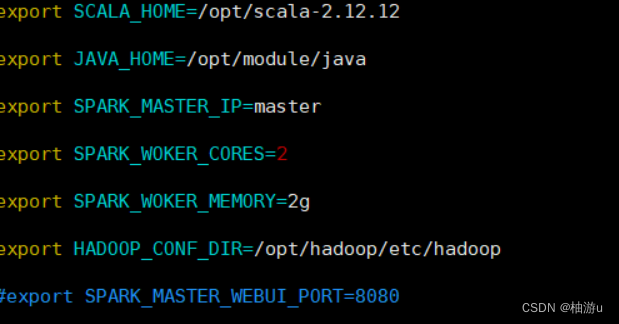

修改配置文件 在spark下的conf目录打开env vim spark-env.sh

export SCALA_HOME=/opt/scala-2.12.12

export JAVA_HOME=/opt/module/java

export SPARK_MASTER_IP=master

export SPARK_WOKER_CORES=2

export SPARK_WOKER_MEMORY=2g

export HADOOP_CONF_DIR=/opt/hadoop/etc/hadoop

#export SPARK_MASTER_WEBUI_PORT=8080

#export SPARK_MASTER_PORT=7070

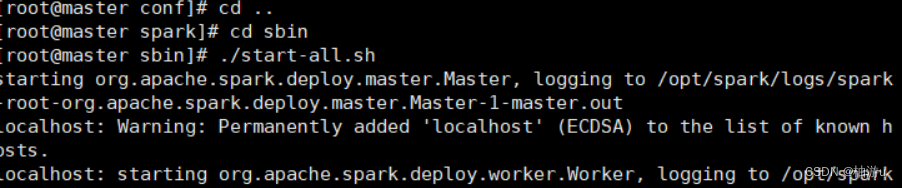

启动集群:spark下sbin目录下:./start-all.sh

使用jps查看 有master就是正确的

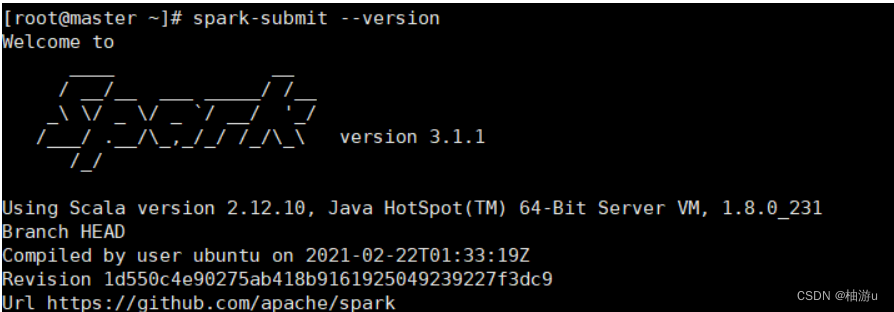

查看spark是否安装成功 返回主目录下输入spark-submit --version

版权归原作者 柚游u 所有, 如有侵权,请联系我们删除。