需求:配置Kettle连接大数据HDFS

Kettle对接大数据平台的配置

一.软件环境

1.Hadoop集群,版本:Hadoop3.3.0

2.ETL工具Kettle,版本:pdi-ce-7.0.0.0-25

(解压命令:*.zip 用 unzip 解压)

3.MySQL服务器,版本:mysql5.7.37

二.修改Kettle配置文件

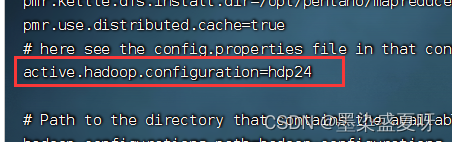

1.文件名称:

/home/hadoop/software\data-integration\plugins\pentaho-big-data-plugin\plugin.properties

2.修改参数:

active.hadoop.configuration=hdp24

- Kettle连接HDFS需要替换的Hadoop文件

文件路径:

/home/centos01/software/data-integration/plugins/pentaho-big-data-plugin/hadoop-configurations/hdp24

文件名称:

1. core-site.xml

2. mapred-site.xml

3. yarn-site.xml

如果需要使用HBase集群,hbase-site.xml文件也需要替换

替换命令:

cp yarn-site.xml /home/centos01/software/data-integration/plugins/pentaho-big-data-plugin/hadoop-configurations/hdp24

(依次替换即可)

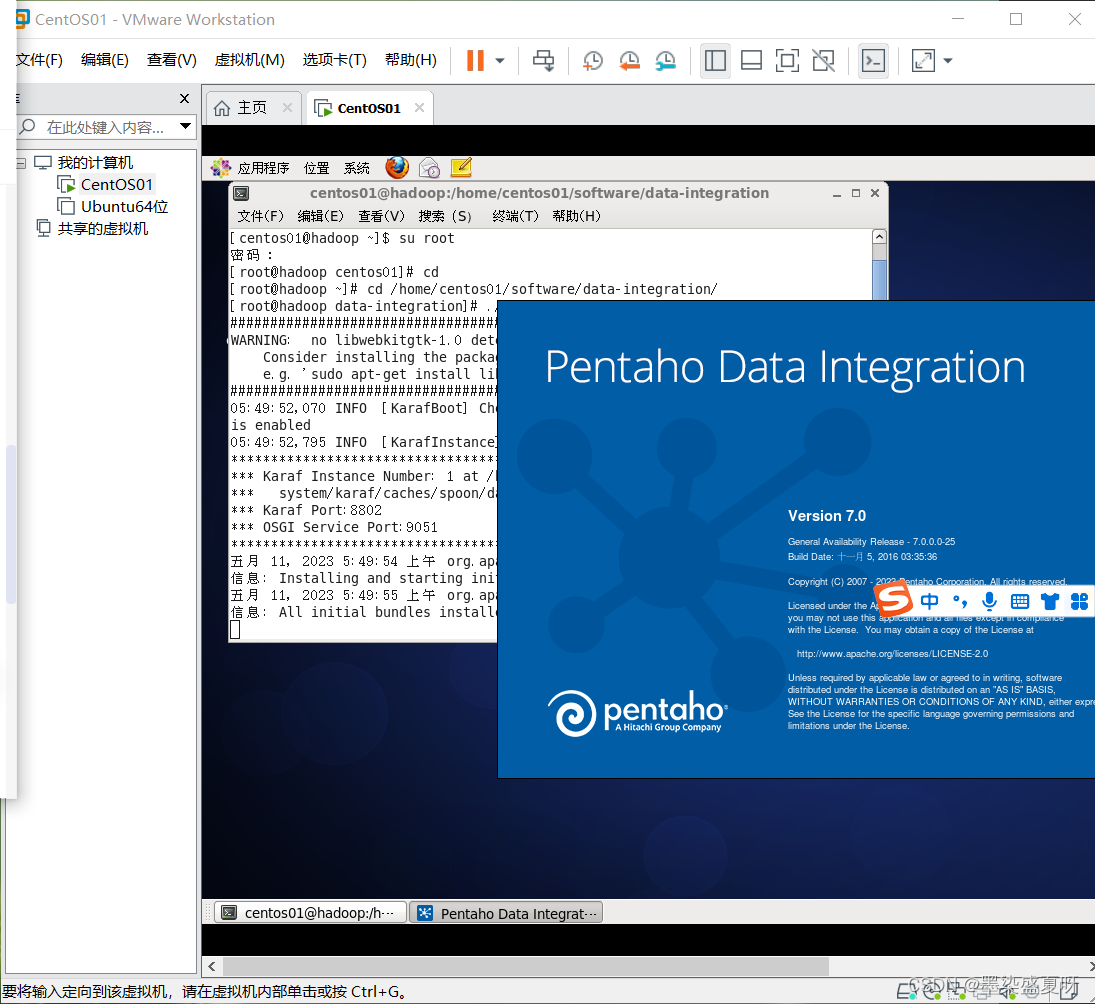

之后输入spoon.sh即可进入该软件:

双击hadoop的output文件,进行配置:

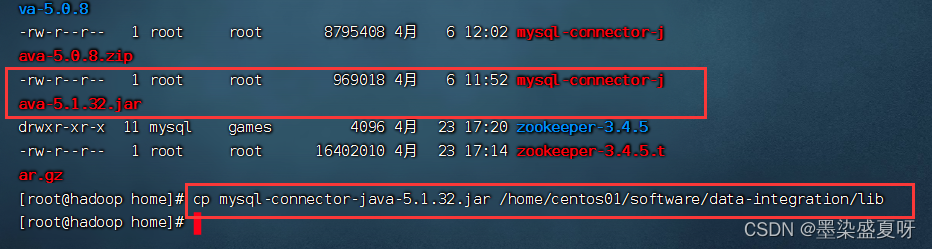

三.配置Kettle连接MySQL

命令:

cp mysql-connector-java-5.1.32.jar /home/centos01/software/data-integration/lib

四、配置Kettle连接HDFS

这里的bigdata001.txt文件将用来存储后面同步的数据:

传输数据:

数据已同步到大数据平台:

即可。

版权归原作者 墨染盛夏呀 所有, 如有侵权,请联系我们删除。