前言

Controlnet 横空出世以来,Stable Diffusion 从抽卡模式变为 引导控制模式,产生了质的飞跃,再也不用在prompt中钻研如何描述生成人物的动作模式,他对AI画师来说生产力提高不知道多少倍,文末附100个Lora资源方便大家使用。对于论文作者,某渣深感佩服。

ControlNet直译即是控制网,是一个基于 Stable Diffusion 1.5 的轻型预训模型,在开发者张吕敏的论文demo中,他解释说ControlNet通过输入条件来控制预先训练的大型扩散模型,能利用输入图片(input image)里的边缘特征、深度特征 或 人体姿势的骨架特征(posture skeleton),配合文字 prompt,精确引导图像在 SD 1.5 里的生成结果。

这很好地解决了文生图大模型无法控制生成图片的细节这个难题。

简述

深度模式是Controlnet中可以使用的模式之一,

Depth模型是通过提取图片中的深度信息,进而生成具有同样深度结构的图。当原图中的人物有前后关系时,depth的效果更好。

深度模式的方式不在此文赘述,后期研究到了的时候再进行补充。本文仅对深度图像库插件进行总结。

安装

插件地址:https://download.csdn.net/download/bestpasu/87762319 GitHub - jexom/sd-webui-depth-lib: Depth map library for use with the Control Net extension for Automatic1111/stable-diffusion-webui

Depth map library for use with the Control Net extension for Automatic1111/stable-diffusion-webui。

Stable Diffusion 深度图像编辑器插件,配合ControlNet 插件进行图像生成引导,常被用于人像生成中引导手部生成使用。

该插件可在SD中对深度文件进行管理、编辑、生成,其自身已携带了部分手型深度图库,可直接支持常规手部动作。(常规的意思就是常见,火影的结印都不包括……需要的话可以通过3D工具生成)

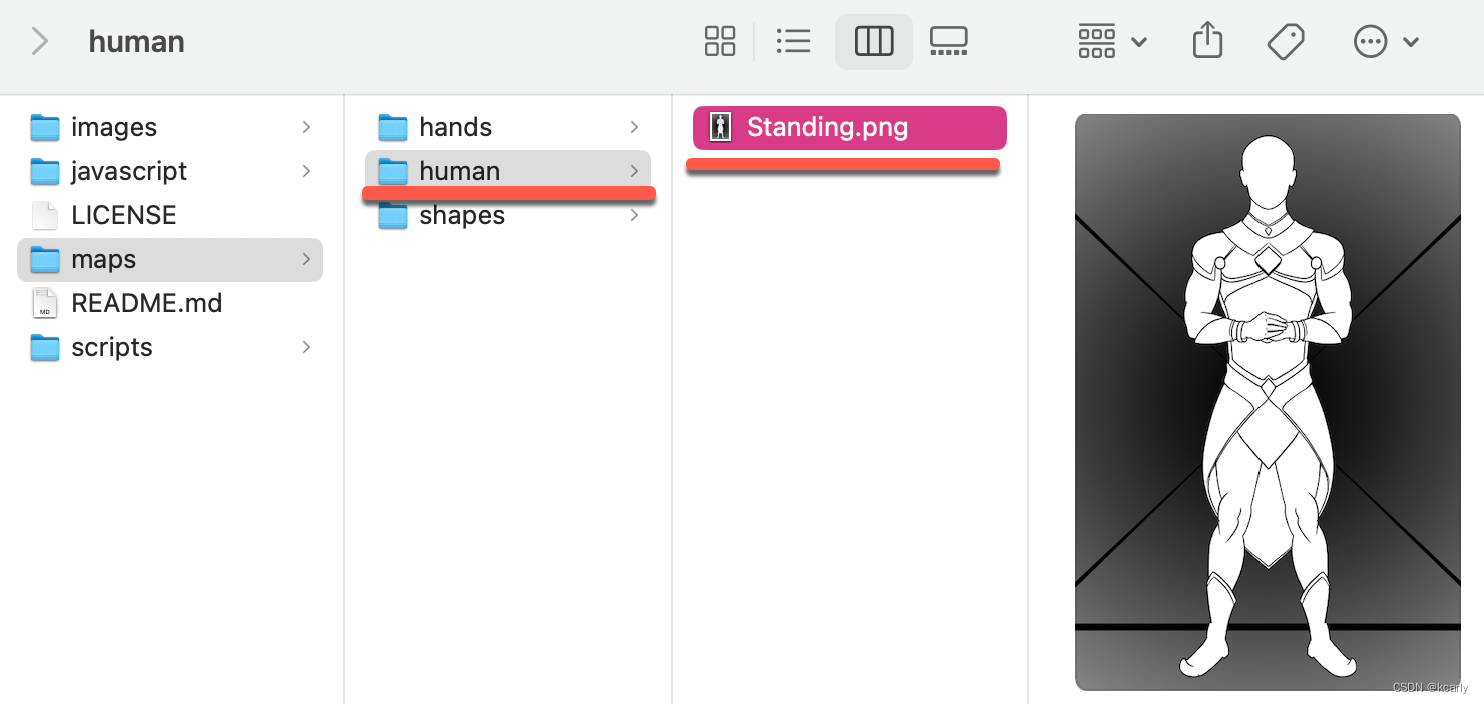

插件的安装比较简单,下载插件后,将其解压在插件目录即可:

~/stable-diffusion-webui/extensions/

插件结构

插件文档结构如下:

.

├── LICENSE

├── README.md

├── images

│ └── ui.png

├── javascript

│ ├── fabric.js

│ └── main.js

├── maps

│ ├── hands

│ │ ├── 1_back.png

│ │ ├── 1_front.png

│ │ ├── 2_back.png

│ │ ├── 2_close_back.png

│ │ ├── 2_close_front.png

│ │ ├── 2_front.png

│ │ ├── 3_close_back.png

│ │ ├── 3_close_front.png

│ │ ├── 3_spread_back.png

│ │ ├── 3_spread_front.png

│ │ ├── 4_back.png

│ │ ├── 4_front.png

│ │ ├── 5_back.png

│ │ ├── 5_front.png

│ │ ├── YEAH_ROCK_a.png

│ │ ├── YEAH_ROCK_b.png

│ │ ├── bene_1.png

│ │ ├── bene_2.png

│ │ ├── birdie.png

│ │ ├── bowl.png

│ │ ├── bowl_open.png

│ │ ├── fist_bottom.png

│ │ ├── fist_front.png

│ │ ├── fist_side_a.png

│ │ ├── fist_side_b.png

│ │ ├── fist_top.png

│ │ ├── heart_half.png

│ │ ├── knuckle_crack.png

│ │ ├── point_front.png

│ │ ├── point_side_a.png

│ │ └── point_side_b.png

│ └── shapes

│ ├── circle.png

│ ├── hexagon.png

│ ├── square.png

│ └── star.png

└── scripts

├── __pycache__ │ └── main.cpython-310.pyc └── main.py

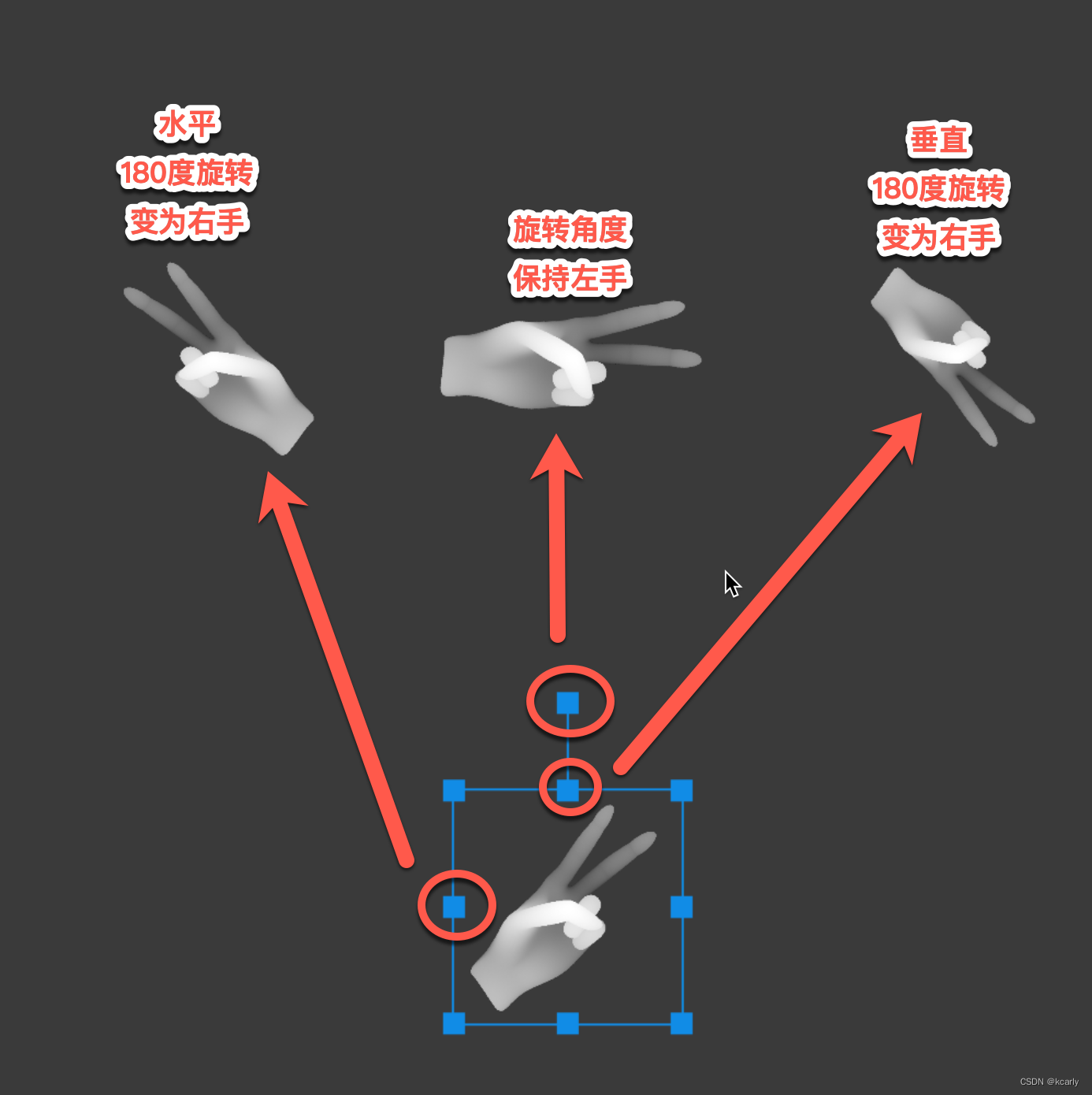

通过插件文档结构,我们可以看到maps 目录下 有 hands 和 shapes 两个目录,hands目录为手型深度模型图,全为左手(在编辑模式下只要180度水平翻转即可变成右手)。shapes目录为作者的示意目录,maps目录下可以任意新建目录存储不同类别的深度图像。创建后,重载UI界面或重启SD后便可在插件中显示。

通过该插件可方便管理深度图模型库,很方便。

使用

下面介绍下具体的用法及一些要点:

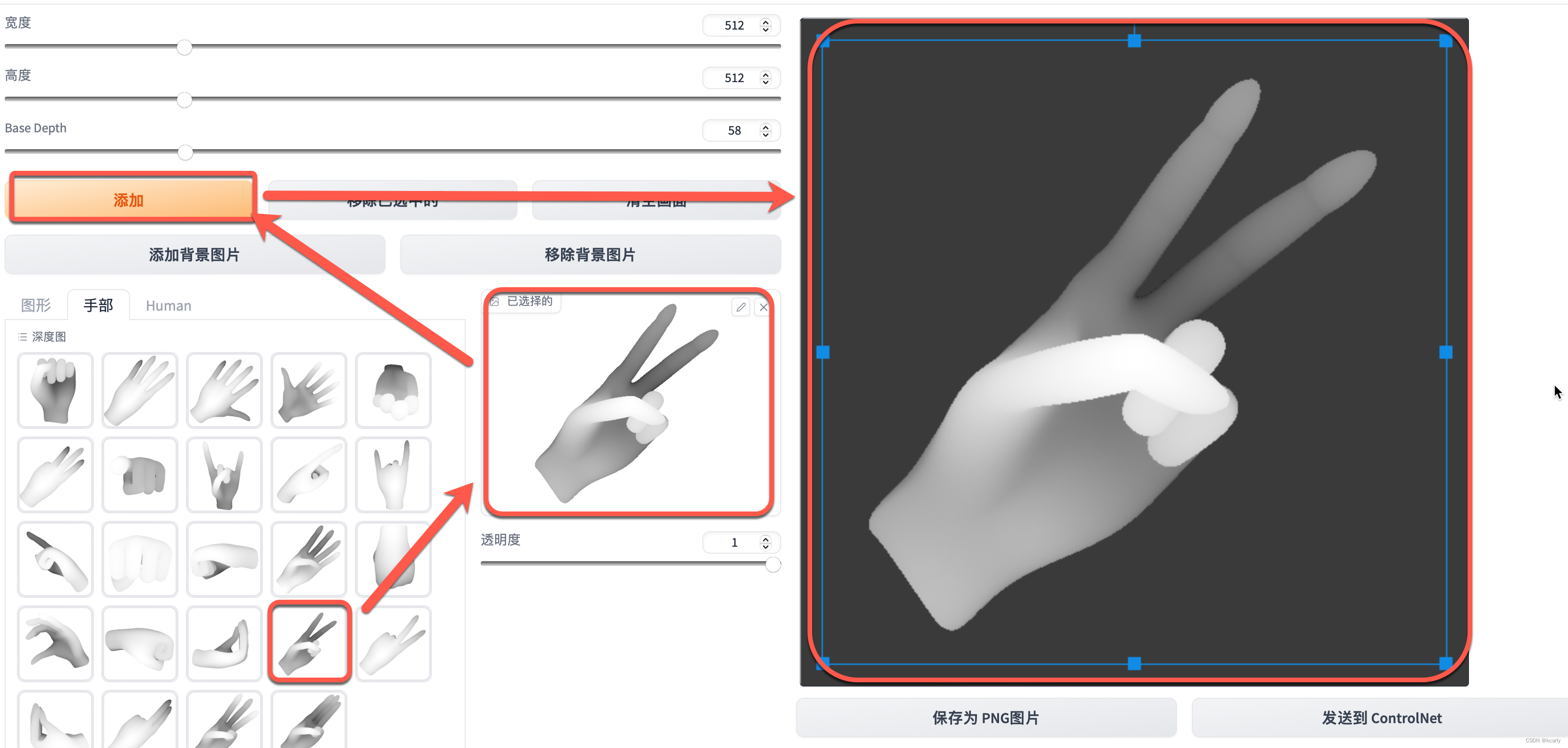

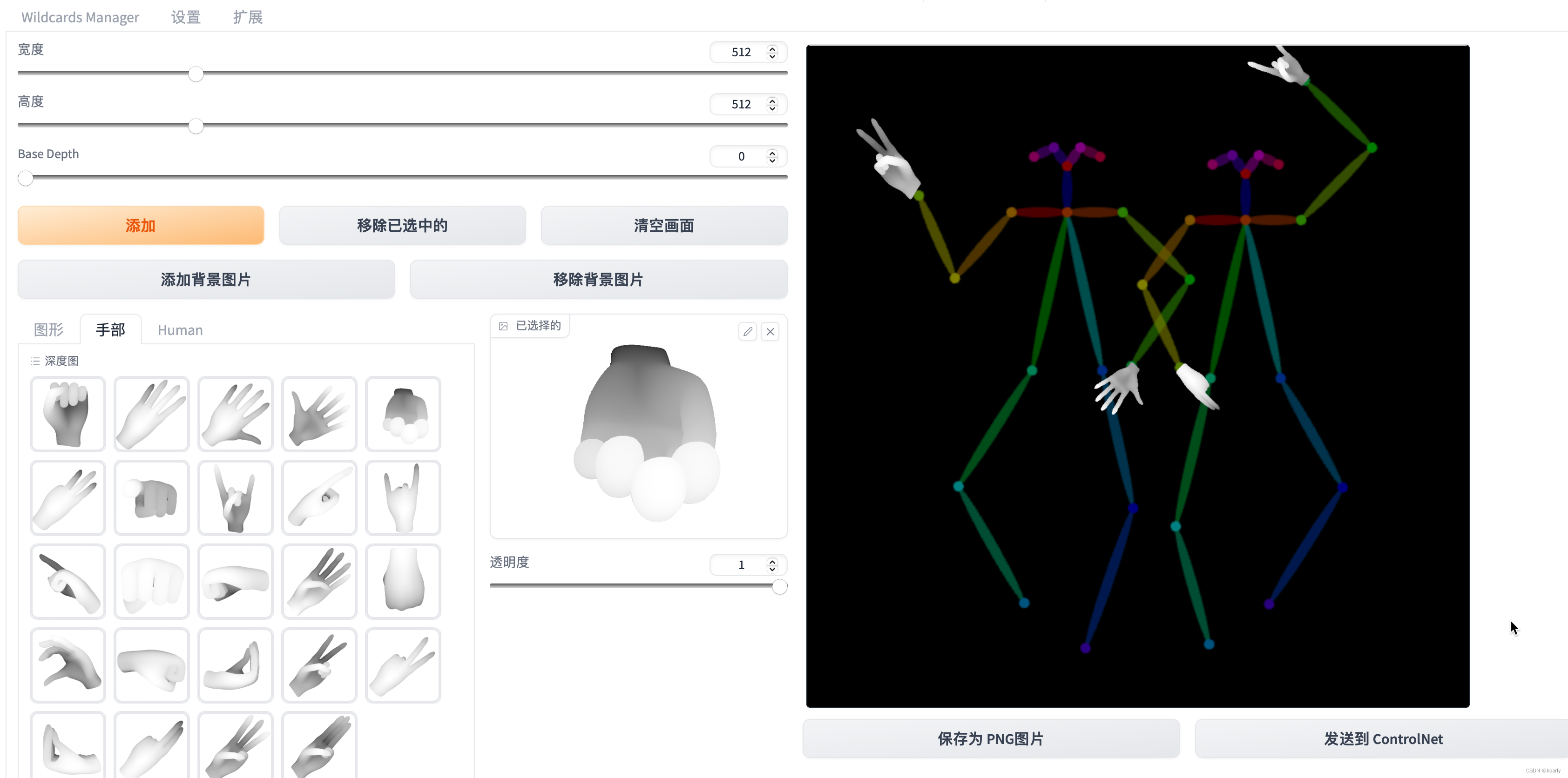

深度图像库插件,除了管理深度图像,另一个比较重要的就是配合Controlnet插件使用,经常我们对局部深度图使用时要配合图片或者pose,往往需要进行深度图与pose的姿势配合,通过深度图插件可以较为容易的进行组合。

界面介绍:

**宽度-高度 **

这里用作调整右侧画布大小,一般与要生成的图片画布大小一致,比如在文生图中初始生成512x512大小,这里就填写512x512,如果是512x768,这里就改成512x768,相同的尺寸进行深度图与POSE组合时生成的图像会比较令人满意。

BASE DEPTH

此参数用以调整基础深度数值,调整此数值,可以后续编辑的深度图像有一个基准对比。

添加

此按钮将选择的深度图库中的深度图添加到右侧画布编辑区。

删除已选中

此按钮将选择的深度图从右侧画布删除。(右侧画布不支持del按键)

清空画布

画布清空。

添加背景图

添加pose(火柴人),或者是图画(图生图模式下 进行局部重绘时一般会将原画作为背景上传,然后将深度图增加上进行摆位置)

删除背景

就是删除背景,更换背景时使用。

深度图编辑

深度图添加到右侧后经常需要编辑位置与角度

上传背景POSE或图像后配合摆深度图位置和姿势

摆好后可以点击保存png或者发送到Controlnet(会转到文生图)

在文生图中开启controlnet,并配合pose图 就可以引导生成结果了 。

如果生成图不满意某部分,同样可通过添加背景,摆好新的深度图,可以在图生图中进行局部修复重绘某部分,比如修改部分崩掉的手……

后记

虽然controlnet已经十分强大了,但是手部绘制依然是很难得事情,手部在图像中较大,且景深层次分明的情况下,手部绘制和修复比较容易,如果手部较小,景深图起的作用目前还是比较有限。

文中如有不当之处,欢迎留言交流。

整理的100个Lora资源

内容来自于C站,不能魔法访问C站的小伙伴可以下载使用,已经使用C站助手更新了效果图与pormpt及模型信息,下载下来之后直接解压到Lora目录即可使用。

版权归原作者 kcarly 所有, 如有侵权,请联系我们删除。