文章目录

初探MapReduce

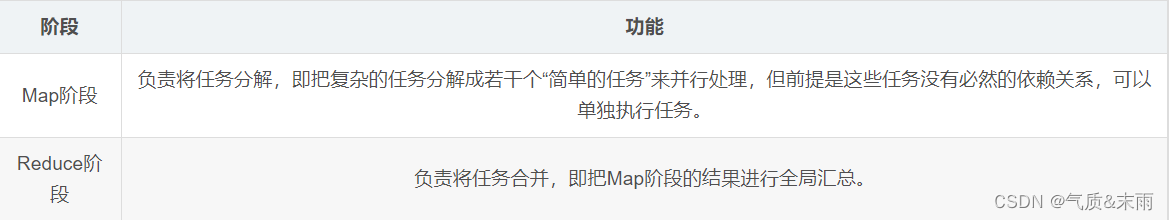

一、MapReduce核心思想

- MapReduce的核心思想是“分而治之”。所谓“分而治之”就是把一个复杂的问题,按照一定的“分解”方法分为等价的规模较小的若干部分,然后逐个解决,分别找出各部分的结果,把各部分的结果组成整个问题的结果,这种思想来源于日常生活与工作时的经验,同样也完全适合技术领域。

- MapReduce作为一种分布式计算模型,它主要用于解决海量数据的计算问题。使用MapReduce操作海量数据时,每个MapReduce程序被初始化为一个工作任务,每个工作任务可以分为Map和Reduce两个阶段。

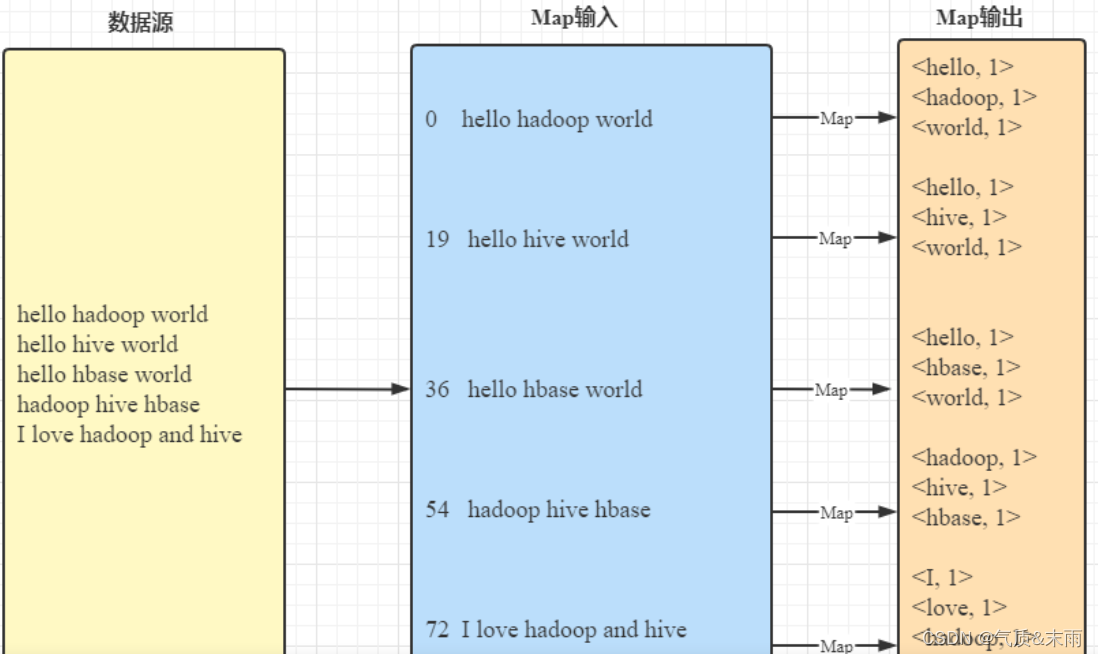

二、MapReduce编程实例-词频统计思路

1、map阶段(映射)

输入键值对=>输出键值对

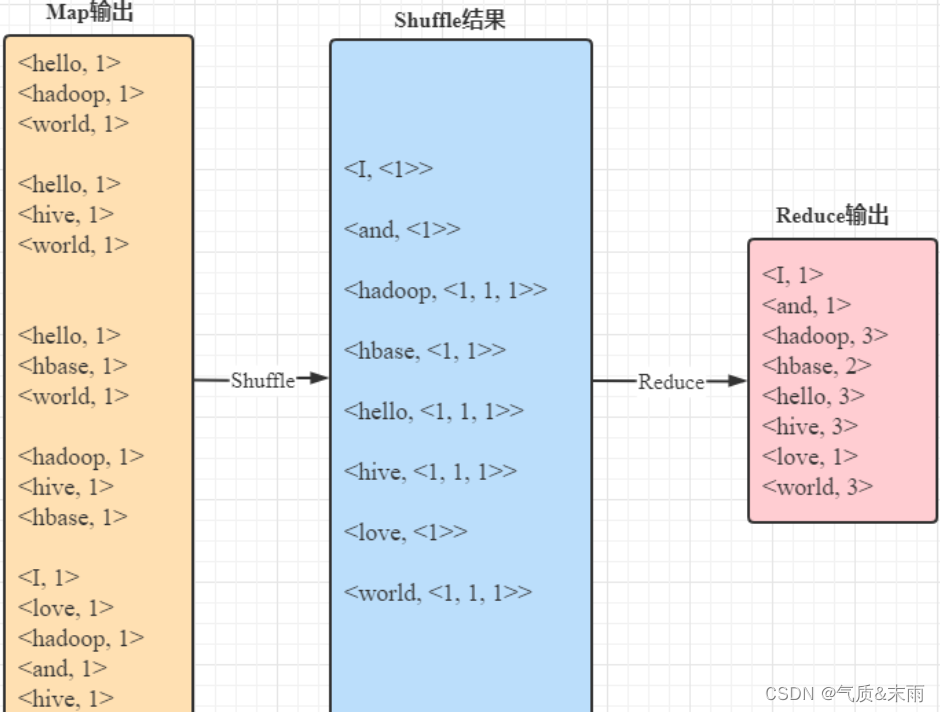

2、reduce阶段(归并阶段)

三、词频统计编程实现

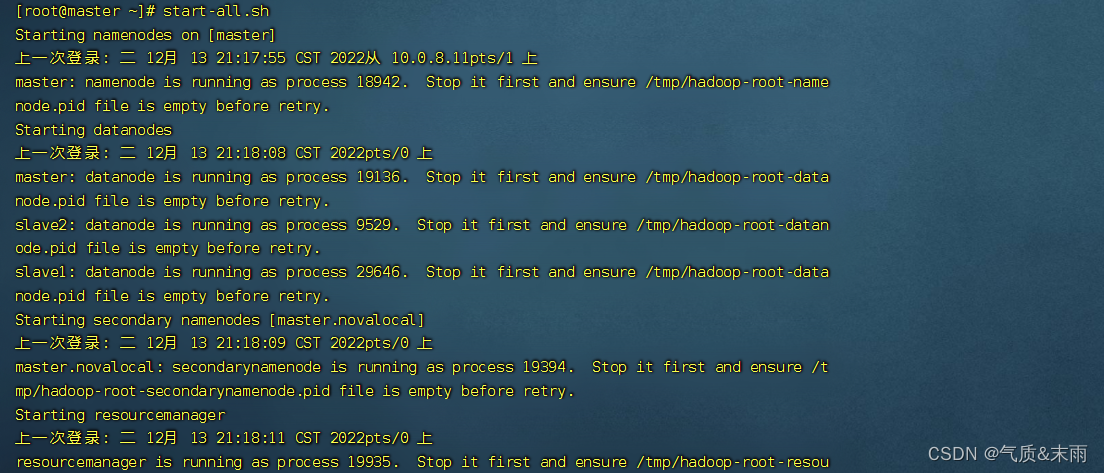

启动hadoop任务,输入命令:start-all.sh

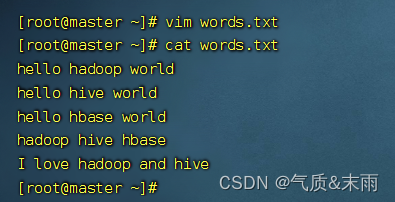

1、准备数据文件

在linux虚拟机上,创建一个文本文件,存放需要的数据

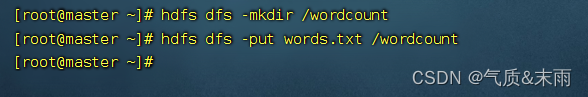

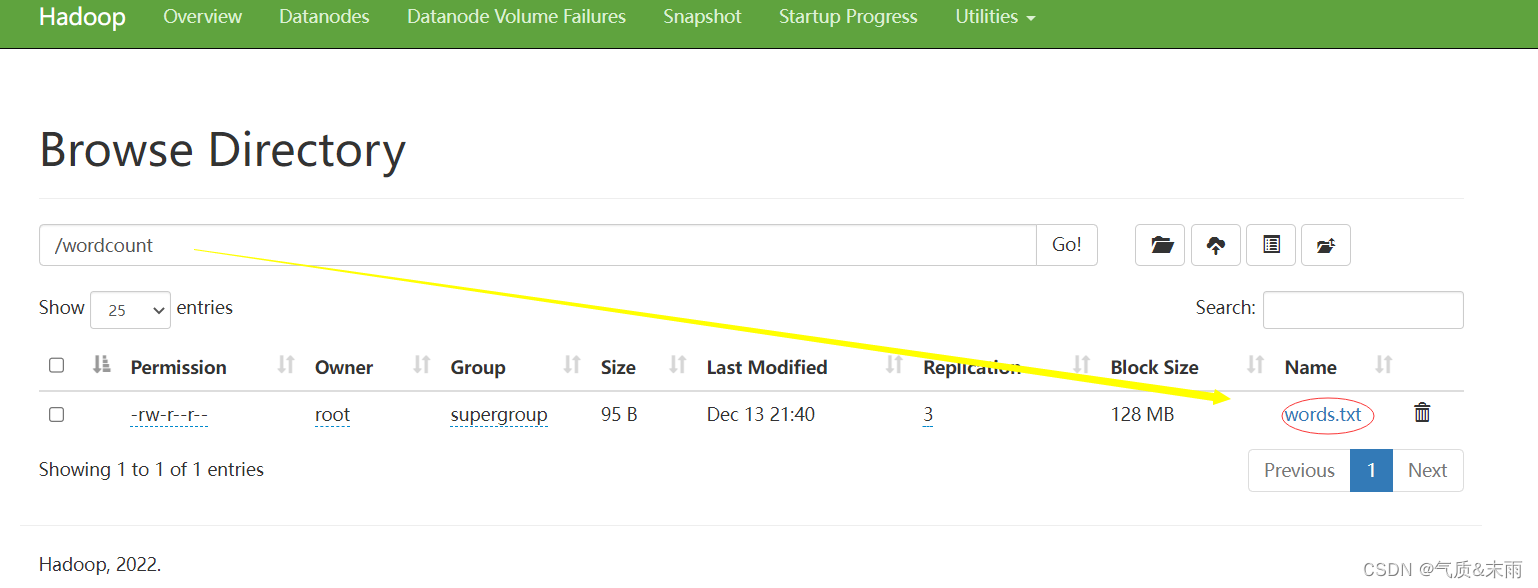

2、将文件上传到hdfs指定路径

首先在hdfs上创建

/wordcount

目录

输入命令:

hdfs dfs -mkdir /wordcount

然后将刚刚创建的words.txt文件,上传到这个目录下

在webUI界面上进行查看

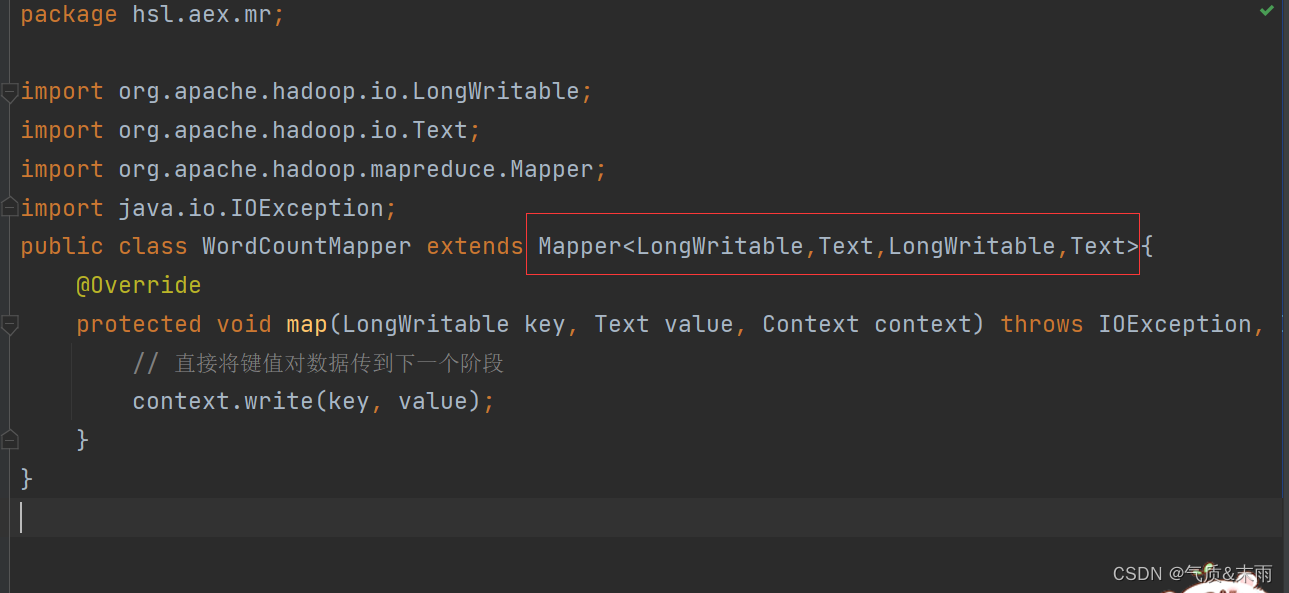

3、在java里创建词频统计映射器类

创建

hsl.aex.mr

包,在包里创建

WordCountMappe

r类

为了更好理解Mapper类的作用,在map()函数里暂时不进行每行文本分词处理,直接利用context输出key和value

packagehsl.aex.mr;importorg.apache.hadoop.io.LongWritable;importorg.apache.hadoop.io.Text;importorg.apache.hadoop.mapreduce.Mapper;importjava.io.IOException;publicclassWordCountMapperextendsMapper<LongWritable,Text,LongWritable,Text>{@Overrideprotectedvoidmap(LongWritable key,Text value,Context context)throwsIOException,InterruptedException{// 直接将键值对数据传到下一个阶段

context.write(key, value);}}

Mapper<泛型参数1, 泛型参数2, 泛型参数3, 泛型参数4>参数说明

注意:MR应用,必须有映射器(Mapper),但是归并器(Reducer)可有可无

4、创建词频统计驱动类

在

hsl.aex.mr

包里创建

WordCountDriver

类

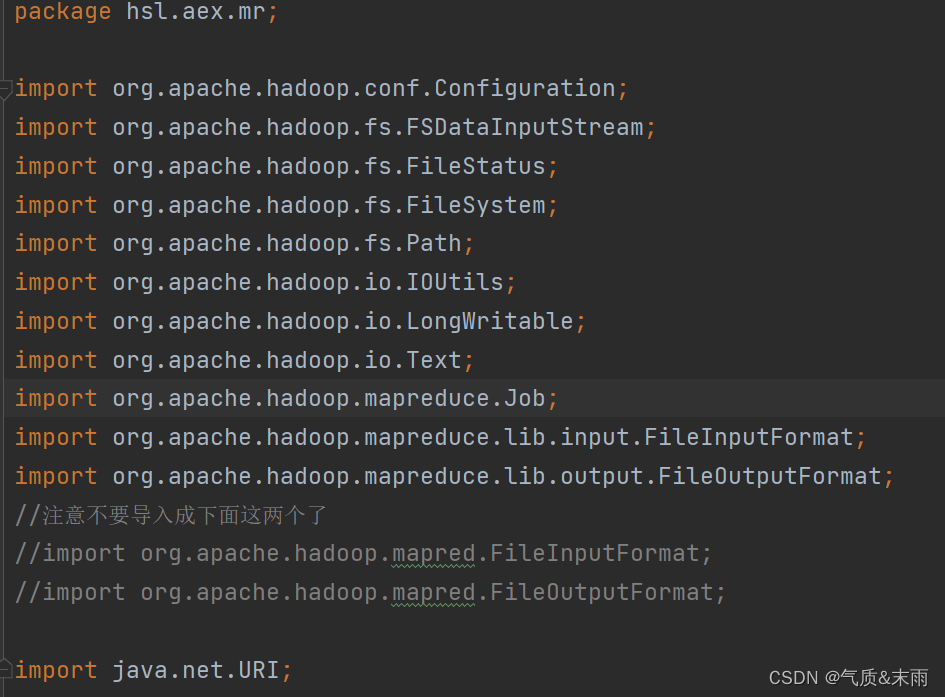

packagehsl.aex.mr;importorg.apache.hadoop.conf.Configuration;importorg.apache.hadoop.fs.FSDataInputStream;importorg.apache.hadoop.fs.FileStatus;importorg.apache.hadoop.fs.FileSystem;importorg.apache.hadoop.fs.Path;importorg.apache.hadoop.io.IOUtils;importorg.apache.hadoop.io.LongWritable;importorg.apache.hadoop.io.Text;importorg.apache.hadoop.mapreduce.Job;importorg.apache.hadoop.mapreduce.lib.input.FileInputFormat;importorg.apache.hadoop.mapreduce.lib.output.FileOutputFormat;importjava.net.URI;publicclassWordCountDriver{publicstaticvoidmain(String[] args)throwsException{// 创建配置对象Configuration conf =newConfiguration();// 设置数据节点主机名属性

conf.set("dfs.client.use.datanode.hostname","true");// 获取作业实例Job job =Job.getInstance(conf);// 设置作业启动类

job.setJarByClass(WordCountDriver.class);// 设置Mapper类

job.setMapperClass(WordCountMapper.class);// 设置map任务输出键类型

job.setMapOutputKeyClass(LongWritable.class);// 设置map任务输出值类型

job.setMapOutputValueClass(Text.class);// 定义uri字符串String uri ="hdfs://master:9000";// 创建输入目录Path inputPath =newPath(uri +"/wordcount/input/words.txt");// 创建输出目录Path outputPath =newPath(uri +"/wordcount/output");// 获取文件系统FileSystem fs =FileSystem.get(newURI(uri), conf);// 删除输出目录(第二个参数设置是否递归)

fs.delete(outputPath,true);// 给作业添加输入目录(允许多个)FileInputFormat.addInputPath(job, inputPath);// 给作业设置输出目录(只能一个)FileOutputFormat.setOutputPath(job, outputPath);// 等待作业完成

job.waitForCompletion(true);// 输出统计结果System.out.println("======统计结果======");FileStatus[] fileStatuses = fs.listStatus(outputPath);for(int i =1; i < fileStatuses.length; i++){// 输出结果文件路径System.out.println(fileStatuses[i].getPath());// 获取文件系统数据字节输入流FSDataInputStream in = fs.open(fileStatuses[i].getPath());// 将结果文件显示在控制台IOUtils.copyBytes(in,System.out,4096,false);}}}

注意导入包不要导入错了

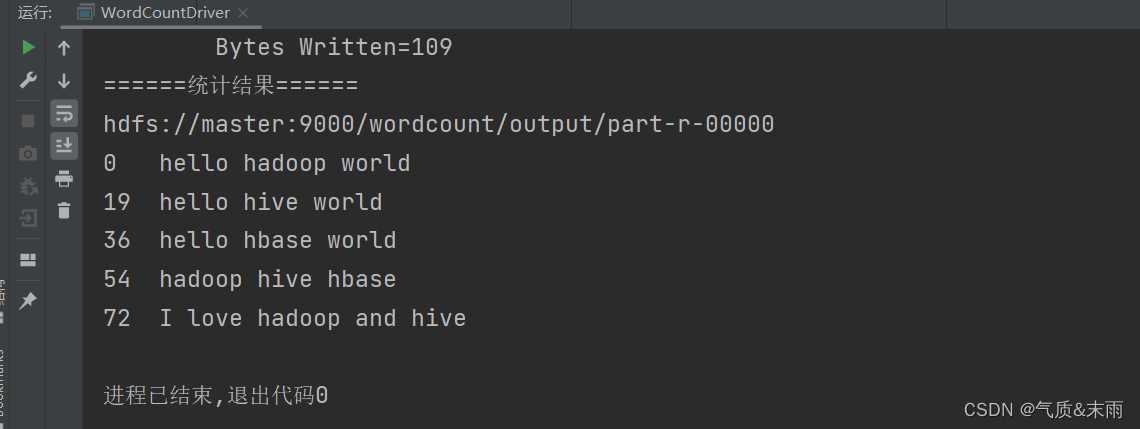

5、运行词频统计驱动类,查看结果

结果出来是这个样子,当然可能会出现很多的问题,需要具体的解决

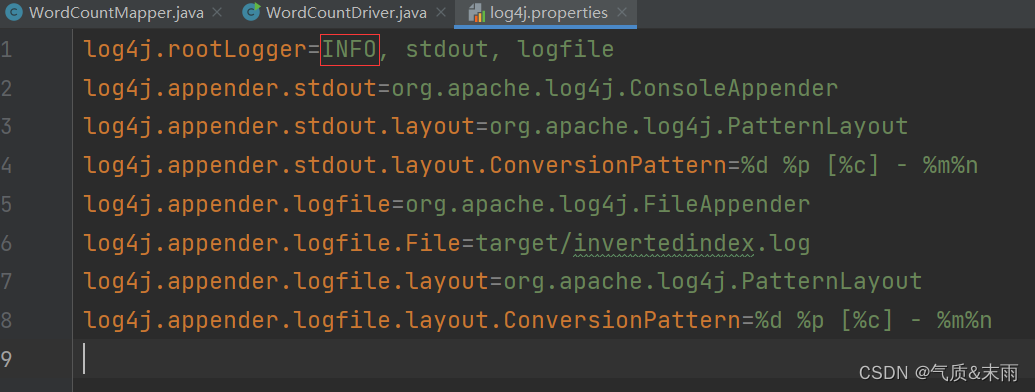

如果不想看到统计结果之前的大堆信息,可以修改

log4j.properties

文件,将

INFO

改为

ERROR

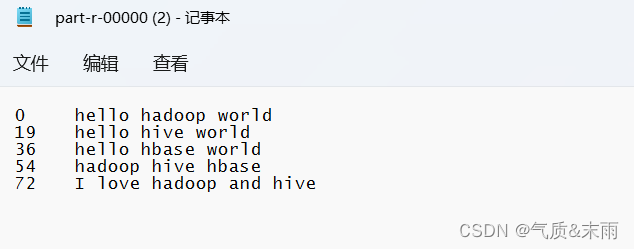

行首数字,表示每行起始位置在整个文件的偏移量(offset)。

1、第一行:hello hadoop world\n 16个字母,2个空格,1个转义字符,总共19个字符,因此,第二行起始位置在整个文件的偏移量就是19。

2、第二行:hello hive world\n 14个字母,2个空格,1个转义字符,总共17个字符,因此,第三行起始位置在整个文件的偏移量就是19 + 16 = 36。

/3、第三行:hello hbase world\n 15个字母,2个空格,1个转义字符,总共18个字符,因此,第三行起始位置在整个文件的偏移量就是19 + 16 + 18 = 54。

4、第四行:hadoop hive hbase\n 15个字母,2个空格,1个转义字符,总共18个字符,因此,第三行起始位置在整个文件的偏移量就是19 + 16 + 18 + 18 = 72。

在webUI界面上,查看结果文件

6、修改词频统计映射类

行首数字对于我们做单词统计没有任何用处,只需要拿到每一行内容,按空格拆分成单词,每个单词计数1,因此,WordCoutMapper的输出应该是单词和个数,于是,输出键类型为Text,输出值类型为IntWritable。

将每行按空格拆分成单词数组,输出<单词, 1>的键值对

packagehsl.aex.mr;importorg.apache.hadoop.io.IntWritable;importorg.apache.hadoop.io.LongWritable;importorg.apache.hadoop.io.Text;importorg.apache.hadoop.mapreduce.Mapper;importjava.io.IOException;publicclassWordCountMapperextendsMapper<LongWritable,Text,Text,IntWritable>{@Overrideprotectedvoidmap(LongWritable key,Text value,Context context)throwsIOException,InterruptedException{// 获取行内容String line = value.toString();// 按空格拆分得到单词数组String[] words = line.split(" ");//regex正则表达式// 遍历单词数组,生成输出键值对for(int i =0; i < words.length; i++){

context.write(newText(words[i]),newIntWritable(1));}}}

- 由于WordCountMapper的输出键值类型发生变化,所以必须告诉WordCountDriver

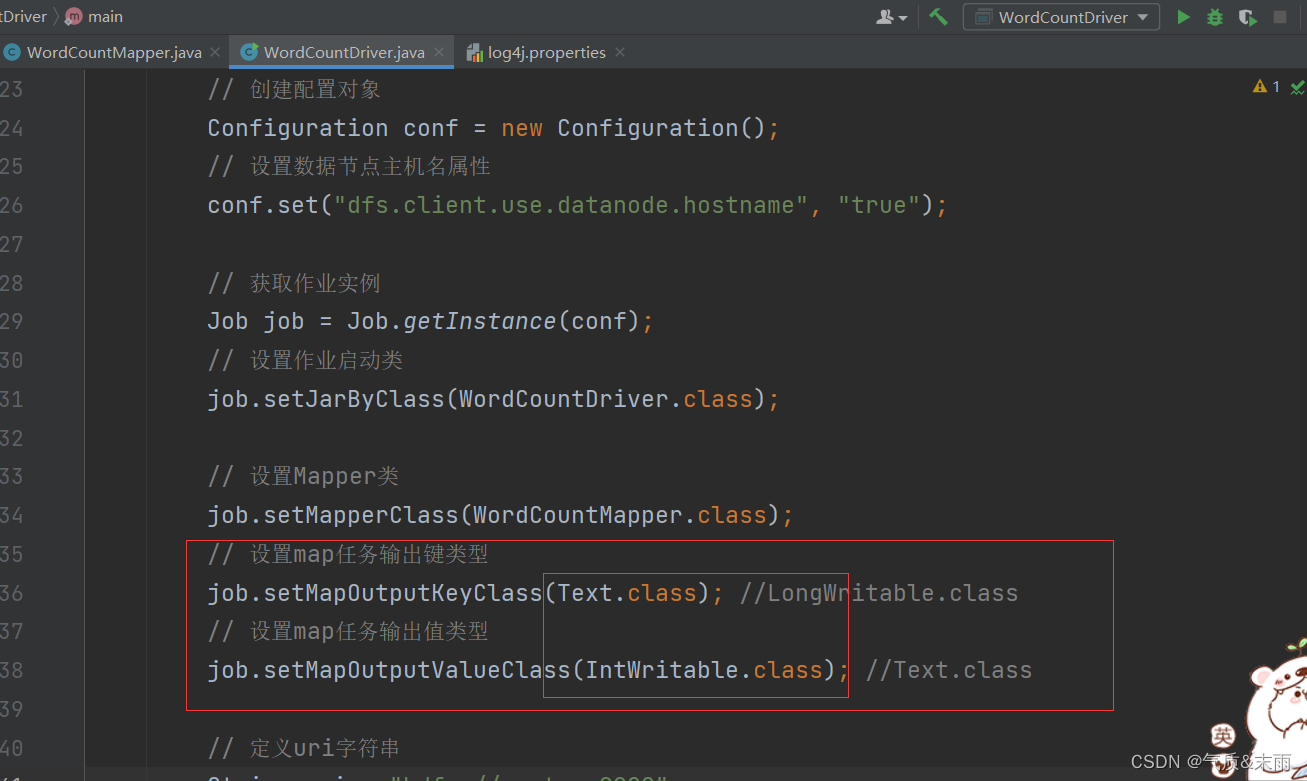

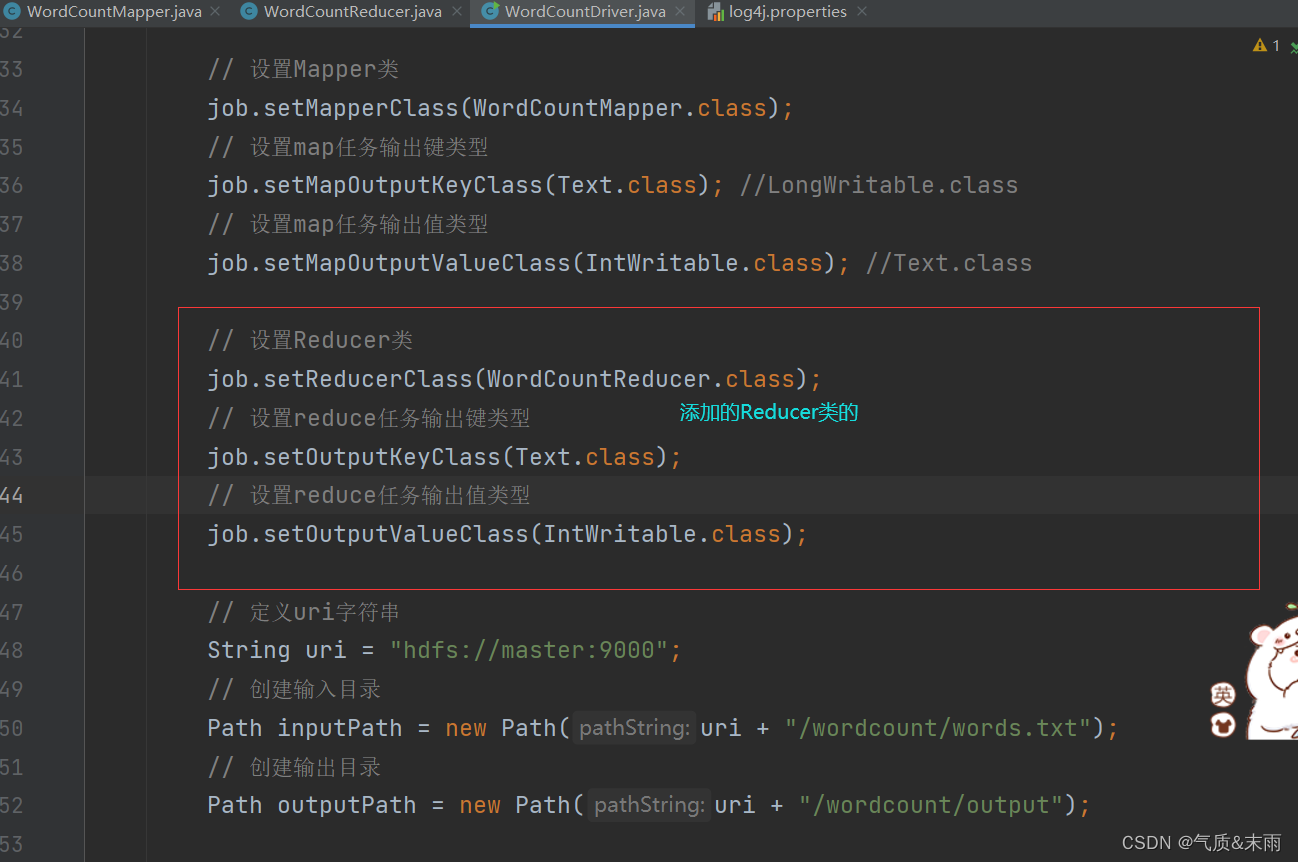

7、修改词频统计驱动器类

修改map任务输出键值类型 主要修改下面这两个

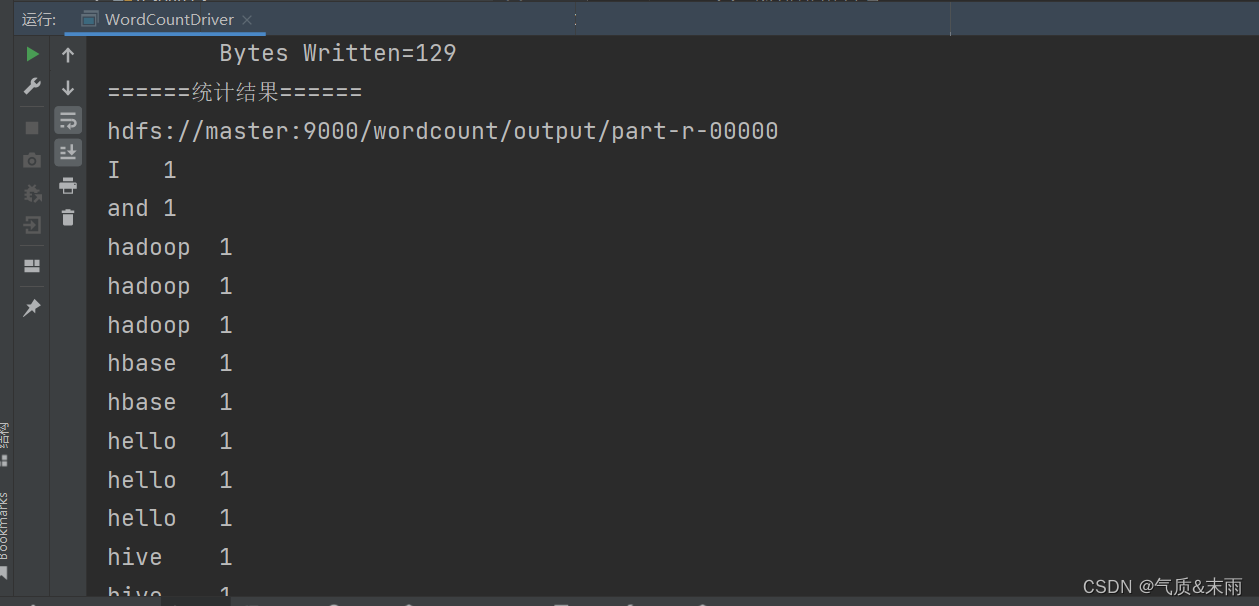

8、启动词频统计驱动器类,查看结果

观察输出结果,map阶段会按键排序输出

对于这样一组键值对,我们需要Reducer组件来进行归并处理,结果如下所示

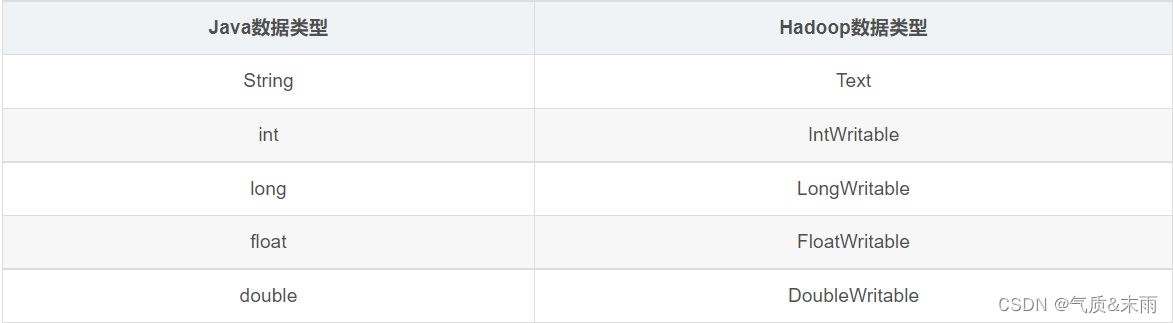

Java数据类型与Hadoop数据类型对应关系

了解map阶段的输出值(reduce阶段的输入值)是一个迭代器

WordCountReducer类和WordCountDriver类

9、创建词频统计归并器类

1、一个类继承Reducer,变成一个Reducer组件类

2、Reducer组件会接收Mapper组件的输出结果

3、第一个泛型对应的是Mapper输出key类型

4、第二个泛型对应的是Mapper输出value类型

5、第三个泛型和第四个泛型是Reducer的输出key类型和输出value类型

6、Reducer组件不能单独存在,但是Mapper组件可以单独存在

7、当引入Reducer组件后,输出结果文件内容就是Reducer的输出key和输出value

在

hsl.aex.mr

包里创建

WordCountReducer

类

packagehsl.aex.mr;importorg.apache.hadoop.io.IntWritable;importorg.apache.hadoop.io.Text;importorg.apache.hadoop.mapreduce.Reducer;importjava.io.IOException;publicclassWordCountReducerextendsReducer<Text,IntWritable,Text,IntWritable>{@Overrideprotectedvoidreduce(Text key,Iterable<IntWritable> values,Context context)throwsIOException,InterruptedException{// 定义输出键出现次数int count =0;// 遍历输出值迭代对象,统计其出现次数for(IntWritable value : values){

count = count + value.get();}// 生成键值对输出

context.write(key,newIntWritable(count));}}

由于引入了词频统计归并器,必须在词频统计驱动器类里进行设置

10、修改词频统计驱动器类

设置

WordCountDriver

,并且设置归并任务的输出键值类型

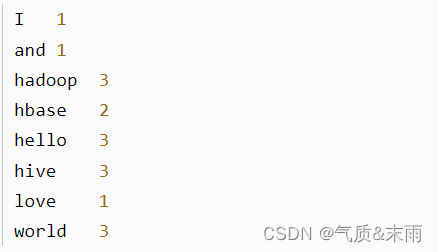

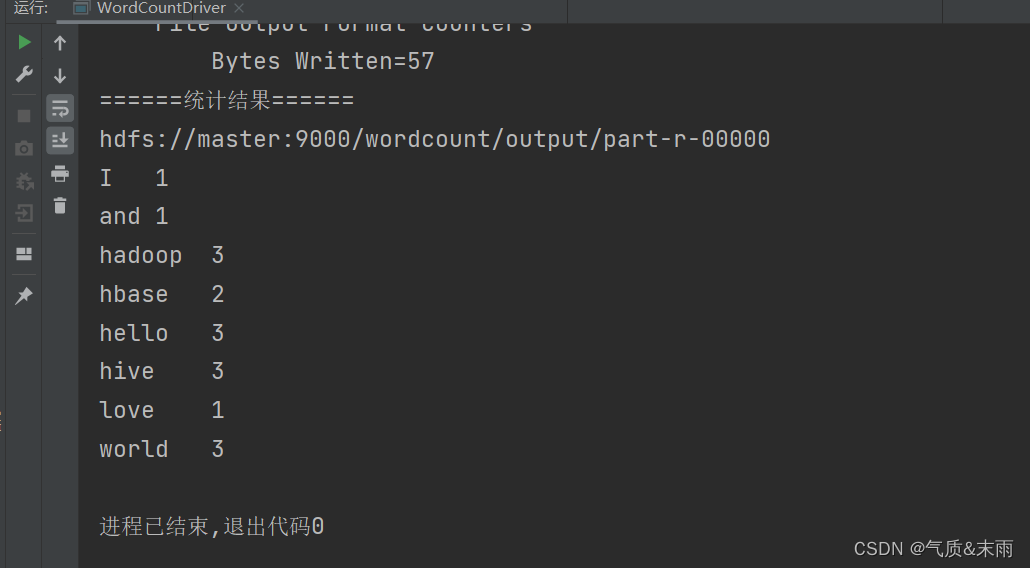

11、启动词频统计驱动器类,查看结果

统计出每个单词出现的次数

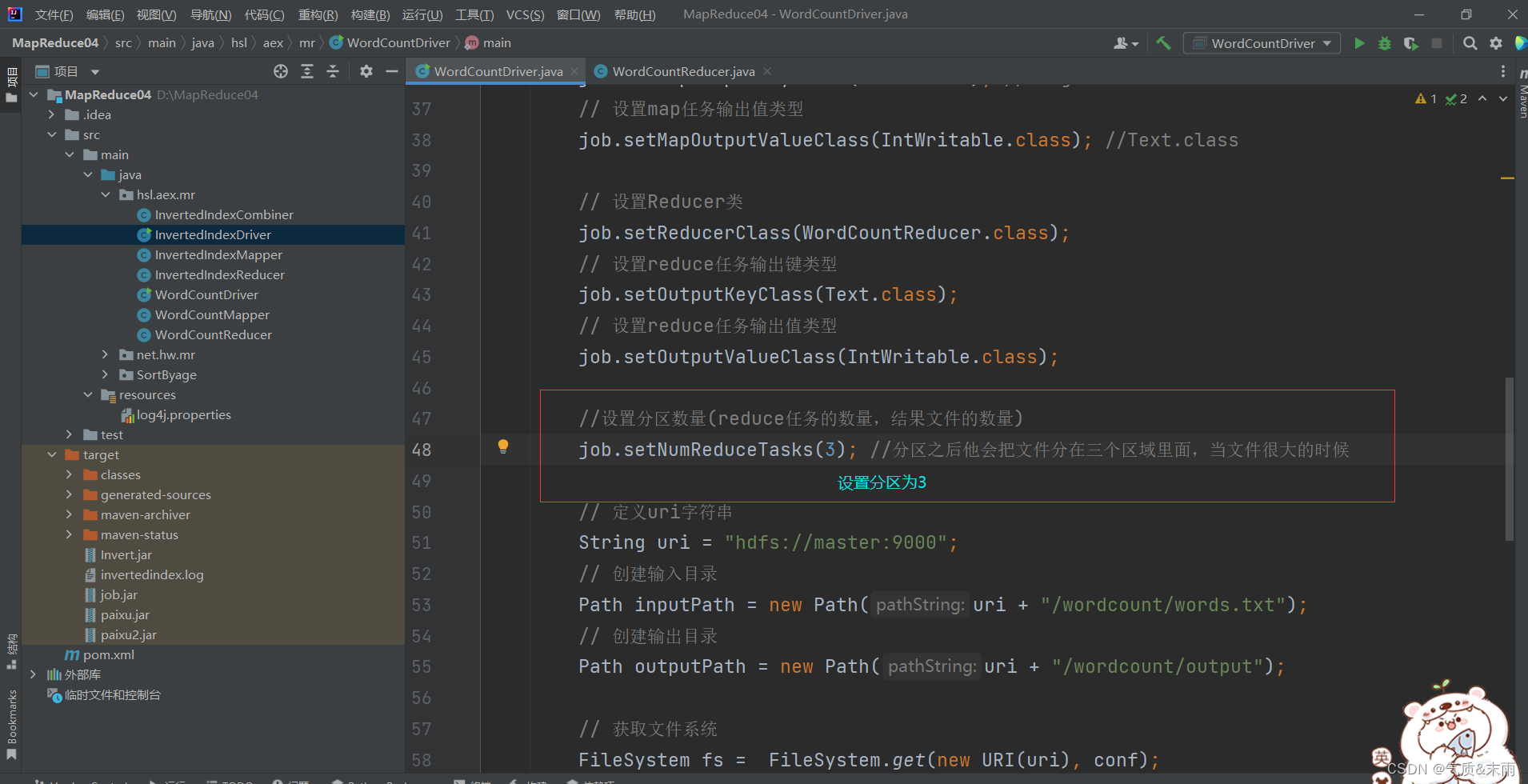

12、采用多个Reduce做合并

相同key的键值对必须发送同一分区

(一个Reduce任务对应一个分区,然后会生成对应的一个结果文件,有多少个

Reduce

任务,就会有多少个分区,最终就会产生多少个结果文件),否则同一个

key

最终会出现在不同的结果文件中,那显然不是我们希望看到的结果。

只需要增加一行代码

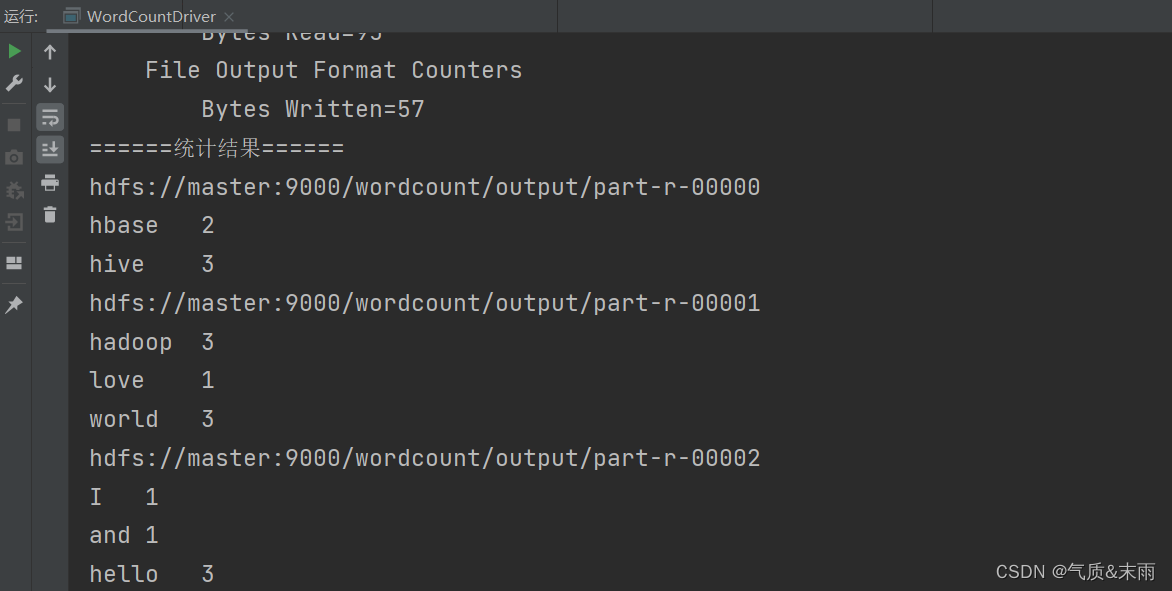

运行程序,查看结果

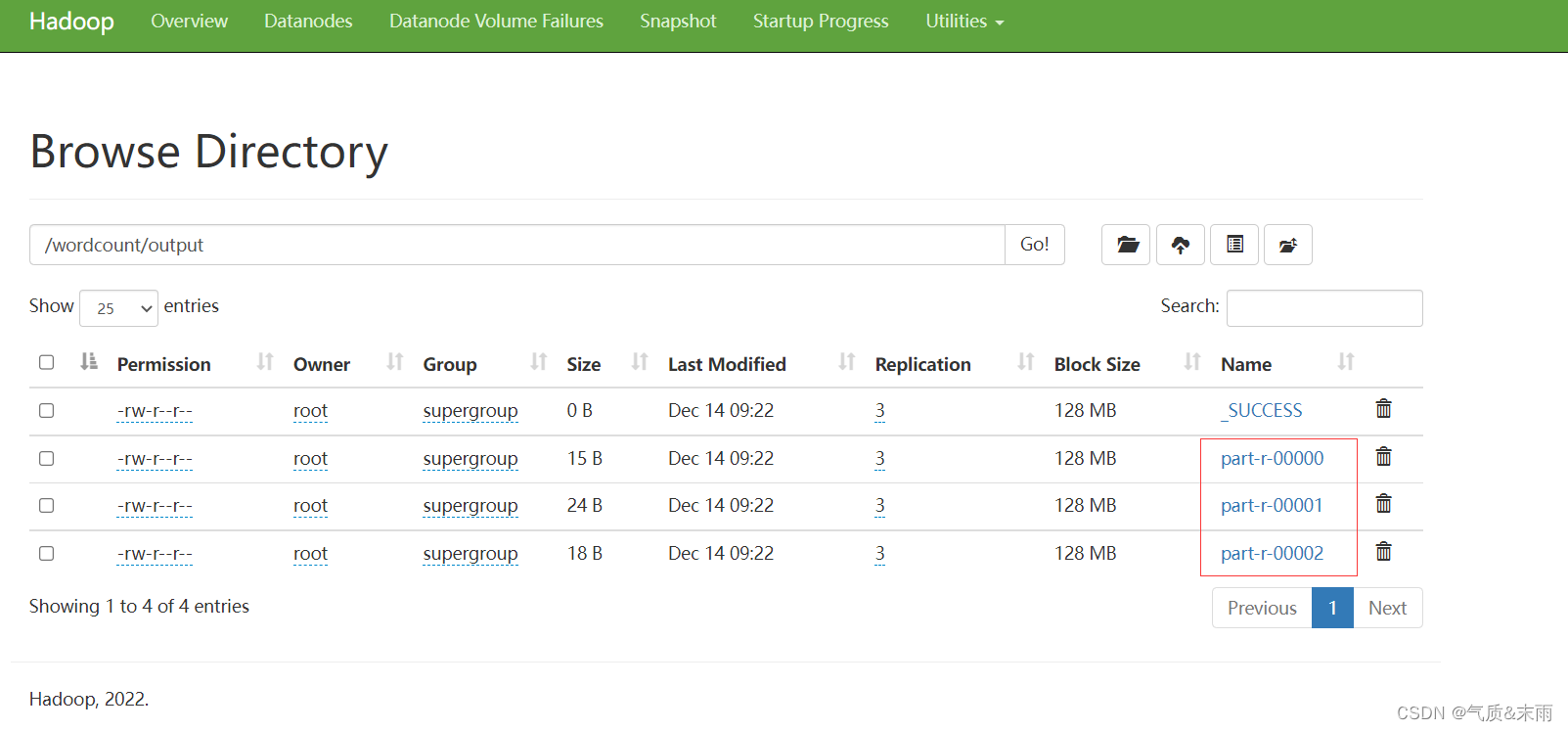

在webUI界面上进行查看 有三个结果文件,因为分了三个区

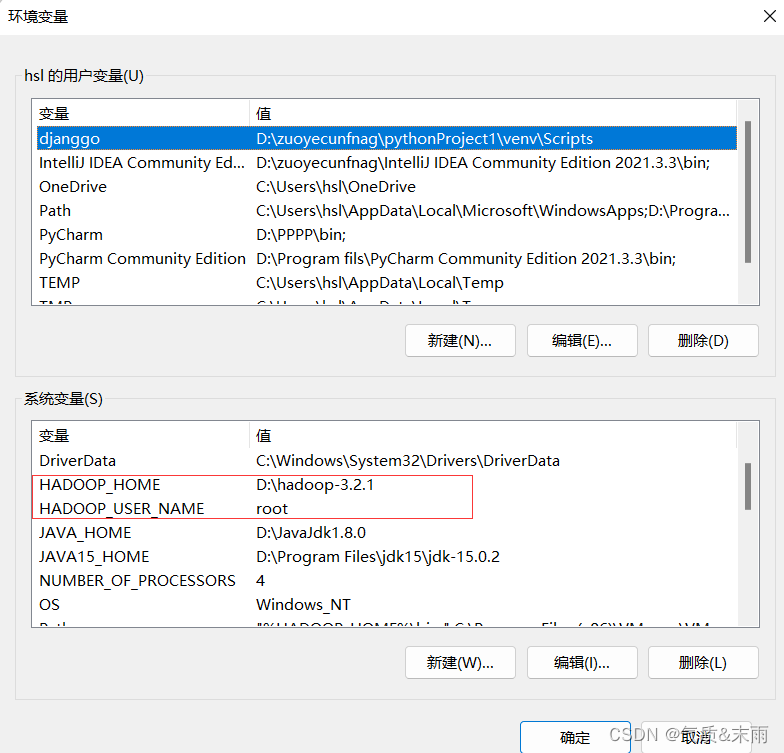

四、解决问题

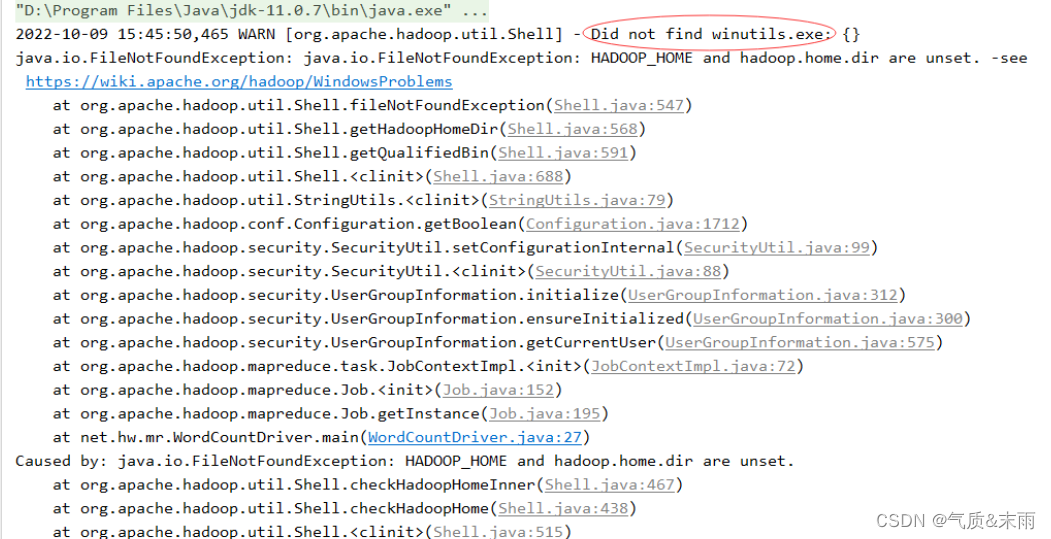

错误:Did not find winutils.exe

运行

WordCountDriver

类,报错找不到

winutils.exe

文件

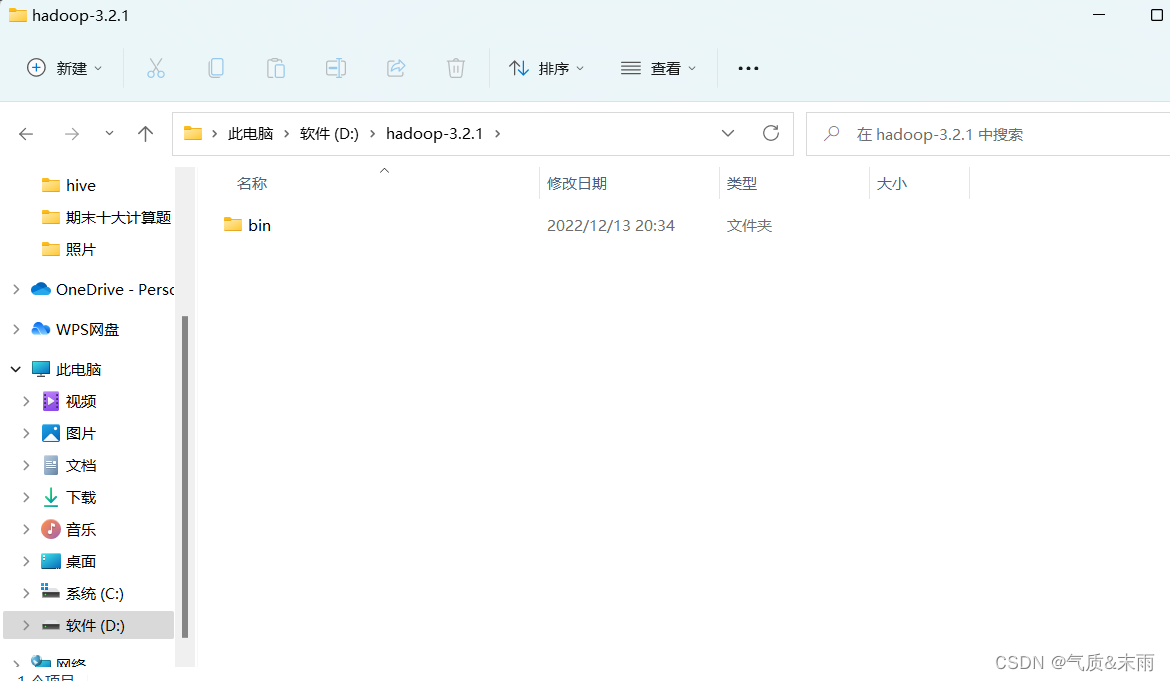

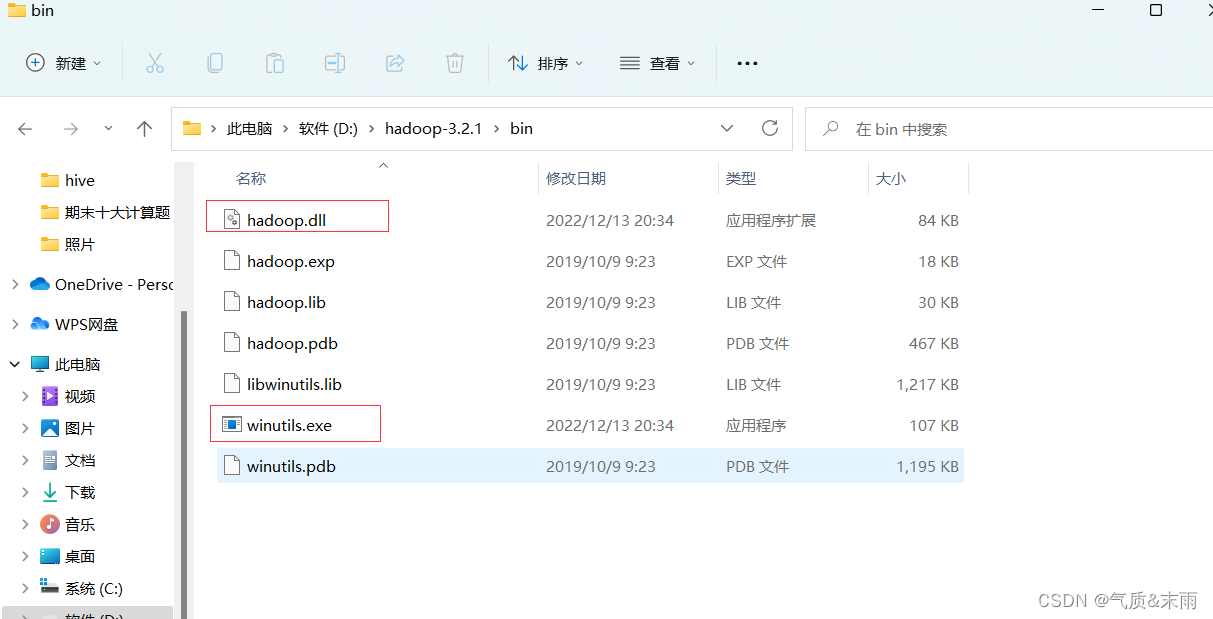

首先下载一个hadoop放在D盘下,下载对应版本的

winutils.exe

和

hadoop.dll

这两个插件放在hadoop安装目录的bin子目录里

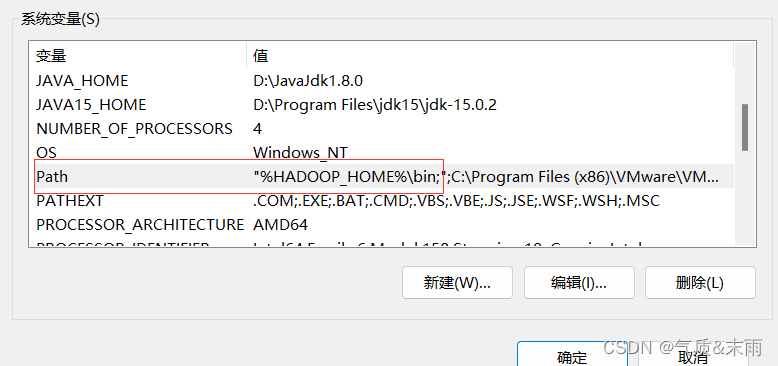

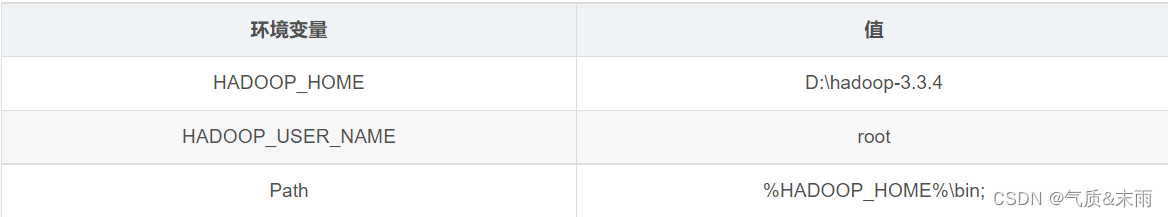

然后放进去了,还要配置环境变量,系统变量下配置这两个,HADOOP_HOME 的值是,

还有这个Path 吧HADOOP_HOME放进去

然后配置好之后,将电脑进行重启,然后重新运行程序就好了

知识点学习

(1)MR框架有两个核心组件,分别是Mapper组件和Reducer组件

(2)写一个类,继承Mapper,则变成了一个Mapper组件类

(3)LongWritable,Text(String),IntWritable,NullWritable都是Hadoop序列化类型

(4)Mapper组件将每行的行首偏移量,作为输入key,通过map()传给程序员

(5)Mapper组件会将每行内容,作为输入value,通过map()传给程序员,重点是获取输入value

(6)Mapper的第一个泛型类型对应的是输入key的类型,第二个泛型类型对应的输入value(在初学阶段,第一个和第二个类型写死)

(7)MR框架所处理的文件必须是在HDFS上的

(8)map()被调用几次,取决于文件的行数

(9)通过context进行结果的输出,以输出key和输出value的形式来输出

(10)输出key是由第三个泛型类型决定,输出value是由第四个泛型类型决定

(11)输出结果文件的数据以及行数取决于context.write

(12)Text=>String: value.toString()

(13)String=>Text:newText(string var)

(14)LongWritable=>long: key.get()

(15)long=>LongWritable:newLongWritable(longvar)

版权归原作者 气质&末雨 所有, 如有侵权,请联系我们删除。