文章目录

第1关:合并去重

任务描述

本关任务:编程实现文件合并和去重操作。

相关知识

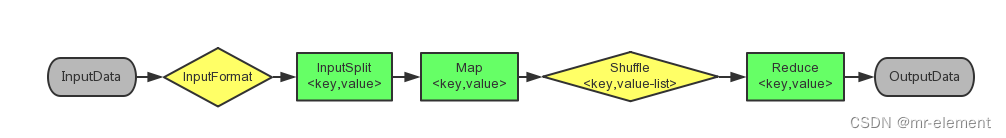

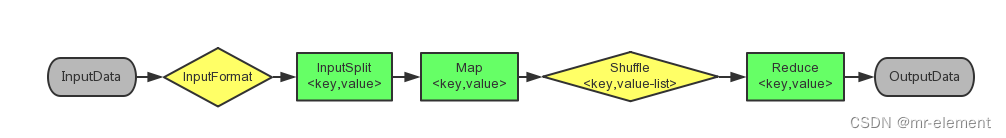

为了实现文件的合并去重,我们首先要知道文件中都有些什么,将文件内容进行“拆解”,映射(Map)到不同节点;然后在通过归约(Reduce)去除重复部分。

Map过程

用法如下:

重载

map

函数,直接将输入中的value复制到输出数据的key上。

public static class Map extends Mapper<Object, Text, Text, Text>{}

Reduce过程

重载

reduce

函数,直接将输入中的key复制到输出数据的key上。

public static class Reduce extends Reducer<Text, Text, Text, Text>{}

编程要求

对于两个输入文件,即文件

A

和文件

B

,请编写

MapReduce

程序,对两个文件进行合并,并剔除其中重复的内容,得到一个新的输出文件

C

。

为了完成文件合并去重的任务,你编写的程序要能将含有重复内容的不同文件合并到一个没有重复的整合文件,规则如下:

- 第一列按学号排列;

- 学号相同,按

x,y,z排列。

测试说明

程序会对你编写的代码进行测试:

输入已经指定了测试文本数据:需要你的程序输出合并去重后的结果。

下面是输入文件和输出文件的一个样例供参考。

输入文件A的样例如下:

20150101 x

20150102 y

20150103 x

20150104 y

20150105 z

20150106 x

输入文件B的样例如下:

20150101 y

20150102 y

20150103 x

20150104 z

20150105 y

根据输入文件A和B合并得到的输出文件C的样例如下:

20150101 x

20150101 y

20150102 y

20150103 x

20150104 y

20150104 z

20150105 y

20150105 z

20150106 x

示例代码

importjava.io.IOException;importorg.apache.hadoop.conf.Configuration;importorg.apache.hadoop.fs.Path;importorg.apache.hadoop.io.IntWritable;importorg.apache.hadoop.io.Text;importorg.apache.hadoop.mapreduce.Job;importorg.apache.hadoop.mapreduce.Mapper;importorg.apache.hadoop.mapreduce.Reducer;importorg.apache.hadoop.mapreduce.lib.input.FileInputFormat;importorg.apache.hadoop.mapreduce.lib.output.FileOutputFormat;importorg.apache.hadoop.util.GenericOptionsParser;publicclassMerge{/**

* @param args

* 对A,B两个文件进行合并,并剔除其中重复的内容,得到一个新的输出文件C

*///重载map函数,直接将输入中的value复制到输出数据的key上 /********** Begin **********/publicstaticclassMapextendsMapper<Object,Text,Text,Text>{privatestaticText text =newText();publicvoidmap(Object key,Text value,Context context)throwsIOException,InterruptedException{

text = value;

context.write(text,newText(""));}}/********** End **********///重载reduce函数,直接将输入中的key复制到输出数据的key上 /********** Begin **********/publicstaticclassReduceextendsReducer<Text,Text,Text,Text>{publicvoidreduce(Text key,Iterable<Text> values,Context context )throwsIOException,InterruptedException{

context.write(key,newText(""));}}/********** End **********/publicstaticvoidmain(String[] args)throwsException{// TODO Auto-generated method stub Configuration conf =newConfiguration();

conf.set("fs.default.name","hdfs://localhost:9000");String[] otherArgs =newString[]{"input","output"};/* 直接设置输入参数 */if(otherArgs.length !=2){System.err.println("Usage: wordcount <in> <out>");System.exit(2);}Job job =Job.getInstance(conf,"Merge and duplicate removal");

job.setJarByClass(Merge.class);

job.setMapperClass(Map.class);

job.setCombinerClass(Reduce.class);

job.setReducerClass(Reduce.class);

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(Text.class);FileInputFormat.addInputPath(job,newPath(otherArgs[0]));FileOutputFormat.setOutputPath(job,newPath(otherArgs[1]));System.exit(job.waitForCompletion(true)?0:1);}}

第1关:第2关:整合排序

任务描述

本关任务:编写程序实现对输入文件的排序。

相关知识

为了实现文件的整合排序,我们首先要知道文件中都有些什么,将文件内容进行“拆解”,映射(

Map

)到不同节点;然后在通过归约(

Reduce

)的过程中进行排序输出。

Map过程

- 输入多个文件,每个文件中的每行内容均为一个整数;

- map函数读取输入中的value,将其转化成IntWritable类型,最后作为输出key。

public static class Map extends Mapper<Object, Text, IntWritable, IntWritable>{

private static IntWritable data = new IntWritable();

}

Reduce过程

reduce函数将map输入的key复制到输出的value上;- 根据输入的

value-list中元素的个数决定key的输出次数,定义一个全局变量line_num来代表key的位次。

public static class Reduce extends Reducer<IntWritable, IntWritable, IntWritable, IntWritable>{

private static IntWritable line_num = new IntWritable(1);

}

返回Partiton ID

- 自定义

Partition函数,此函数根据输入数据的最大值和MapReduce框架中Partition的数量获取将输入数据按照大小分块的边界; - 根据输入数值和边界的关系返回对应的

Partiton ID。

public static class Partition extends Partitioner<IntWritable, IntWritable>{

public int getPartition(IntWritable key, IntWritable value, int num_Partition){

int Maxnumber = 65223;//int型的最大数值

}

编程要求

为了完成合并文件并排序的功能,你编写的程序要能将整合排序后的结果输出,规则如下:

- 现在有多个输入文件,每个文件中的每行内容均为一个整数。要求读取所有文件中的整数,进行升序排序后,输出到一个新的文件中;

- 输出的数据格式为每行两个整数,第一个数字为第二个整数的排序位次,第二个整数为原待排列的整数。

测试说明

程序会对你编写的代码进行测试:

下面是输入文件和输出文件的一个样例供参考。

输入文件1的样例如下:

33

37

12

40

输入文件2的样例如下:

4

16

39

5

输入文件3的样例如下:

1

45

25

根据输入文件1、2和3得到的输出文件如下:

1 1

2 4

3 5

4 12

5 16

6 25

7 33

8 37

9 39

10 40

11 45

示例代码

importjava.io.IOException;importorg.apache.hadoop.conf.Configuration;importorg.apache.hadoop.fs.Path;importorg.apache.hadoop.io.IntWritable;importorg.apache.hadoop.io.Text;importorg.apache.hadoop.mapreduce.Job;importorg.apache.hadoop.mapreduce.Mapper;importorg.apache.hadoop.mapreduce.Partitioner;importorg.apache.hadoop.mapreduce.Reducer;importorg.apache.hadoop.mapreduce.lib.input.FileInputFormat;importorg.apache.hadoop.mapreduce.lib.output.FileOutputFormat;importorg.apache.hadoop.util.GenericOptionsParser;publicclassMergeSort{/**

* @param args

* 输入多个文件,每个文件中的每行内容均为一个整数

* 输出到一个新的文件中,输出的数据格式为每行两个整数,第一个数字为第二个整数的排序位次,第二个整数为原待排列的整数

*///map函数读取输入中的value,将其转化成IntWritable类型,最后作为输出key publicstaticclassMapextendsMapper<Object,Text,IntWritable,IntWritable>{privatestaticIntWritable data =newIntWritable();publicvoidmap(Object key,Text value,Context context)throwsIOException,InterruptedException{/********** Begin **********/String text = value.toString();

data.set(Integer.parseInt(text));

context.write(data,newIntWritable(1));/********** End **********/}}//reduce函数将map输入的key复制到输出的value上,然后根据输入的value-list中元素的个数决定key的输出次数,定义一个全局变量line_num来代表key的位次 publicstaticclassReduceextendsReducer<IntWritable,IntWritable,IntWritable,IntWritable>{privatestaticIntWritable line_num =newIntWritable(1);publicvoidreduce(IntWritable key,Iterable<IntWritable> values,Context context)throwsIOException,InterruptedException{/********** Begin **********/for(IntWritable val : values){

context.write(line_num, key);

line_num =newIntWritable(line_num.get()+1);}/********** End **********/}}//自定义Partition函数,此函数根据输入数据的最大值和MapReduce框架中Partition的数量获取将输入数据按照大小分块的边界,然后根据输入数值和边界的关系返回对应的Partiton ID publicstaticclassPartitionextendsPartitioner<IntWritable,IntWritable>{publicintgetPartition(IntWritable key,IntWritable value,int num_Partition){/********** Begin **********/intMaxnumber=65223;//int型的最大数值 int bound =Maxnumber/num_Partition+1;int keynumber = key.get();for(int i =0; i<num_Partition; i++){if(keynumber<bound *(i+1)&& keynumber>=bound * i){return i;}}return-1;/********** End **********/}}publicstaticvoidmain(String[] args)throwsException{// TODO Auto-generated method stub Configuration conf =newConfiguration();

conf.set("fs.default.name","hdfs://localhost:9000");String[] otherArgs =newString[]{"input","output"};/* 直接设置输入参数 */if(otherArgs.length !=2){System.err.println("Usage: wordcount <in> <out>");System.exit(2);}Job job =Job.getInstance(conf,"Merge and sort");

job.setJarByClass(MergeSort.class);

job.setMapperClass(Map.class);

job.setReducerClass(Reduce.class);

job.setPartitionerClass(Partition.class);

job.setOutputKeyClass(IntWritable.class);

job.setOutputValueClass(IntWritable.class);FileInputFormat.addInputPath(job,newPath(otherArgs[0]));FileOutputFormat.setOutputPath(job,newPath(otherArgs[1]));System.exit(job.waitForCompletion(true)?0:1);}}

第3关:信息挖掘

任务描述

本关任务:对给定的表格进行信息挖掘。

相关知识

Map过程

Map将输入文件按照空格分割成child和parent,然后正序输出一次作为右表,反序输出一次作为左表,需要注意的是在输出的value中必须加上左右表区别标志;- 在

Map阶段,将父子关系与相反的子父关系,同时在各个value前补上前缀-与+标识此key-value中的value是正序还是逆序产生的,之后进入context。

public static class Map extends Mapper<Object, Text, Text, Text>{

public void map(Object key, Text value, Context context) throws IOException,InterruptedException{

String child_name = new String();

String parent_name = new String();

}

Reduce过程

public static class Reduce extends Reducer<Text, Text, Text, Text>{

public void reduce(Text key, Iterable<Text> values,Context context) throws IOException,InterruptedException{

if(time == 0){ //输出表头

context.write(new Text("grand_child"), new Text("grand_parent"));

time++;

}

}

编程要求

为了完成信息挖掘的任务,你编写的程序要能挖掘父子辈关系,给出祖孙辈关系的表格。规则如下:

- 孙子在前,祖父在后;

- 孙子相同,祖父的名字按照A-Z排列。

测试说明

程序会对你编写的代码进行测试:

下面给出一个

child-parent

的表格,要求挖掘其中的父子辈关系,给出祖孙辈关系的表格。

输入文件内容如下:

child parent

Steven Lucy

Steven Jack

Jone Lucy

Jone Jack

Lucy Mary

Lucy Frank

Jack Alice

Jack Jesse

David Alice

David Jesse

Philip David

Philip Alma

Mark David

Mark Alma

输出文件内容如下:

grandchild grandparent

Steven Alice

Steven Jesse

Jone Alice

Jone Jesse

Steven Mary

Steven Frank

Jone Mary

Jone Frank

Philip Alice

Philip Jesse

Mark Alice

Mark Jesse

示例代码

importjava.io.IOException;importjava.util.*;importorg.apache.hadoop.conf.Configuration;importorg.apache.hadoop.fs.Path;importorg.apache.hadoop.io.IntWritable;importorg.apache.hadoop.io.Text;importorg.apache.hadoop.mapreduce.Job;importorg.apache.hadoop.mapreduce.Mapper;importorg.apache.hadoop.mapreduce.Reducer;importorg.apache.hadoop.mapreduce.lib.input.FileInputFormat;importorg.apache.hadoop.mapreduce.lib.output.FileOutputFormat;importorg.apache.hadoop.util.GenericOptionsParser;publicclass simple_data_mining {publicstaticint time =0;/**

* @param args

* 输入一个child-parent的表格

* 输出一个体现grandchild-grandparent关系的表格

*///Map将输入文件按照空格分割成child和parent,然后正序输出一次作为右表,反序输出一次作为左表,需要注意的是在输出的value中必须加上左右表区别标志 publicstaticclassMapextendsMapper<Object,Text,Text,Text>{publicvoidmap(Object key,Text value,Context context)throwsIOException,InterruptedException{/********** Begin **********/String child_name =newString();String parent_name =newString();String relation_type =newString();String line = value.toString();int i =0;while(line.charAt(i)!=' '){

i++;}String[] values ={line.substring(0,i),line.substring(i+1)};if(values[0].compareTo("child")!=0){

child_name = values[0];

parent_name = values[1];

relation_type ="1";//左右表区分标志

context.write(newText(values[1]),newText(relation_type+"+"+child_name+"+"+parent_name));//左表

relation_type ="2";

context.write(newText(values[0]),newText(relation_type+"+"+child_name+"+"+parent_name));//右表 }/********** End **********/}}publicstaticclassReduceextendsReducer<Text,Text,Text,Text>{publicvoidreduce(Text key,Iterable<Text> values,Context context)throwsIOException,InterruptedException{/********** Begin **********/if(time ==0){//输出表头

context.write(newText("grand_child"),newText("grand_parent"));

time++;}int grand_child_num =0;String grand_child[]=newString[10];int grand_parent_num =0;String grand_parent[]=newString[10];Iterator ite = values.iterator();while(ite.hasNext()){String record = ite.next().toString();int len = record.length();int i =2;if(len ==0)continue;char relation_type = record.charAt(0);String child_name =newString();String parent_name =newString();//获取value-list中value的child while(record.charAt(i)!='+'){

child_name = child_name + record.charAt(i);

i++;}

i=i+1;//获取value-list中value的parent while(i<len){

parent_name = parent_name+record.charAt(i);

i++;}//左表,取出child放入grand_child if(relation_type =='1'){

grand_child[grand_child_num]= child_name;

grand_child_num++;}else{//右表,取出parent放入grand_parent

grand_parent[grand_parent_num]= parent_name;

grand_parent_num++;}}if(grand_parent_num !=0&& grand_child_num !=0){for(int m =0;m<grand_child_num;m++){for(int n=0;n<grand_parent_num;n++){

context.write(newText(grand_child[m]),newText(grand_parent[n]));//输出结果 }}}/********** End **********/}}publicstaticvoidmain(String[] args)throwsException{// TODO Auto-generated method stub Configuration conf =newConfiguration();

conf.set("fs.default.name","hdfs://localhost:9000");String[] otherArgs =newString[]{"input","output"};/* 直接设置输入参数 */if(otherArgs.length !=2){System.err.println("Usage: wordcount <in> <out>");System.exit(2);}Job job =Job.getInstance(conf,"Single table join ");

job.setJarByClass(simple_data_mining.class);

job.setMapperClass(Map.class);

job.setReducerClass(Reduce.class);

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(Text.class);FileInputFormat.addInputPath(job,newPath(otherArgs[0]));FileOutputFormat.setOutputPath(job,newPath(otherArgs[1]));System.exit(job.waitForCompletion(true)?0:1);}}

版权归原作者 mr-element 所有, 如有侵权,请联系我们删除。